tum专题

基于神经塑性的地球观测多模态基础模型 (慕尼黑工业大学, TUM)

Neural Plasticity-Inspired Multimodal Foundation Model for Earth Observation 2403.15356 (arxiv.org) ------| 本博客非完整版,完整版请参阅原文 |------ Abstract 基础模型的发展彻底改变了利用卫星观测数据解释地球表面的能力。传统模型相互孤立,专为特定传感器或数据

使用自己的TUM数据集来实现ORBSLAM稠密建图

简介 项目链接:https://github.com/LeonardoDiCaprio1/Map_ORBSLAM_ROS奥比中光ROS功能驱动包:https://github.com/LeonardoDiCaprio1/astra_camera笔者参照很多大佬的文章和相关代码并添加了一些功能而且最终编译出来,现在分享给大家 硬件设备 奥比中光深度相机(Astra)笔记本电脑(AMD)

VINS-fusion 跑通Euroc、TUM、KITTI数据集,以及评估工具EVO的下载和使用

零、EVO工具获取与使用 ubuntu20.04中python版本是3.x,因此对应的pip工具会变成pip3,可以先参考如下链接查看自己系统的python和pip版本。 Ubuntu20.04安装evo(详细教程)【亲测有效】_ubantu20.04 evo_学无止境的小龟的博客-CSDN博客 再调用如下命令对evo工具进行安装 pip3 install evo --upgrade --

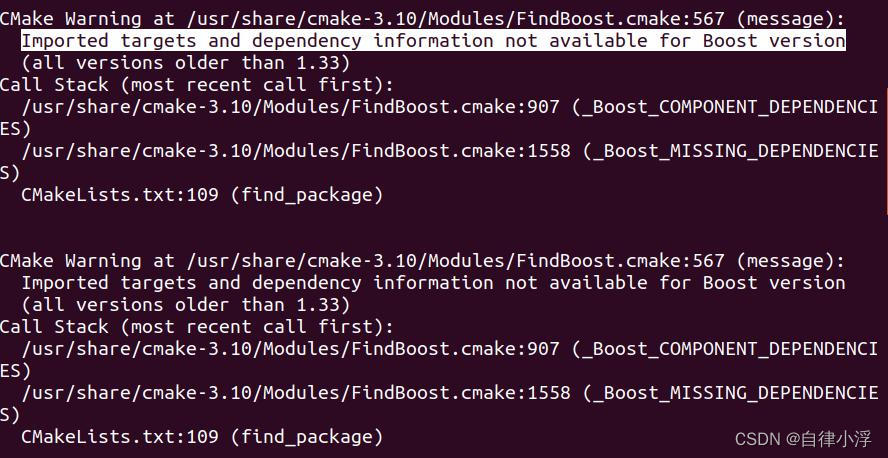

运行RESLAM的TUM数据集问题

①先在官网下载TUM数据集fr1/xyz,解压; ②运行association.py脚本,生成association.txt; ③编译RESLAM,出现问题 发现是boost版本的问题,于是便重新安装boost1.6x版本。 再次编译,发现缺少Cere库。于是再下载安装Cere库,再次编译,成功。 ④输入运行指令,发现数据集路径没有更新,将数据集路径更新后,成功运行。

TUM数据集内容和名称特点

连接:https://cvg.cit.tum.de/data/datasets/rgbd-dataset/download#freiburg3_nostructure_notexture_far ‘freiburg3_nostructure_texture_near_withloop’ 华硕Xtion已经移动在一个圆一米高的纹理,平面表面。它由几张会议海报组成,纹理具有很强的区别性。轨迹的起点

T265录制的rosbag拆包:拆IMU序列和图像序列方法以及如何制作双目euroc、双目tum数据集

目录 1.录制bag包 2.左右目图像的拆解 3.拆IMU数据 4.如何制作eruoc与tum数据集 4.1 eruoc数据集格式 4.2 对齐时间戳 4.3 编写imu.csv文件 4.4 生成索引文件 4.一个脚本完成拆包 1.录制bag包 这里推荐我的同学的博客,大家可以参考这篇博客录制T265的ros包并解决一些问题: 使用 RealSe

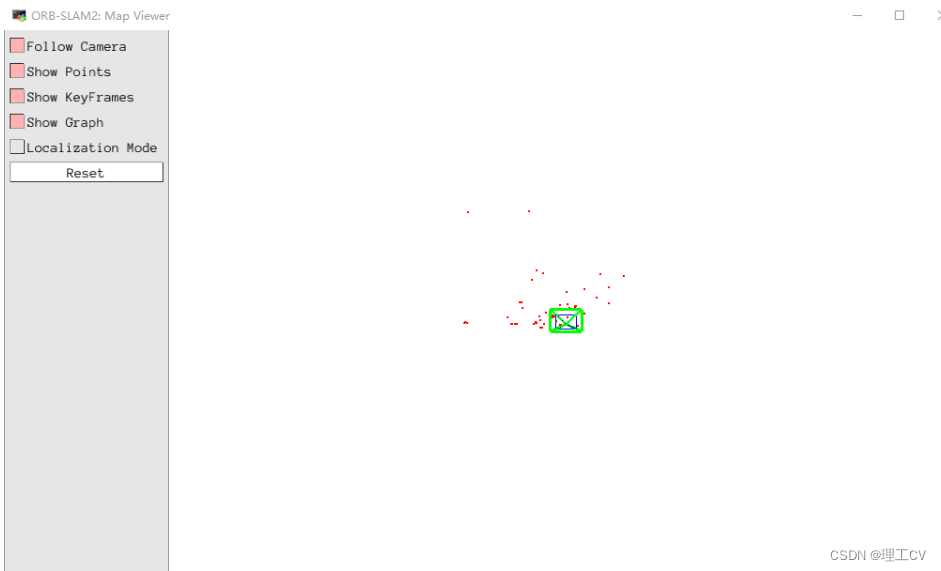

Ubuntu18.04 ORB-SLAM2运行TUM数据集

首先默认已配置ROS与ORB-SLAM2环境 1、ORB-SLAM2的安装位置为:/home/csim/catkin_ws/src/ORB_SLAM2 2、TUM数据集的所在位置为: /home/csim/ren/data/TUM/rgbd_dataset_freiburg1_xyz 3、运行TUM数据集分为:单目示例运行、双目示例运行与深度示例运行,其中深度示例运行需要使用python脚

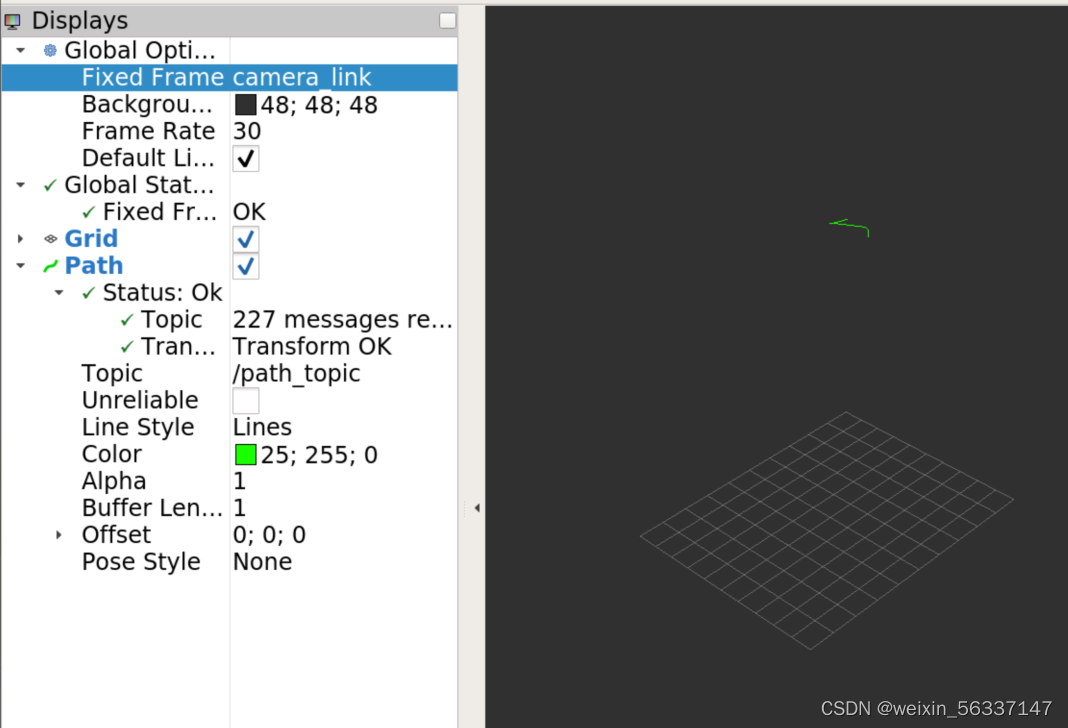

使用ROS读取tum格式轨迹文件并在RVIZ显示的实现过程

内容 有一个轨迹文本文件,使用ROS系统读取该文件,并将轨迹在RVIZ界面绘制。 先用EVO工具将tum格式轨迹文件转为bag格式; 再创建ROS功能包,订阅bag文件中的话题数据,处理再发布新的轨迹话题,同时新建线程发布TF。 最后编译、运行,多个终端发布开启roscore、启动功能包、打开rviz、播放bag。 实现过程 tum转bag 使用EVO工具将tum

TUM数据集转为ElasticFusion的数据集格式.klg

一、TUM数据集转为klg格式并运行ElasticFusion 1、下载TUM数据集 下载地址:https://cvg.cit.tum.de/data/datasets/rgbd-dataset/download TUM数据集一共用了三个机器人,记成fr1, fr2, fr3。这三台相机的参数在这里: http://vision.in.tum.de/data/datasets/rgbd-data

evo同时对比多个tum数据集

1.用法 1)将evoCapsulation.sh置于RGBD数据集所在的文件夹 2)运行以下命令 ./evoEncapsulation.sh fr2_desk_ORB.txt fr2_desk_ORB_kf_mono.txt fr2groundtruth.txt 2 shell文件 #!/bin/bash#判断输入参数的个数if [ $# -eq 0 ];then echo "

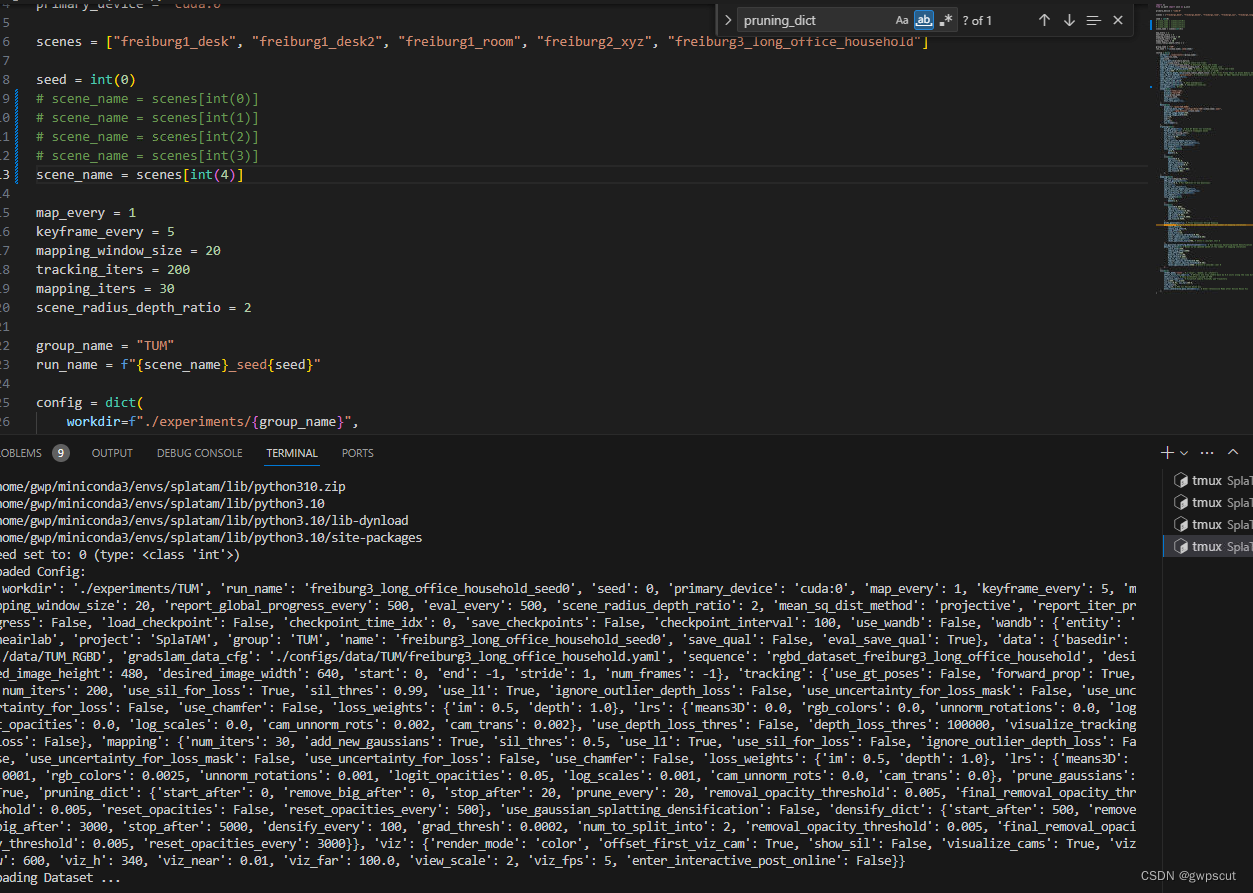

实验笔记之——基于TUM-RGBD数据集的SplaTAM测试

之前博客对SplaTAM进行了配置,并对其源码进行解读。 学习笔记之——3D Gaussian SLAM,SplaTAM配置(Linux)与源码解读-CSDN博客SplaTAM全称是《SplaTAM: Splat, Track & Map 3D Gaussians for Dense RGB-D SLAM》,是第一个(也是目前唯一一个)开源的用3D Gaussian Splatting(3DGS

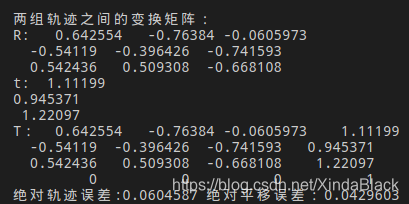

TUM数据集groundtruth轨迹与估计轨迹统一参考系

TUM数据集groundtruth轨迹与估计轨迹(ORBSLAM2运行的结果)统一参考系 参考:https://blog.csdn.net/luo870604851/article/details/85006243 阅读ORBSLAM的相关论文并且在UBuntu系统上编译好ORB-SLAM2后,准备运行下程序,获得估计的轨迹后,评估下轨迹的误差。这里运行的是rgbd_dataset_freibu

ubuntu18.04+realsenseD455制作TUM数据集

教程目录 一、本机环境二、安装RealSense SDK三、录制rosbag四、制作数据集四、安装ROS-RealSense五、测试数据集 一、本机环境 Ubuntu系统ROS系统RealSense18.04melodicD455 二、安装RealSense SDK 1、首先注册服务器的公钥 sudo apt-key adv --keyserver keyserver.u

把点云(point cloud)视作位姿的平移部分, 导出 Tum 格式的位姿

需求:对一个 [N,3] 的 point cloud txt 补充 时间戳跟 单位阵 四元数。输出 Tum 格式的 位姿 txt。方便对 原始 point cloud 使用 EVO 轨迹评测工具,在 相似变换的 尺度上计算两个 点云的整体距离。 import osimport numpy as npdef transform_and_write_txt(input_file, output_f

[安装配置] TX2上利用Kinect v1录制'TUM'数据集

环境设置 安装驱动 $ sudo apt-get install ros-indigo-freenect-*$ rospack profile 设置环境变量 echo $TURTLEBOT_3D_SENSOR#Output: kinect 如果你看到一个3D传感器,例如asus_xtion_pro,您将需要设置环境变量的默认值,修改和重新启动终端: echo "export

DS-SLAM最后运行launch时:[TUM-2] process has died [pid 15448, exit code -11, cmd ....

请问运行DS-SLAM,最后执行roslaunch DS_SLAM_TUM.launch会出现这个错误是什么原因,卡了好几天了~

ORB-SLAM2 技术详解(3)-- 源码编译及TUM RGB-D数据集测试

目录 0. 摘要 1. ORB-SLAM2 简介 2. 安装依赖库 (1)安装Pangolin (2)安装必要的依赖库 (3)安装OpenCV (4)安装Eigen (5)安装BLAS and LAPACK库 (1) BLAS: Basic Linear Algebra Subprograms (2) LAPACK:Linear Algebra PACKage 3. 编译O

TUM evaluate_ate.py评测工具

绝对轨迹误差脚本直接测量真实轨迹和估计轨迹的点之间的差异。 作为预处理步骤,我们使用时间戳将估计的姿势与地面真实姿势相关联。 基于此关联,我们使用奇异值分解来对齐真实轨迹和估计轨迹。 最后,我们计算每对姿势之间的差异,并输出这些差异的均值/中值/标准差。 此外,脚本还可以将两个轨迹绘制到png或pdf文件,这样一来可以更加直观的看到差异。 接下来,我们分别看一下相应的脚本执行命令 (注:

TUM VIO数据集介绍与尝试 The TUM VI Benchmark for Evaluating Visual-Inertial Odometry论文翻译

前言 做SLAM或是CV方向的应该大都接触过TUM提供的各种数据集,如RGBD数据集、单目数据集等。最近TUM发布了关于VIO即视觉惯性状态估计的对应数据集,成为了继飞行数据集EuRoc、MAV、车辆数据集Kitti等之后的又一个常用大型数据集。 本博客将就其数据集的论文《The TUM VI Benchmark for Evaluating Visual-Inertial Odometry》对

![DS-SLAM最后运行launch时:[TUM-2] process has died [pid 15448, exit code -11, cmd ....](https://img-blog.csdnimg.cn/20200807220944712.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NDQ3NzQ0Mg==,size_16,color_FFFFFF,t_70)