本文主要是介绍Ubuntu18.04 ORB-SLAM2运行TUM数据集,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

首先默认已配置ROS与ORB-SLAM2环境

1、ORB-SLAM2的安装位置为:/home/csim/catkin_ws/src/ORB_SLAM2

2、TUM数据集的所在位置为:

/home/csim/ren/data/TUM/rgbd_dataset_freiburg1_xyz

3、运行TUM数据集分为:单目示例运行、双目示例运行与深度示例运行,其中深度示例运行需要使用python脚本associate.py关联RGB图像和深度图像。

关联颜色和深度图像:Kinect以非同步的方式提供彩色图像和深度图像。这意味着来自彩色图像的时间戳集不会与深度图像的时间戳集相交。因此,我们需要一种将彩色图像与深度图像相关联的方法。

单目示例运行TUM数据集的rgbd_dataset_freiburg1_xyz:

(1)在ORB-SLAM2所在位置:

/home/csim/catkin_ws/src/ORB_SLAM2(2)运行命令:

./Examples/Monocular/mono_tum Vocabulary/ORBvoc.txt Examples/Monocular/TUM1.yaml /home/csim/ren/data/TUM/rgbd_dataset_freiburg1_xyz上述命令中TUM1.yaml对应的是freiburg1数据集,则TUM2.yaml与TUM3.yaml分别对应的是freiburg2数据集与freiburg3数据集。

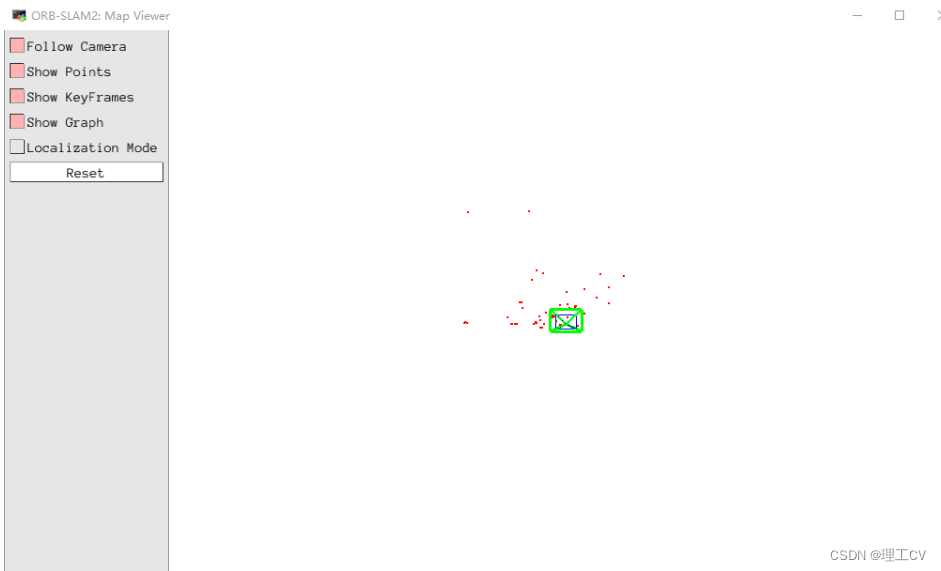

深度示例运行TUM数据集的rgbd_dataset_freiburg1_xyz:

(1)下载TUM数据集提供的associate.py 为文件,将其下载到

/home/csim/ren/data/TUM下载地址为:https://cvg.cit.tum.de/data/datasets/rgbd-dataset/tools

(2)在associate.py 文件所在位置执行命令:

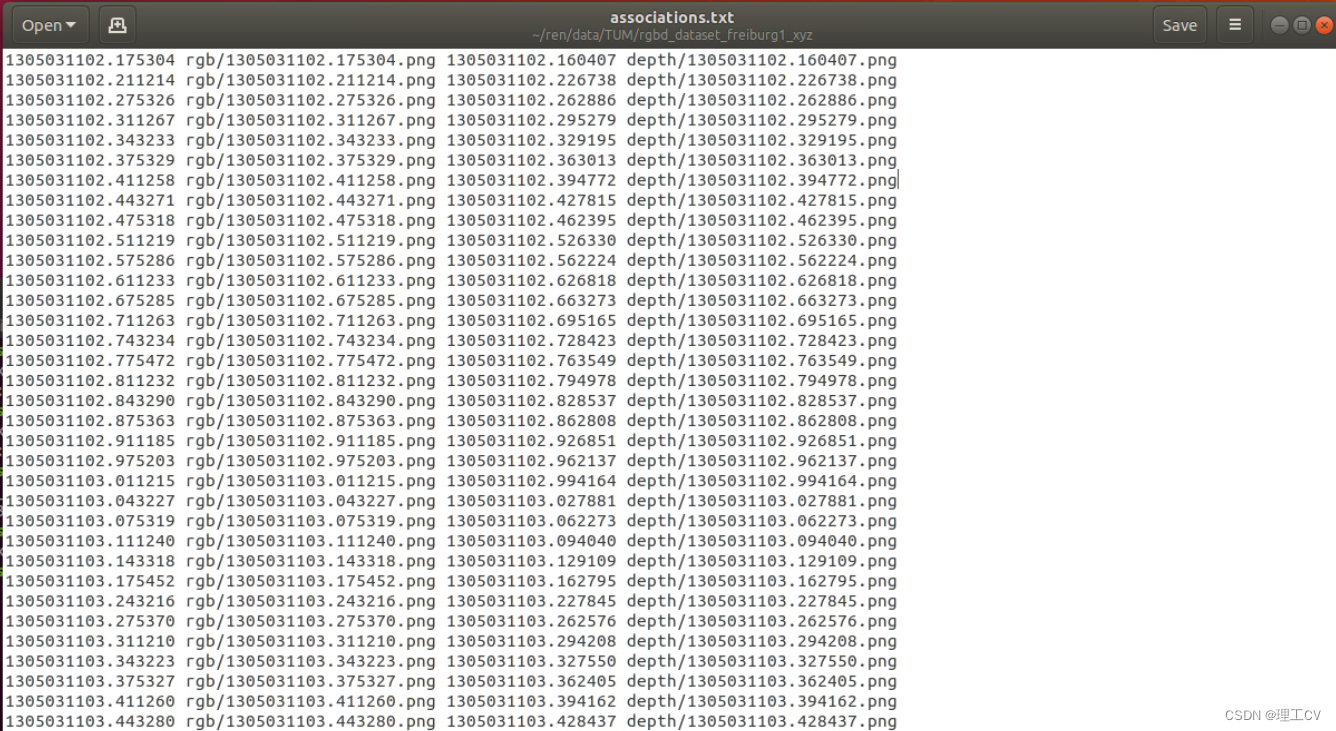

python associate.py rgbd_dataset_freiburg1_xyz/rgb.txt rgbd_dataset_freiburg1_xyz/depth.txt > rgbd_dataset_freiburg1_xyz/associations.txt运行上述命令后,会在rgbd_dataset_freiburg1_xyz数据集的文件夹中看到associations.txt文件

(3)在ORB-SLAM2所在位置:

/home/csim/catkin_ws/src/ORB_SLAM2(4)运行命令:

./Examples/RGB-D/rgbd_tum Vocabulary/ORBvoc.txt Examples/RGB-D/TUM1.yaml /home/csim/ren/data/TUM/rgbd_dataset_freiburg1_xyz /home/csim/ren/data/TUM/rgbd_dataset_freiburg1_xyz/associations.txt双目实例运行TUM数据集的rgbd_dataset_freiburg1_xyz:

(1)需要开启三个终端,每个终端要先运行:

export ROS_PACKAGE_PATH=/home/csim/catkin_ws/src/ORB_SLAM2/Examples/ROS:${ROS_PACKAGE_PATH}(2)三个终端都需要在

/home/csim/catkin_ws/src/ORB_SLAM2下运行命令。

第一个终端:

roscore第二个终端:

rosrun ORB_SLAM2 Stereo Vocabulary/ORBvoc.txt Examples/Stereo/EuRoC.yaml true第三个终端:

rosbag play --pause /home/csim/ren/data/TUM/MH_01_easy.bag /cam0/image_raw:=/camera/left/image_raw /cam1/image_raw:=/camera/right/image_raw但是我这里双目实例运行TUM数据集的rgbd_dataset_freiburg1_xyz,并没有出现一下结果。

这篇关于Ubuntu18.04 ORB-SLAM2运行TUM数据集的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!