大幅专题

生信软件34 - 大幅提升Python程序执行效率的工具Pypy

在生信开发过程中,会大量使用Python脚本,除了多进程和多线程编程提高程序运行效率外,还可以借助效率更高的Python解释器来提高程序的运行速度, CPython 使用c语言实现的解释器, PyPy 使用python语言的子集RPython实现的解释器,一般情况下PyPy比CPython快4倍左右。 1. 比较解释器的运行效率 # task.pyimport timedef compute

Hinton等人最新研究:大幅提升模型准确率,标签平滑技术 2019-7-8

导读:损失函数对神经网络的训练有显著影响,也有很多学者人一直在探讨并寻找可以和损失函数一样使模型效果更好的函数。后来,Szegedy 等学者提出了标签平滑方法,该方法通过计算数据集中 hard target 的加权平均以及平均分布来计算交叉熵,有效提升了模型的准确率。近日,Hinton 团队等人在新研究论文《When Does Label Smoothing Help?》中,就尝试对标签平滑技术对

环信高质量全球网络——70%丢包环境,消息100%送达,抗弱网能力大幅提升!

在当今数字化时代,稳定而高效的即时通讯已成为企业和个人不可或缺的工具。环信即时通讯(IM)云服务一直致力于为用户提供优质的通信体验。如今,环信IM通过自研传输协议,实现了在弱网环境下的卓越表现,确保消息在高丢包率情况下仍能100%可靠传输。 自研协议的优势 环信IM自研的传输层协议专为优化弱网环境下的通信而设计,与传统的TCP和UDP协议相比,具有以下显著优势: 快速连接建立:自研协议通过

聚观早报 | 理想汽车OTA 6.2发布;京东大幅上调校招薪资

聚观早报每日整理最值得关注的行业重点事件,帮助大家及时了解最新行业动态,每日读报,就读聚观365资讯简报。 整理丨Cutie 9月3日消息 理想汽车OTA 6.2发布 京东大幅上调校招薪资 哪吒汽车8月销量持续破万 C919国产大飞机首航在即 现代汽车正调整电动汽车战略 理想汽车OTA 6.2发布 近日,理想汽车正式发布OTA 6.2升级推送,AD Pro车型新增基于

三维一代人工智能 Meshy-4 发布!质量大幅提升,新增工作流程和重试功能等。

从埃及的金字塔到文艺复兴时期精致的雕塑,再到今天高耸入云的摩天大楼,结构艺术塑造了人类几千年的创造力。 然而,在虚拟世界中建造这样的建筑却面临着独特的挑战。 像圣彼得大教堂这样的标志性建筑需要一个多世纪的时间才能完成,而如今开发一款游戏仅用五年时间就已算漫长。 人们对游戏的期望同样很高:虚拟世界中的旅行者要求游戏环境既要有令人惊叹的视觉效果,又要有引人入胜的故事情节。 虚拟世界建设中的这些挑

豆包模型能力大幅提升,中国版Vision Pro正式发布!今年大模型市场份额第一还会是百度吗?|AI日报

文章推荐 上线一天销售额超15亿!《黑神话:悟空》火爆全网的技术秘诀! 昆仑万维推出全球首款AI短剧平台SkyReels!中国首个接入大模型Linux开源操作系统正式发布!|AI日报 今日热点 IDC首次发布大模型平台及应用市场份额报告,百度、商汤、智谱排名前三 国际数据公司(IDC)于8月21日首次发布了《中国大模型平台市场份额,2023:大模型元年 —— 初局》。 数据显示,202

GPT-5大幅推迟?OpenAI CTO称将在2025年底到2026年初推出

GPT-5大幅推迟?OpenAI CTO称将在2025年底到2026年初推出 OpenAI CTO同时透露,GPT-5性能将有巨大飞跃,在某些特定任务中达到“博士水平”智能,此前市场曾预测GPT-5可能在2023年底或2024年夏季发布。 一再跳票的GPT-5可能大幅推迟,但预计性能将显著跃升,达到“博士水平”的智能。 据媒体周日报道,OpenAI首席技术官Mira Murati近日透露,公

黄仁勋最新对话:未来互联网流量将大幅减少,计算将更多即时生成

黄仁勋表示,未来随着设备上运行的小语言模型变得更加上下文化和生成化,互联网流量将大幅减少,计算将更多地即时生成,这将极大地节省能源,使计算模型发生根本性转变。 要点 1、黄仁勋强调生成式AI正以指数速度增长,企业需要迅速适应并利用这一技术,而不是观望,以免落后于技术发展的步伐。 2、黄仁勋认为开源和闭源AI模型将共存,企业需要利用各自的优势,推动AI技术的发展和应用。 3、黄仁勋提出,A

利安科技上市首日股价大涨:2023营收净利润下滑,募资金额大幅缩水

《港湾商业观察》施子夫 6月7日,宁波利安科技股份有限公司(以下简称,利安科技)正式在深交所创业板挂牌上市,股票简称为利安科技,股票代码300784。 上市当天,利安科技股价大涨348.76%。 2022年5月,利安科技递表深市创业板IPO获受理,保荐机构为海通证券。在经过监管下发的两轮审核问询函后,2022年12月30日,在2022年第89次上市委员会审议会议中,利安科技的首发上会

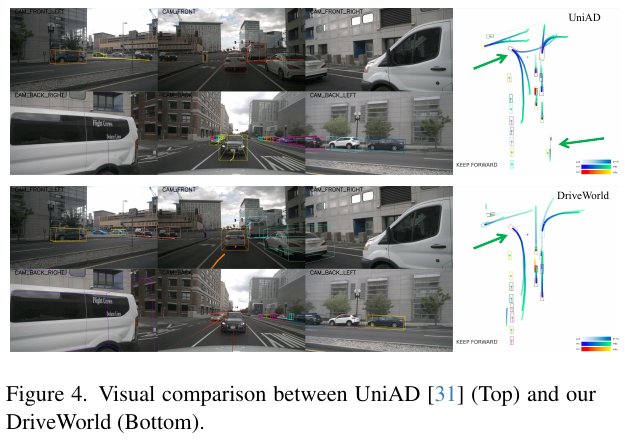

DriveWorld:一个预训练模型大幅提升检测+地图+跟踪+运动预测+Occ多个任务性能

1. 写在前面 以视觉为中心的自动驾驶技术近期因其较低的成本而引起了广泛关注,而预训练对于提取通用表示至关重要。然而,当前的以视觉为中心的预训练通常依赖于2D或3D预训练任务,忽视了自动驾驶作为4D场景理解任务的时序特征。这里通过引入一个基于世界模型的自动驾驶4D表示学习框架“DriveWorld”来解决这一挑战,该框架能够从多摄像头驾驶视频中以时空方式进行预训练。具体来说,提出了一个用于时空建

户曝iPhone 5S指纹识别灵敏度大幅下降

自从苹果在今年9月发布iPhone 5S和iPhone 5C两款新机以来,外界对于这两款产品的热情就从未褪去。而在我们熟悉的国内市场,“土豪金”版iPhone 5S仍然时有供不应求的情况发生。但是,日前就有国外媒体报道称,iPhone 5S中搭载的最新Touch ID指纹识别技术在仅仅问世3个月后就出现了问题。 据悉,iPhone 5S中搭载的指纹识别技术是苹果此前以3.56亿美元的价格收

超越传统AI 新型多智能体系统MESA,探索效率大幅提升

探索多智能体强化学习的协同元探索 —— MESA 算法深度解读在多智能体强化学习(MARL)的征途中,如何高效探索以发现最优策略一直是研究者们面临的挑战。特别是在稀疏奖励的环境中,这一问题变得更加棘手。《MESA: Cooperative Meta-Exploration in Multi-Agent Learning through Exploiting State-Action S

量化交巨变文艺复兴大幅削减趋势追踪交策略

转 量化交易巨变!文艺复兴大幅削减趋势追踪交易策略 来源:华尔街见闻 作者:祁月 摘要:英国金融时报称,去年接近年底时,文艺复兴科技在其RIDA基金中减少使用趋势追踪策略,幅度多达2/3。这种策略在08年曾带来两位数的高收益,但近年来却无法适应市场和环境的快速发展。 多年以来,趋势追踪策略是对冲基金经理们采用的一种经典交易策略。然而时过境迁,这种策略近些年人气渐失,当全世界最具影响力的量

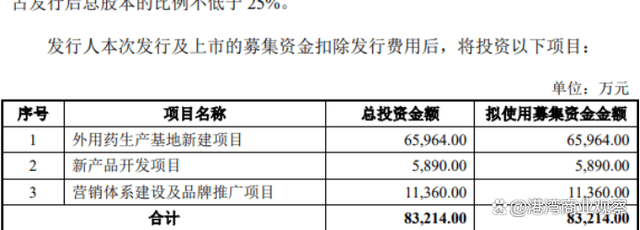

巨额分红与大幅下调募资金额,小方制药注册生效半年后仍无进展

《港湾商业观察》施子夫 2022年7月1日,上海小方制药股份有限公司(以下简称,小方制药)递表上交所板,2023年9月1日公司提交了注册申请,并于同年12月19日获得生效。 离挂牌上市仅有一步之遥的小方制药注册生效半年后何以未有动作,在当前IPO严格监管的环境下,这不禁更令外界担忧。 在上市道路上已经行走了近两年,小方制药前景如何? 连年巨额分红引关注 小方制药主营业务为外用药

机器之心 | 清华接手,YOLOv10问世:性能大幅提升,登上GitHub热榜

本文来源公众号“机器之心”,仅用于学术分享,侵权删,干货满满。 原文链接:清华接手,YOLOv10问世:性能大幅提升,登上GitHub热榜 相同性能情况下,延迟减少 46%,参数减少 25%。 目标检测系统的标杆 YOLO 系列,再次获得了重磅升级。 自今年 2 月 YOLOv9 发布之后, YOLO(You Only Look Once)系列的接力棒传到了清华大学研究人员的手上

近五年营收和净利润大幅“败北”,尚品宅配今年押注扩张加盟

《港湾商业观察》廖紫雯 两个月前经历过高管公开信的尚品宅配(300616.SZ),无论是2023年年报,还是今年一季报,虽然公司净利润表现尚佳,但收入端的持续承压仍然备受关注。 今年一季报,尚品宅配实现营业收入7.76亿元,同比减少3.98%;归属于上市公司股东的净亏损8652.45万元,同比收窄9.22%;归属于上市公司股东的扣除非经常性损益的净亏损9476.05万元,同比收窄9.

厦门国际银行业绩大幅下滑:不良贷款猛增,董事长王晓健曾被罚

撰稿|行星 来源|贝多财经 随着改制的完成,摇身一变成为中资商业银行的厦门国际银行依托“以内地为主体、以港澳为两翼”的战略布局优势,在不断适应行业发展趋势中稳步前行。 迈上万亿资产规模层级后,厦门国际银行本应继续夯实质量底座、优化业务结构、积蓄发展动能,但其近年来的表现却如同被按下了“暂停键”。在2023年的重要财务指标中,该行仅有资产规模继续上升,经营质量与效益均出现了回退。 不仅

12月中国区块链经理人指数(BMI)59.9: 环比出现大幅下跌 企业融资不理想

2021年1月5日,由工业和信息化部电子第五研究所指导,中央财经大学财经研究院共识经济学课题组联合探针金融科技研究院制作的中国区块链经理人指数调研(Blockchain Manager Index,BMI)12月份数据为59.9,相较11月的72.3出现大幅下跌。共识分歧指数(CDI)为2.1,相较于11月的21.3明显缩小,说明经历了行业扩张之后,预期有所收敛。本期除用户数和业务活动预期外,其

Llama3-chinese: 大幅改进Llama3 中文能力

中文 | English 介绍 Llama3-Chinese是以Meta-Llama-3-8B为底座,使用 DORA + LORA+ 的训练方法,在50w高质量中文多轮SFT数据 + 10w英文多轮SFT数据 + 2000单轮自我认知数据训练而来的大模型。 Github:https://github.com/seanzhang-zhichen/llama3-chinese

Higress 全新 Wasm 运行时,性能大幅提升

本文作者: 澄潭,阿里云 API 网关软件工程师,Higress 开源项目主要贡献者 何良,Intel Web Platform Engineering 软件工程师,WAMR 开源项目主要贡献者 本文介绍 Higress 将 Wasm 插件的运行时从 V8 切换到 WebAssembly Micro Runtime (WAMR) 的最新进展。通过切换到 WAMR 并开启 AOT 模式大幅提升

ubuntu使用gnome boxes,安装Hyper-V使虚拟机流程度大幅提升

参考文章:https://blog.csdn.net/loveric/article/details/134064884

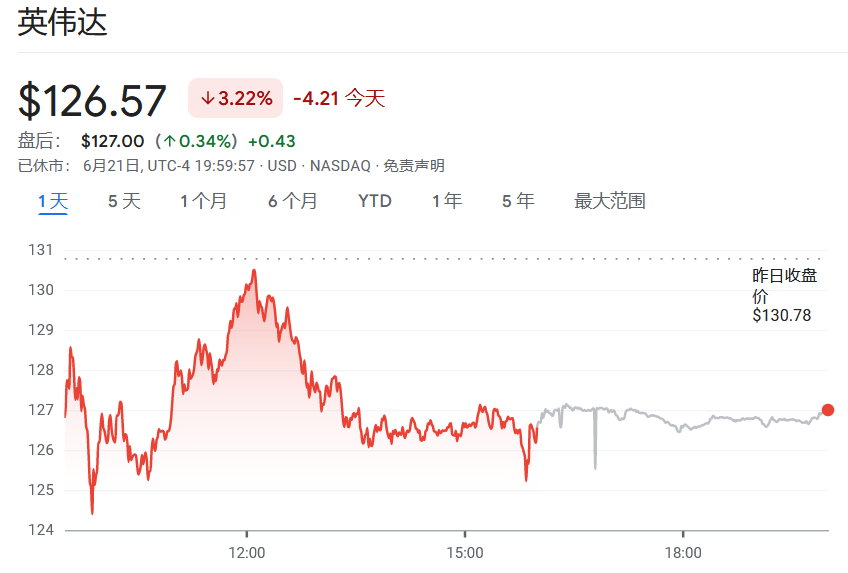

淘宝开放微信支付,用户体验大幅提升 /英伟达聘请百度Apollo技术负责人罗琦加入汽车事业部 | 魔法半周报

我有魔法✨为你劈开信息大海❗ 高效获取AIGC的热门事件🔥,更新AIGC的最新动态,生成相应的魔法简报,节省阅读时间👻 🔥资讯预览 淘宝开放微信支付,用户体验大幅提升 英伟达聘请百度Apollo技术负责人罗琦加入汽车事业部,将推动智驾业务发展 微软发布最新AI访问原则,扩大云计算基础设施建设,支持全球开发人员 手机厂商竞相投入AI技术研发,打造智能助手,提升用户体验 Mi

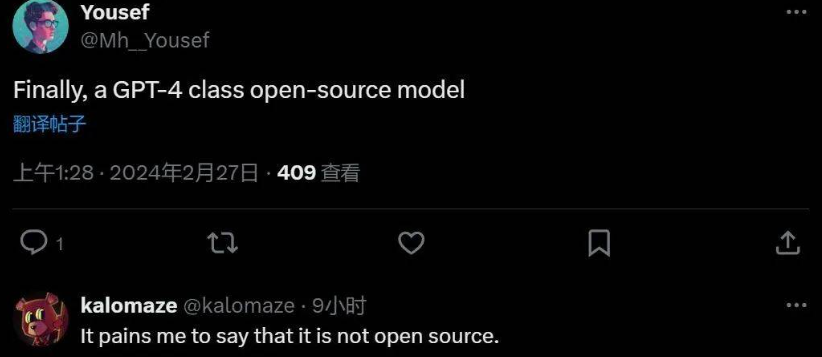

马斯克旗下xAI发布Grok-1.5,相比较开源的Grok-1,各项性能大幅提升,接近GPT-4!

本文原文来自DataLearnerAI官方网站:马斯克旗下xAI发布Grok-1.5,相比较开源的Grok-1,各项性能大幅提升,接近GPT-4! | 数据学习者官方网站(Datalearner) 继Grok-1开源之后,xAI宣布了Grok-1.5的内测消息,并预告即将全面商用,这一消息无疑为AI技术爱好者和开发者社区带来了新的兴奋点。 Grok-1.5的技术突破 Grok-1.5在性能上

【Bugout产品更新】版本管理功能上线,流程管理大幅优化

Bugout 是什么? Bugout 是一款完全免费的缺陷管理系统,可以收集来自各个渠道和设备的 bug 问题,通过自定义自动化规则并与企业的开发工具集成,帮助企业高效的收集、跟进、解决 bug 问题。 更多详情访问 bugout.testin.cn 本次版本更新时间:2019.03.20 本周重要更新一览 【Bugout缺陷管理】问题流程管理优化【Bugout缺陷管理】自动化流程增

程序莫名卡顿、运行速度大幅降低的一种可能因素

前言 有一次调试一个程序,在并没有改动什么代码的情况下,突然间程序性能大幅下降,降低了足足75%左右!!一番研究之后,发现.. 原因 从Win7开始,微软加入了一项名叫“容错堆”的功能(英文名称:Fault Tolerant Heap,简写为FTH)。 根据微软的说法,容错堆 (FTH) 是一个子系统,负责监视应用程序崩溃并自主应用缓解措施,以防止系统将来发生崩溃。。 这个缓解措施非常的

UE4大幅提升编译速度的技巧

其中流传最广的一个就是“空格法”。 这个方法可以在某些情况下下把编译时间加快三倍左右,比较恐怖了。 我们讲一下操作过程: 1.首先在Unreal Engine的安装文件夹下找到Win64这个文件,每个人的安装位置不太一样这是我的安装文件路径:E:\UE\UE_4.20\Engine\Binaries\Win64 在下面找到Win64这个文件。 2.在Win64这个文件中找到一个UnrealHead