rcnn专题

[训练测试过程记录]Faster-RCNN用于场景文字检测

写在前面:github上面的Text-Detection-with-FRCN项目是基于py-faster-rcnn项目在场景文字识别领域的扩展。 和py-faster-rcnn相比,该项目的主要改动为:将检测类别换成了背景和文字,并且更改了数据集。 对于初学者而言,要实现一个自己的baseline,第一步可以尝试训练别人已经实现了的网络,看看整个的运行流程是怎么样的。那么,接下来,我就记录一

[目标检测]Faster RCNN算法详解

转载来自:http://blog.csdn.net/shenxiaolu1984/article/details/51152614 本文是继RCNN,fast RCNN之后,目标检测界的领军人物Ross Girshick团队在2015年的又一力作。简单网络目标检测速度达到17fps,在PASCAL VOC上准确率为59.9%;复杂网络达到5fps,准确率78.8%。 作者在github上

[目标检测]Fast RCNN算法详解

转载来自:http://blog.csdn.net/shenxiaolu1984/article/details/51036677 继2014年的RCNN之后,Ross Girshick在15年推出Fast RCNN,构思精巧,流程更为紧凑,大幅提升了目标检测的速度。在Github上提供了源码。 同样使用最大规模的网络,Fast RCNN和RCNN相比,训练时间从84小时减少为9.5小时

[目标检测]RCNN算法详解

转载来自:http://blog.csdn.net/shenxiaolu1984/article/details/51066975 Region CNN(RCNN)可以说是利用深度学习进行目标检测的开山之作。作者Ross Girshick多次在PASCAL VOC的目标检测竞赛中折桂,2010年更带领团队获得终身成就奖,如今供职于Facebook旗下的FAIR。 这篇文章思路简洁,在DP

py-faster-rcnn 环境配置

1、下载py-faster-rcnn git clone --recursive https://github.com/rbgirshick/py-faster-rcnn.git 2、进入py-faster-rcnn/lib,执行make cd ~/py-faster-rcnn/libmake 3、进入py-faster-rcnn\caffe-fast-rcnn,修改Makefile

faster RCNN/YOLO/SSD算法的比较

只要是做过物体检测(object detection)的人,都会对这三种算法比较熟悉,起码听说过。那么这三种算法各自有什么特点呢?为什么他们不能相互取代?接下来我们将慢慢分析。 RCNN系列 SSD YOLO系列 faster RCNN 这个算法是一个系列,是RBG大神最初从RCNN发展而来,RCNN->fast RCNN->faster RCNN,那么简单的介绍下前两种算法。 首先R

windows+tensorflow2+python3环境配置mask-rcnn(COCO数据集)详解

windows+tensorflow2+python3环境配置COCO数据集详解 Github下载源码下载GIthub源码与数据解压文件放置到对应目录设置运行参数 调试代码1. 'tensorflow' has no attribute 'random_shuffle'2. no attribute 'metrics_tensors'3. no 'load_weights_from_hdf5

windows+tensorflow2+python3环境配置faster-rcnn详解

windows+tensorflow2+python3环境配置faster-rcnn详解 Github下载代码下载Git源码与数据解压相应数据至对应目录 调试代码'tensorflow' has no attribute 'app'No module 'tensorflow.contrib''tensorflow_core.compat.v1' has no attribute 'contr

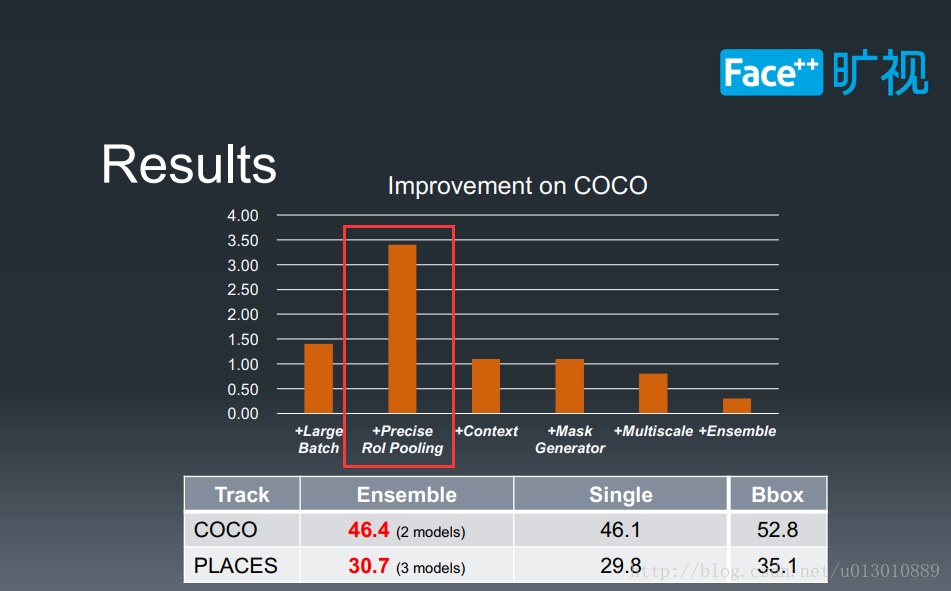

mask rcnn解读

上一篇中介绍faster rcnn,这次mask 基本在上次的基础上加了点代码,参考和引用1. mask rcnn slides 2. kaiming he maskrcnn 3. Ardian Umam mask rcnn,欢迎fork简版mask rcnn 整体框架 RoIAlign 问题 做segment是pixel级别的,但是faster rcnn中roi pooling

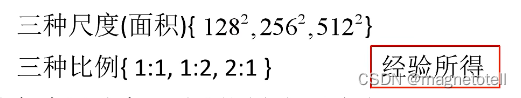

faster rcnn源码解析

之前一直是使用faster rcnn对其中的代码并不是很了解,这次刚好复现mask rcnn就仔细阅读了faster rcnn,主要参考代码是pytorch-faster-rcnn ,部分参考和借用了以下博客的图片 [1] CNN目标检测(一):Faster RCNN详解 姊妹篇mask rcnn解析 整体框架 首先图片进行放缩到W*H,然后送入vgg16(去掉了pool5),得

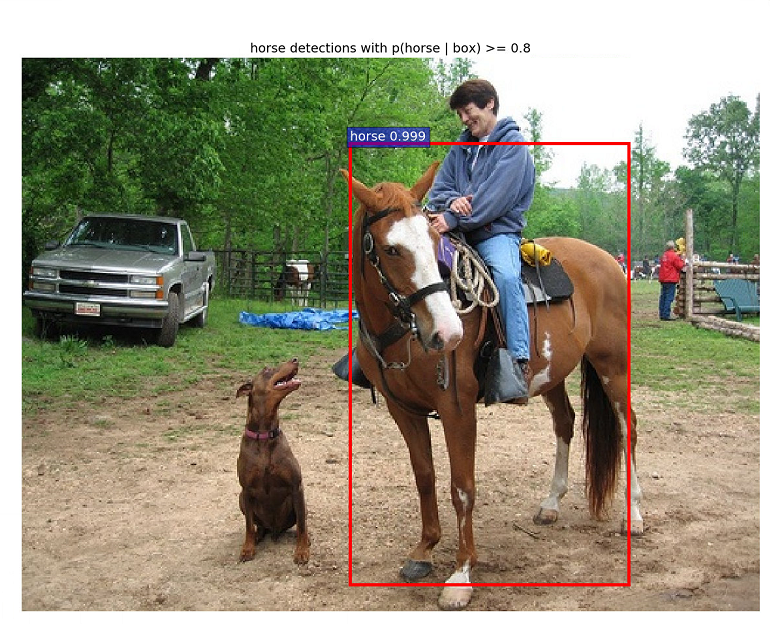

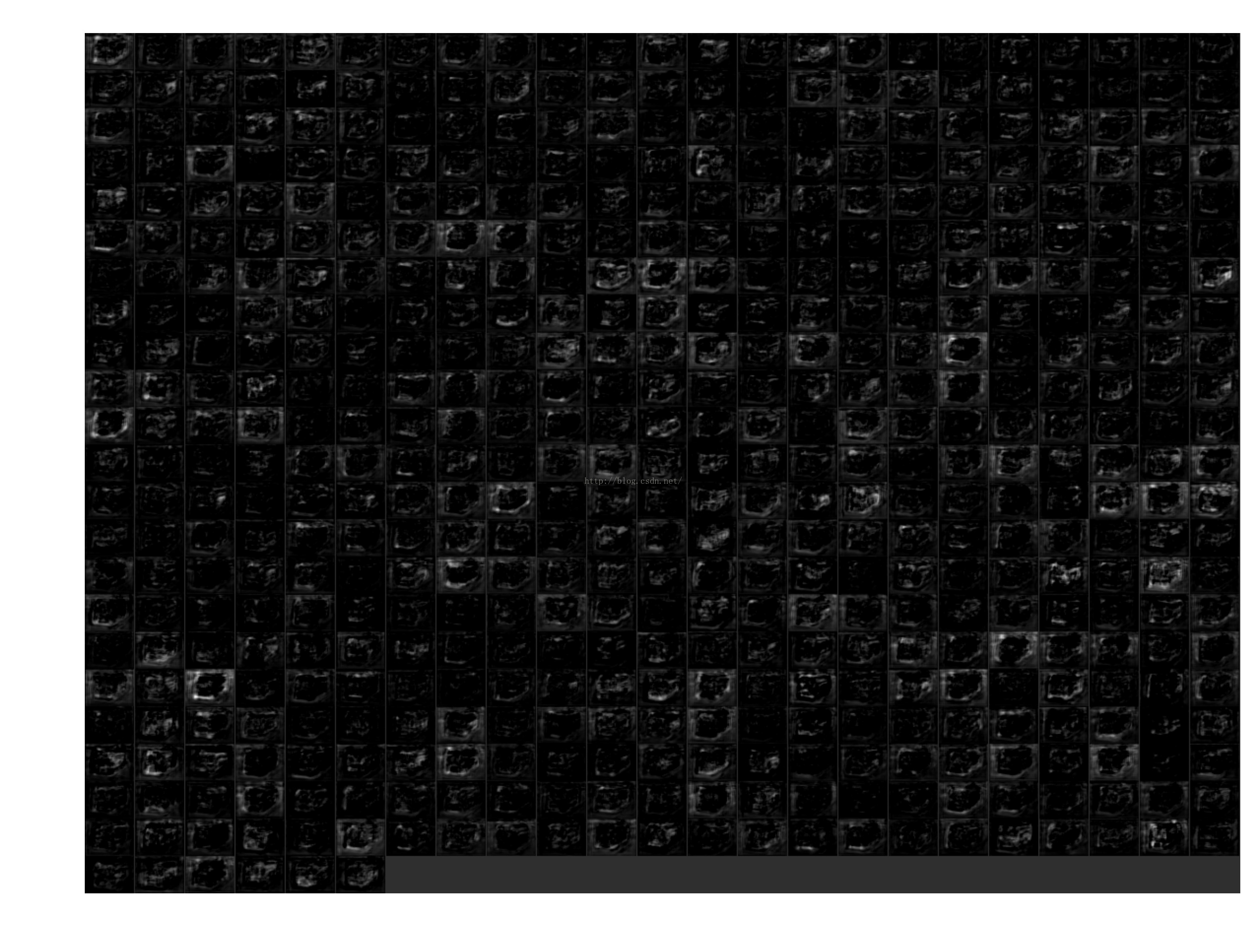

CAFFE- faster rcnn修改demo.py保存网络中间结果

faster rcnn用python版本 https://github.com/rbgirshick/py-faster-rcnn 以demo.py中默认网络VGG16. 原本demo.py地址https://github.com/rbgirshick/py-faster-rcnn/blob/master/tools/demo.py 图有点多,贴一个图的本分结果出来: 上图是原图,下面

fast rcnn中遇到的问题

碰到了out of memory的情况,可能有两方面原因: 1、别人在用GPU; 2、model太大,跑不起来。 如果是第一个原因,可以告知别人在跑程序时指定GPU,因为不指定的话默认占用所有的GPU。 如果是第二个原因,可以换一个小一点的model。比如,fast rcnn中有vgg16,caffenet,vgg_cnn_m_1024,如果vgg16遇到out of memory的情况,

fast rcnn 训练自己的数据集(训练和检测)

转载请注明出处,楼燚(yì)航的blog,http://www.cnblogs.com/louyihang-loves-baiyan/ http://github.com/YihangLou/fast-rcnn-train-another-dataset 这是楼主 在github上修改的几个文件的链接 在之前两篇文章中我介绍了怎么编译Fast RCNN,和怎么修改Fast

fast rcnn训练自己的数据集(修改读写接口)

转载请注明出处,楼燚(yì)航的blog,http://www.cnblogs.com/louyihang-loves-baiyan/ https://github.com/YihangLou/fast-rcnn-train-another-dataset 这是楼主在github上修改的几个文件的链接 这里楼主讲解了如何修改Fast RCNN训练自己的数据集,首先请确保你已经安装

fast rcnn 训练自己的数据集(编译环境配置)

FastRCNN 训练自己数据集 (1编译配置) 转载请注明出处,楼燚(yì)航的blog,http://www.cnblogs.com/louyihang-loves-baiyan/ http://github.com/YihangLou/fast-rcnn-train-another-dataset 这是楼主在github上修改的几个文件的链接 FastRCNN是Ross Gir

一文教你跑通Faster-Rcnn

第一步因为跑这个代码必须使用GPU进行加速,准备用CPU来跑的话,可以放弃了,安装cuda和cudnn,再安装NVIDIA的显卡驱动(版本一定要对),这方面网上教程非常之多,也有不少坑,仔仔细细一步一步的来是不会有多大问题的,安装完一定要进行一个测试,是否安装成功。 测试显卡驱动:$:nvidia-smi,出现GPU的使用情况,则代表成功 测试cuda:$:nvcc -V,出现Cuda的版

Faster RCNN安装问题

对于Faster RCNN安装网上给出了很多的方法,这里只是记录自己遇到的几个比较奇怪的问题,当时在安装的时候由于这几个问题花费了大量时间,在这里记录下来,以期能够帮助遇到同样问题的网友。 第一个问题 /util/cudnn.hpp:127:41: error: too few arguments to function ‘cudnnStatus_t cudnnSetPooling2dDesc

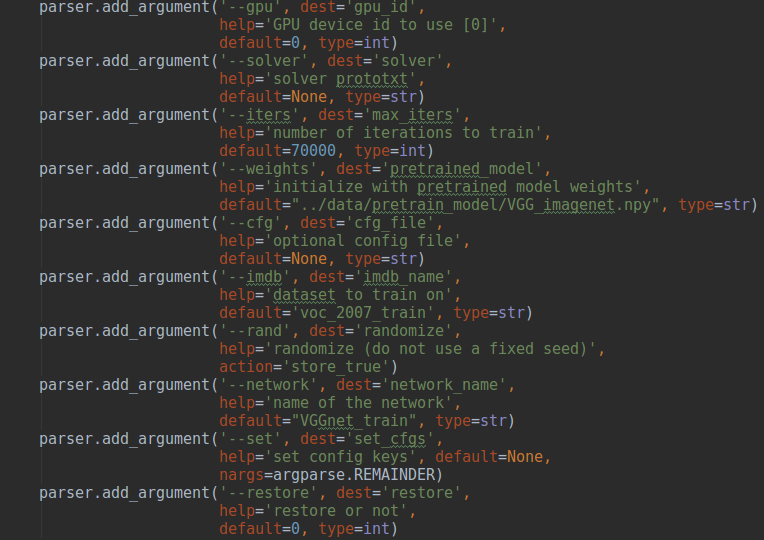

Faster RCNN代码理解(Python)

最近开始学习深度学习,看了下Faster RCNN的代码,在学习的过程中也查阅了很多其他人写的博客,得到了很大的帮助,所以也打算把自己一些粗浅的理解记录下来,一是记录下自己的菜鸟学习之路,方便自己过后查阅,二来可以回馈网络。目前编程能力有限,且是第一次写博客,中间可能会有一些错误。 目录 目录 第一步准备第二步Stage 1 RPN init from ImageNet model

使用faster-rcnn训练自己的模型

参考 faster-rcnn 源码链接 论文链接 一个不错的参考 faster rcnn简介 各文件目录介绍 caffe-fast-rcnn —> caffe框架 data —> 存放数据,以及读取文件的cache experiments —>存放配置文件以及运行的log文件,配置文件 lib —> python接口 models —> 三种模型, ZF(

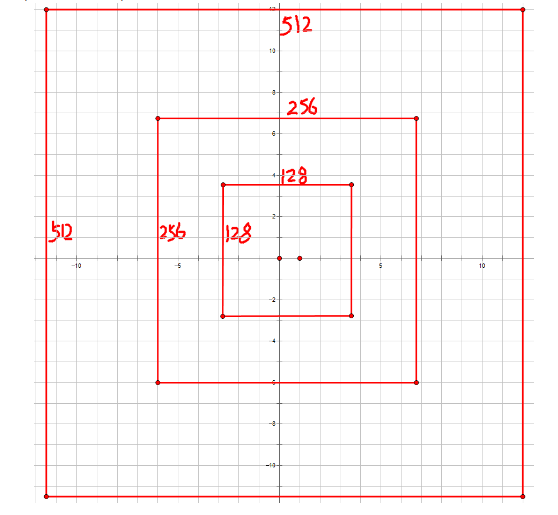

Faster-RCNN基本思想和网络结构

简单来说,Faster RCNN = RPN + Fast RCNN RPN 是指 Region Proposal Network,建议区域生成网络。 Faster RCNN 中用 RPN 来代替了 Fast RCNN 中的SS算法。 算法流程: (1)将图像输入CNN网络得到相应的特征图。 (2)使用RPN网络生成候选框,将RPN生成的候选框投影到特征图上获得ROI区域的特征矩阵。

Faster-RCNN/SSD/训练将数据集做成VOC2007格式

reference: http://blog.csdn.net/sinat_30071459/article/details/50723212 0.文件夹名 首先,确定你的数据集所放的文件夹名字,例如我的叫logos。 (或者和voc2007一样的名字:VOC2007) 1.图片命名 虽然说图片名对训练没什么影响,但建议还是按VOC2007那样,如“000005.jpg”这

faster RCNN(keras版本)代码讲解(1)-概述

faster RCNN(keras版本)代码讲解博客索引: 1.faster RCNN(keras版本)代码讲解(1)-概述 2.faster RCNN(keras版本)代码讲解(2)-数据准备 3.faster RCNN(keras版本)代码讲解(3)-训练流程详情 4.faster RCNN(keras版本)代码讲解(4)-共享卷积层详情 5.faster RCNN(keras版本)

利用Fast RCNN训练自己的数据做无人机检测(一)

学习计算机视觉,深度学习快一年了,第一次写博客,想记录自己学习的过程,深度学习作目标检测的模型已经有很多,包括RCNN, Fast RCNN, YOLO, SSD等,本次实验室利用Fast RCNN做目标检测,数据集是采集的大疆四旋翼无人机,后面会继续对其他模型进行训练,先给出实验检测的效果。 一. Fast RCNN模型特点 去除了R-CNN中冗余的特征提取,将整张图像输入神经网络进

RCNN系列(注意事项及简单步骤)

原文地址:https://blog.csdn.net/poorfriend/article/details/51604385 训练过程: step 1: 对于每张图片,利用选择性搜索(SS,Selective Search)找出2K个候选区域。对每个候选区域改变其尺度和长宽比,使其与卷积神经网络要求的图片输入的规格保持一致。 step 2: 利用Alexnet或VGGne

基于R-CNN的物体检测(对RCNN的详细解读)

原文地址:http://blog.csdn.net/hjimce/article/details/50187029 一、相关理论 本篇博文主要讲解2014年CVPR上的经典paper:《Rich feature hierarchies for Accurate Object Detection and Segmentation》,这篇文章的算法思想又被称之为:R-CNN(Region

![[训练测试过程记录]Faster-RCNN用于场景文字检测](https://img-blog.csdn.net/20171114195553586?watermark/2/text/aHR0cDovL2Jsb2cuY3Nkbi5uZXQvdTAxMzI1MDQxNg==/font/5a6L5L2T/fontsize/400/fill/I0JBQkFCMA==/dissolve/70/gravity/Center)

![[目标检测]Faster RCNN算法详解](https://img-blog.csdn.net/20160415151012671)

![[目标检测]Fast RCNN算法详解](https://img-blog.csdn.net/20160414104600312)

![[目标检测]RCNN算法详解](https://img-blog.csdn.net/20160405214721512)