networks专题

A Comprehensive Survey on Graph Neural Networks笔记

一、摘要-Abstract 1、传统的深度学习模型主要处理欧几里得数据(如图像、文本),而图神经网络的出现和发展是为了有效处理和学习非欧几里得域(即图结构数据)的信息。 2、将GNN划分为四类:recurrent GNNs(RecGNN), convolutional GNNs,(GCN), graph autoencoders(GAE), and spatial–temporal GNNs(S

Complex Networks Package for MatLab

http://www.levmuchnik.net/Content/Networks/ComplexNetworksPackage.html 翻译: 复杂网络的MATLAB工具包提供了一个高效、可扩展的框架,用于在MATLAB上的网络研究。 可以帮助描述经验网络的成千上万的节点,生成人工网络,运行鲁棒性实验,测试网络在不同的攻击下的可靠性,模拟任意复杂的传染病的传

Convolutional Neural Networks for Sentence Classification论文解读

基本信息 作者Yoon Kimdoi发表时间2014期刊EMNLP网址https://doi.org/10.48550/arXiv.1408.5882 研究背景 1. What’s known 既往研究已证实 CV领域著名的CNN。 2. What’s new 创新点 将CNN应用于NLP,打破了传统NLP任务主要依赖循环神经网络(RNN)及其变体的局面。 用预训练的词向量(如word2v

【机器学习】生成对抗网络(Generative Adversarial Networks, GANs)详解

🌈个人主页: 鑫宝Code 🔥热门专栏: 闲话杂谈| 炫酷HTML | JavaScript基础 💫个人格言: "如无必要,勿增实体" 文章目录 生成对抗网络(Generative Adversarial Networks, GANs)详解GANs的基本原理GANs的训练过程GANs的发展历程GANs在实际任务中的应用小结 生成对

Image Transformation can make Neural Networks more robust against Adversarial Examples

Image Transformation can make Neural Networks more robust against Adversarial Examples 创新点 1.旋转解决误分类 总结 可以说简单粗暴有效

吴恩达深度学习笔记:卷积神经网络(Foundations of Convolutional Neural Networks)1.9-1.10

目录 第四门课 卷积神经网络(Convolutional Neural Networks)第一周 卷积神经网络(Foundations of Convolutional Neural Networks)1.9 池化层(Pooling layers)1.10 卷 积 神 经 网 络 示 例 ( Convolutional neural network example) 第四门课

NLP-文本匹配-2016:SiamseNet【Learning text similarity with siamese recurrent networks】

NLP-文本匹配-2016:SiamseNet【Learning text similarity with siamese recurrent networks】

GNN-频域-2014:Spectral Networks and Locally Connected Networks on Graphs(频谱图卷积神经网络)【第一篇从频域角度分析】

《原始论文:Spectral Networks and Locally Connected Networks on Graphs》 空域卷积非常直观地借鉴了图像里的卷积操作,但缺乏一定的理论基础。 而频域卷积则不同,相比于空域卷积而言,它主要利用的是**图傅里叶变换(Graph Fourier Transform)**实现卷积。 简单来讲,它利用图的**拉普拉斯矩阵(Laplacian ma

YOLO前篇---Real-Time Grasp Detection Using Convolutional Neural Networks

论文地址:https://arxiv.org/abs/1412.3128 1. 摘要 比目前最好的方法提高了14%的精度,在GPU上能达到13FPS 2. 基于神经网络的抓取检测 A 结构 使用AlexNet网络架构,5个卷积层+3个全连接层,卷积层有正则化和最大池化层网络结构示意图如下 B 直接回归抓取 最后一个全连接层输出6个神经元,前4个与位置和高度相关,另外2个用来表示方向

Self-Attention Generative Adversarial Networks解读+部分代码

Self-Attention Generative Adversarial Networks解读+部分代码 引言 这篇是文章是Ian goodfellow他们的新工作,在GAN中引入Attention。 在文章的摘要中作者主要突出了三点。 Self-Attention Generative Adversarial Network(SAGAN)是一个注意力驱动,长范围 关联模型(a

AST: Asymmetric Student-Teacher Networks for Industrial Anomaly Detection代码运行

环境 設置遠程路徑 conda create --name zgp_ast python=3.7.7 pip install -r requirements.txt PIL>=7.1.2改爲Pillow>=7.1.2 Building wheels for collected packages: efficientnet-pytorchBuilding wheel for efficient

Relation Networks for Object Detection

目录 1. Background 2. Object Relation Module 3. Duplicate removal 4. Experiment 5. Summary 参考 主要贡献点有两条: 1. 提出了一种relation module,可以在以往常见的物体特征中融合进物体之间的关联性信息,同时不改变特征的维数,能很好地嵌进目前各种检测框架,提高性能 2.

Layer-refined Graph Convolutional Networks for Recommendation【ICDE2023】

Layer-refined Graph Convolutional Networks for Recommendation 论文:https://arxiv.org/abs/2207.11088 源码:https://github.com/enoche/MMRec/blob/master/README.md 摘要 基于图卷积网络(GCN)的抽象推荐模型综合了用户-项目交互图的节点信息和拓

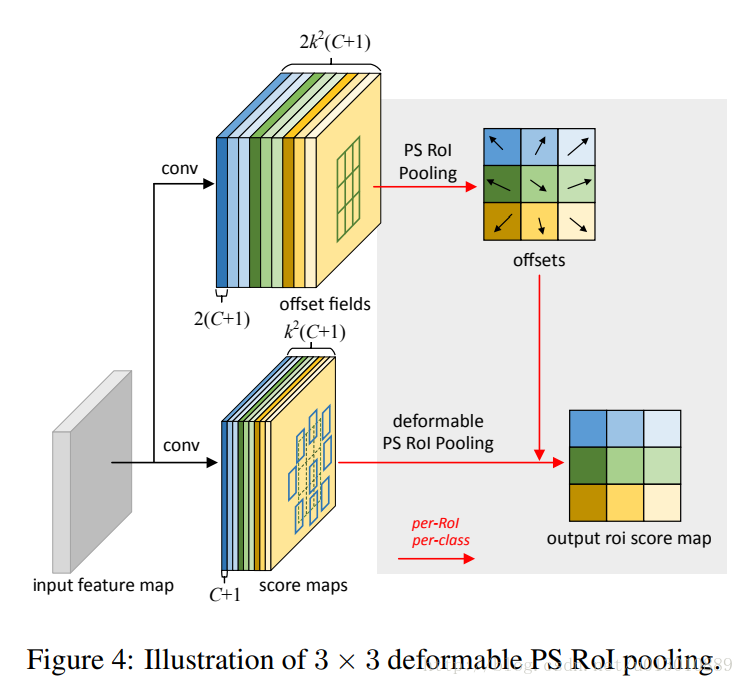

Deformable Convolutional Networks解读

这篇论文是daijifeng老师又一篇好文,一贯的好想法,而且实现的很漂亮,arxiv link Motivation 现实图片中的物体变化很多,之前只能通过数据增强来使网络“记住”这些变种如n object scale, pose, viewpoint, and part deformation,但是这种数据增强只能依赖一些先验知识比如反转后物体类别不变等,但是有些变化是未知而且手动设

Noise Conditional Score Networks 简单总结

Noise Conditional Score Networks Score S c o r e = ∇ x l o g p ( x ) (1) Score = \nabla_xlog~{p(x)} \tag{1} Score=∇xlog p(x)(1) Score 是论文中的一个定义,表示概率密度 p ( x ) p(x) p(x)的梯度,沿着概率密度的梯度向前走,会走到概率密度最高的

【论文阅读】Model Stealing Attacks Against Inductive Graph Neural Networks(2021)

摘要 Many real-world data(真实世界的数据) come in the form of graphs(以图片的形式). Graph neural networks (GNNs 图神经网络), a new family of machine learning (ML) models, have been proposed to fully leverage graph data(

姿态估计Rethinking on Multi-Stage Networks for Human Pose Estimation论文梗概及代码解读

2018年COCO关键点检测冠军算法MSPN,姿态估计,Top-down的技术路线 应该是截止2019年10月26日时开源的最好的姿态估计算法之一了 旷世出品 代码链接点这,是基于Pytorch的 论文链接点这 摘要 姿态估计方法以基本形成one-stage 和 multi-stage两个路线 多阶段看上去更适合任务,但是现在多阶段的性能还是不如单阶段的 我们论文就来研究这个问题,我们讨论当下

论文笔记 DenseCap: Fully Convolutional Localization Networks for Dense Captioning

李飞飞组的文章,是一篇很有意思的文章,主要介绍了一种CNN解决密集字幕任务的方法。密集字幕任务主要含两个方面: (1)单个单词描述的目标检测任务;(2)对整个图像的一个预测区域的字幕标注任务。具体任务需求如下: 文章主要提出了全卷积定位网络(FCLN)架构,无需外部区域的建议,并可以用单轮优化进行端对端的训练。该架构包含一个卷积网络,一个新的密集定位层,一个生成标签序列的递归神经网络的语言

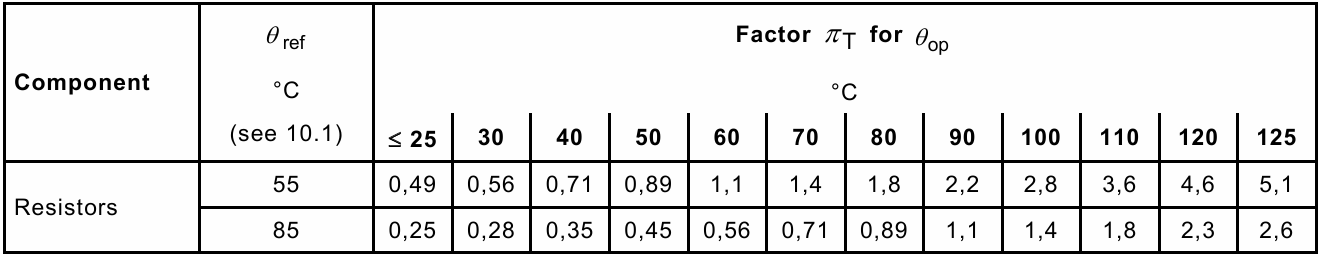

ISO 26262中的失效率计算:IEC 61709-Clause 10_Resistors and resistor networks

目录 概要 1 元器件分类和基准温度 2 失效率的计算 2.1 失效率预测模型 2.2 温度应力系数 2.2.1 温度应力系数计算模型 3.2.2 温度应力系数计算 结语 概要 IEC 61709是国际电工委员会(IEC)制定的一个标准,即“电子元器件 可靠性 失效率的基准条件和失效率转换的应力模型”。主要涉及电学元器件的可靠性,包括失效率的基准条件和失效率转换的应

论文翻译:Are aligned neural networks adversarially aligned?

Are aligned neural networks adversarially aligned? https://proceedings.neurips.cc/paper_files/paper/2023/hash/c1f0b856a35986348ab3414177266f75-Abstract-Conference.html 对齐的神经网络是否对抗性对齐? 文章目录 对齐的神经网

【专业英语 复习】第8章 Communications and Networks

1. 单选题 One of the most dramatic changes in connectivity and communications in the past few years has been ____. A. widespread use of mobile devices with wireless Internet connectivity B. chat ro

ResNeXt - Aggregated Residual Transformations for Deep Neural Networks

《Aggregated Residual Transformations for Deep Neural Networks》是Saining Xie等人于2016年公开在arXiv上: https://arxiv.org/pdf/1611.05431.pdf 创新点 1.在传统Resnet基础上采用group convolution,在不增加参数量的前提下,获得更强的representat

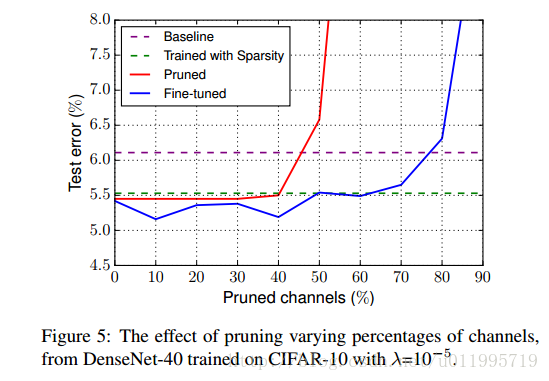

模型压缩:Networks Slimming-Learning Efficient Convolutional Networks through Network Slimming

Network Slimming-Learning Efficient Convolutional Networks through Network Slimming(Paper) 2017年ICCV的一篇paper,思路清晰,骨骼清奇~~ 创新点: 1. 利用batch normalization中的缩放因子γ 作为重要性因子,即γ越小,所对应的channel不太重要,就可以裁剪(prun

算法杂货铺——分类算法之贝叶斯网络(Bayesian networks)

2010-09-18 22:50 by T2噬菌体, 20383 阅读, 18 评论, 收藏 , 编辑 2.1、摘要 在上一篇文章中我们讨论了朴素贝叶斯分类。朴素贝叶斯分类有一个限制条件,就是特征属性必须有条件独立或基本独立(实际上在现实应用中几乎不可能做到完全独立)。当这个条件成立时,朴素贝叶斯分类法的准确率是最高的,但不幸的是,现实中各个特征属性间往往并不条件独立

Selective Kernel Networks(CVPR-2019)

摘要 提出了一种动态选择机制,允许每个神经元根据输入信息的多个尺度自适应调整感受野大小。设计了一种称为选择核(SK)单元的结构块,利用softmax attention 对不同核大小的多个分支进行融合。对这些分支的不同attention产生融合层神经元有效感受野的不同大小。多个SK单元被堆叠成一个称为选择性核的网络SKNets。 文章提出了一种非线性方法,从多个内核中聚合信息,实现神经元的自适应

Causal Effect Identification in Uncertain Causal Networks

我们采用以下六个分类标准为: 数据模态: 观察数据: 这类数据是在没有研究人员任何干预的情况下收集的。它通常很容易获得,但由于潜在的混杂变量而带来挑战。例如,在流行病学中,由于实验的伦理限制,观察性研究很常见。参考文献[6]讨论了观察性研究中因果效应的识别和估计。实验数据: 这是因果推理的黄金标准,因为它涉及随机对照试验(RCT),研究人员在其中操纵治疗变量。RCT旨在最大限度地减少偏差,为因