本文主要是介绍论文笔记 DenseCap: Fully Convolutional Localization Networks for Dense Captioning,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

李飞飞组的文章,是一篇很有意思的文章,主要介绍了一种CNN解决密集字幕任务的方法。密集字幕任务主要含两个方面:

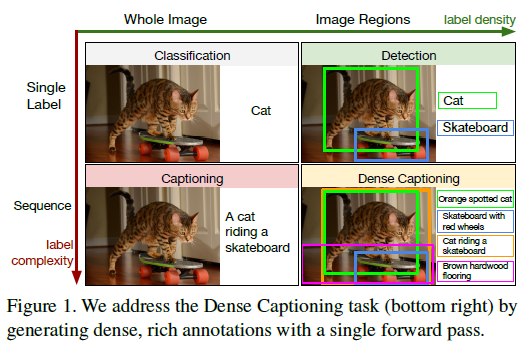

(1)单个单词描述的目标检测任务;(2)对整个图像的一个预测区域的字幕标注任务。具体任务需求如下:

文章主要提出了全卷积定位网络(FCLN)架构,无需外部区域的建议,并可以用单轮优化进行端对端的训练。该架构包含一个卷积网络,一个新的密集定位层,一个生成标签序列的递归神经网络的语言模型。

采用的数据集还是李飞飞组的,含94000图像和4,100,000个区域字幕。同时开源了代码:https://github.com/jcjohnson/densecap

模型结构:

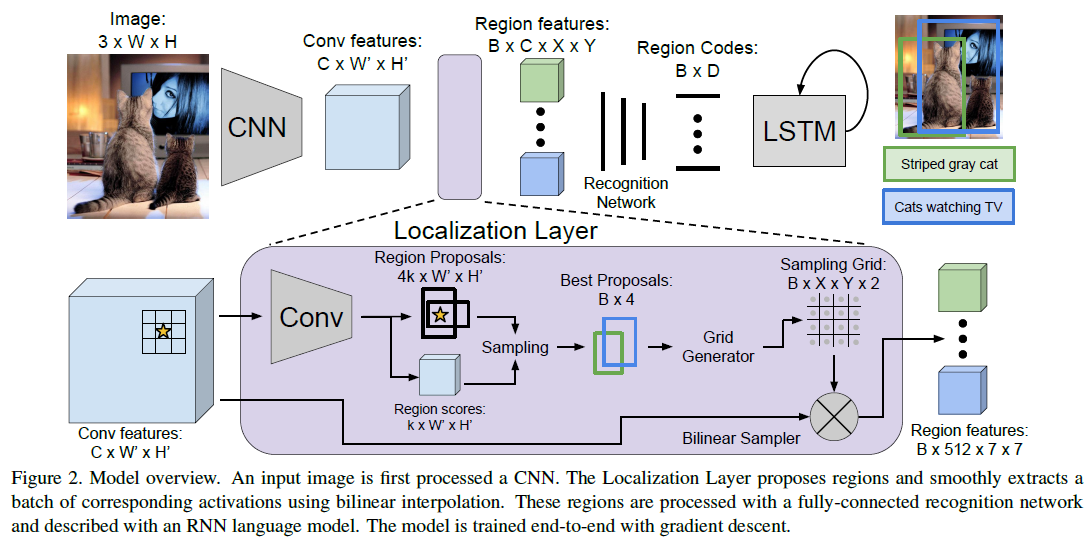

文章的目标是设计一种网络结构使得感兴趣区域定位和自然语言的描述相结合,做到端到端的训练使得单一步骤优化的支持。其网络结构示意图如下:

方法主要基于Faster R-CNN,将其RoI pooling部分改成了双线性插值。

实验结果:

由于文章的网络部分创新性没有很大,大部分都和Faster R-CNN一致,因此就不详细讲了,有意思的是这个思想与结果,个人非常喜欢这个结果哈哈,当一句句短语从图形中自己输出的时候,感觉自己对深度学习的热爱又一点点回来了呢!~

这篇关于论文笔记 DenseCap: Fully Convolutional Localization Networks for Dense Captioning的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!