本文主要是介绍交通流量预测HSTGCNT:Hierarchical Spatio–Temporal Graph Convolutional,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

Hierarchical Spatio–Temporal Graph Convolutional Networks and Transformer Network for Traffic Flow Forecasting

交通流预测的层次时空图卷积网络和Transformer网络

Abstract

图卷积网络(GCN)具有图形化描述道路网络不规则拓扑结构的能力,已被应用于交通流预测任务中。然而,基于GCN的交通流预测方法往往无法同时捕捉到交通流数据所承载的短期和长期时间关系,并且还存在过平滑问题。为了克服这些问题,我们提出了一个分层的交通流预测网络合并新设计的长期时间Transformer网络(LTT)和时空图卷积网络(STGC)。

具体而言,LTT旨在学习交通流数据之间的长期时间关系,而STGC模块旨在通过一维卷积和图卷积之间的级联分别捕获交通流数据之间的短期时间关系和空间关系。此外,提出了一种联合收割机的注意力融合机制,将长期和短期时间关系作为STGC中图卷积层的输入,以缓解GCN的过度平滑问题。

在三个公共交通流数据集上的实验结果证明了该方法的有效性和鲁棒性。

索引术语:图形卷积网络GCN,交通数据预测traffic data forecasting,Transformer。

主要贡献

提出了一种由时空图卷积网络(STGC)和长期时间变换网络(LTT)两个并行网络构建的分层交通流预测模型

- 长期时间变换网络通过变换对时间位置信息进行编码,提取交通流数据之间的长期时间关系;

- 时空图卷积网络捕捉交通流数据在不同时间粒度层次上的空间依赖关系,利用多个一维卷积核挖掘数据之间的短期时间关系;

- 长短时态信息融合模块设计了一种基于注意力的融合模块,根据上述长期和短期时态关系的重要性自适应地整合它们,并将融合后的表示传递给STGC,具有缓解GCN的过平滑问题的能力。

相关工作

在这一部分中,我们回顾了与传统交通流预测、基于图卷积网络的交通流预测和变压器网络相关的必要知识。

B.

时空GCN(STGCN)是第一个将GCN应用于交通数据预测任务的工作,它将时间CNN和空间GCN模块级联在一起来捕捉交通数据之间的时空关系。

GCN的交通流预测,扩散卷积递归神经网络(DCRNN)[12]在道路网络图上执行双向随机游动来捕捉空间关系,并使用门控递归单元来获得时间关系

C.

Transformer的交通量预测

Motivation

交通流数据具有复杂的时空关系。如何有效地捕捉和融合这两种关系是交通流预测任务的关键问题。因此,提出了一种用于交通流预测任务的新型分层深度神经网络模型,其动机如下。

-

为了学习隐藏的长期时间关系,我们使用Transformer网络[27]来构建长期时间Transformer网络(LTT)。

-

为了充分利用短期时间关系和空间关系,我们构建了时空图卷积网络(STGC),它也从交通流数据中学习短期关系,由一维时间卷积和GCN组成。

-

为了综合上述的长时、短时和空间关系,我们设计了基于注意力的融合模块,将LTT和STGC逐层连接起来,从而缓解了STGC的过度平滑问题。

整体网络架构

- 长期时间Transformer网络(LTT)从原始业务流数据捕获长期时间依赖性,即

- 每个时空图卷积模块(STGC)级联一维卷积神经网络

、图卷积网络

、图卷积网络 ,随后是另一个一维卷积神经网络

,随后是另一个一维卷积神经网络

,其同时捕获短期时间依赖性和空间依赖性;

,其同时捕获短期时间依赖性和空间依赖性; - 长短时间信息融合模块融合上述长期和短期时间依赖性,即

,然后我们将其逐层发送到STGC中的图卷积网络。

,然后我们将其逐层发送到STGC中的图卷积网络。

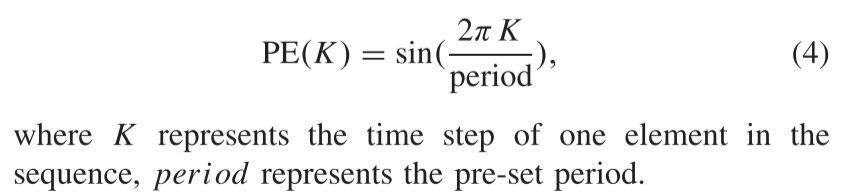

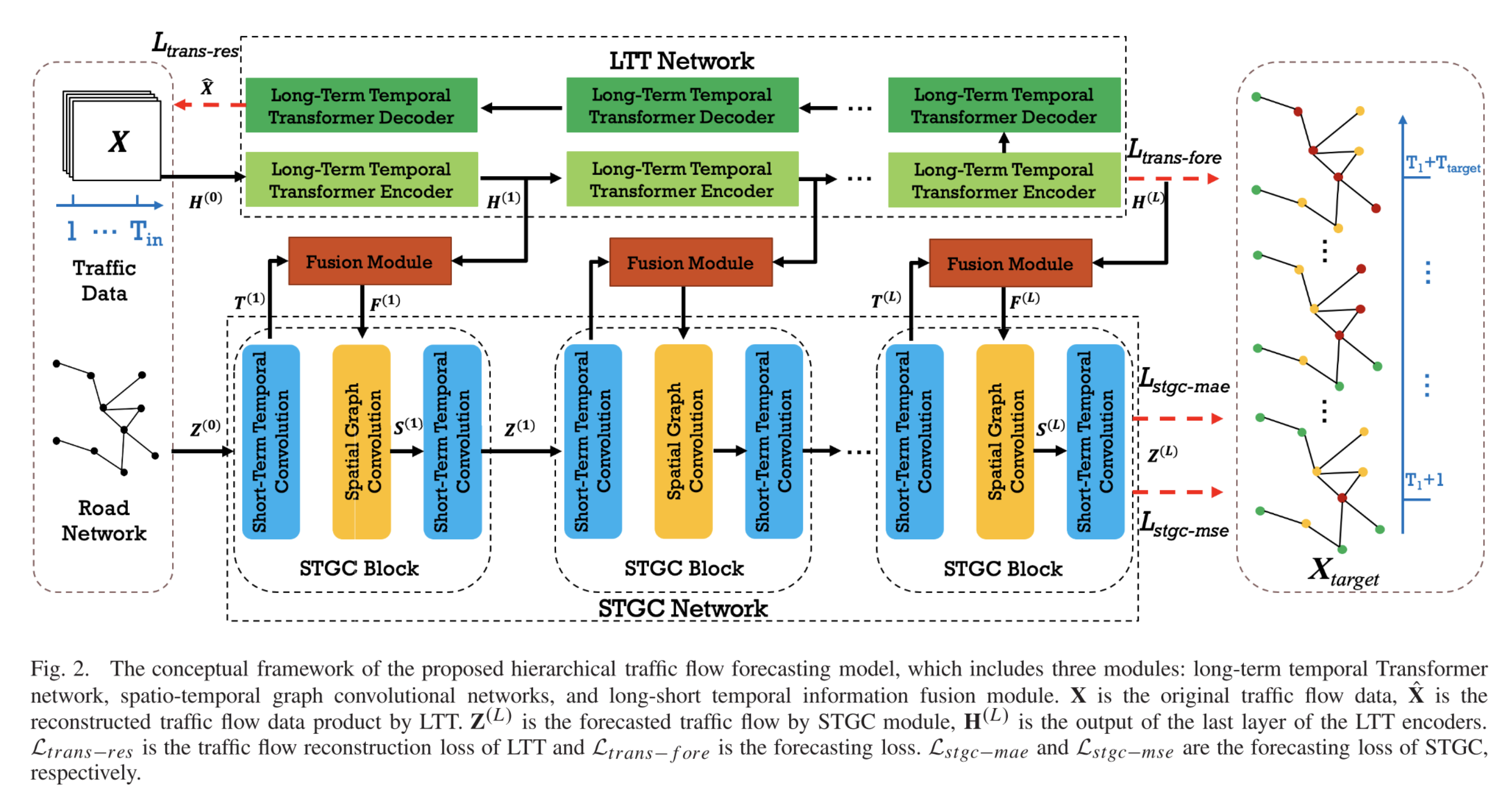

层次化交通流预测模型的概念框架

图2所示。提出了层次化交通流预测模型的概念框架,该模型包括三个模块:

- 长时transformer网络(LTT)

- 时空图卷积网络(STGC)

- 长短时信息融合模块(LSTIF)Fusion Module

X 为原始交通流数据, X ^ \hat{X} X^为LTT重构后的交通流数据乘积。Z(L) 为STGC模块预测的交通流量, H(L) 为LTT编码器最后一层的输出。Ltrans-res为LTT交通流重构损失,Ltrans-fore为预测损失。Lstgc-mae和Lstgc-mse分别为STGC的预测损失。

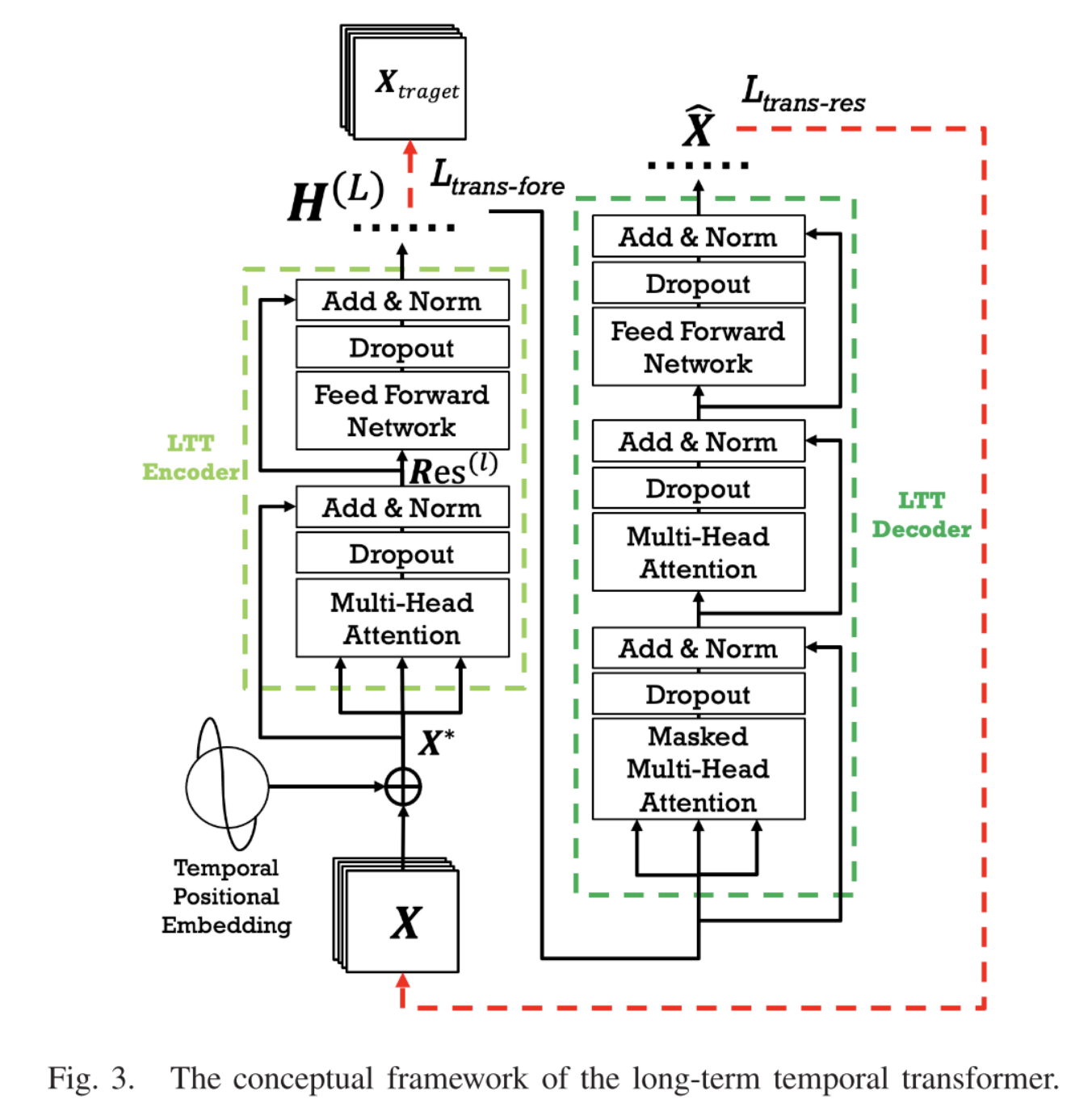

长期时间Transformer的概念框架

该网络对时间位置信息进行编码,从原始交通流数据中提取长期时间关系。

如图3所示,所设计的长期时间Transformer网络具有两个主要组件:时间位置嵌入和长期时间信息提取。

1)时间位置嵌入:由于交通流数据是典型的时间序列数据,分析数据之间的时间位置关系可以提高交通流预测的性能。例如,当我们预测某段道路7:30的交通流量时,7:00的交通流量数据比5:00的交通流量数据更重要。传统的注意力机制被用来捕捉数据之间的关系[37],而忽略了这种时间序列数据中的顺序信息。

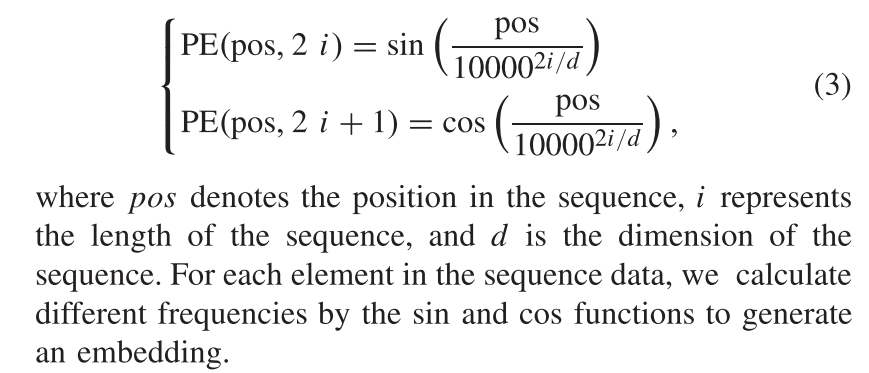

Transformer引入了sin、cos来完成周期性的操作

但是周期太大,需要设置一个合理的周期

2)长时间信息提取:30分钟以上的长时间交通预测仍然是当前智能交通领域的一个基础和难点问题。这种长期的时间依赖性给传统的基于CNN或RNN的时间处理模块带来了很大的困难。为了解决这个问题,我们提出了一个LTT网络,从整个交通流序列中提取长期的时间关系。

Each encoder is constructed by four main components:

multi-head attention, fully-connected feed-forward network, dropout [38] and layer normalisation [39].

只使用前几个时间步长的交通流量预测

编码器和解码器都是三个,结构类似

时空卷积网络(STGC)

时空卷积网络(STGC)由三个相同的块组成(如图2所示),每个块由短期时间卷积和空间图卷积构成。顾名思义,短时时间卷积旨在捕捉交通流数据的短时时间相关性,而空间图卷积则是捕捉相应的空间相关性

1)短期时间卷积:与递归神经网络相比,卷积神经网络可以并行训练,因此耗时更少。此外,CNN只关注感受野内的数据,捕捉数据的短期剧烈变化。因此,**我们沿着交通流数据的时间轴T1执行一维卷积以提取短期时间关系。**为了进一步防止消失梯度问题并确保充分的信息传输,我们使用门控线性单元来激活通过一维卷积提取的特征,

2)空间图卷积:交通流数据变化复杂,道路网络具有非欧结构,路段之间存在许多隐含的复杂关系。例如,两个路段在**道路网络中可能不直接连接,而它们具有许多相同的邻居。**这是一个自然的信念,这两个路段具有高阶结构关系。作为一种重要的深度学习方法,GCN可以挖掘道路网络中这种潜在的高阶关系。

长短时信息融合模块(LSTIF)

在不同的时期,长短时信息的重要性是不同的。比如早晚高峰时段,车流量大,当前交通拥堵对15分钟后的车流量影响明显。在这种情况下,短时交通流信息在交通流预测任务中起着至关重要的作用。在交通平坦期,交通量小,交通拥堵消散快,因此30分钟至1小时的长时间时间信息更有指导意义。LTT网络捕获交通流数据之间的长期时间关系,STGC网络学习短期时间关系和空间关系,但如何正确集成这些异构数据是一个关键问题。我们提出的长短时信息融合模块(LSTIF)学习一个更好的交通流表示逐层通过注意力融合机制。然后,融合表示发送到每个STGC层,以解决GCN的过平滑问题。LSTIF模块具有强大的全局学习能力和良好的并行性,进一步突出了融合表示中根据目标交通流周期的关键信息,抑制了无用噪声。

这篇关于交通流量预测HSTGCNT:Hierarchical Spatio–Temporal Graph Convolutional的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!