lasso专题

【机器学习 sklearn】模型正则化L1-Lasso,L2-Ridge

#coding:utf-8from __future__ import divisionimport sysreload(sys)sys.setdefaultencoding('utf-8')import timestart_time = time.time()import pandas as pd# 输入训练样本的特征以及目标值,分别存储在变量X_train与y_train之中。

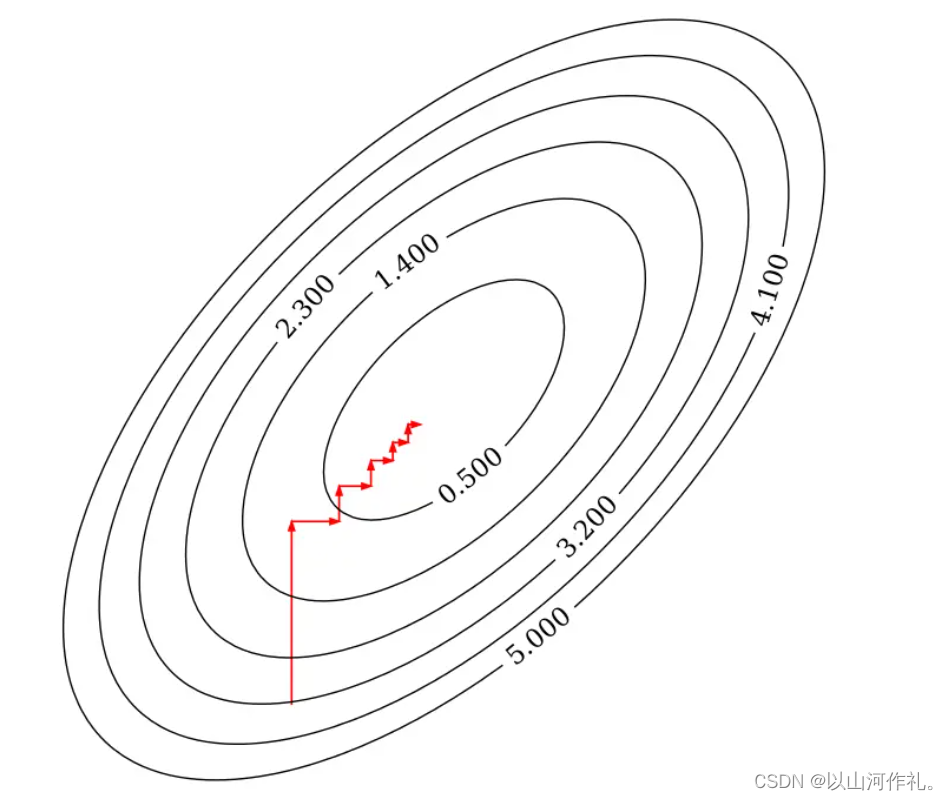

Lasso回归的坐标下降法推导

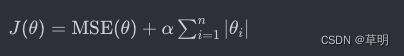

Lasso回归的坐标下降法推导 目标函数 Lasso相当于带有L1正则化项的线性回归。先看下目标函数: 这个问题由于正则化项在零点处不可求导,所以使用非梯度下降法进行求解,如坐标下降法或最小角回归法。 坐标下降法 本文介绍坐标下降法。 坐标下降算法每次选择一个维度进行参数更新,维度的选择可以是随机的或者是按顺序。 当一轮更新结束后

零基础入门转录组数据分析——预后模型之lasso模型

零基础入门转录组数据分析——预后模型之lasso模型 目录 零基础入门转录组数据分析——预后模型之lasso模型1. 预后模型和lasso模型基础知识2. lasso预后模型(Rstudio)——代码实操2. 1 数据处理2. 2 构建lasso预后模型2. 3 提取Lasso预后基因2. 4 计算风险评分 1. 预后模型和lasso模型基础知识 1.1 预后模型是

【机器学习】特征工程的基本概念以及LASSO回归和主成分分析优化方法

引言 特征工程是机器学习中的一个关键步骤,它涉及到从原始数据中提取和构造新的特征,以提高模型的性能和预测能力LASSO(Least Absolute Shrinkage and Selection Operator)回归是一种用于回归分析的线性模型,它通过引入L1正则化(Lasso正则化)来简化模型并减少过拟合的风险主成分分析(Principal Component Analysis,PCA)

【机器学习】Lasso回归:稀疏建模与特征选择的艺术

🌈个人主页: 鑫宝Code 🔥热门专栏: 闲话杂谈| 炫酷HTML | JavaScript基础 💫个人格言: "如无必要,勿增实体" 文章目录 Lasso回归:稀疏建模与特征选择的艺术引言一、Lasso回归简介1.1 基本概念1.2 数学表达式 二、算法与实现2.1 解决方案2.2 Python实现示例 三、Lasso回归的优势与特性3.1

【Python机器学习实战】 | Lasso回归和弹性网回归详细分析研究

🎩 欢迎来到技术探索的奇幻世界👨💻 📜 个人主页:@一伦明悦-CSDN博客 ✍🏻 作者简介: C++软件开发、Python机器学习爱好者 🗣️ 互动与支持:💬评论 👍🏻点赞 📂收藏 👀关注+ 如果文章有所帮助,欢迎留下您宝贵的评论, 点赞加收藏支持我,点击关注,一起进步! 引言 Lasso回归(Lasso Regression)和

scikit-learn linaerRegression 1.1.3 LASSO

Lasso 是一种估计稀疏线性模型的方法.由于它倾向具有少量参数值的情况,对于给定解决方案是相关情况下,有效的减少了变量数量。 因此,Lasso及其变种是压缩感知(压缩采样)的基础。在约束条件下,它可以回复一组非零精确的权重系数(参考Compressive sensing: tomography reconstruction with L1 prior (Lasso)). 用数学形式

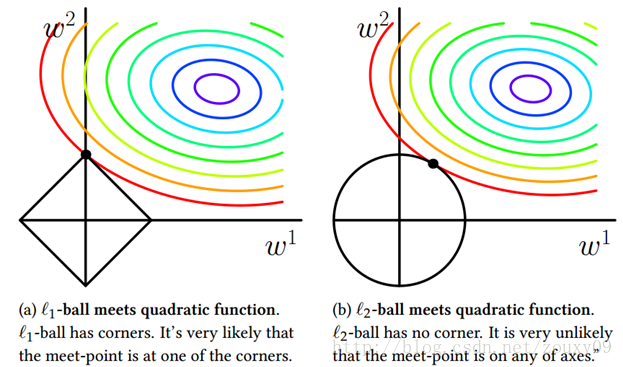

LASSO与redge回归区别 L1 L2范数之间的区别

转载自:http://blog.csdn.net/sinat_26917383/article/details/52092040 一、正则化背景 监督机器学习问题无非就是“minimizeyour error while regularizing your parameters”,也就是在规则化参数的同时最小化误差。最小化误差是为了让我们的模型拟合我们的训练数据, 而规

降维1-----LASSO(24年5月2日)

这篇哥们儿写的老有意思了: 统计学习:变量选择之Lasso - 知乎 (zhihu.com) Lasso Regression with Scikit-Learn (Beginner Friendly) (youtube.com) from sklearn.linear_model import Lassofrom sklearn.datasets import load_iris# 加

Shark源码分析(五):线性回归算法与Lasso回归

Shark源码分析(五):线性回归算法与Lasso回归 为什么上一篇还是三,这一篇就跳到五了呢?其实我们原来提到过: 方法=模型+策略+算法 方法 = 模型+策略+算法 这里的模型与算法我们之前都已经提到过了,虽然只是介绍了一个基类,并没有涉及到其具体的实现。在这里我们就会揭开其真正面目了。『策略』我们还没有介绍过,其实就是目标函数,在前面一些较为简单的算法中并没有涉及到这

7.机器学习-十大算法之一拉索回归(Lasso)算法原理讲解

7.机器学习-十大算法之一拉索回归(Lasso)算法原理讲解 一·摘要二·个人简介三·前言四·原理讲解五·算法流程六·代码实现6.1 坐标下降法6.2 最小角回归法 七·第三方库实现7.1 scikit-learn实现(坐标下降法):7.2 scikit-learn 实现(最小角回归法): 一·摘要 拉索回归(Lasso Regression)是一种线性回归的正则化形式,它通过

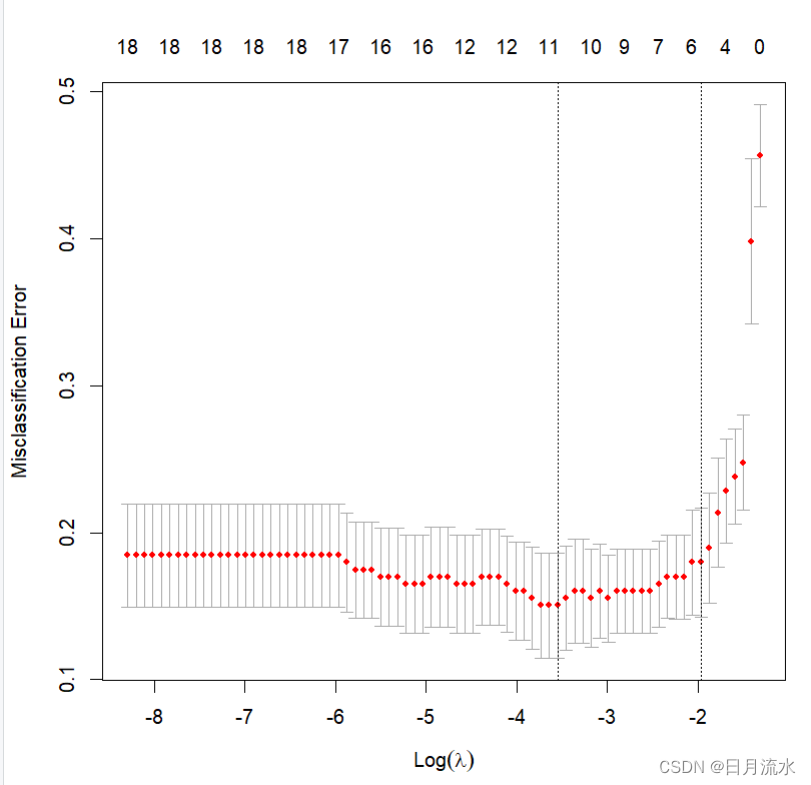

R语言逻辑回归与lasso模型

一、数据描述 数据集heart_learning.csv与heart_test.csv是关于心脏病的数据集,heart_learning.csv是训练数据集,heart_test.csv是测试数据集。 变量名称变量说明age年龄sex性别,取值1代表男性,0代表女性pain 胸痛的类型,取值1,2,3,4,代表4种类型bpress入院时的静息血压(单位:毫米汞柱chol血清胆固醇(单位:毫克/

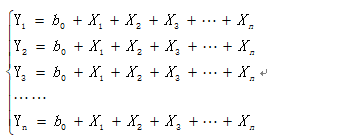

多变量处理的LASSO方法

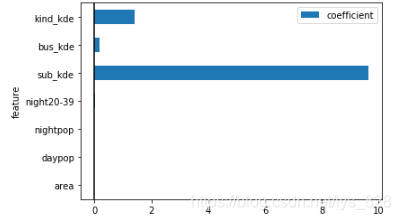

1.lasso方法 其中,因变量是Y,自变量是X。(数据中的变量众多,但如何选择X,就使用了lasso) lasso能够对变量进行筛选和对模型的复杂程度进行降低。这里的变量筛选是指不把所有的变量都放入模型中进行拟合,而是有选择的把变量放入模型从而得到更好的性能参数。 lasso回归的特色就是在建立广义线型模型的时候,这里广义线型模型包含一维连续因变量、多维连续因变量、非负次数因变量、二元离散

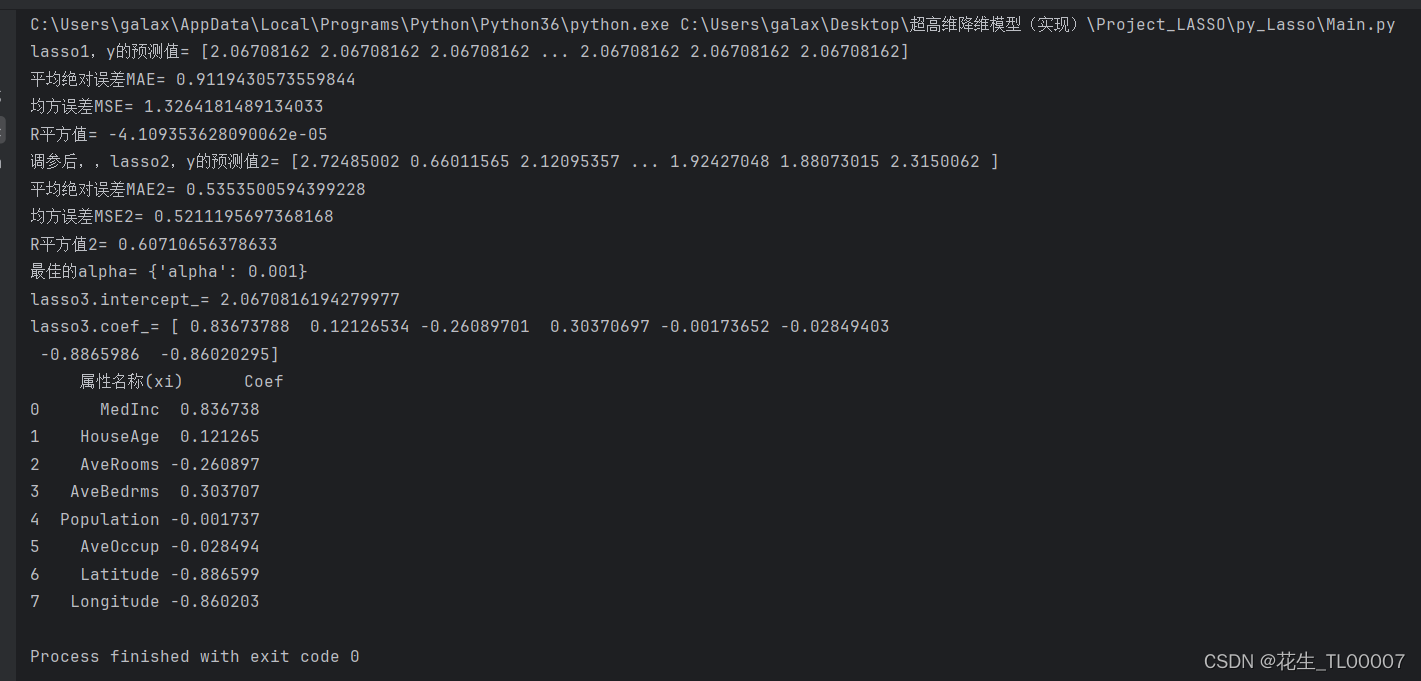

python 机器学习包 sklearn 实现 LASSO回归

转自:https://blog.csdn.net/luanpeng825485697/article/details/79829926

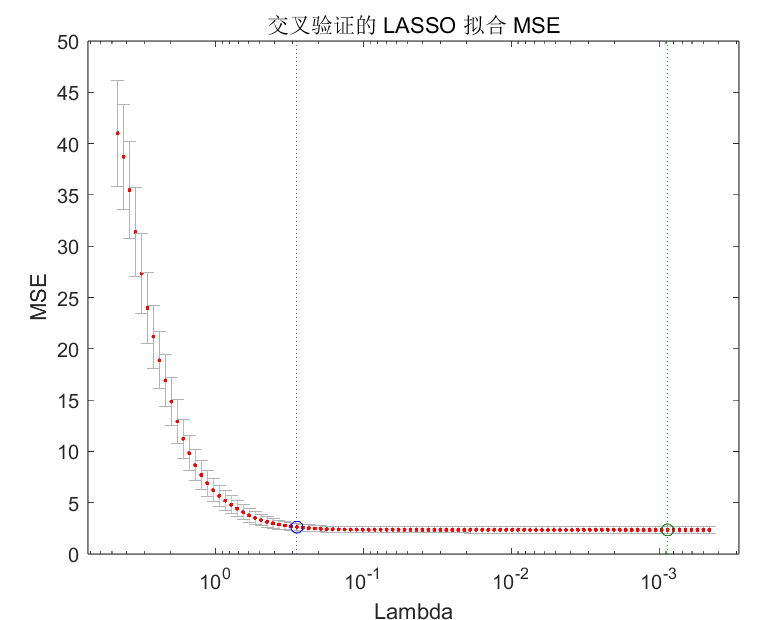

回归预测模型:MATLAB岭回归和Lasso回归

1. 岭回归和Lasso回归的基本原理 1.1 岭回归: 岭回归(Ridge Regression) 是一种用于共线性数据分析的技术。共线性指的是自变量之间存在高度相关关系。岭回归通过在损失函数中添加一个L2正则项( λ ∑ j = 1 n β j 2 \lambda \sum_{j=1}^{n} \beta_j^2 λ∑j=1nβj2)来减小回归系数的大小,从而控制模型的复杂度和防止过拟

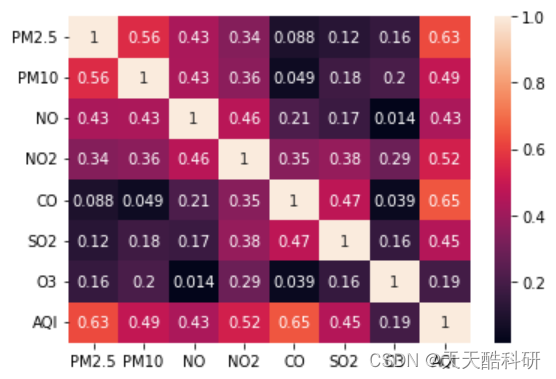

空气质量预测 | Python实现基于线性回归、Lasso回归、岭回归、决策树回归的空气质量预测模型

文章目录 效果一览文章概述源码设计参考资料 效果一览 文章概述 政府机构使用空气质量指数 (AQI) 向公众传达当前空气污染程度或预测空气污染程度。 随着 AQI 的上升,公共卫生风险也会增加。 不同国家有自己的空气质量指数,对应不同国家的空气质量标准。 对于空气质量预测,我们将使用 4 种算法: 1.线性回归 2.Lasso回归 3.岭回归 4.决策树

Lasso回归(Lasso Regression)

什么是机器学习 Lasso回归(Lasso Regression),也称为 L1 正则化线性回归,是一种在线性回归模型中加入 L1 正则化项以防止过拟合的方法。与岭回归(Ridge Regression)不同,Lasso回归使用的是参数的绝对值(L1范数)来添加正则化项。 Lasso回归的目标函数可以表示为: 其中: J(θ) 是Lasso回归的目标函数MSE(θ) 是均方误差(Mean

【Python机器学习】线性模型——lasso

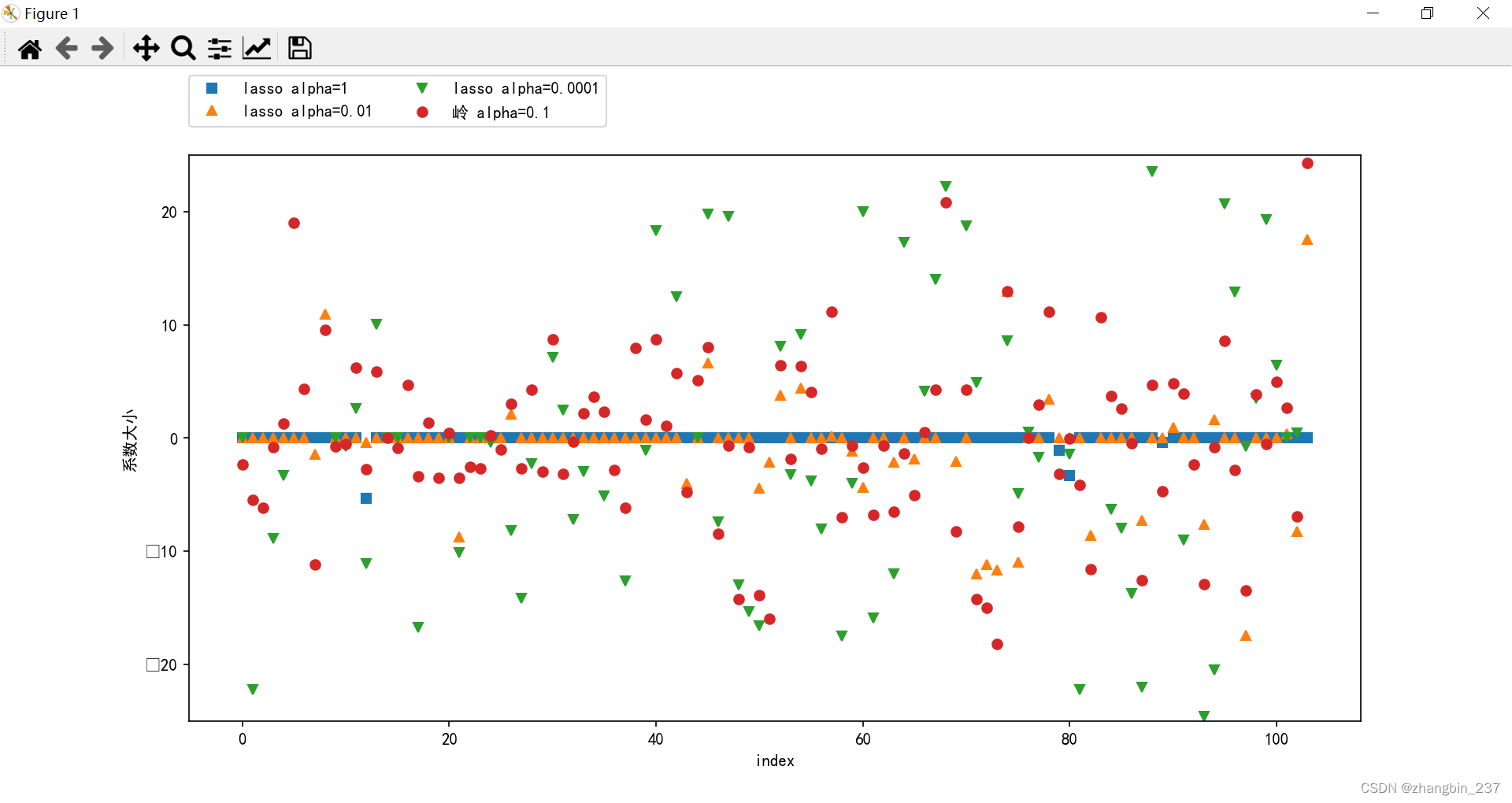

除了岭回归,还有一种正则化的线性回归是lasso,与岭回归相同,使用lasso也是约束系数使其接近于0,但方法不同,叫做L1正则化。L1正则化的结果是使用lasso时某些系数刚好为0。说明某些特征被模型完全忽略。 同样以波士顿房价数据集为例: import mglearn.datasetsfrom sklearn.model_selection import train_test_split

ML之回归预测之Lasso:利用Lasso算法对对红酒品质wine数据集解决回归(实数值评分预测)问题—优化模型【增加新(组合)属性】

ML之回归预测之Lasso:利用Lasso算法对对红酒品质wine数据集解决回归(实数值评分预测)问题—优化模型【增加新(组合)属性】 目录 输出结果 设计思路 核心代码 输出结果 设计思路 核心代码 names[-1] = "a^2"names.append("a*b")nrows = len(xList)ncols = len(x

正则化实战( Lasso 套索回归,Ridge 岭回归)

Lasso 套索回归 导入包 import numpy as npfrom sklearn.linear_model import Lassofrom sklearn.linear_model import SGDRegressor, LinearRegression 原方程的计算结果 # 1. 创建数据集X,yX = 2 * np.random.rand(100, 20)w =

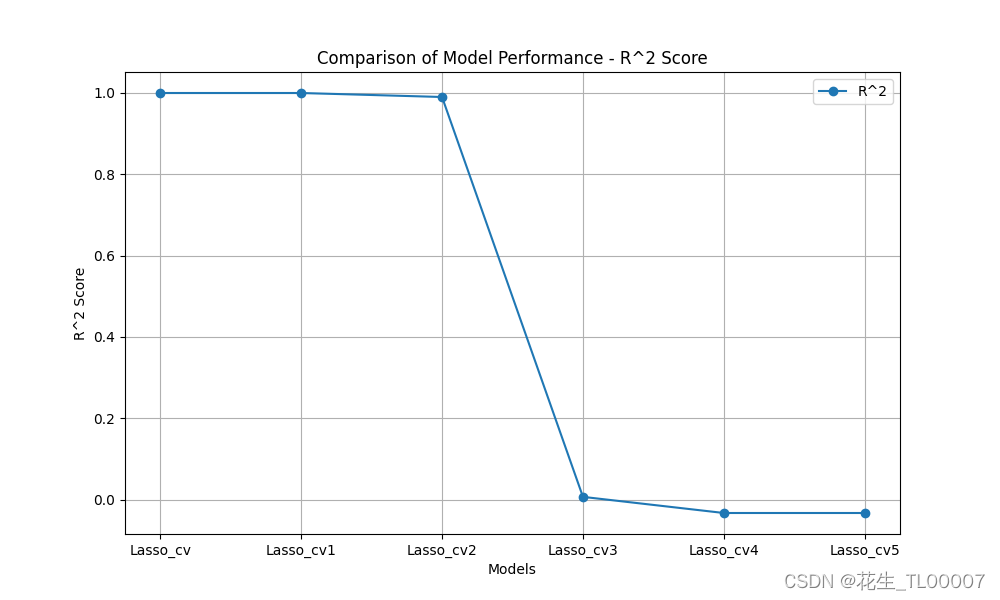

【机器学习(5)】Scikit-learn创建线性回归模型(LinearRegression、Lasso及Ridge)和逻辑回归模型(logistic)

1. 数据加载 假如进行房价的预测,这里加载的数据共1000条,共十个维度(十个特征),除了id以外,其余的都是自变量(9个可用) import pandas as pdimport numpy as np import osimport matplotlib.pyplot as pltos.chdir(r"C:\Users\86177\Desktop")df = pd.read_cs

以更快的承诺方案助力Lasso/Jolt

1. 引言 前序博客有: 基于Towers of Binary Fields的succinct argumentsmultilinear多项式承诺方案benchmark对比关于Lasso、Jolt和SNARK设计最新进展的技术常见问题解答Lasso、Jolt 以及 Lookup Singularity——Part 1Lasso、Jolt 以及 Lookup Singularity——Part