augmented专题

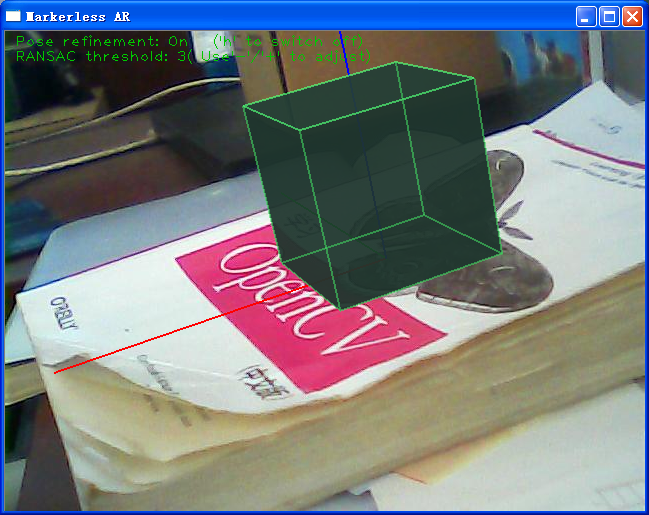

第三章 少量(无)标记增强现实——Chapter 3:Marker-less Augmented Reality

注释: 1、翻译书名:Mastering OpenCV with Practical Computer Vision Projects 2、翻译章节:Chapter 3:Marker-less Augmented Reality 3、电子书下载,源代码下载,请参考:http://blog.csdn.net/raby_gyl/article/details/11617875 4、本章程序

deeplabv3+使用voc2012 augmented 数据进行训练

在原始的论文中结果使用了augmented数据的,因为改数据不是平移旋转放缩的增加方式,而是将voc2012中未标注的图片进行了标注,不过由于并不是那种很精准的标注,举个例子: 也没有白边,推测是利用边缘检测结合手工。 关于该数据的获取:https://blog.csdn.net/u013249853/article/details/100136780 使用方法简单到不可思议。。。 注

论文翻译:Benchmarking Large Language Models in Retrieval-Augmented Generation

https://ojs.aaai.org/index.php/AAAI/article/view/29728 检索增强型生成中的大型语言模型基准测试 文章目录 检索增强型生成中的大型语言模型基准测试摘要1 引言2 相关工作3 检索增强型生成基准RAG所需能力数据构建评估指标 4实验设置噪声鲁棒性结果负面拒绝测试平台结果信息整合测试平台结果反事实鲁棒性测试平台结果 5 结论 摘要

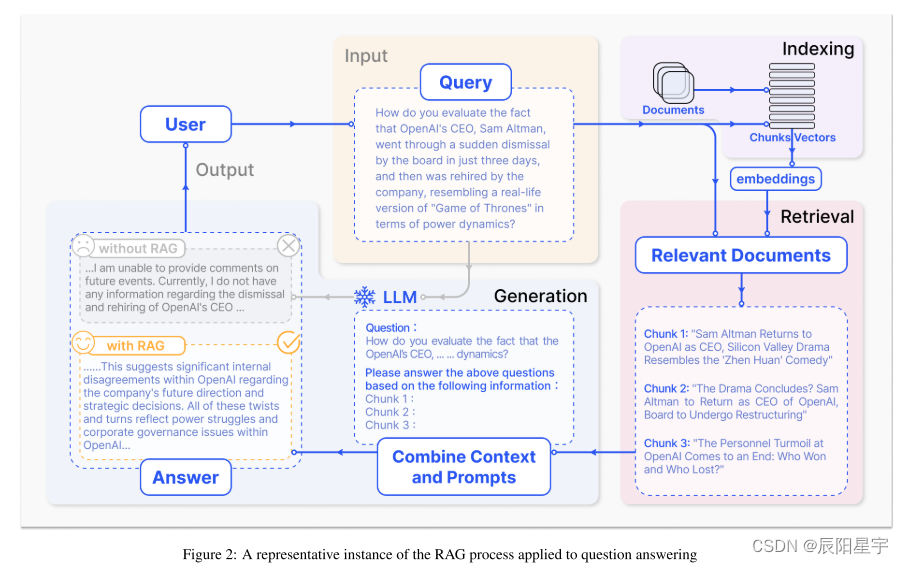

Retrieval-Augmented Generation for Large Language Models A Survey

Retrieval-Augmented Generation for Large Language Models: A Survey 文献综述 文章目录 Retrieval-Augmented Generation for Large Language Models: A Survey 文献综述 Abstract背景介绍 RAG概述原始RAG先进RAG预检索过程后检索过程 模块化RAGMo

Retrieval-Augmented Generation for Large Language Models: A Survey论文阅读

论文:https://arxiv.org/pdf/2312.10997.pdf github:https://github.com/Tongji-KGLLM/ RAG-Survey 简介 大语言模型常常制造虚假事实,在处理特定领域或高度专业化的查询时缺乏知识。例如,当所需信息超出模型训练数据的范围或需要最新数据时,LLM可能无法提供准确的答案。这一限制在将生成型人工智能部署到现实世界的生产

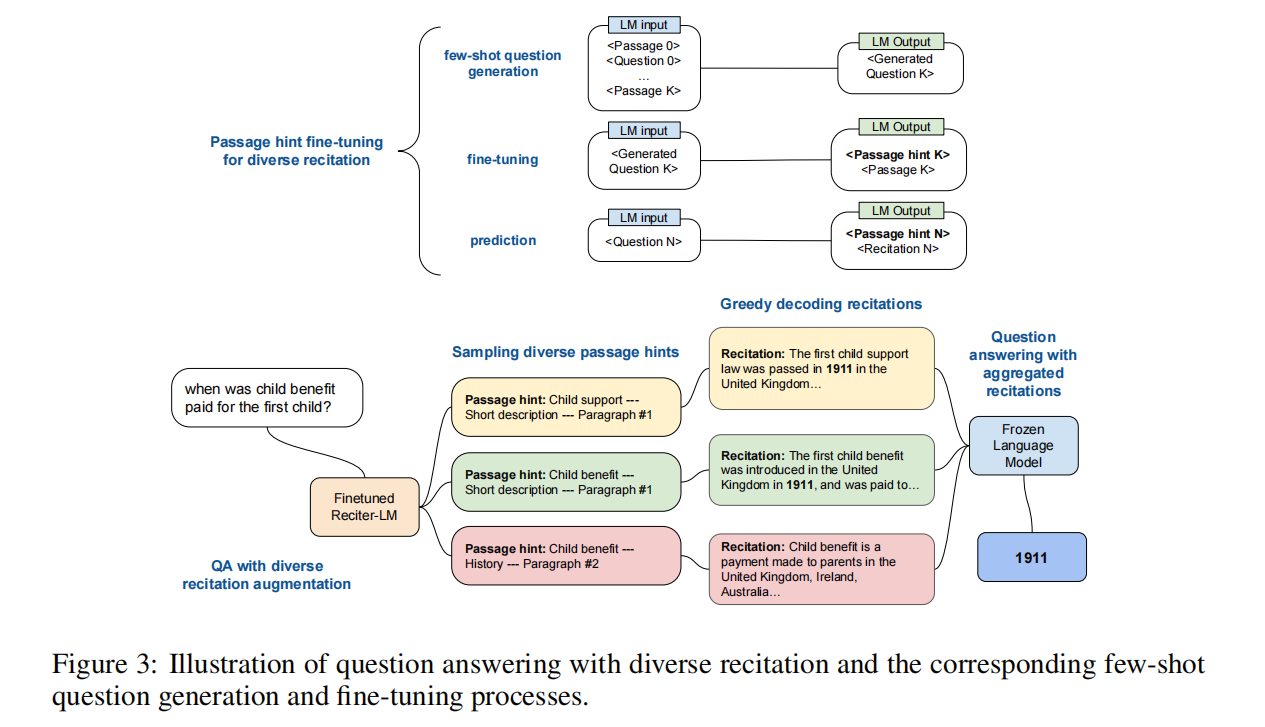

【LLM 论文】背诵增强 LLM:Recitation-Augmented LM

论文:Recitation-Augmented Language Models ⭐⭐⭐ ICLR 2023, Google Research, arXiv:2210.01296 Code:github.com/Edward-Sun/RECITE 文章目录 论文速读 论文速读 论文的整体思路还是挺简单的,就是让 LLM 面对一个 question,首先先背诵(recita

IOS Augmented Reality增强现实学习笔记 -基于位置

地图编程和定位是增强现实技术的基础,因此首先学习Location Services 1标准定位(standard location service) 有两种方式可以监控我们的位置,首先是标准定位。这是一种很普遍的方式,因为所有的ios设备都支持标准定位。首先我们要导入Core Location Framework到我们的工程中,然后把Core Location Framework加入到头文件

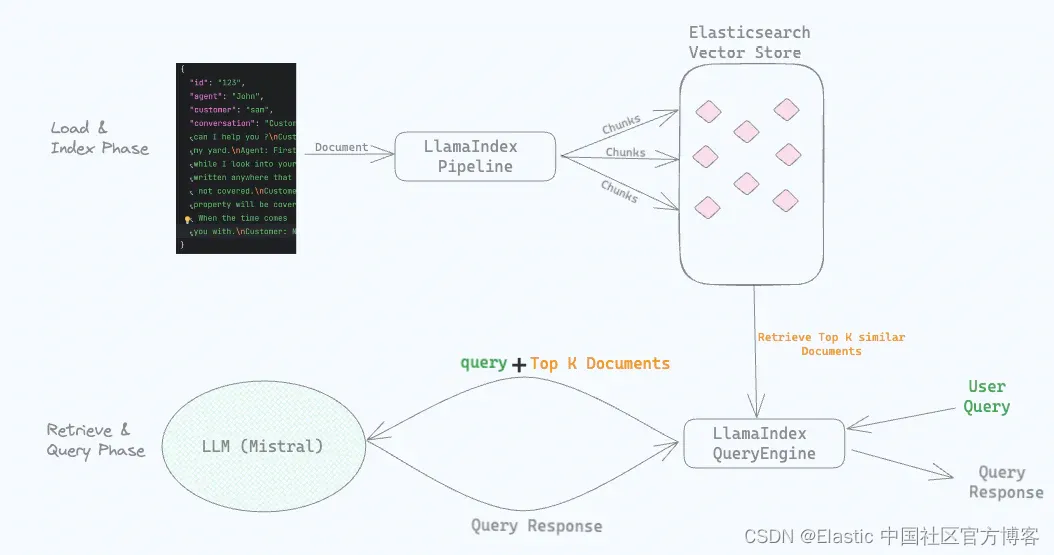

RAG (Retrieval Augmented Generation) 结合 LlamaIndex、Elasticsearch 和 Mistral

作者:Srikanth Manvi 在这篇文章中,我们将讨论如何使用 RAG 技术(检索增强生成)和 Elasticsearch 作为向量数据库来实现问答体验。我们将使用 LlamaIndex 和本地运行的 Mistral LLM。 在开始之前,我们将先了解一些术语。 术语解释: LlamaIndex 是一个领先的数据框架,用于构建 LLM(大型语言模型)应用程序。LlamaIndex

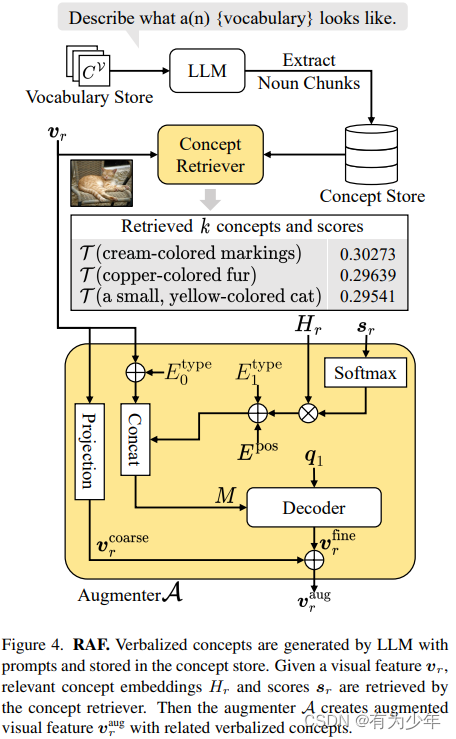

CVPR 2024 | Retrieval-Augmented Open-Vocabulary Object Detection

CVPR 2024 - Retrieval-Augmented Open-Vocabulary Object Detection 论文:https://arxiv.org/abs/2404.05687代码:https://github.com/mlvlab/RALF原始文档:https://github.com/lartpang/blog/issues/13 本文提出了一种新的开放词汇目标检测

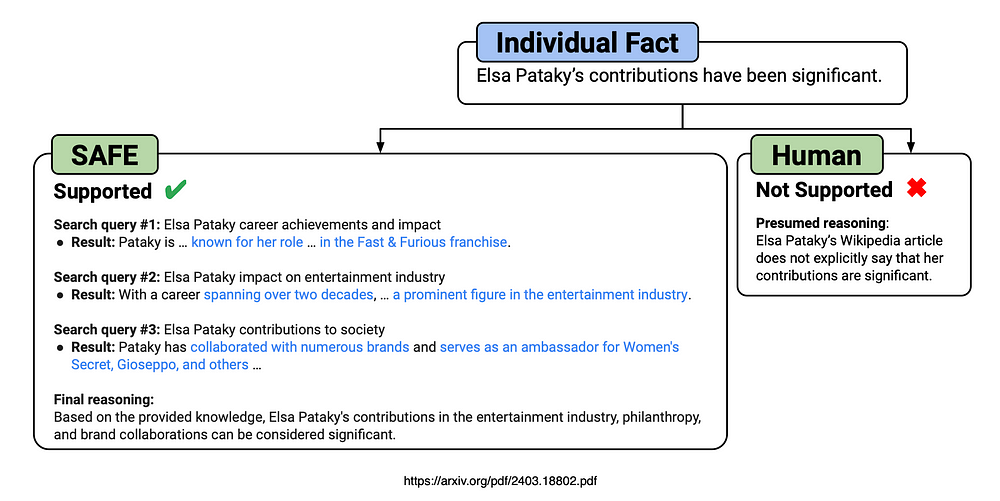

适用于LLM的代理搜索增强事实评估器 (Search-Augmented Factuality Evaluator,SAFE)

原文地址:agentic-search-augmented-factuality-evaluator-safe-for-llms 2024 年 4 月 6 日 介绍 SAFE作为事实性评估代理,其评估结果在72%的情况下与人类众包注释者观点一致。 在随机选取的100个存在分歧的案例中,SAFE的判断结果有76%是正确的。 SAFE的成本比人类注释者低20倍以上。 利用GPT-4生成了Lon

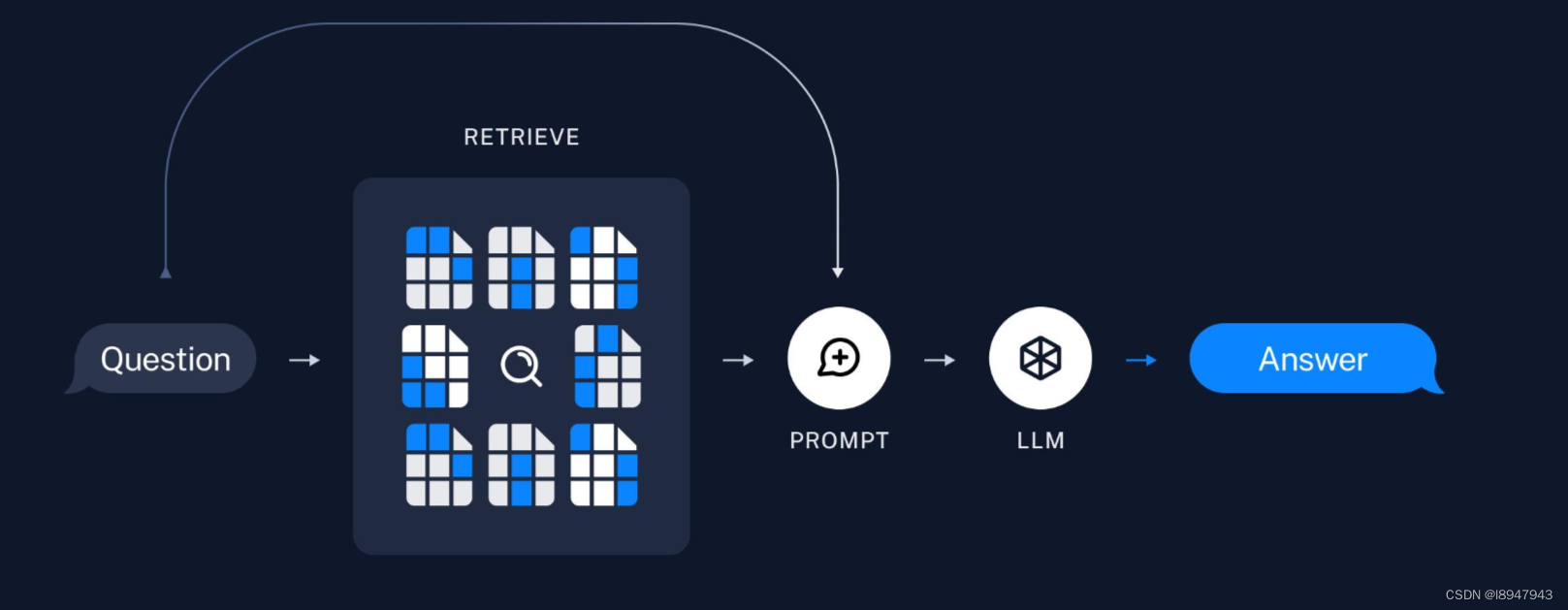

什么是检索增强生成(Retrieval-Augmented Generation,RAG)

什么是RAG? 检索增强生成(Retrieval-Augmented Generation,RAG),是指为大模型提供外部知识源的概念。能够让大模型生成准确且符合上下文的答案,同时能够减少模型幻觉。 用最通俗的语言描述:在已有大模型的基础上,外挂一个知识库,让大模型学习这个知识库后,回答的内容与知识库更为相关,与实际业务场景更加贴切,符合我们的需求。 为什么要用RAG? 模型知识局限

Augmented Dickey–Fuller (ADF)Test 详解

扩张的Dickey–Fuller检定是在时间序列分析当中用来辨识个别变数的样本资料是否存在单根之检定。它从Dickey-Fuller检定扩张修改而来。 ADF检验和迪基-福勒检验类似,但ADF检验的优点在于它透过纳入(理论上可无限多期,只要资料量容许)落后期的一阶向下差分项,排除了自相关的影响。 迪基-福勒检验 在统计学里,迪基-福勒检验(Dickey-Fuller test)可以测试一

【检索增强】Retrieval-Augmented Generation for Large Language Models:A Survey

本文简介 1、对最先进水平RAG进行了全面和系统的回顾,通过包括朴素RAG、高级RAG和模块化RAG在内的范式描述了它的演变。这篇综述的背景下,更广泛的范围内的法学硕士研究RAG的景观。 2、确定并讨论了RAG过程中不可或缺的核心技术,特别关注“检索”、“生成”和“增强”方面,并深入研究了它们的协同作用,阐明了这些组件如何复杂地协作以形成一个有凝聚力和有效的RAG框架。 3、构建了一个全面的

M4C精读:融合多种模态到公共语义空间,使用指针增强多模态变形器来迭代应答TextVQA任务 Iterative Answer Prediction Pointer-Augmented

M4C精读:融合多种模态到公共语义空间,使用指针增强多模态变形器来迭代应答TextVQA任务 Iterative Answer Prediction with Pointer-Augmented Multimodal Transformers for TextVQA 论文点我 Code点我 摘要 许多视觉场景都包含了承载重要信息的文本,因此理解图像中的文本对于后续的推理任务是至关重要的。例

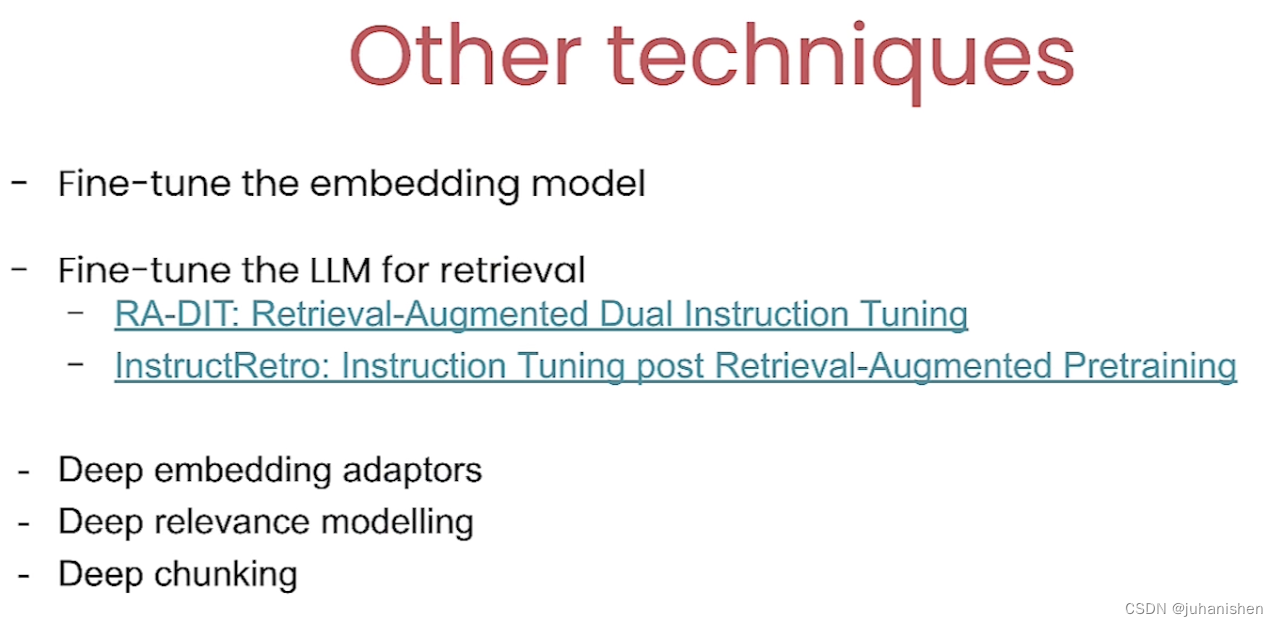

RAG综述 《Retrieval-Augmented Generation for Large Language Models: A Survey》笔记

文章目录 概述RAG 的定义RAG的框架Naive RAGAdvanced RAGpre-retrieval processRetrievalpost-retrieval process Modular RAG RetrievalEnhancing Semantic Representationschunk 优化 微调向量模型Aligning Queries and DocumentsAli

一文读懂「RAG,Retrieval-Augmented Generation」检索增强生成

Retrieval-Augmented Generation(RAG)作为机器学习和自然语言处理领域的一大创新,不仅代表了技术的进步,更在实际应用中展示了其惊人的潜力。 RAG结合了检索(Retrieval)和生成(Generation)两大核心技术,通过这种独特的混合机制,能够在处理复杂的查询和生成任务时,提供更加准确、丰富的信息。无论是在回答复杂的问题,还是在创作引人入胜的故事,RA

大模型RAG(索增强生成(Retrieval Augmented Generation))

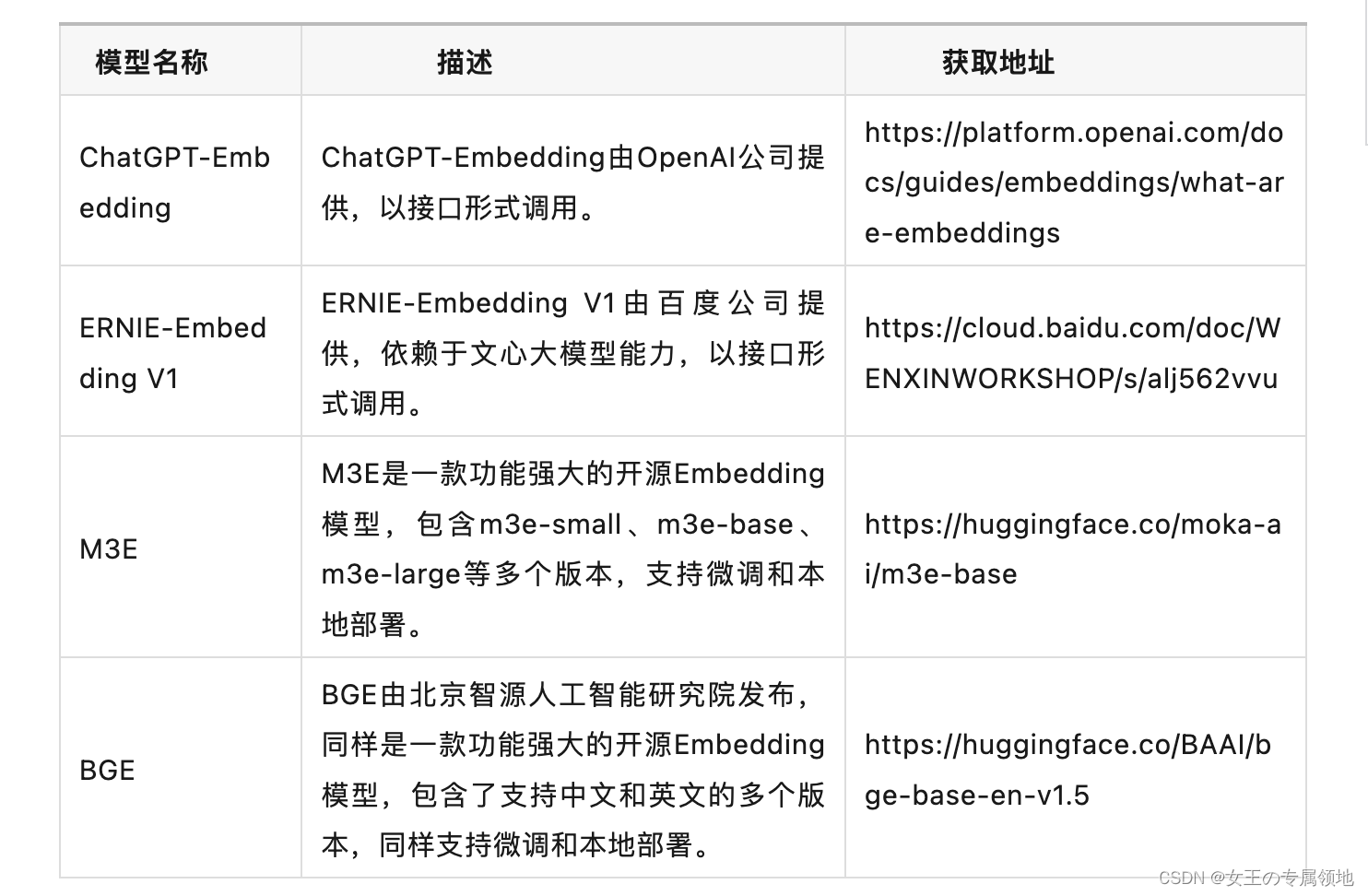

我们将大模型应用于实际业务场景时会发现,通用的基础大模型基本无法满足我们的实际业务需求 以下几方面原因:知识的局限性,数据安全性 RAG是解决上述问题的一套有效方案。 RAG(中文为检索增强生成) = 检索技术 + LLM 提示。例如,我们向 LLM 提问一个问题(answer),RAG 从各种数据源检索相关的信息,并将检索到的信息和问题(answer)注入到 LLM 提示中,LLM 最后给

【博士每天一篇文献-算法】Memory augmented echo state network for time series prediction

阅读时间:2023-11-24 1 介绍 年份:2023 作者:济南大学,刘千文、李范俊 期刊: Neural Computing and Applications 引用量:0 这篇论文介绍了记忆增强的回声状态网络(MA-ESN),旨在平衡ESN的记忆能力和非线性映射能力,以提高时间序列预测的性能。传统的ESNs具有较高的记忆能力,但其非线性映射能力有限,导致在复杂时间序列上的预测表现较差。M

[异常检测]Memorizing Normality to Detect Anomaly: Memory-augmented Deep Autoencoder for Unsupervised

源码地址:https://github.com/donggong1/memae-anomaly-detection 问题提出 ''It has been observed that sometimes the autoencoder “generalizes” so well that it can also reconstruct anomalies well, leading to the

RAG检索增强生成(Retrieval-augmented Generation)

RAG检索增强生成(Retrieval-augmented Generation)是一种结合了检索和生成的技术,旨在通过检索相关信息来增强文本生成的质量。这种方法通常用于处理需要大量上下文信息的任务,如生成式对话系统、问答系统等。 在RAG中,检索阶段会从大量的数据集中找到与生成任务相关的信息,这些信息随后被用来增强生成器在生成文本时的上下文理解。具体来说,检索到的

RAG (Retrieval Augmented Generation)简介

1. 背景 目前大模型很多,绝大部分大模型都是通用型大模型,也就是说使用的是标准的数据,比如wikipedia,百度百科,。。。。 中小型企业一般都有自己的知识库,而这些知识库的数据没有在通用型的大模型中被用到或者说训练到。如果中小型企业要适合自己本身业务需要的大模型,当然理想的方法是重新训练数据,而这些数据有其自身业务场景的数据。 现实是自身训练无论是人力成本,数据成本,计算成本都是不可行的。

[论文阅读] |RAG评估_Retrieval-Augmented Generation Benchmark

写在前面 检索增强能够有效缓解大模型存在幻觉和知识时效性不足的问题,RAG通常包括文本切分、向量化入库、检索召回和答案生成等基本步骤。近期组里正在探索如何对RAG完整链路进行评估,辅助阶段性优化工作。上周先对评估综述进行了初步的扫描,本篇分享其中一份评估benchmark,RGB。 论文:https://arxiv.org/abs/2309.01431 代码和数据:https://githu

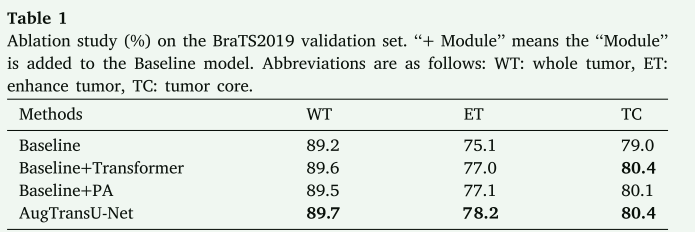

【论文阅读】Augmented Transformer network for MRI brain tumor segmentation

Zhang M, Liu D, Sun Q, et al. Augmented transformer network for MRI brain tumor segmentation[J]. Journal of King Saud University-Computer and Information Sciences, 2024: 101917. [开源] IF 6.9 SCIE JCI 1

ACL 2020 MART: Memory-Augmented Recurrent Transformer for Coherent Video Paragraph Captioning

动机 本文目标是生成一个段落(多个句子),条件是输入具有几个预定义的事件片段的视频。为视频生成多句子描述是最具挑战性的任务之一,因为它不仅要求视频的视觉相关性,而且要求段落中句子之间基于语篇的连贯性。最近,Transformer已被证明比RNN更有效,在许多顺序建模任务中展示了卓越的性能。之前将transformer模型引入视频段落captioning任务的方法,Transformer操作在分离

Retrieval-Augmented Generation for Large Language Models: A Survey

PS: 梳理该 Survey 的整体框架,后续补充相关参考文献的解析整理。本文的会从两个角度来分析总结,因此对于同一种技术可能在不同章节下都会有提及。第一个角度是从整体框架的迭代来看(对应RAG框架章节),第二个是从RAG中不同组成部分来看(对应 Retriever,Generator 和 Augmentation in RAG)。 https://arxiv.org/abs/2312.1099

Re58:读论文 REALM: Retrieval-Augmented Language Model Pre-Training

诸神缄默不语-个人CSDN博文目录 诸神缄默不语的论文阅读笔记和分类 论文名称:REALM: Retrieval-Augmented Language Model Pre-Training 模型名称:Retrieval-Augmented Language Model pre-training (REALM) 本文是2020年ICML论文,作者来自谷歌,关注RAG+LLM。目标是解决纯用LM参

![[异常检测]Memorizing Normality to Detect Anomaly: Memory-augmented Deep Autoencoder for Unsupervised](https://img-blog.csdnimg.cn/abdd90d6d6654884ab23b9e8880c52f1.png)

![[论文阅读] |RAG评估_Retrieval-Augmented Generation Benchmark](https://img-blog.csdnimg.cn/direct/917cb2d98d70495c96388e5cba5fcd64.png)