affective专题

Affective Computing Research

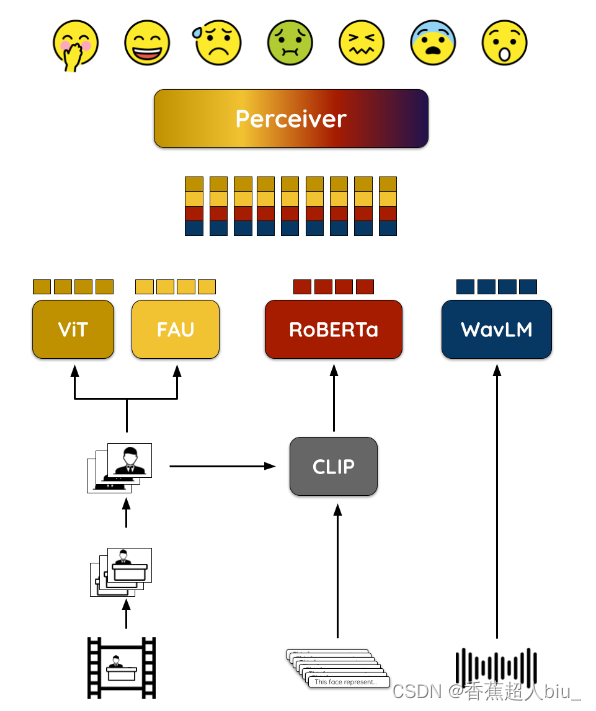

Disentangled Representation Learning for Multimodal Emotion Recognition 提出了一种特征分解的多模态情感识别方法,学习每种模态的共同和私有的特征表征。 Pipline 主要创新点 提出了一种特征解缠方法,同时提出了一种基于注意力机制的跨模态融合方法 设计了共同的和私有的编码器,将每个模态分别投射到模态不变的子空间和

Retrieving and Classifying Affective Images via Deep Metric Learning

论文标题: Retrieving and Classifying Affective Images via Deep Metric Learning (基于深度学习的情感图像检索与分类) 论文地址:http://users.cs.cf.ac.uk/Yukun.Lai/papers/retrieving-classifying-affective-AAAI18.pdf 1、Introductio

【论文阅读】Visual Sentiment Prediction Based on Automatic Discovery of Affective Regions

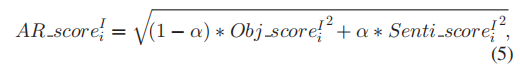

概括 本文尝试去解决在情感分析中所遇到的情感分类和可解释性问题。这里的可解释性主要指图片上哪一区域会影响人类视觉对情感的判断。本文解决这个问题的办法是引入了Affective Region (AR),类似空间注意力的东西。 结合流程图,整体的思路和亮点有两个: 弱监督找到AR(建立自动寻找AR的模型),用于定位最容易影响人类视觉判断情感的区域,起到辅助情感分类的作用。【也就是下面的红色虚

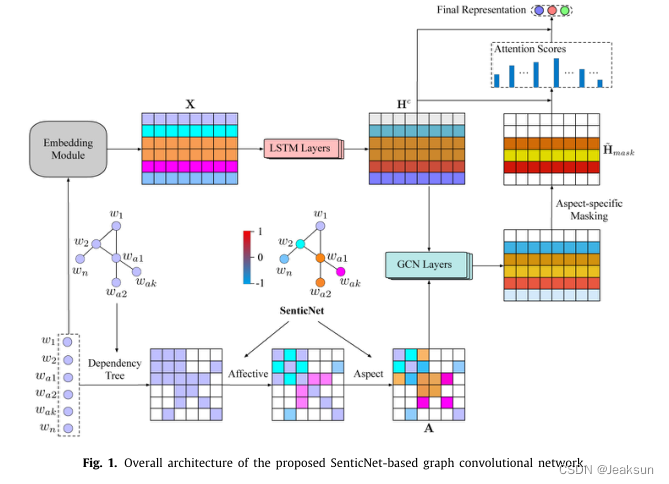

Aspect-based sentiment analysis via affective knowledge enhanced graph convolutional networks

Aspect-based sentiment analysis via affective knowledge enhanced graph convolutional networks 基于情感知识增强图卷积网络的基于方面的情感分析 Abstract 现有的研究大多集中在基于句子依存关系树的上下文词到aspect词的依存关系信息的学习上,缺乏对特定体的语境情感知识的挖掘。在本文中,作者

《Aspect-based sentiment analysis via affective knowledge enhanced graph convolutional networks》论文阅读

文章目录 文章介绍文章模型通过依赖树构建图学习特定方面实体的表示 总结 文章地址: https://www.sciencedirect.com/science/article/pii/S0950705121009059 文章介绍 最近,图卷积神经网络因为其优越的性能(能很好的考虑词语间的依赖)被广泛的应用在自然语言处理任务当中。其一般方式为首先将文本转化为邻接矩阵的形

[论文记录] 2021 - ArtEmis: Affective Language for Visual Art

[论文记录] 2021 - ArtEmis: Affective Language for Visual Art 论文简介论文内容摘要1 介绍(1)为什么关注于视觉艺术(visual art)?(2)ArtEmis数据集的创新点(3)观者反应的主观性(4)情感解释的难点(5)情感语音机器人 论文简介 原论文:ArtEmis: Affective Language for

Affect-LM: A Neural Language Model for Customizable Affective Text Generation

原先的LSTM求下一个单词的概率公式: 其中,f(.)是LSTM的输出结果。现在更改(加入情感能量项)如下: β表示情感强度,可以从0(中性,基线模型)到β=∞(生成的句子只由情感色彩的单词组成,没有语法结构) e t − 1 e_{t-1} et−1表示从上文学到的词向量,g( e t − 1 e_{t-1} et−1)表示属于哪种情感,例[1,0,1,1,0] V i T V{^

【论文阅读笔记】Visual Sentiment Prediction Based on AutomaticDiscovery of Affective Regions

主题:视觉情感分析 贡献: a)提出了一个深度框架,用于自动发现图像的情感区域,这些区域很可能会引发重要的情绪信息。该框架不依赖于图像中的对象类别,也不需要对边界框注释,比现有方法更加通用。 b)使用CNN构建视觉情感预测模型,该模型利用来自全局图像和局部图像区域的整体和局部信息。实验证明,最终得到的表达特征有助于视觉情感分类,在情感数据集的表现优于前人的方法。 c)实验结果表明,本文提出

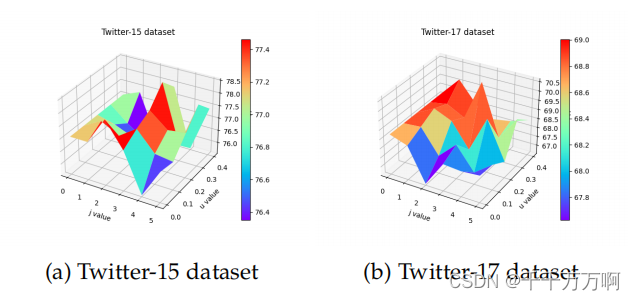

《Affective Region Recognition and FusionNetwork for Target-Level Multimodal SentimentClassificati》阅读

原论文地址:https://ieeexplore.ieee.org/abstract/document/10014688/ 代码地址:https://github.com/LiLi-Jia/ARFN(作者暂未上传代码) 摘要 目标级/方面级的多模态情感分类任务已经获得更多的关注。现有的方法主要依赖于将整个图像和文本结合起来,忽略了图像中的隐藏情感区域的作用。基于这个问题作者提出了ARFN

论文笔记 EMNLP 2020|Affective Event Classification with Discourse-enhanced Self-training

文章目录 1 简介1.2 创新 2 方法3 实验 1 简介 论文题目:Affective Event Classification with Discourse-enhanced Self-training 论文来源:EMNLP 2020 论文链接:https://aclanthology.org/2020.emnlp-main.452.pdf 1.2 创新 提出了一个基于

Affective Loop

Affective Loop(情感回路)是Hook在2007年提出的一个全新概念。Hook是一位著名的Affective Computing研究者。同Picard不同,Hook的研究侧重于Affective Interaction方面,更加强调特定情景下人类情感同特定交互行为的结合,将人类的情感同交互行为更加和谐的结合在一起。 Affective Loop这个概念其实很好理解,回忆下大学

Personalizing EEG-based Affective Models with Transfer Learning 阅读

提出了个体到个体的两种方法 1)源域和目标域共享结构(TCA、KPCA) 2)训练多个个体的分类器,对分类器参数进行迁移。 基本方法:组合所有个体可用的数据作为训练数据,训练一个基类分类器线性SVM。 数据特征维度:62*310(导联*特征维度) TCA和KPCA:源域:14个个体中随机选取5000个样本,核选用线性核,分类器选用one vs one 策略。目标域剩余的一个人 Tran

《论文阅读》用于情绪回复生成的情绪正则化条件变分自动编码器 Affective Computing 2021

《论文阅读》用于情绪回复生成的情绪正则化条件变分自动编码器 前言简介模型结构实验结果总结 前言 今天为大家带来的是《Emotion-Regularized Conditional Variational Autoencoder for Emotional Response Generation》 出版:IEEE Transactions on Affective C

![[论文记录] 2021 - ArtEmis: Affective Language for Visual Art](https://img-blog.csdnimg.cn/d839f11328134c5485f4c35bb29742fd.png?x-oss-process=image/watermark,type_ZHJvaWRzYW5zZmFsbGJhY2s,shadow_50,text_Q1NETiBARW1vcnlEb2Rpbg==,size_20,color_FFFFFF,t_70,g_se,x_16)