linearregression专题

IsotonicRegression、LinearRegression、RandomForestRegressor与FMRegressor

IsotonicRegression 核心原理: 保序回归(Isotonic Regression)是一种非参数回归方法,适用于处理有序数据。它试图在保持数据顺序的同时,拟合出一个单调非减或非增的函数。 数学表达式: 保序回归的目标是找到一个函数 ( f ( x ) ) ( f(\mathbf{x}) ) (f(x)),使得对于给定的数据点 ( ( x i , y i ) ) ( (\mat

scikit-learn linearRegression 1.1.11 随机梯度下降

1.5. 随机梯度下降 Stochastic Gradient Descent (SGD) 是一种简单但又非常高效的方式判别式学习方法,比如凸损失函数的线性分类器如 Support Vector Machines 和 Logistic Regression. 虽然SGD已经在机器学习社区出现很长时间,但是在近期在大规模机器学习上受到了相当大数量的关注。 SGD 已经被成功应用到大规模和稀

scikit-learn linearRegression 1.1.10 逻辑回归

逻辑回归形如其名,是一个线性分类模型而不是回归模型。逻辑回归在文献中也称为logit回归、最大熵分类(MaxEnt) 或者 log-linear classifier。 在这个模型中,描述单次可能结果输出概率使用 logistic function 来建模。 scikit-learn中逻辑回归的实现为 LogisticRegression 类。它可以拟合含L2或者L1正则化项的多类逻辑回归问

scikit-learn linearRegression 1.1.9 贝叶斯回归

1.1.9. 贝叶斯回归 可以在估计过程中使用贝叶斯回归技术包含正则化参数:正则化参数不是硬编码设置的而是手动调节适合数据的值 可以通过在模型的超参数上引入 uninformative priors `Ridge Regression`_ 中 使用的正则化项等价于在一个参数为 且精度为 的高斯先验下寻找 一个最大的后验的解。而且并不是手动设置 lambda ,而是有可能把它看做

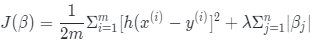

scikit-learn linearRegression 1.1.2 岭回归

Ridge 岭回归通过对回归稀疏增加罚项来解决 普通最小二乘法 的一些问题.岭回归系数通过最小化带罚项的残差平方和 上述公式中, 是控制模型复杂度的因子(可看做收缩率的大小) : 越大,收缩率越大,那么系数对于共线性的鲁棒性更强 一、一般线性回归遇到的问题 在处理复杂的数据的回归问题时,普通的线性回归会遇到一些问题,主要表现在

scikit-learn linearRegression 1.1.1 普通最小二乘法

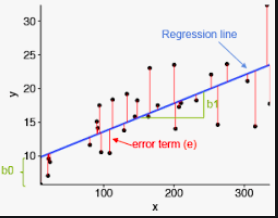

普通线性回归公式: 在这个公式中,为权值,有些书籍和文章也称为参数和权重,再线性回归中,通过优化算法求出最佳拟合的w和b(偏值),来进行预测 sklaern实例应用: LinearRegression 用系数 :math:w = (w_1,...,w_p) 来拟合一个线性模型, 使得数据集实际观测数据和预测数据(估计值)之间误差平方和最小,这也是最小二乘法的核心思想。数

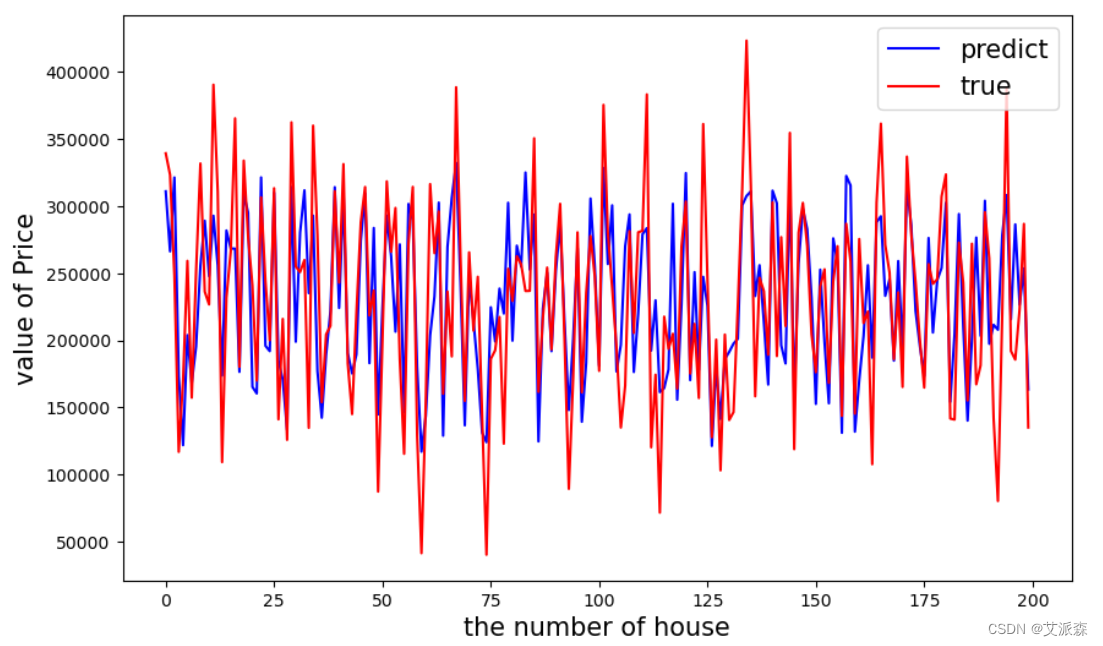

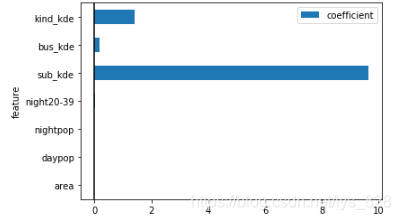

大数据分析案例-基于LinearRegression回归算法构建房屋价格预测模型

🤵♂️ 个人主页:@艾派森的个人主页 ✍🏻作者简介:Python学习者 🐋 希望大家多多支持,我们一起进步!😄 如果文章对你有帮助的话, 欢迎评论 💬点赞👍🏻 收藏 📂加关注+ 喜欢大数据分析项目的小伙伴,希望可以多多支持该系列的其他文章 大数据分析案例合集 大数据分析案例-基于随机森林算法预测人类预期寿命

Python-sklearn-LinearRegression

目录 1 手动实现/使用sklearn实现线性回归训练 1.1 单特征线性回归(One Feature) 1.2 多特征线性回归(Multiple Features) 1.3 多项式线性回归(Polynomial) 1 手动实现/使用sklearn实现线性回归训练 1.1 单特征线性回归(One Feature) 假设函数(One feature): 损失函数(平方差损

大数据分析案例-基于LinearRegression回归算法构建房屋价格预测模型

🤵♂️ 个人主页:@艾派森的个人主页 ✍🏻作者简介:Python学习者 🐋 希望大家多多支持,我们一起进步!😄 如果文章对你有帮助的话, 欢迎评论 💬点赞👍🏻 收藏 📂加关注+ 喜欢大数据分析项目的小伙伴,希望可以多多支持该系列的其他文章 大数据分析案例合集 大数据分析案例-基于随机森林算法预测人类预期寿命大数据分析案例-基于随机森林算法的商品评价情感分析大数据

机器学习原理到Python代码实现之LinearRegression

Linear Regression 线性回归模型 该文章作为机器学习的第一篇文章,主要介绍线性回归模型的原理和实现方法。 更多相关工作请参考:Github 算法介绍 线性回归模型是一种常见的机器学习模型,用于预测一个连续的目标变量(也称为响应变量)与一个或多个自变量之间的线性关系。 算法原理解析 传统版本 线性回归模型是一种常见的机器学习模型,用于预测一个连续的目标变量(也称为响

sklearn LinearRegression输出线性回归系数,得到回归方程

多元线性回归模型: (训练的时候设μ=0) model.fit(X,y) 训练出一个模型后,sklearn分了两部分存模型系数 model.coef_ # 得到[] model.intercept_ # ,截距,默认有截距 这样就可以写出完整模型啦~

SparkMLlib---LinearRegression(线性回归)、LogisticRegression(逻辑回归)

1、随机梯度下降 首先介绍一下随机梯度下降算法: 1.1、代码一: package mllibimport org.apache.log4j.{Level, Logger}import org.apache.spark.{SparkContext, SparkConf}import scala.collection.mutable.HashMap/** * 随机梯度下降算法

【机器学习(5)】Scikit-learn创建线性回归模型(LinearRegression、Lasso及Ridge)和逻辑回归模型(logistic)

1. 数据加载 假如进行房价的预测,这里加载的数据共1000条,共十个维度(十个特征),除了id以外,其余的都是自变量(9个可用) import pandas as pdimport numpy as np import osimport matplotlib.pyplot as pltos.chdir(r"C:\Users\86177\Desktop")df = pd.read_cs

线性回归模型sklearn.LinearRegression()原理解析

一、模型原理 Linear Rgegrssion基于最小二乘法的线性回归。是机器学习算法里面的基本算法,在sklearn.linear_model 的包里面。它能解决的问题是通过数据拟合,从而得到比较符合事物内部规律的数学表达式。也就是说寻找到数据与数据之间的规律所在。例如对于房价的预测。 二、线性回归的原理表示 我们先从最简单的函数看起,在只有一个变量的情况下,线性回归可以用方程:y =

深度学习-从零开始(2) - LinearRegression

本章背景 本章是来源于coursera课程 python-machine-learning中的作业2内容。 本章内容 多项式线性回归决定系数 R2 (coefficient of determination) 的计算ridge线性回归lasso线性回归 参考 评价回归模型r2_score为负数的问题探讨 0. Polynomial LinearRegression(多项式线性回归)