gated专题

论文笔记:A Gated Self-attention Memory Network for Answer Selection

作者:陈宇飞 单位:燕山大学 论文地址:https://www.aclweb.org/anthology/D19-1610/ 论文代码:https://github.com/laituan245/StackExchangeQA 目录 一、研究问题二、解决思路三、模型设计3.1 The gated self-attention mechanism3.2 Combining w

论文笔记《Gated-Attention Readers for Text Comprehension》

来源1606.01549 这篇论文提出的模型叫做GA Reader,用的是GRU,GRU中的两个门及候选状态的推理公式如下: GA Reader的实现思路为: 1,对于query首先也是用双向GRU处理,然后分别获取最后的状态concate一起。 2,对于doc也是用双向GRU处理,但是是输出每个时刻的Hidden,最后concate在一起。 3,然后用一个K层网络来处理,网

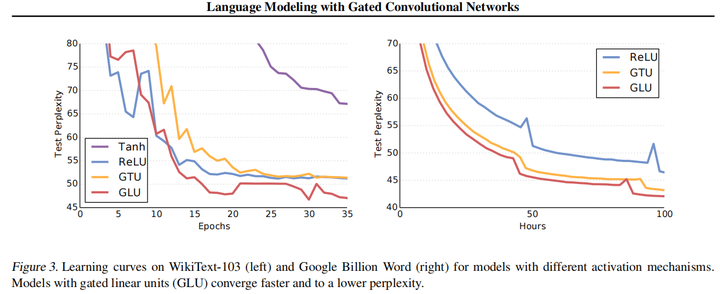

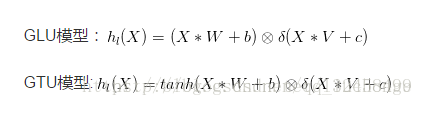

GLU(Gated Linear Unit) 门控线性单元

文章目录 一、RNN二、GLU2.1 整体结构2.2 输入层(Input Sentence+Lookup Table)2.3 中间层(Convolution+Gate)2.4 输出层(Softmax)2.5 实验结果2.6 实现代码 三、RNN与GLU的对比参考资料 GLU可以理解为能够并行处理时序数据的CNN网络架构,即利用CNN及门控机制实现了RNN的功能。优点在进行时序数据处

[论文笔记]Language Modeling with Gated Convolutional Networks

引言 今天带来论文Language Modeling with Gated Convolutional Networks的笔记,该篇工作提出了GLU(Gated Linear Units,门控线性单元)。 注意该篇工作是2016年发表,是在Transformer论文发表之前。当时作者认为语言建模的主要方法是基于循环神经网络。它们在这个任务上的成功往往与其捕捉无限上下文的能力有关。 在本篇工作

GCT:Gated Channel Transformation for Visual Recognition

论文名称:Gated Channel Transformation for Visual Recognition 作者:Zongxin Yang, Linchao Zhu, Y u Wu, and Yi Yang Code:https://github.com/z-x-yang/GCT 摘要 GCT模块是一个普遍适用的门控转换单元,可与网络权重一起优化。不同于SEnet通过全连接的隐式学

2020 ||门控通道注意力机制Gated Channel Transformation

Gated Channel Transformation for Visual Recognition 论文链接: https://arxiv.org/abs/1909.11519 代码地址: https://github.com/z-x-yang/GCT CSDN(这个是详细的解说):https://blog.csdn.net/weixin_47196664/article/details

Gated Neural Networks for Targeted Sentiment Analysis原文、翻译及代码

论文地址 代码地址 摘要 目标情感分析对给定文本文档中每个目标实体提及的情感极性进行分类。Seminal方法从自动句法解析树中提取人工离散特征,以捕获封闭句对目标实体提及的语义信息。最近,已经证明了不使用句法解析器就可以实现有竞争力的准确度,因为句法解析器在推文等嘈杂的文本上可能非常不准确。这是通过在根据目标实体提及的推文的简单和直观的分割上应用分布式词表示和丰富的神经池函数来实现的。在本文中

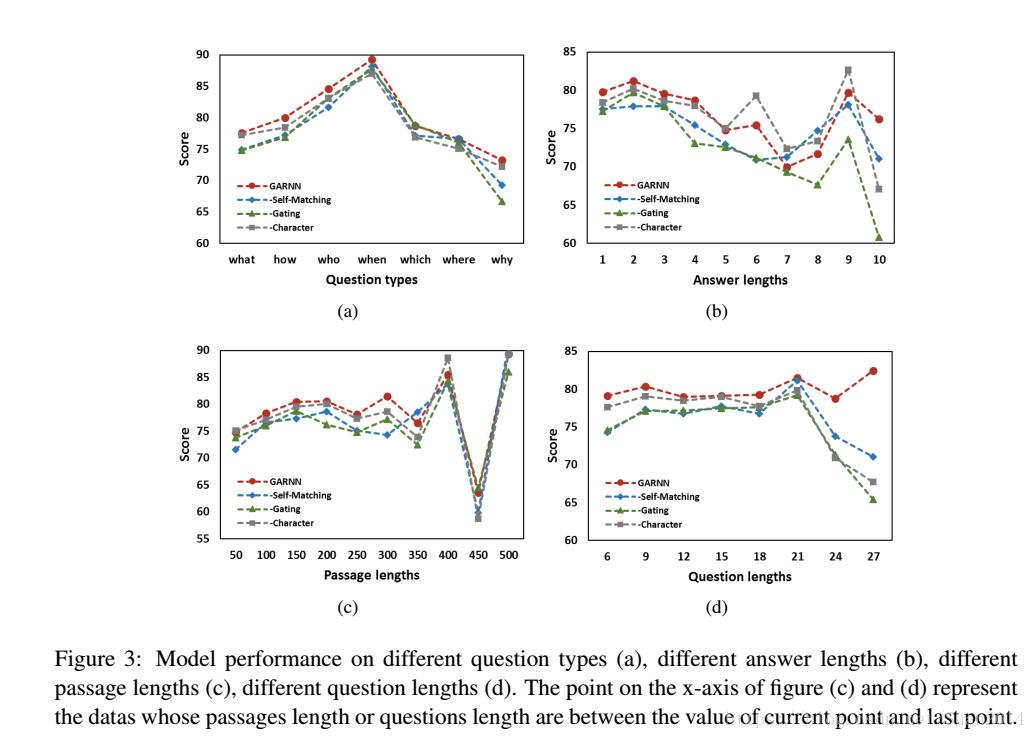

Gated Self-Matching Networks for Reading Comprehension and Question Answering论文笔记

原文下载链接 摘要 检索式问答系统试图从文档中获取问题的答案。一般步骤是先从一众文档中检索相关文档,然后再进一步检索文档回答问题。本文解决的是后一步,即阅读理解式的问答系统。文章基于端到端的多层神经网络模型从篇章中获取答案。 模型分为四部分:一是使用多层双向神经网络编码问题和篇章的语义向量表示;二是使用门注意力机制得到问题感知的篇章的语义向量表示;三是通过 Self-Matching 注意力

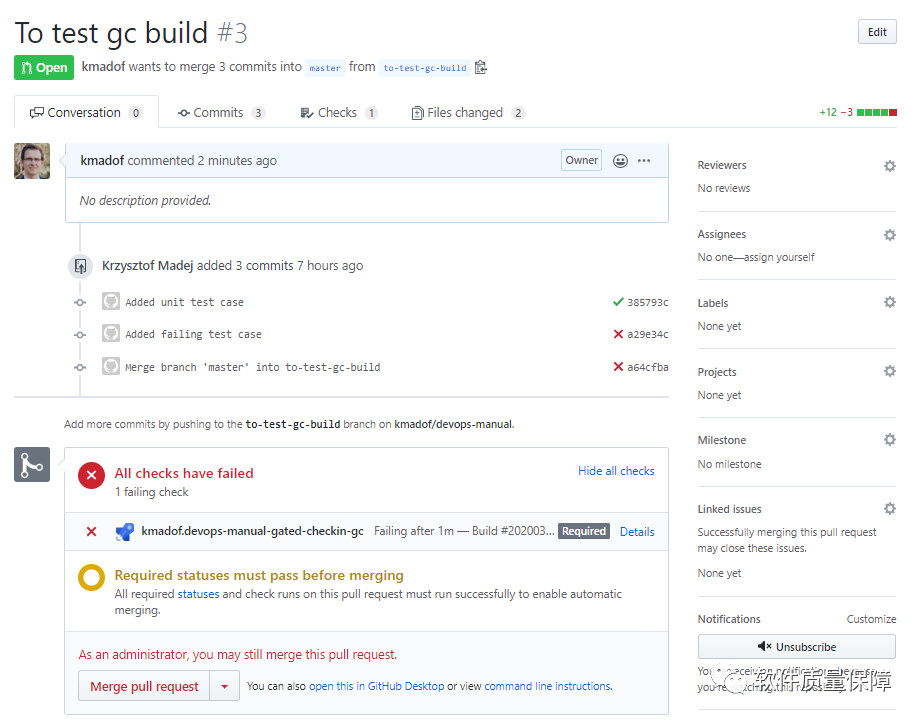

代码门禁(Gated Check-in)

软件质量保障:普及测试技术 标准 CI 构建是在代码合并后检查已提交 代码 的功能完整性,这种方法会导致代码出现测试用例执行失败甚至编译失败而无法部署的情况(即代码合并到master后编译失败导致没有可用版本部署)。 代码门禁则是在代码合并之前就验证代码来保护主干分支的完整性。通过这种方式,可以保护主分支代码避免因合码导致的构建中断,以确保 master 分支代码始终是可部署的,并且不会因

论文笔记——Gated-Attention Readers for Machine Reading Comprehension

Inroduction 本文是ACL 2017的一篇文章,用更细粒度的gated-attention对背景文章和问题进行计算。作者是CMU的Graduate Research Assistant: Bhuwan Dhingra。文章的相关工作部分总结的很好,代码实现可以参考[GitHub]。 Background 本文针对的是MRC任务中的Cloze-Style类型,翻译过来是叫完形填空,但是

【算法】门控线性单元 GLU(Gated Linear Units)

https://blog.csdn.net/liuchonge/article/details/70238350 门控线性单元Gated linear units是在Language model with gated convolutional network中提出的。 首先我们可以通过堆叠CNN来标识长文本,提取更高层、更抽象的特征,而且相比LSTM而言,我们需要的op更少(CNN需要O(N

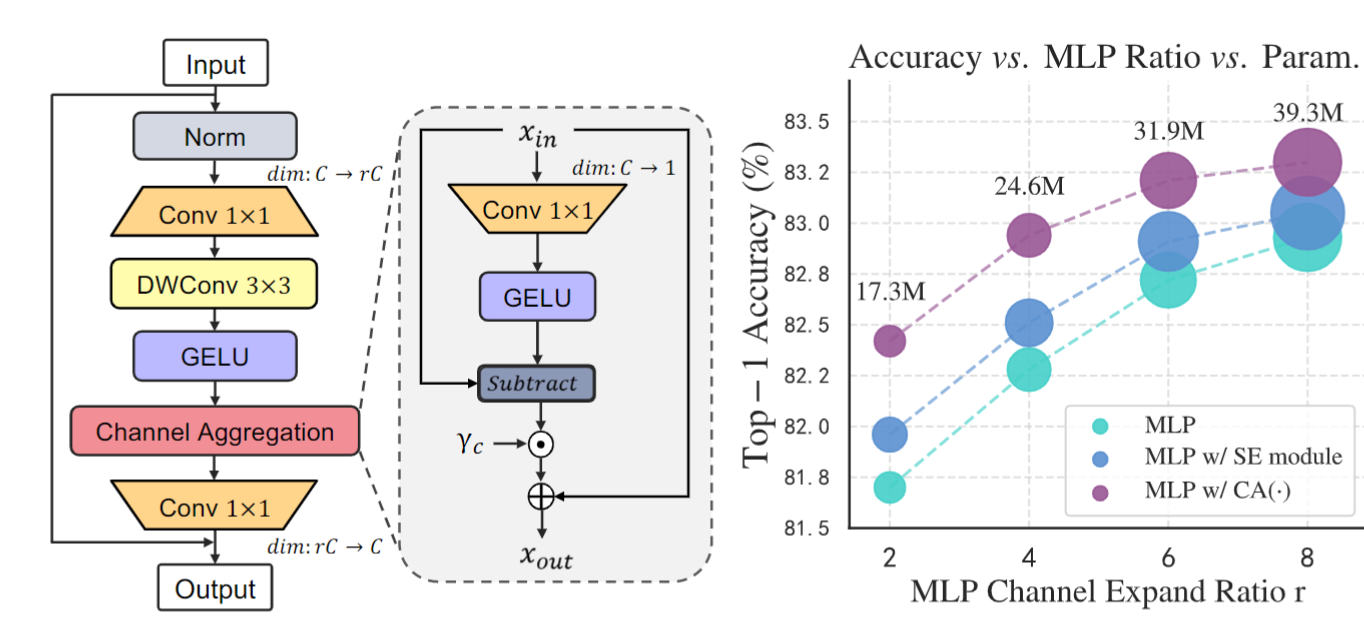

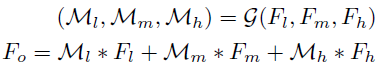

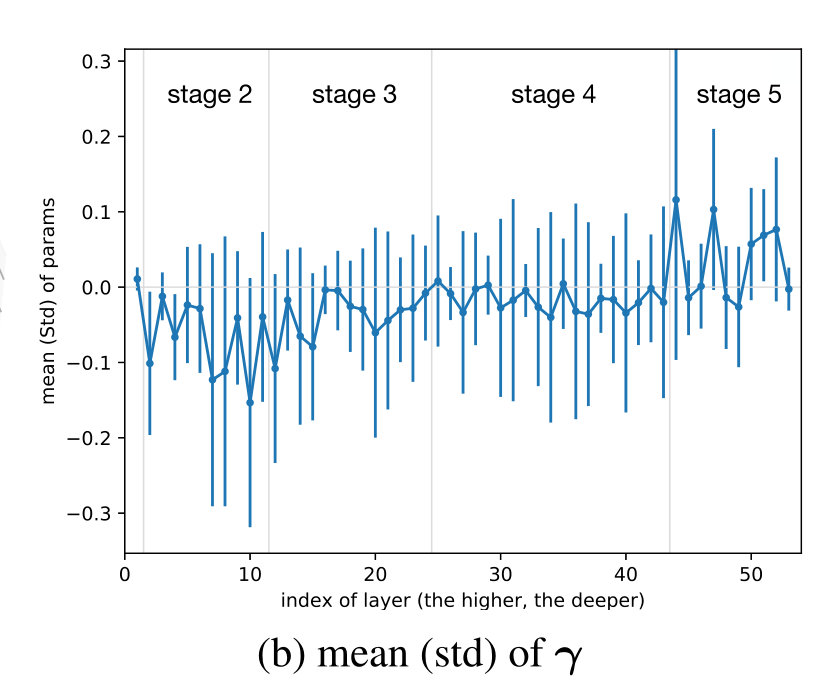

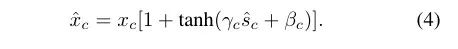

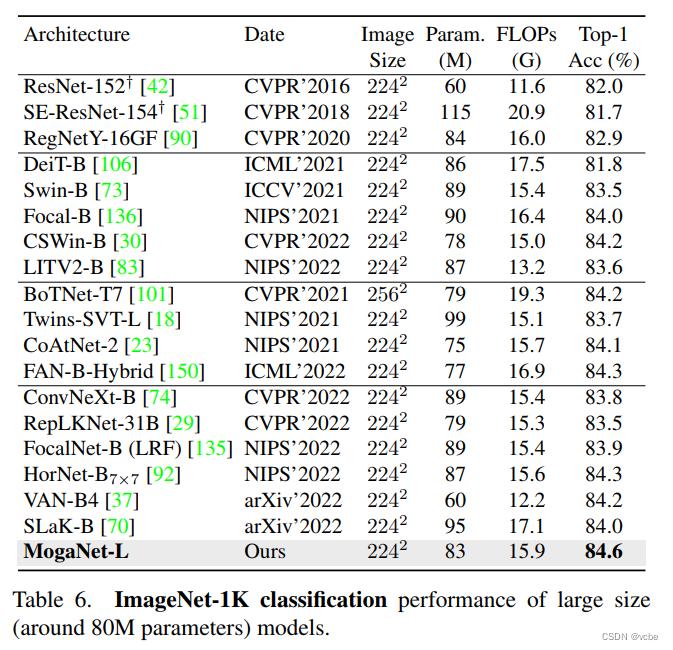

【Moga Net】Efficient Multi-order Gated Aggregation Network 阅读

Efficient Multi-order Gated Aggregation Network 目录 Efficient Multi-order Gated Aggregation Network导读 背景网络结构消融实验特征可视化实验结果官方代码库 导读 今天分享一篇发在arxiv上的backbone基础网络创新论文【MogaNet】,作者来自于西湖大学和浙江大学。Moga

[深度学习论文笔记]Robust Multimodal Brain Tumor Segmentation via Feature Disentanglement and Gated Fusion

Robust Multimodal Brain Tumor Segmentation via Feature Disentanglement and Gated Fusion 基于特征分离和门控融合的鲁棒多模式脑肿瘤分割 Published: Feb 2020 MICCAI 2019 论文:https://arxiv.org/pdf/2002.09708 摘要: 准确的医学图像分

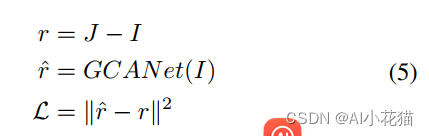

Gated Context Aggregation Network for Image Dehazing and Deraining(GCANet)

1 总体概述 GCANet是端到端去雾的一篇代表性的文章,它摒弃以往使用手工设计的先验以及大气散射模型的使用,直接通过原始有雾图像估计出无雾图像J与有雾图像I之间的残差,图像恢复阶段直接使用网络输出的残差与输入有雾图像I之间的加和完成去雾过程。 文章本身最大的贡献: 1、借鉴并使用了平滑空洞卷积消除以往空洞卷积存在的网格伪影以及特征相关性不强的问题,提出了一个门限子网络,用于依据不同level

【ARXIV2211】Efficient multi-order gated aggregation network

作者认为,交互复杂性是视觉识别一个重要特点。为此,作者通过复杂特征交互构建了一个纯卷积的网络 MogaNet 用于图像识别。MogaNet的整体框架如下图所示,架构和一般的 Transformer 网络非常类似,核心包括两个模块:spatial aggregation (取代注意力) 和 channel aggregation (取代FFN)。 (1)spatial aggregation

GCANet(Gated Context Aggregation Network for Image Dehazing and Deraining)图像去雾去雨

雾化处理可以由以下模型表示(corruption model): I ( x ) :有雾的图片 J ( x ) :去雾的图片 A : 全球大气光 t ( x ) :中间的转换映射,取决于未知的深度信息,介质透射图 以往的去雾方法是用回归方法加上人为设计的先验条件来估计A或t(x),但问题是现实中这两项很难得到。该论文中使用的方式是直接学习原图和雾图之间的残差。

![[论文笔记]Language Modeling with Gated Convolutional Networks](https://img-blog.csdnimg.cn/img_convert/af6bb99a6f4a50fe3ad92a011c9ff170.png)

![[深度学习论文笔记]Robust Multimodal Brain Tumor Segmentation via Feature Disentanglement and Gated Fusion](https://img-blog.csdnimg.cn/20210711212124573.png)