本文主要是介绍在ROS2中使用奥比中光(ORBBEC)的AstraPro深度相机,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

文章目录

- 0.效果演示及注意事项

- 0.1.效果演示

- 0.2.注意事项

- 1.下载SDK

- 2.拷贝至自定义目录

- 3.安装各种库

- 4.编译项目

- 5.启动相机节点

- 6.启动rviz2

- 6.1.显示深度图

- 6.2.显示彩色图

- 6.3.显示点云

- 6.4.显示着色后的点云

- 6.4.1.RGB与DEPTH没有对齐的原因分析

- 7.结语

0.效果演示及注意事项

0.1.效果演示

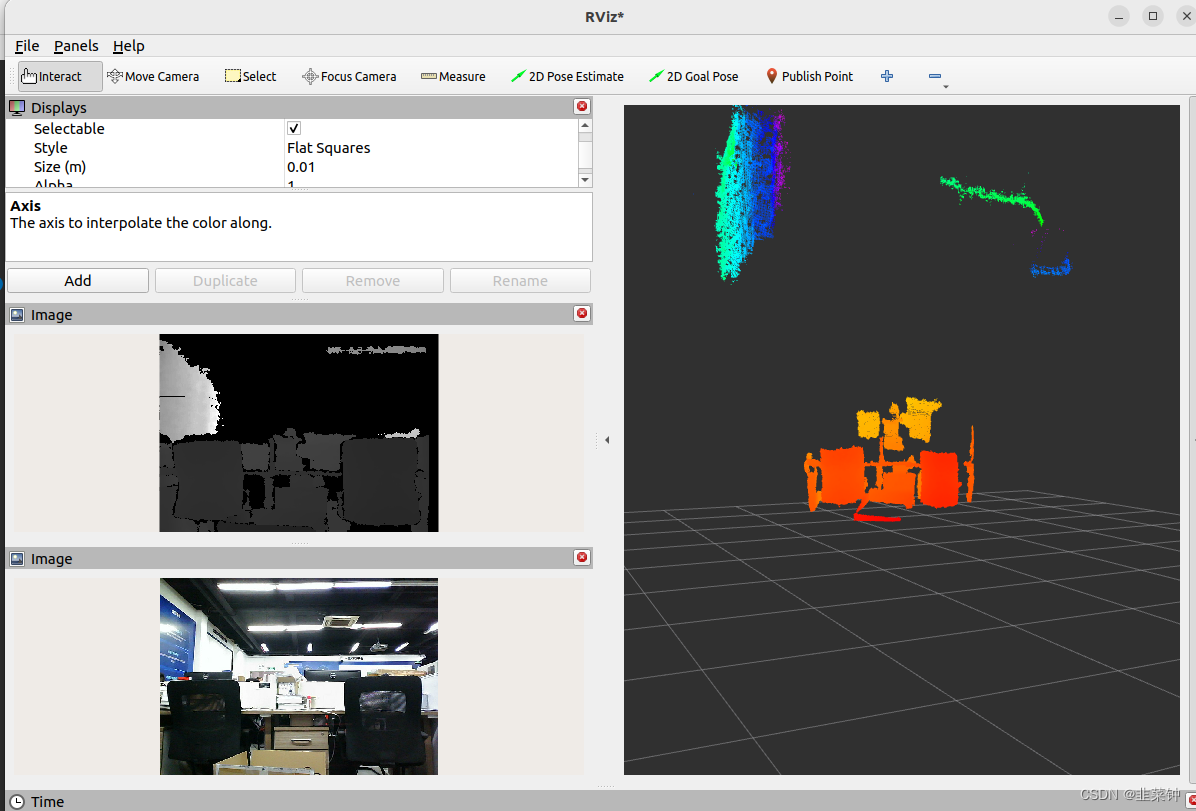

如下图所示,在rviz2中显示彩色图、深度图、点云。

0.2.注意事项

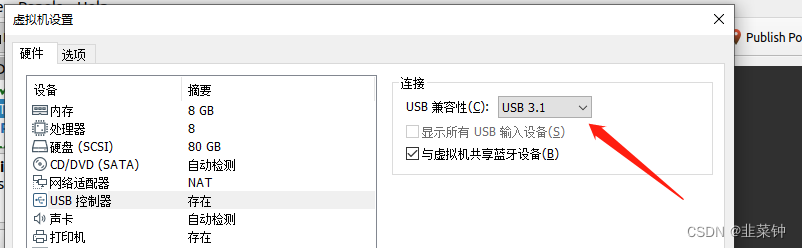

假如是在虚拟机操作,最好把虚拟机的usb兼容性设置成usb3.1

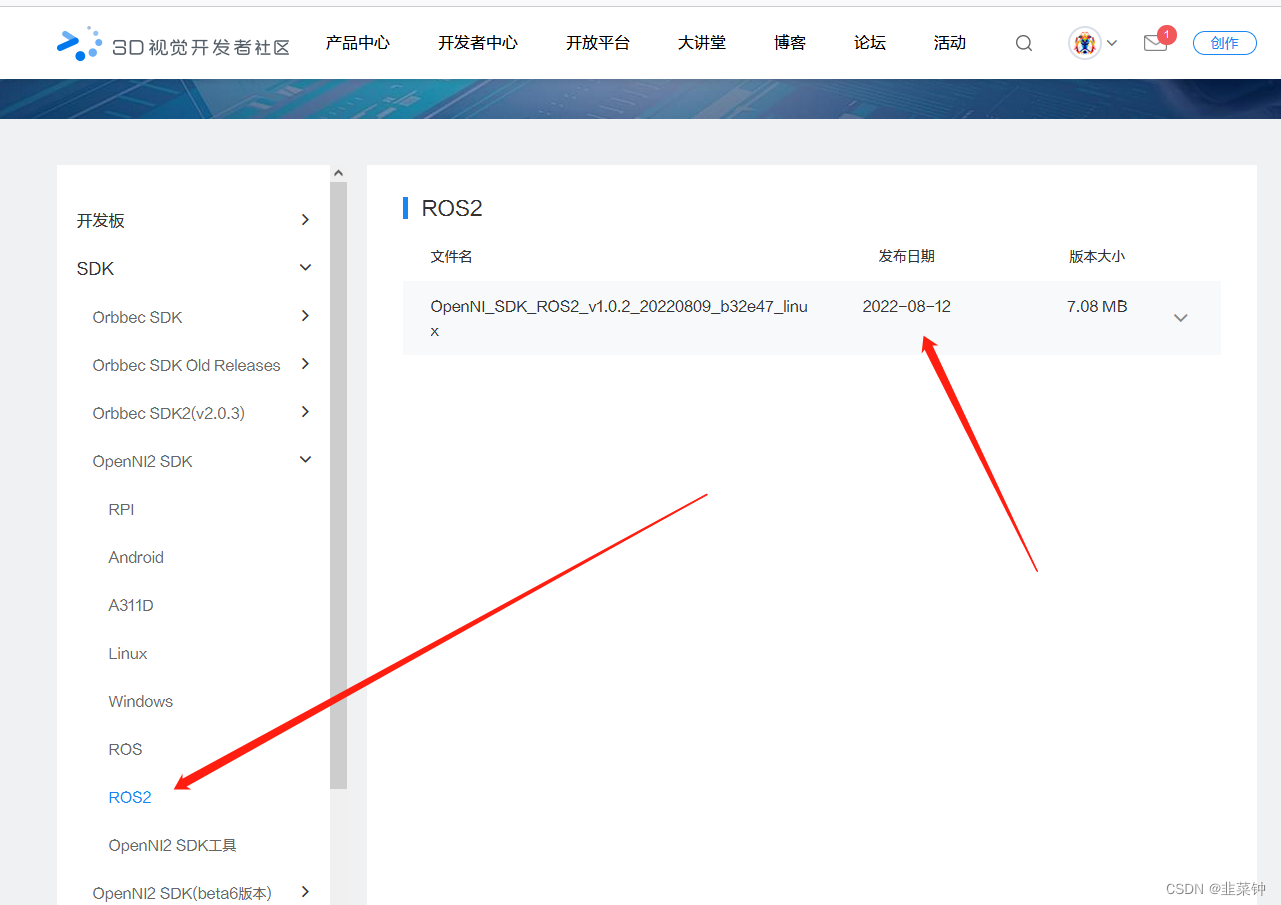

1.下载SDK

到官网下载OpenNI2_SDK

记得是下载这个OpenNI2_SDK,而不是下载那个Orbbec_SDK.

2.拷贝至自定义目录

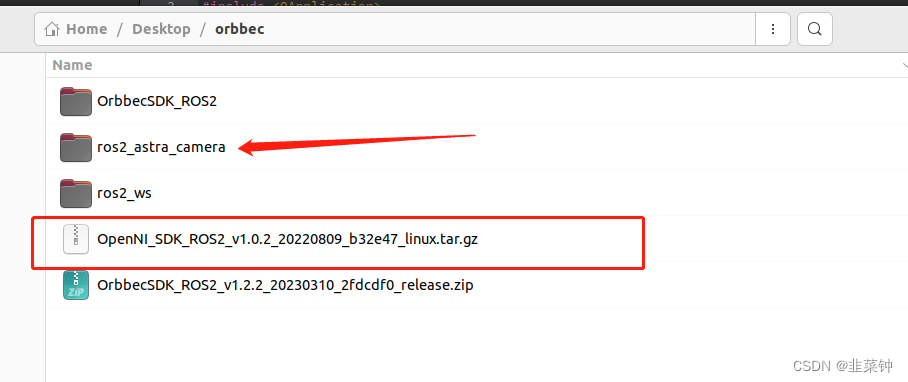

拷贝到你的ubuntu的一个文件夹中,并解压得到 ros2_astra_camera 文件夹

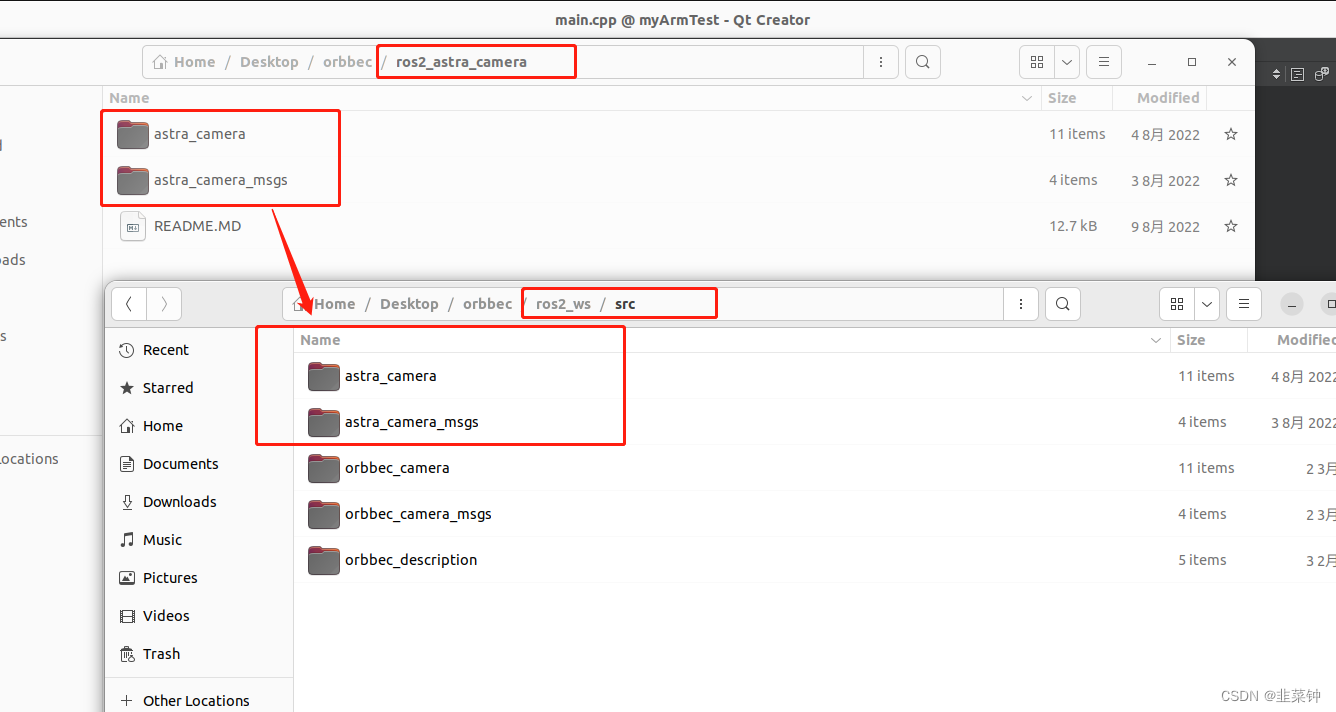

然后新建一个ros2_ws文件夹,再在ros2_ws文件夹中新建src文件夹,然后复制 ros2_astra_camera文件夹里面的astra_camera、astra_camera_msg两个文件夹到src里面

3.安装各种库

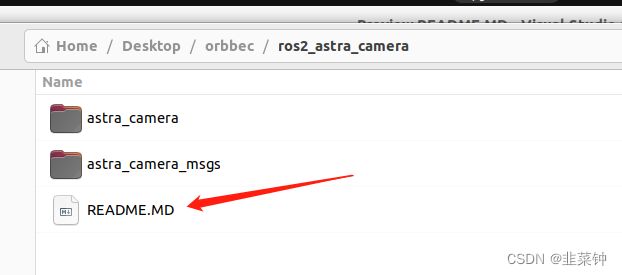

然后根据 ros2_astra_camera里面的README.MD,来安装好各种库:

● Install dependencies

● Install glog

● Install magic_enum

● Install libuvc

在安装过程中,假如git clone或者wget 失败。可以自己搭梯子下载好源码然后再放到一个文件夹中再编译安装

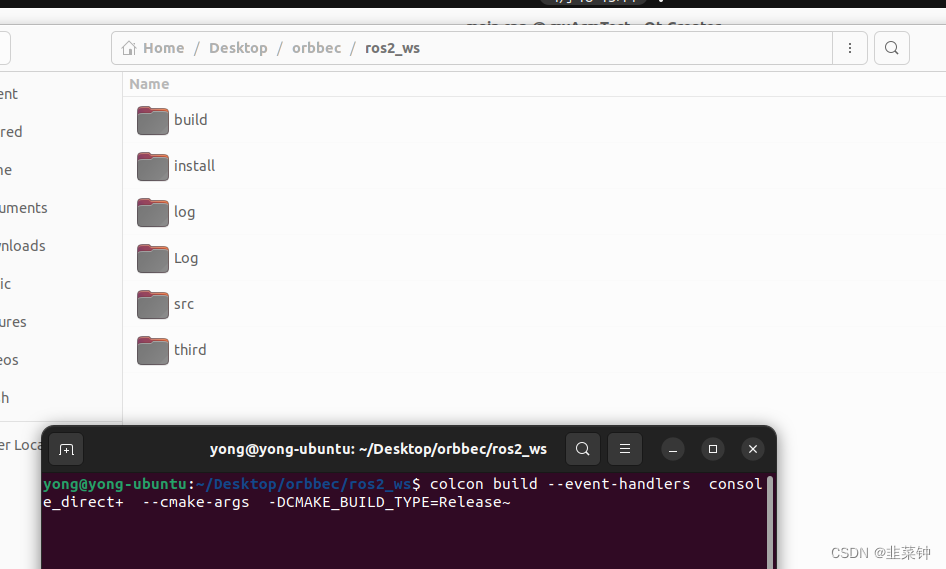

4.编译项目

安装好上面的库之后,在orbbec中打开终端,并执行以下命令:

cd ros2_ws/src/astra_camera/scripts

sudo bash install.sh

sudo udevadm control --reload-rules && sudo udevadm trigger

cd ../../../

colcon build --event-handlers console_direct+ --cmake-args -DCMAKE_BUILD_TYPE=Release

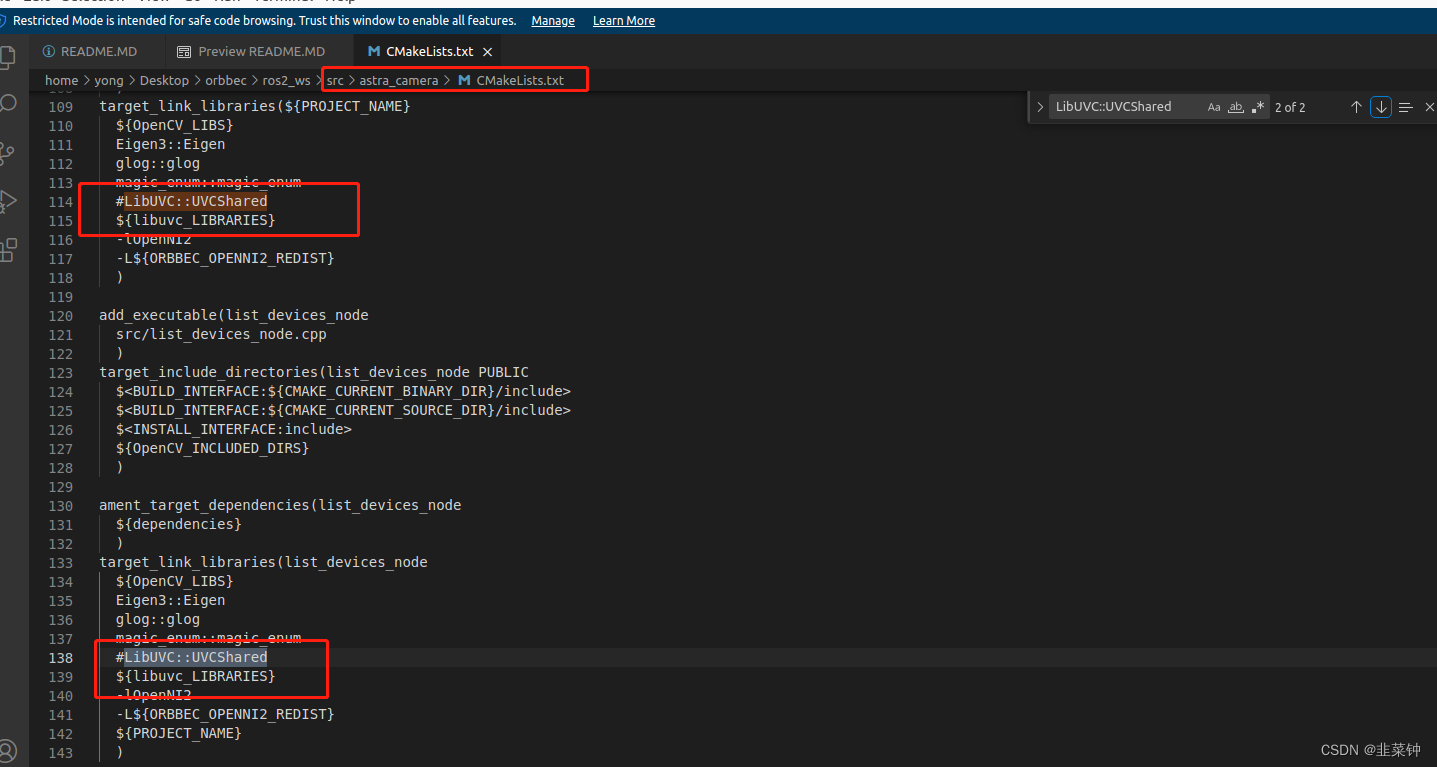

在编译过程中,可能会出现 LibUVC::UVCShared 的问题。

参考这里修正

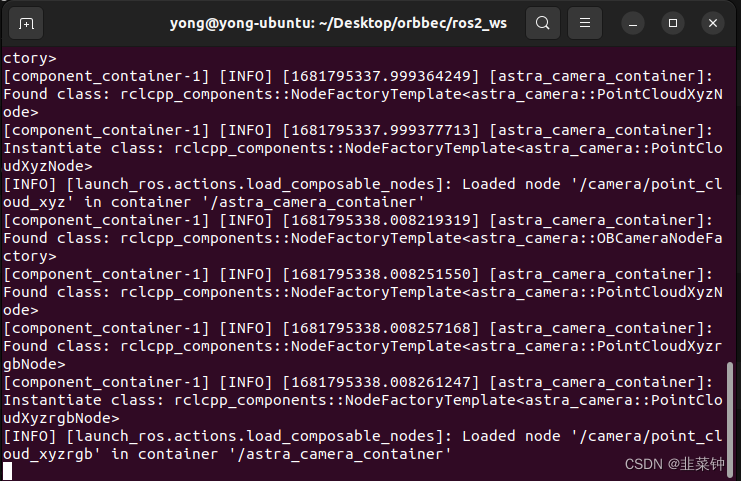

5.启动相机节点

执行以下命令,启动相机节点

source install/setup.bash

ros2 launch astra_camera astra_mini.launch.py

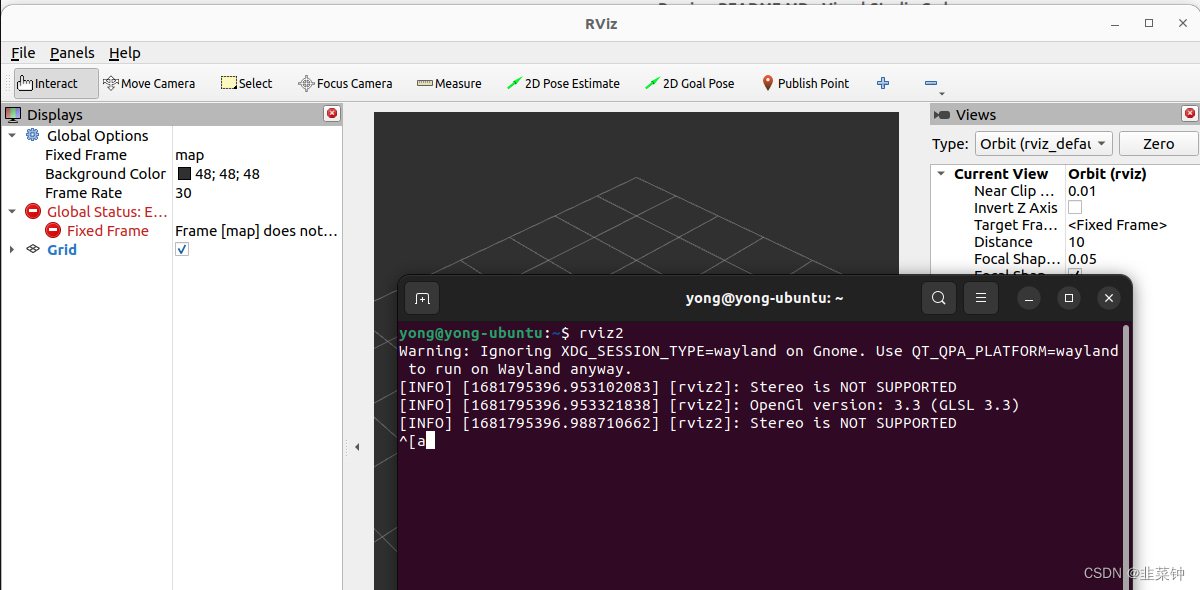

6.启动rviz2

在一个新的控制台中启动rviz2

rviz2

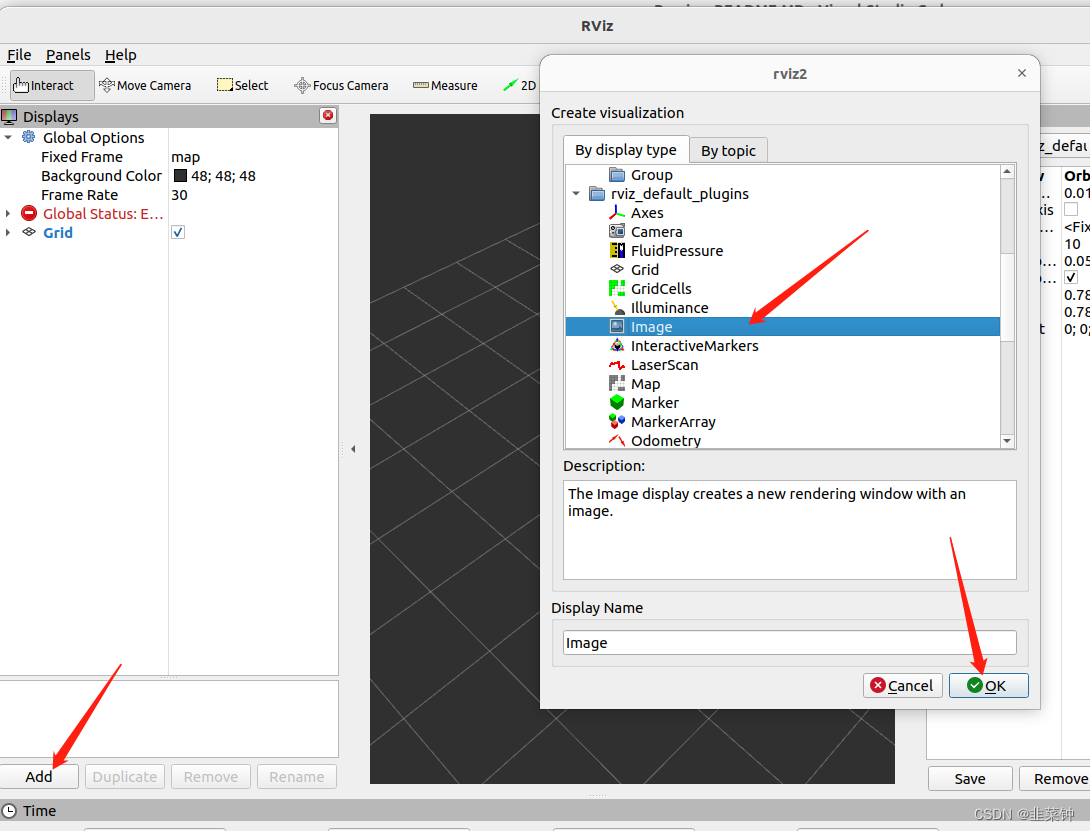

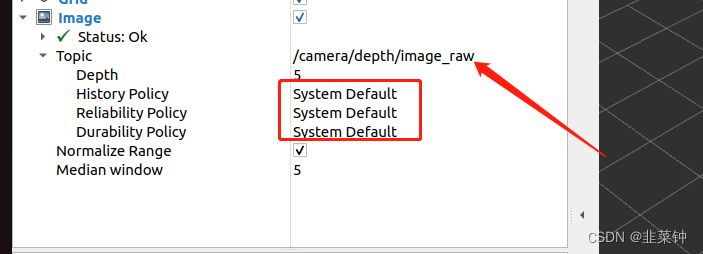

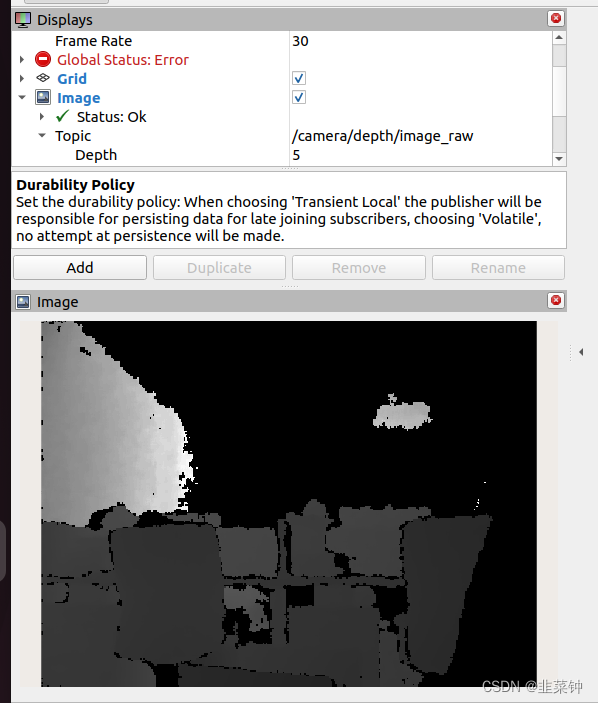

6.1.显示深度图

添加一个图像控件

选择好话题,并设置好qos的参数。

选择好话题,并设置好qos的参数。

然后就可以看到深度图了

按照默认配置,选择红外图(/camera/ir/image_raw)也是可以的,但是彩色图就不行,不知道为啥。假如想要显示彩色图,请按以下操作进行设置。

6.2.显示彩色图

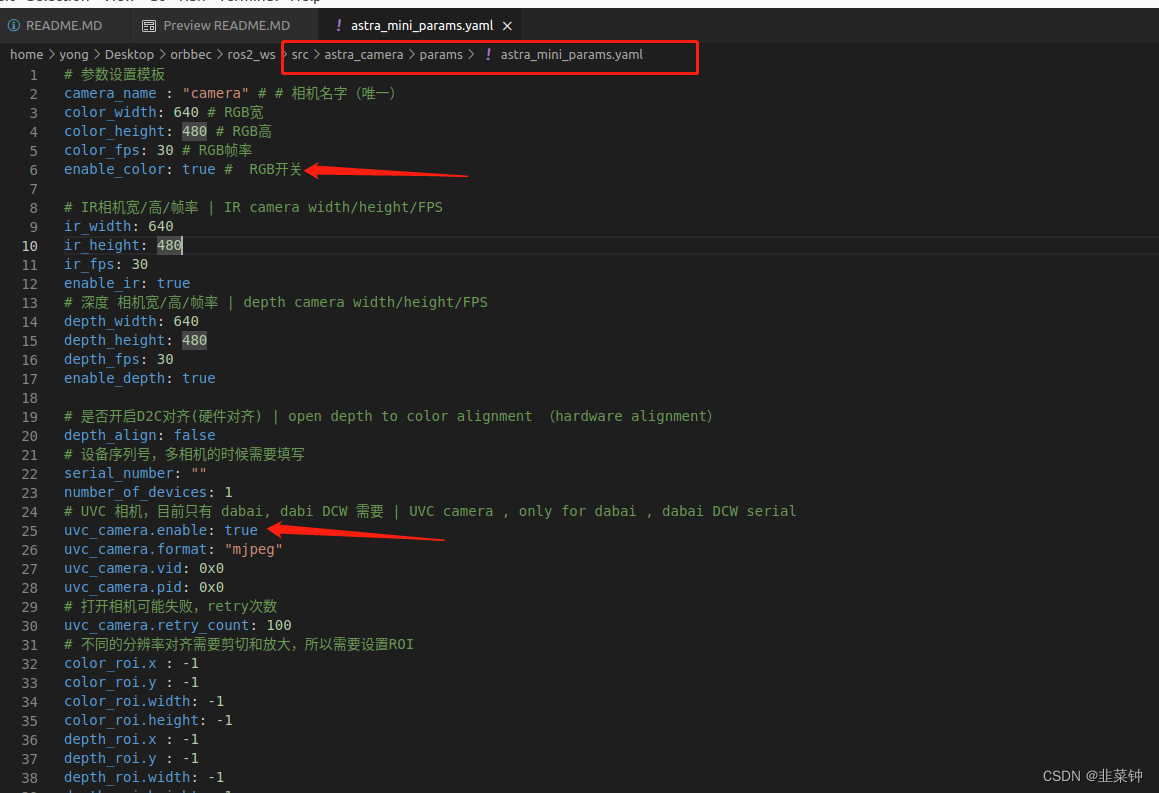

要显示彩色图要修改以下源码的两个地方

修改orbbec/ros2_ws/src/astra_camera/params下面的astra_mini_params.yaml文件

将enable_color、uvc_camera.enable由原来的false改为true(这两个记得要相互对应,true一起true,false一起false,否则相机无法启动)。

然后把刚才启动的相机关掉,接着编译、安装、启动。

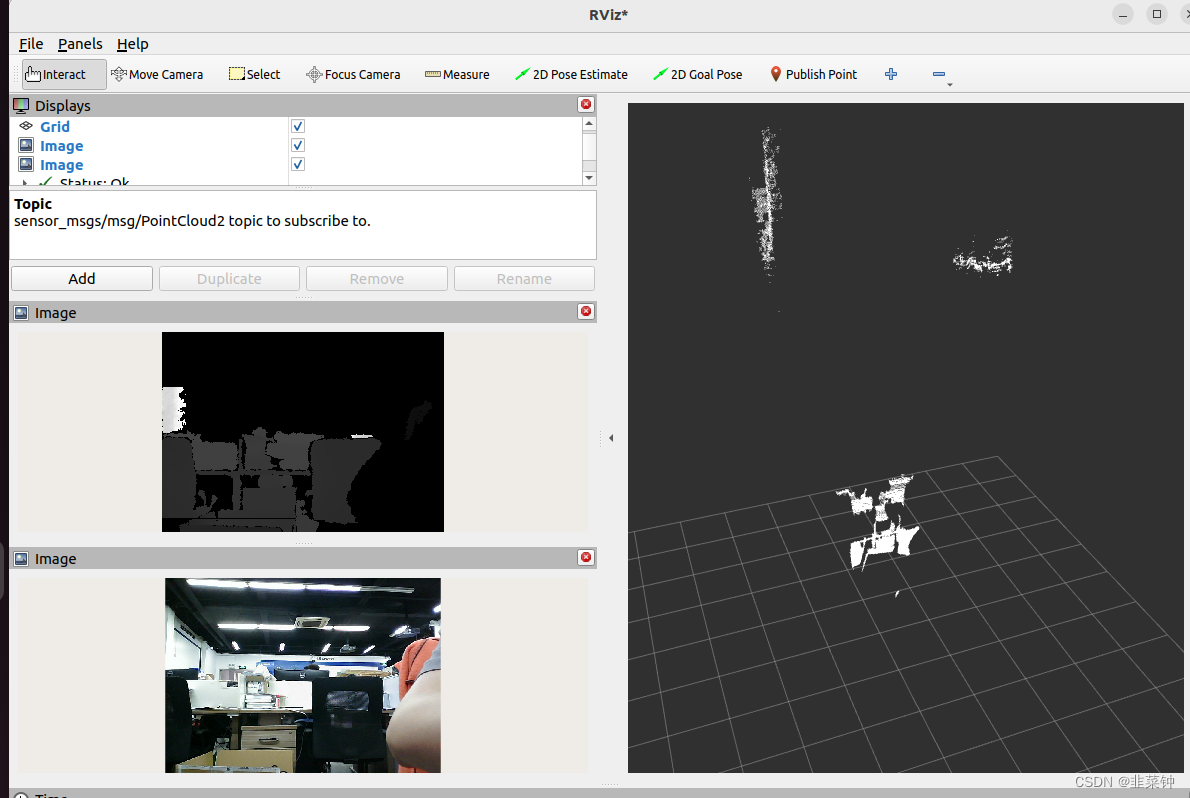

最后,就可以在rviz里面看到了彩色图、深度图、点云

但是要注意的是,一旦enable_color之后,红外ir就没图像了。可能彩色图和红外图只能二选一。

假如想要点云、彩色图、红外图都用上,可以让该sdk提供点云、红外图,然后借助ros-humble-usb-cam来提供彩色图。 (这个办法会导致点云、红外图暂停),或者使用第三方的sdk我在淘宝购买相机的商家提供的sdk。

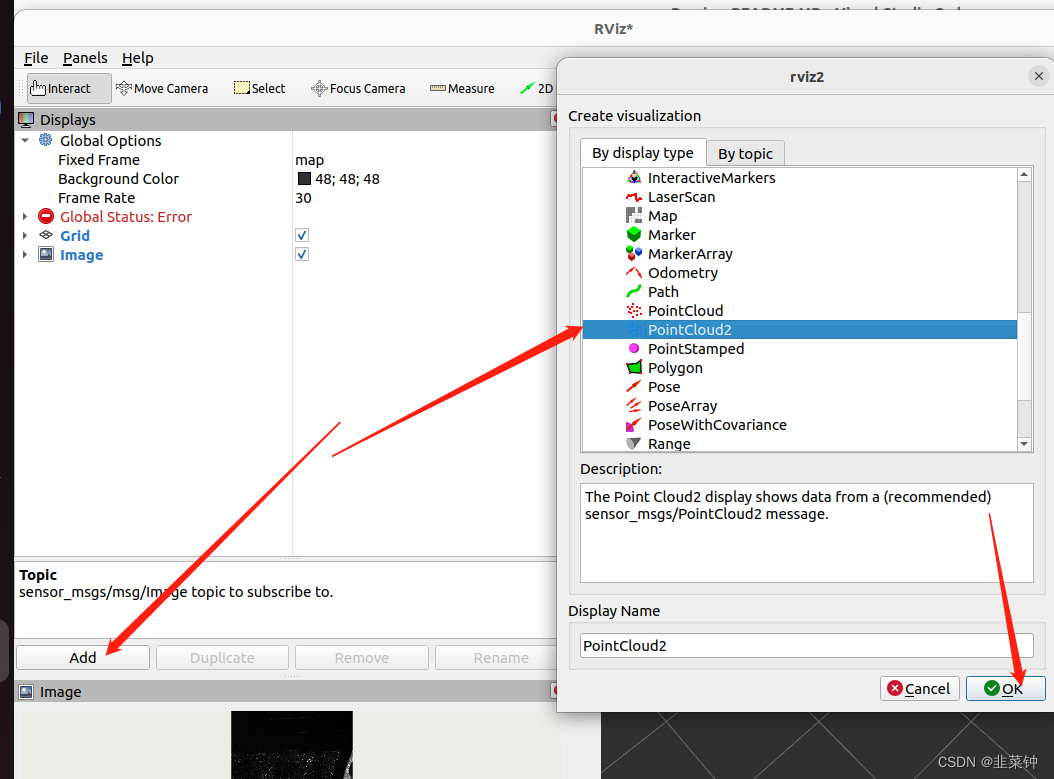

6.3.显示点云

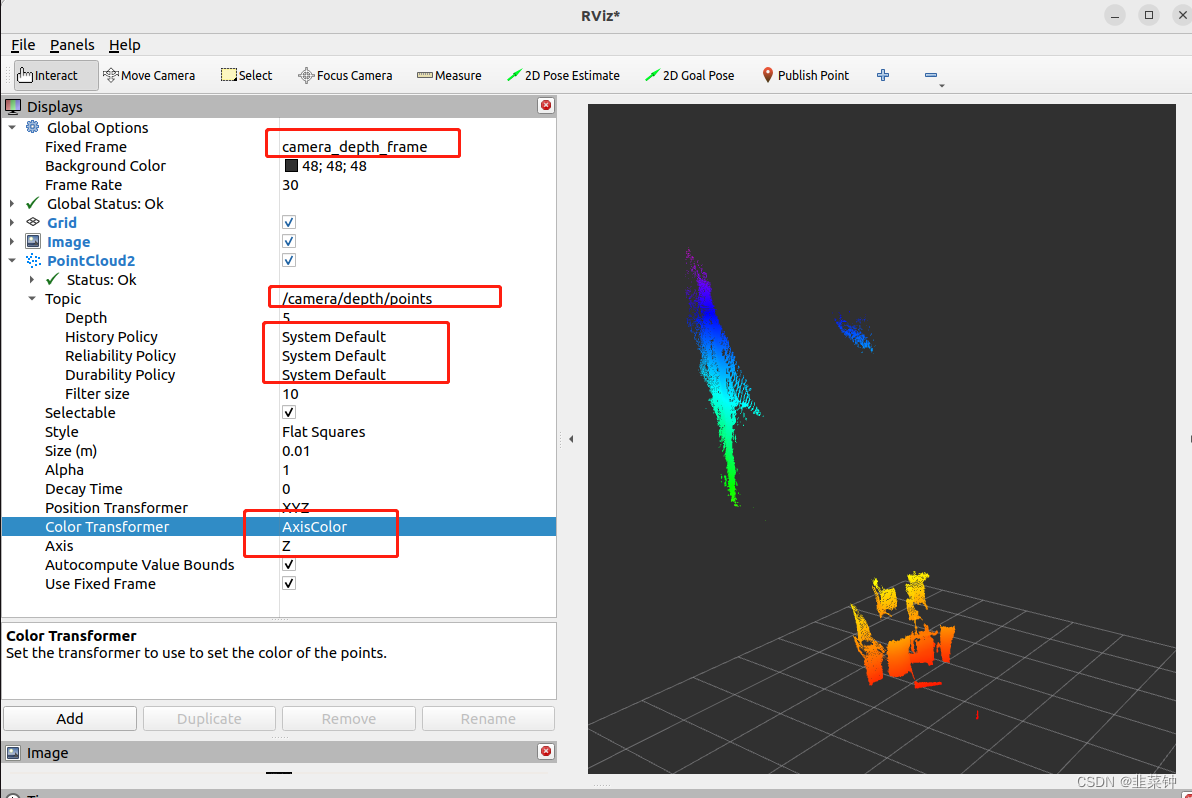

再看看点云

同样也要设置好各个参数

同样也要设置好各个参数

6.4.显示着色后的点云

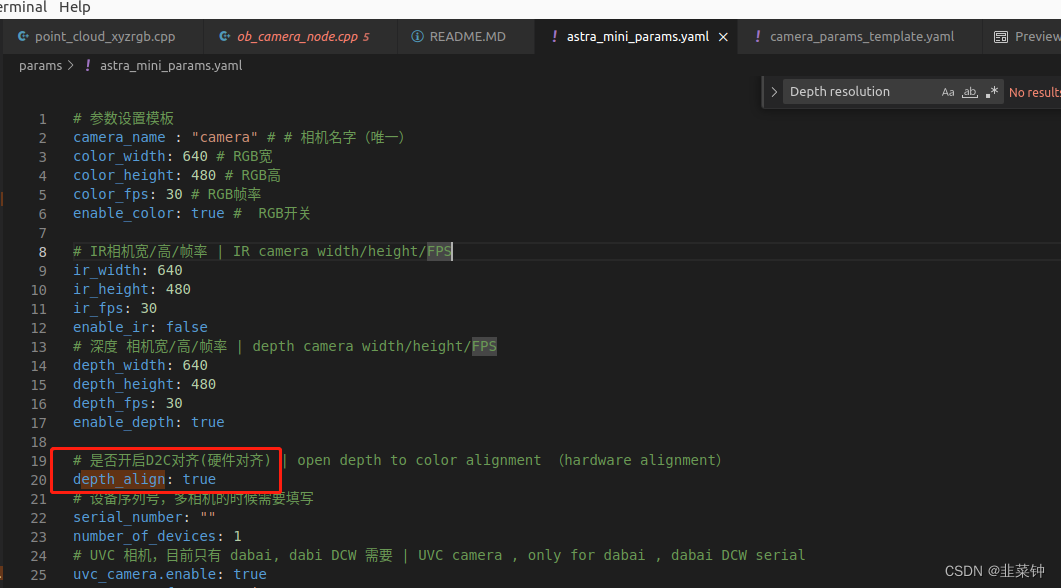

要显示着色的点云,首先要按照【6.2显示彩色图】的方法成功显示彩色图后再进行。

默认情况下,是显示不了着色的点云的,需要修改一下源码(同时,经过测试,发现这样子做的彩色图与实际点云没有对齐)

修改orbbec/ros2_ws/src/astra_camera/params/astra_mini_params.yaml

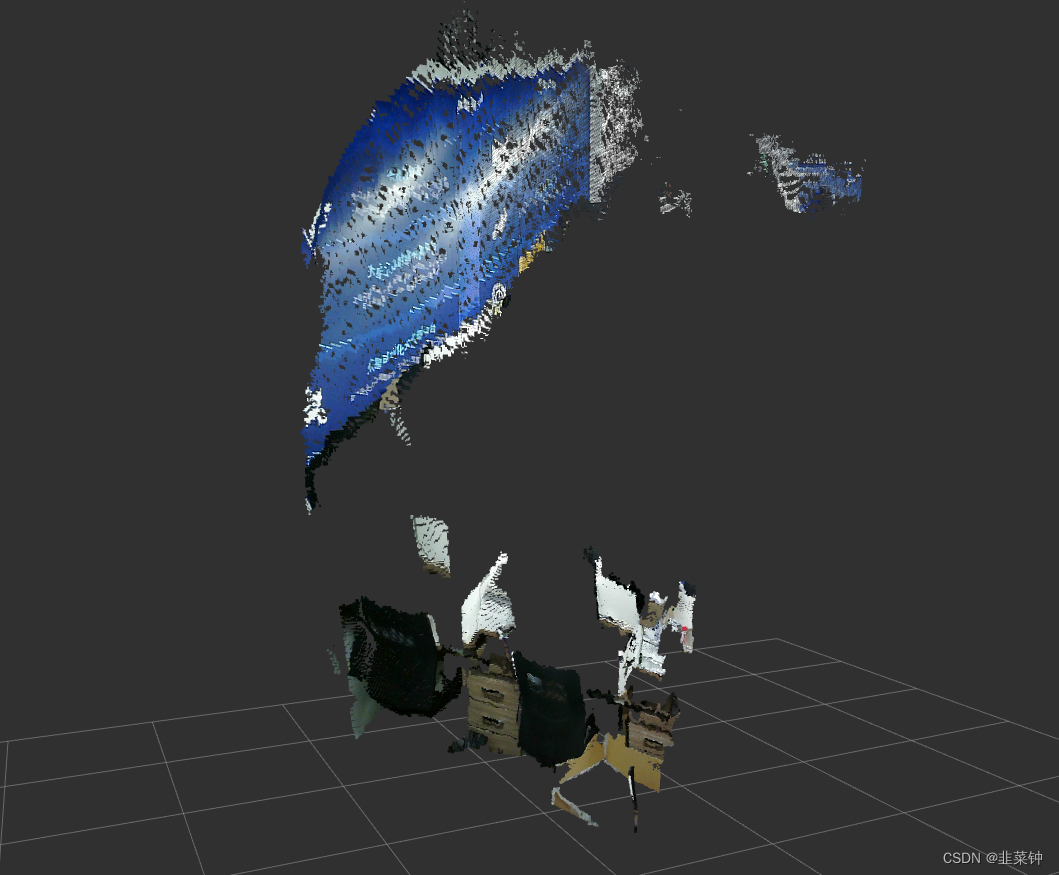

然后重新编译、打开相机,就可以在rviz2中看到着色的点云了。

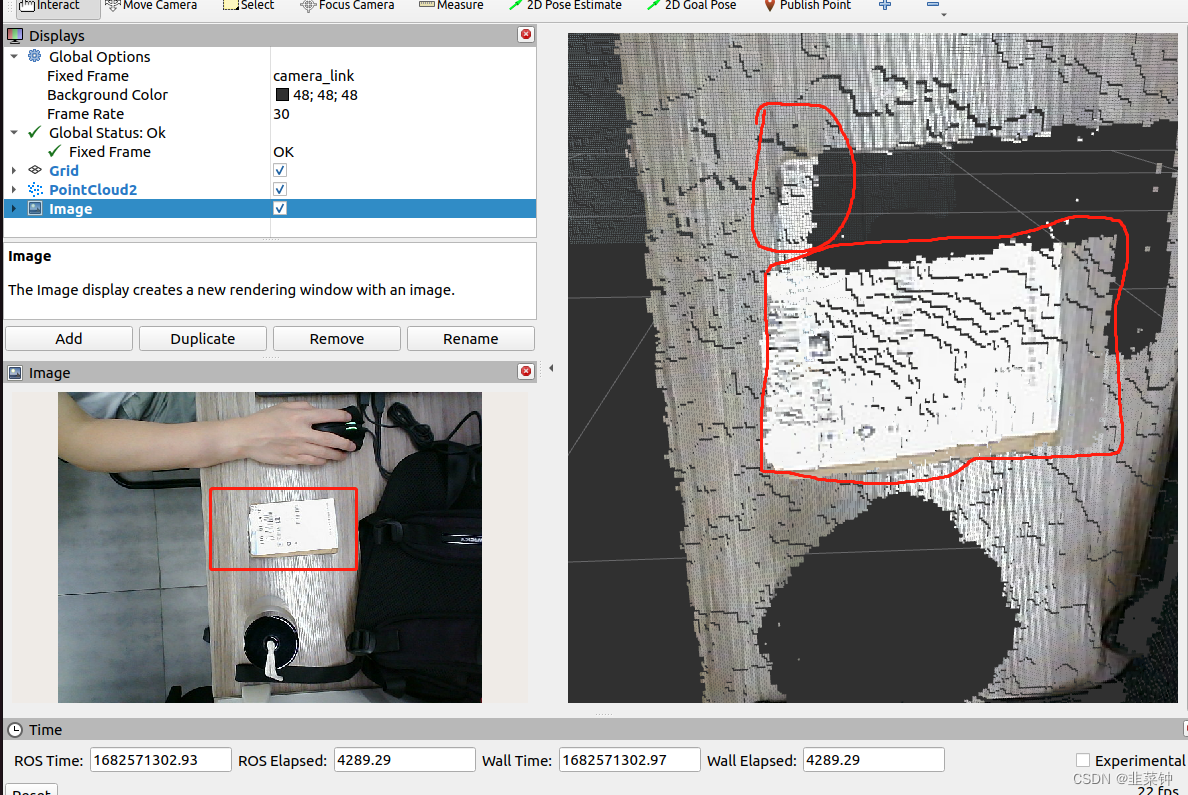

但是点云与颜色没有对齐,可以看到,代表快递盒子的点云与快递盒子的颜色没有对齐,颜色往x方向偏移了一段距离。

6.4.1.RGB与DEPTH没有对齐的原因分析

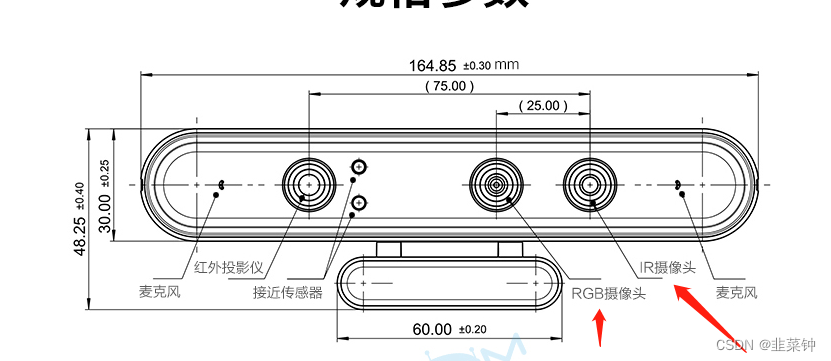

没有对齐的原因,简单说就是:获取RGB、depth信息的,不是同一个镜头。

【奥比中光Astra深度传感器工作原理】

【RGBD相机实用问题】

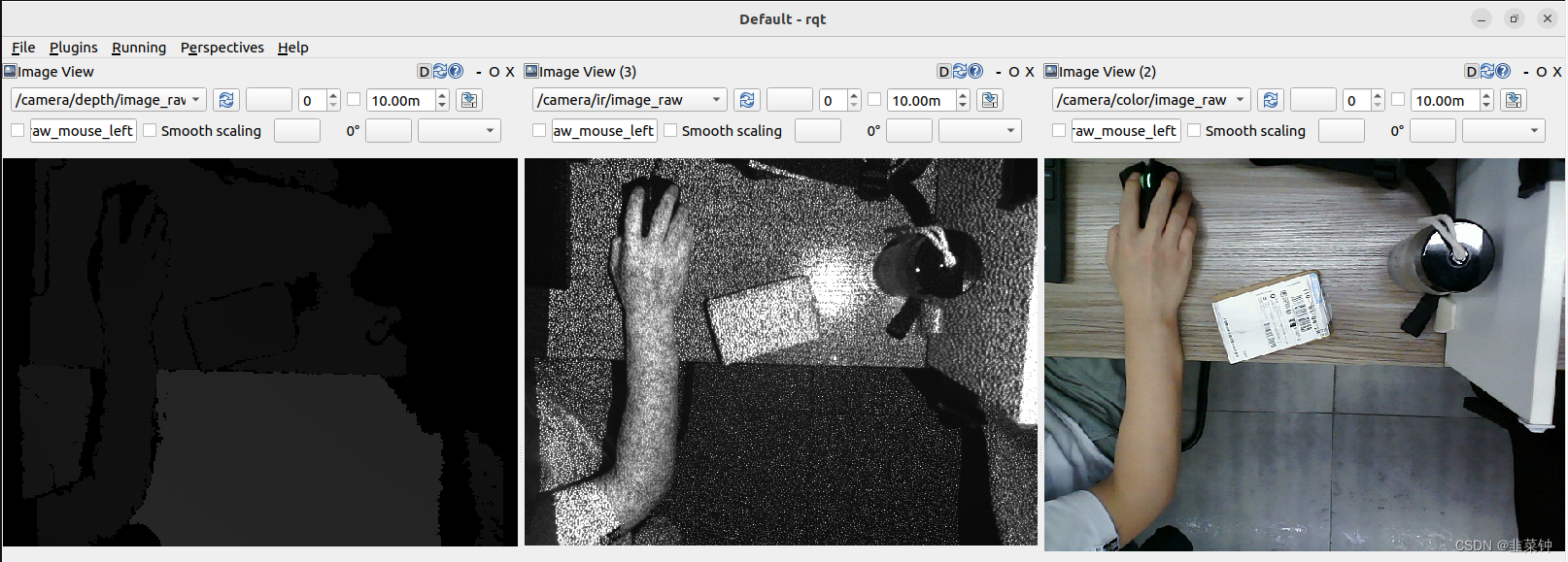

可以看一下下面这张图(这次可以显示三种图的原因是我使用了我在淘宝购买相机的商家提供的sdk,而不是前面orbbec提供的sdk):

上面从左往右分别是:深度图、红外(ir)图、彩色图。其中深度图和红外图用的是同一个IR摄像头、彩色图用的是RGB摄像头(如下图所示),可以明显看到,红外图像和RGB图像明显没对齐(看我右手握住的鼠标顶部与图像顶部的边沿距离)。

而点云是深度图+相机参数计算得到的,自然和RGB对不齐了。

假如非要对齐,有办法吗?

有。

假如要求不高的,只要手动在IR图像和RGB图像手动选择几个对应点,用opencv的getAffineTransform或者estimateAffine2D(实测这个更好)计算一下变换矩阵,将rgb投影到IR图像的坐标空间,再自己搞个PointCloud2的话题发布出去就OK了。

要求高的,需要分别对RGB相机、IR相机进行标定、配准,可以看看这里【ORBBEC(奥比中光)AstraPro相机在ROS2下的标定与D2C(配准与对齐)】

7.结语

既然可以得到深度图或者点云了,接下来就可以按照【ROS2中将octomap发布到Moveit中作为碰撞物体】中提到的办法,将他们转成octomap导入moveit进行路径规划了。完美(其实还有个手眼标定的问题…)。

这篇关于在ROS2中使用奥比中光(ORBBEC)的AstraPro深度相机的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!