浅层专题

从最浅层剖析C语言————第四节(深入了解二维数组存储以及实现二分查找)

目录 1. 前情提要 2. sizeof计算数组元素个数 3. 二维数组的创建及其初始化 3.1 二维数组的概念 3.2 二维数组的创建 3.3 二维数组的初始化 4. 二维数组的使用 4.1 二维数组的下标 4.2 二维数组在内存之中的存储 4.3 C99中的变长数组 1. 前情提要 前面一篇博客中,我们深入了解了一维数组的各种方面的知识 这一节博客中,我们

GNN-静态表征-随机游走-2014:DeepWalk【步骤:①随机游走策略生成每个节点的训练序列(DFS),得到训练数据集;②套用Word2vec算法得到节点表示】【捕获二阶相似度】【浅层、同质图】

一、概述 1、 2、DeepWalk、LINE、Node2vec对比 提出的顺序DeepWalk 2014, UNE 2015, Node2Vec 2016 Node2Vec设置 p = q = 1 p=q =1

深度学习基础-- 浅层神经网络

第三章 浅层神经网络 第二章我们学习了使用一维线性回归的监督学习方法,但这种模型只能表示出输入与输出之间简单的线性关系。在这一章里,我们将接触到浅层神经网络。这种网络可以表达分段线性函数,并且能力强大到足以近似任何复杂度的多维输入和输出之间的关系。 3.1 神经网络示例 浅层神经网络是带有参数 ϕ \phi ϕ 的函数 y = f [ x , ϕ ] y = f[x, \phi] y=f

从最浅层剖析C语言——第四节(超详细讲解一维数组内容)

目录 1. 数组的概念 2. 一维数组的创建及其初始化 2.1 数组的创建 2.2 数组的初始化 考点总结:当我们未对数组进行初始化时,数组里面的元素打印出来是乱码,但哪怕只对数组里面一个元素赋值,之后未被赋值的元素也会默认赋值为0 3. 一维数组的使用 3.1 下标引用操作符 3.2 数组的输入 4. 一维数组在内存中的存储 1. 数组的概念 数组是一组相同类型元素

文本分类大综述:从浅层到深度学习

http://link.zhihu.com/?target=https%3A//arxiv.org/pdf/2008.00364.pdf 01 摘要 文本分类是自然语言处理中最基本、最基本的任务。过去十年,由于深度学习取得了前所未有的成功,这一领域的研究激增。大量的方法、数据集和评价指标已经在文献中提出,提高了全面和更新综述的需要。本文通过回顾1961年到2020年的先进方法的现状来填补这一

《深度学习Ng》课程学习笔记01week3——浅层神经网络

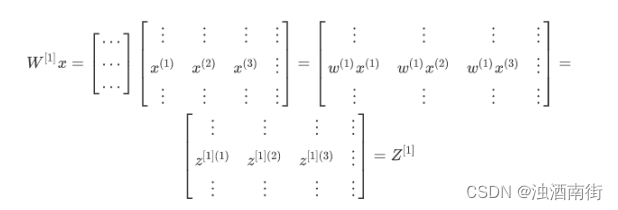

http://blog.csdn.net/u011239443/article/details/77884830 3.1 神经网络概览 3.2 神经网络表示 3.3 计算神经网络的输出 对应的正向传播公式: 3.4 多个例子中的向量化 3.5 向量化实现的解释 3.6 激活函数 更多可以参阅《神经网络-激活函数对比》 3.7 为什么需要非线性激

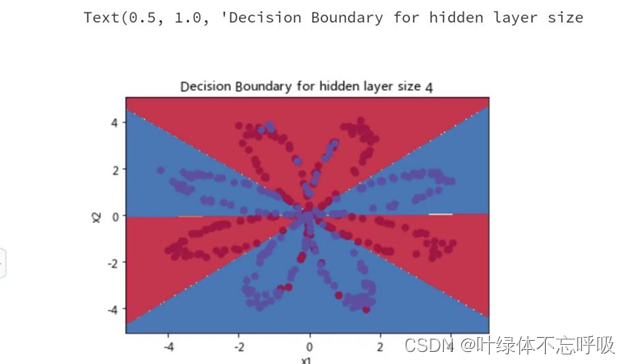

deeplearning.ai 吴恩达网上课程学习(六)——浅层神经网络分类代码实战

本文将学习如何利用Python的来实现具有一个隐藏层的平面数据分类问题。 本文的实践平台是Linux,Python3.4,基础库anaconda和spyder, 参考文章的实现平台是jupyter notebook:具有一个隐藏层的平面数据分类代码实战 理论知识学习请参看上篇deeplearning.ai 吴恩达网上课程学习(五)——浅层神经网络理论学习 目的:将创建的“花状”数据集分类

【深度学习】第一门课 神经网络和深度学习 Week 3 浅层神经网络

🚀Write In Front🚀 📝个人主页:令夏二十三 🎁欢迎各位→点赞👍 + 收藏⭐️ + 留言📝 📣系列专栏:深度学习 💬总结:希望你看完之后,能对你有所帮助,不足请指正!共同学习交流 🖊 文章目录 3.1 神经网络概述 3.2 神经网络的表示 3.3 计算一个神经网络的输出 3.3.1 神经网络的符号惯例 3.3.2 神经网络的计算 3.4 多样本向量

【机器学习300问】69、为什么深层神经网络比浅层要好用?

要回答这个问题,首先得知道神经网络都在计算些什么东西?之前我在迁移学习的文章中稍有提到,跳转链接在下面: 为什么其他任务预训练的模型参数,可以在我这个任务上起作用?http://t.csdnimg.cn/FVAV8 本文我不光从机器视觉,还举例自然语言处理和语音识别来更为全面的解答这个问题。当你知晓了神经网络在学什么东西后,你就会明白为什么深层的往往比浅层的好用,但

解析《明日方舟》在社区中遭其他产品用户排挤的深浅层原因及如何破局

概述:《明日方舟》自2019年5月1日开启全平台公测,在获得口碑及2019年二次元类游戏营收第二的成绩的同时,二次元类游戏社区出现了其他游戏用户厌恶并抵制《明日方舟》的现象。 数数将从事件对比、用户对比以及产品对比,3个方向对该现象进行分析,并尝试总结原因,给出解决方法。 一、 现象概述 二次元同类游戏及《明日方舟》自身的社区、论坛、信息内容里,开始出现对《明日方舟》及其玩家的抵制,从b站游

吴恩达深度学习笔记:浅层神经网络(Shallow neural networks)3.1-3.5

目录 第一门课:神经网络和深度学习 (Neural Networks and Deep Learning)第三周:浅层神经网络(Shallow neural networks)3.1 神经网络概述(Neural Network Overview)3.2 神经网络的表示(Neural Network Representation)3.3 计算一个神经网络的输出(Computing a Neur

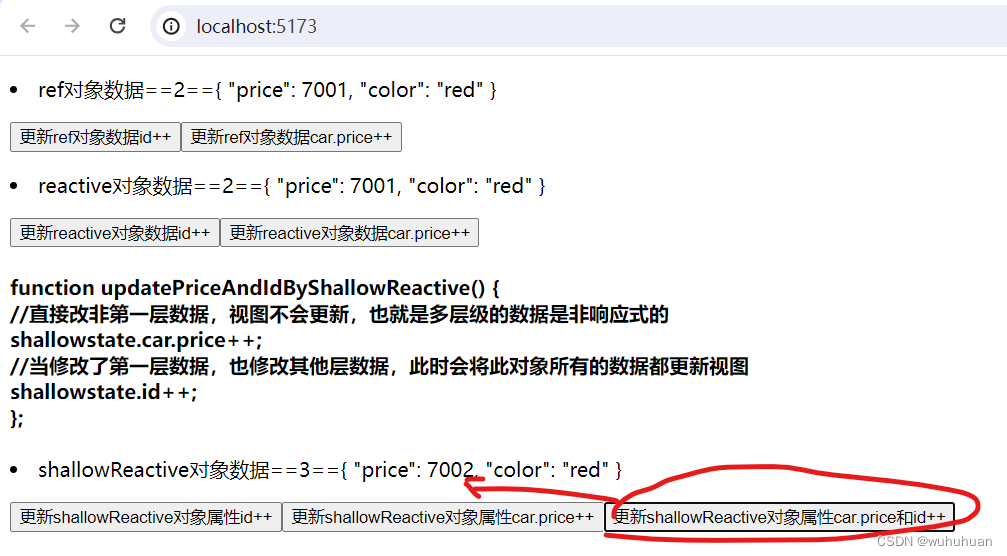

shallowReactive浅层式响应对象

一、 reactive 和ref 都是深层响应式对象: 就是不管对象有多少层,修改此对象任一属性都会响应式处理 shallowReactive 和shallowRef 浅层响应式对象: 只会修改第一层对象,修改此对象第一层属性,视图会有同步变化,非第一层,数值会变,视图不会变。 例如有这样一个对象 {id:1,name:'张三',car:{price: 7000,color: 're

使用浅层神经网络进行模式识别

目录 定义问题 使用神经网络模式识别进行模式识别 使用命令行函数进行模式识别 选择数据 选择训练算法 创建网络 划分数据 训练网络 测试网络 查看网络 分析结果 后续步骤 除了函数拟合,神经网络也擅长识别模式。 例如,假设要根据细胞大小、肿块厚度、有丝分裂等特征的均匀性将肿瘤分为良性或恶性。有699个样本,相关特征有9项,并且这些案例

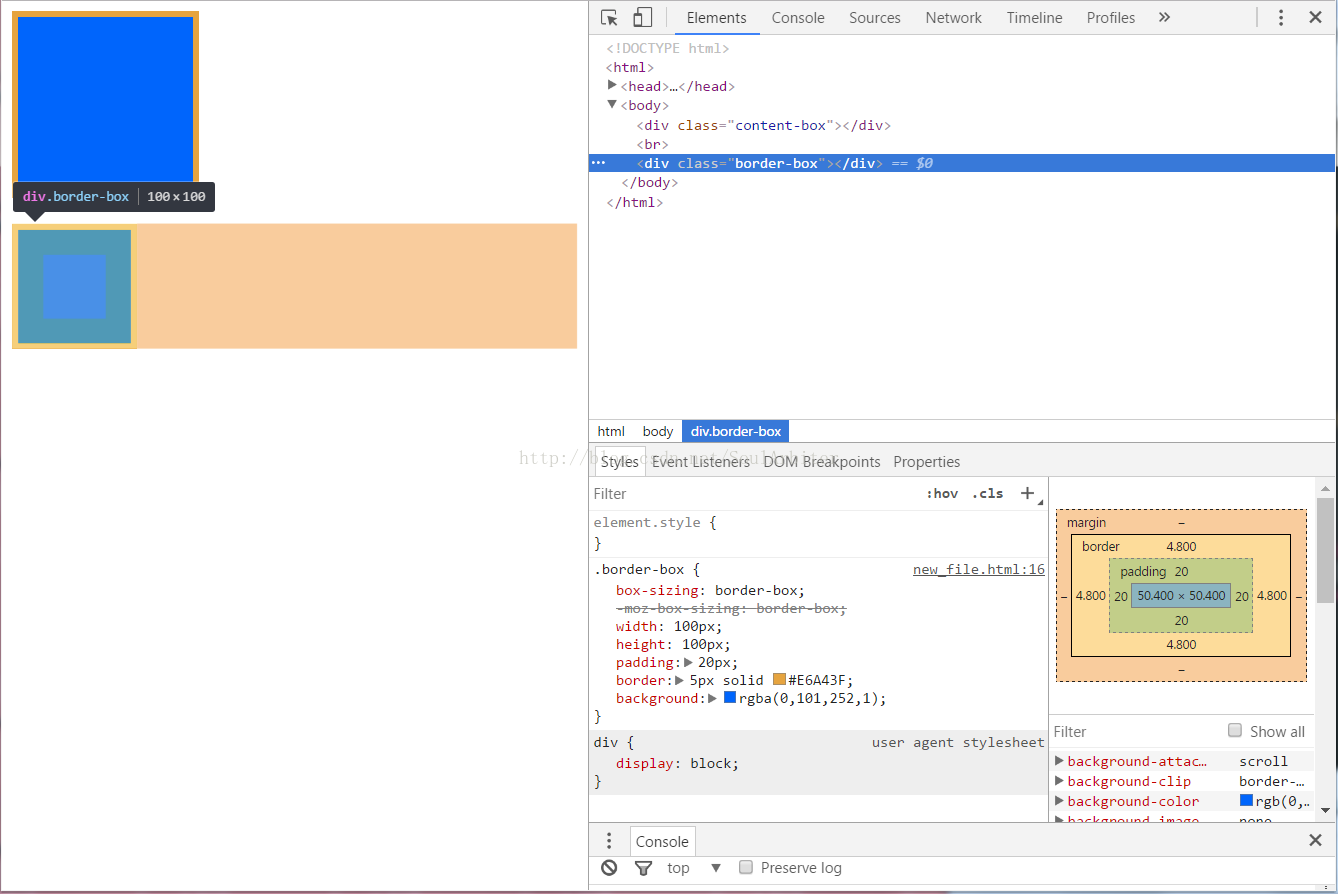

HTML+CSS基础之浅层理解box-sizing:content-box | border-box | inherit

在css2.中我们设置一个盒模型后,该盒子总占有宽高是为我们设定的内容宽高+内边距(width+padding) 这有时会在实际开发时 由于计算的疏忽给我们带来一些不便 于是 css3的时候 引入了一种新的规范 box-sizing ------------------------------分割线------------------------------ box-sizing有

深度学习课程实验一浅层神经网络的搭建

一、 实验目的 1、学习如何建立逻辑回归分类器用来识别猫。将引导你逐步了解神经网络的思维方式,同时磨练我们对深度学习的直觉。(说明):除非指令中明确要求使用,否则请勿在代码中使用循环(for / while)。 2、理解神经网络的基础:通过实现一个简单的神经网络模型(即使它只有一个隐藏层),可以更好地理解神经网络的工作原理,包括前向传播和反向传播过程,以及如何通过调整权重和偏置来优化模型。 3、

【神经网络基础】第二课--浅层神经网络

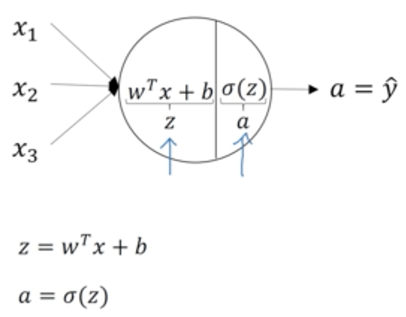

课程来源:吴恩达 深度学习课程 《神经网络基础》 笔记整理:王小草 时间:2018年5月15日 1.神经网络概览 回顾逻辑回归的结构: 圆圈节点内的计算如下,先计算线性z,再过一个sigmoid函数得到a,然后计算损失函数,进行梯度下降法求最优参数。 推广到神经网络,每个圆圈节点都代表以上z,a两步计算(第一层用1表示,第而层用2表示) 相当于如下计算过程: 同

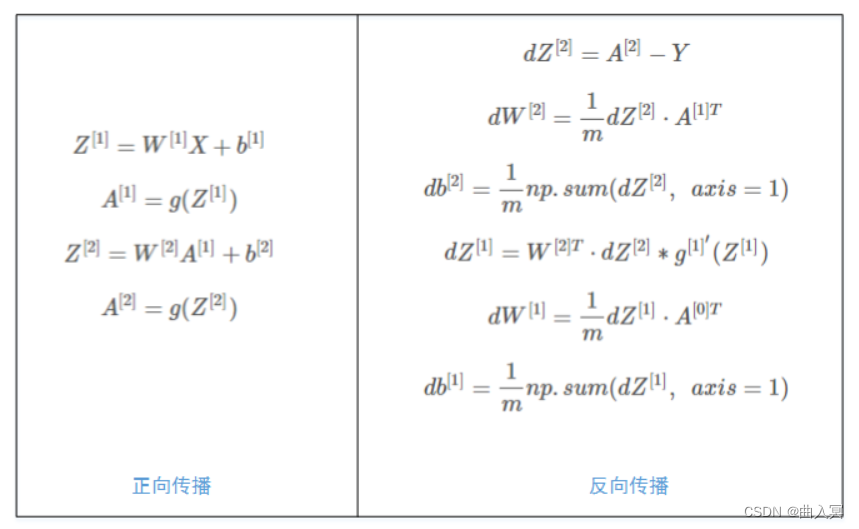

深度学习——第6章 浅层神经网络(NN)

第6章 浅层神经网络(NN) 目录 6.1 神经网络模型概述 6.2 神经网络正向传播 6.3 神经网络反向传播 6.4 W和b的初始化 6.5 总结 上一课主要介绍了一些神经网络必备的基础知识,包括Sigmoid激活函数、损失函数、梯度下降和计算图。这些知识对学习神经网络非常有用。本节将开始真正的神经网络学习,从一个浅层的神经网络出发,详细推导其正向传播和反向传播完整过程。

深度学习——第6章 浅层神经网络(NN)

第6章 浅层神经网络(NN) 目录 6.1 神经网络模型概述 6.2 神经网络正向传播 6.3 神经网络反向传播 6.4 W和b的初始化 6.5 总结 上一课主要介绍了一些神经网络必备的基础知识,包括Sigmoid激活函数、损失函数、梯度下降和计算图。这些知识对学习神经网络非常有用。本节将开始真正的神经网络学习,从一个浅层的神经网络出发,详细推导其正向传播和反向传播完整过程。

【读点论文】VanillaNet: the Power of Minimalism in Deep Learning,在浅层网络中加入更丰富的非线性元素加上提出的网络训练技巧得到了一些惊讶的效果

VanillaNet: the Power of Minimalism in Deep Learning Abstract 基础模型的核心理念是“多而不同”,计算机视觉和自然语言处理领域的惊人成功就是例证。然而,优化的挑战和transformer模型固有的复杂性要求范式向简单性转变。在这项研究中,我们介绍了VanillaNet,一个包含优雅设计的神经网络架构。通过避免高深度、残差方式和复杂的

深浅层特征融合——HRNet

写在前面 本系列博客“深浅层特征融合”对几篇出现较新的深浅层特征融合算法进行简要介绍,多为本人的论文笔记,记录了一个深度学习小学生在看论文时想到的问题。 论文题目:Deep High-Resolution Representation Learning for Human Pose Estimation 论文链接:https://arxiv.org/pdf/1902.09212.pdf

深浅层特征融合——CBNet

写在前面 本系列博客“深浅层特征融合”对几篇出现较新的深浅层特征融合算法进行简要介绍,多为本人的论文笔记,记录了一个深度学习小学生在看论文时想到的问题。 论文题目:CBNet: A Novel Composite Backbone Network Architecture for Object Detection 论文链接:https://arxiv.org/pdf/1909.03625

第一门课:神经网络和深度学习(第三周)——浅层神经网络

浅层神经网络 1. 神经网络概览2. 神经网络的表示3. 神经网络的输出4. 多样本向量化5. 激活函数6. 为什么需要非线性激活函数7. 激活函数的导数8.直观理解反向传播9. 随机初始化 1. 神经网络概览 对于以往由逻辑单元组成的简单神经网络,我们对其计算过程已经大致了解。接下来我们类比于浅层神经网络中。 算法过渡: 逐步求解: 第一层根据输入计算 z [ 1

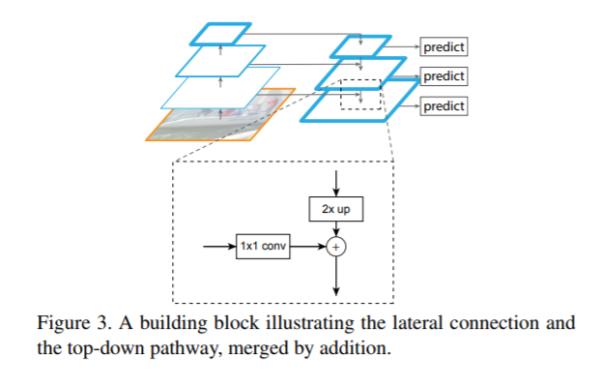

SSD浅层网络_语义分割网络 - FPN 结构及代码

初识 FPN FPN 全称 Feature Pyramid Network,翻译过来就是特征金字塔网络。何为特征金字塔,深度卷积神经网络(DCNN)提取的不同尺度特征组成的金字塔形状。本文提出了一种新型的特征融合方式,虽然距离论文提出的时间比较久了,但直到现在该结构仍较常用,尤其是在检测小目标时值得一试。 本篇论文的目的是为了合理利用特征金字塔中不同尺度的语义信息。实际上在本篇文章之前,已经有很

吴恩达深度学习_第一课(3)《浅层神经网络》

神经网络概览 符号变化 变量上标是圆括号 (1),(2),(3)…(i) 表示第 i 个样本的数据:x(1),x(2)… 变量上标是方括号[1],[2],[3]…[i] 表示第 i 层layer的数据:x[1],x[2]… 举个例子: x作为输入进入第一层,配合W[1]和b[1]进行计算,得到第一层结果a[1];a[1]作为第二层的输入,配合W[2]和b[2]进行计算,得到第二层结果a[2