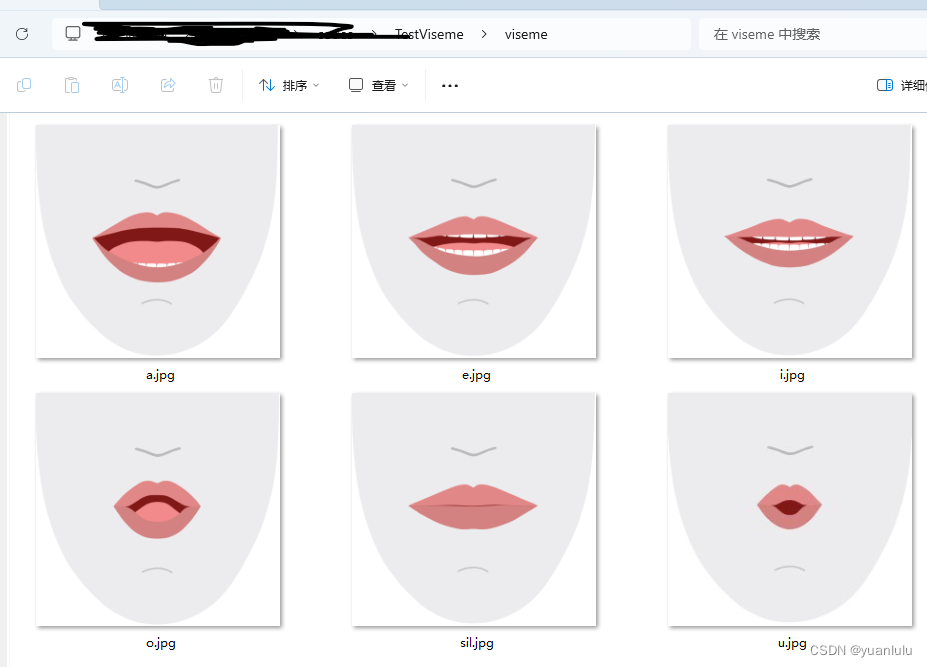

口型专题

使用共振峰提取元音音素/从声音生成口型动画

视频效果 我前段时间研究了下从声音提取共振峰的方法。今天测试了下实际效果。 我使用一段33秒的女声视频,提取元音后使用静态视位图序列生成了一个视频,效果如下: b站视频: https://www.bilibili.com/video/BV1JD421H7m9/?vd_source=8abb7f0122649239c41b4c8acf458e47 https://www.bilibili.co

46秒AI生成真人视频爆火,遭在线打假「换口型、声音」

ChatGPT狂飙160天,世界已经不是之前的样子。 新建了人工智能中文站https://ai.weoknow.com 每天给大家更新可用的国内可用chatGPT资源 发布在https://it.weoknow.com 更多资源欢迎关注 是炒作还是真正的 AI 视频能力进化? AI 生成视频已经发展到这个程度了吗? 前段时间,英国王室凯特王妃的 P 图事件,再

Dialogue System for Unity文档中文对照版(简雨原创翻译)第三篇(口型,语音同步相关)

When the conversation uses thisdialogue entry, it will play the Voice() command in the Sequence field. Thiscommand will play the audio clip and the animation and wait until both aredone. 当会话使用对话的

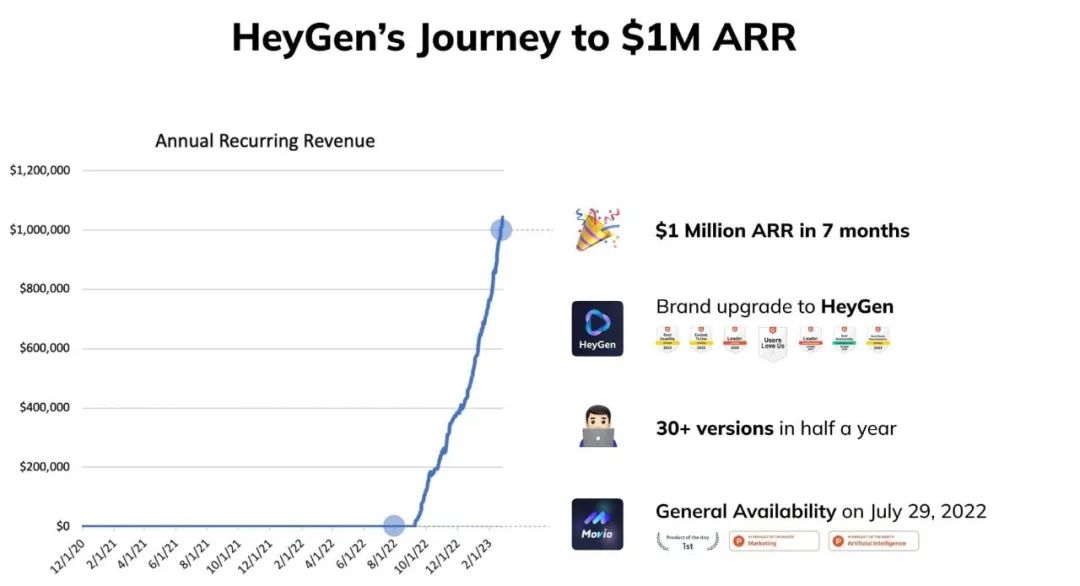

口型几乎完美、还能卡点,霉霉说地道中文的视频火了,背后 AI 工具原来是它...

转自:机器之心 这两天,美国女歌星霉霉(泰勒・斯威夫特)一则说中文的短视频在各社交平台火了起来。有的播放量已经达到了 600 多万。 在视频里,霉霉操着一口流利、地道的中文,神情自若,几乎没有早期译制片女主角的那种腔调,口型也能对得上。 图源:微博 @会火 还没有看过视频的小伙伴们,我们先来一睹为快。 视频作者:johnhuu 教英语 感觉怎么样,是不是很神奇呢? 可以看到,不仅是霉霉,蕾切尔

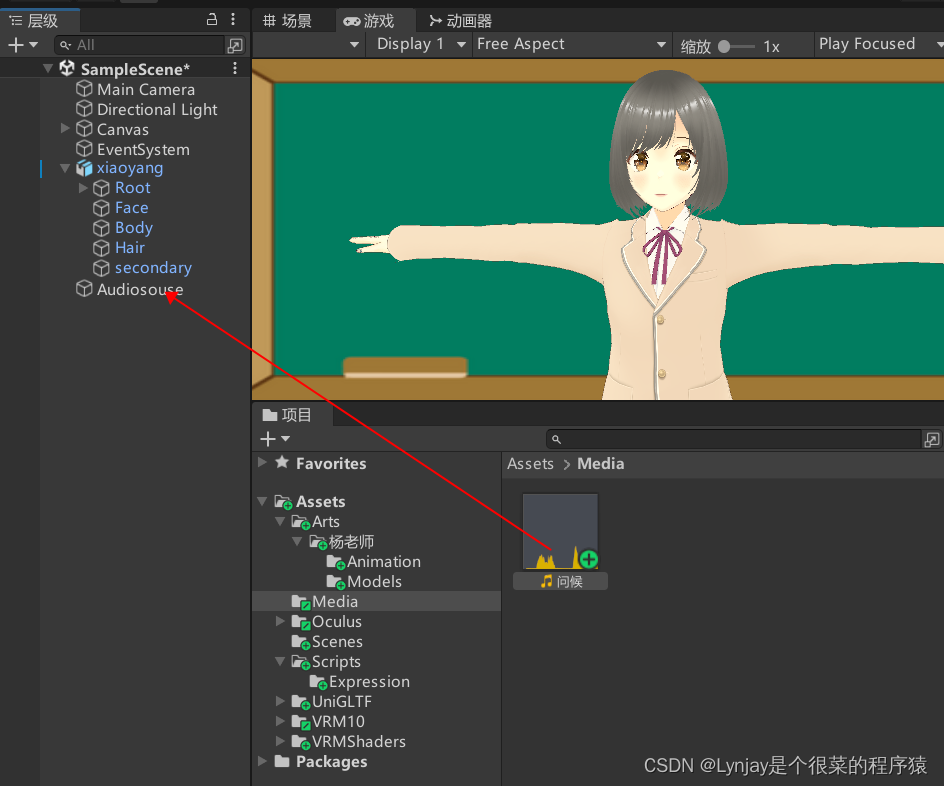

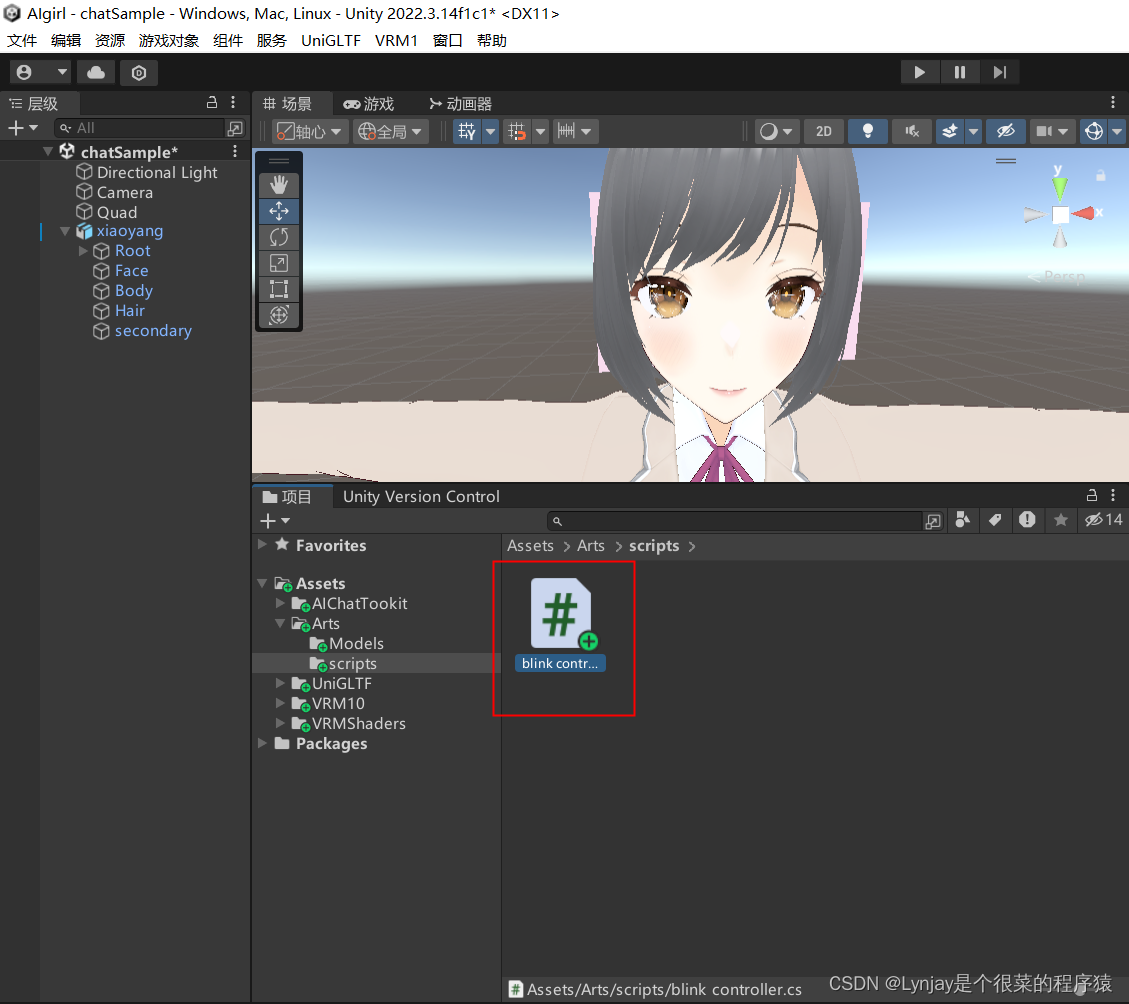

【unity学习笔记】捏人+眨眼效果+口型效果

一、vriod捏人 1.在vroidstudio软件中捏人 2.导出模型(.vrm) 二、vrid导入unity的插件 1.在Git上搜索、打开univrm。 2.找到release页面找到合适的插件版本。(VRM-0.116.0_0f6c) 3.将univrm导入到工程中(assets)。 三、导入小人 1.在assets中新建文件夹arts,拖入小人。 2.将小人转化为unity可识别

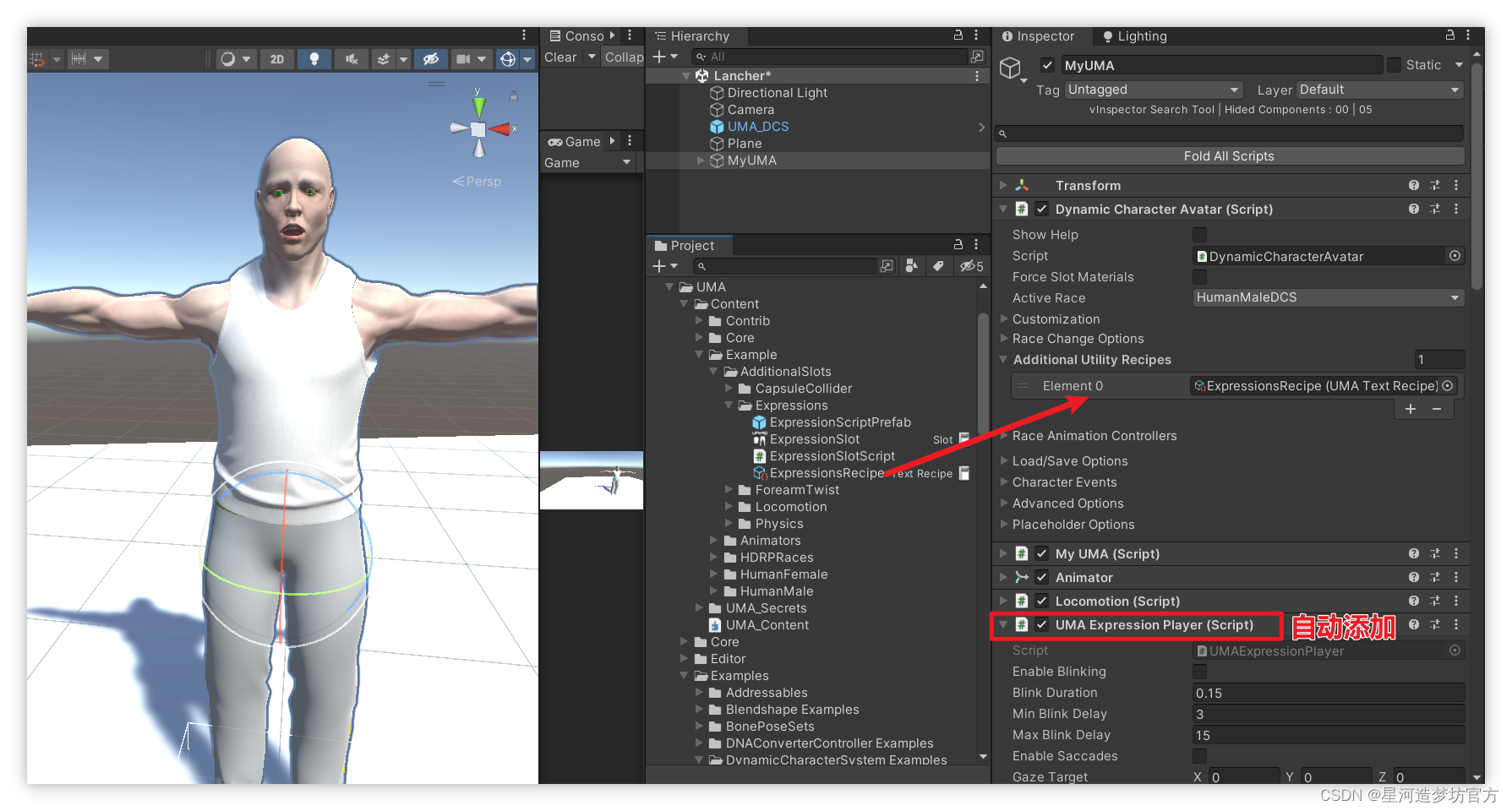

UMA 2 - Unity Multipurpose Avatar☀️九.Expressions表情管理与表情插件推荐 (口型同步 / 表情管理)

文章目录 🟥 Expressions文件位置🟧 功能 : 解决嘴巴张开问题🟨 Expressions : 表情面板API讲解🟩 表情插件推荐 : 口型同步 / 表情管理 🟥 Expressions文件位置 Expressions也是UMA内置5种实用Recipes之一,位置如下. 使用方法: 如下图所示,将Recipes拖到Additional Utility R

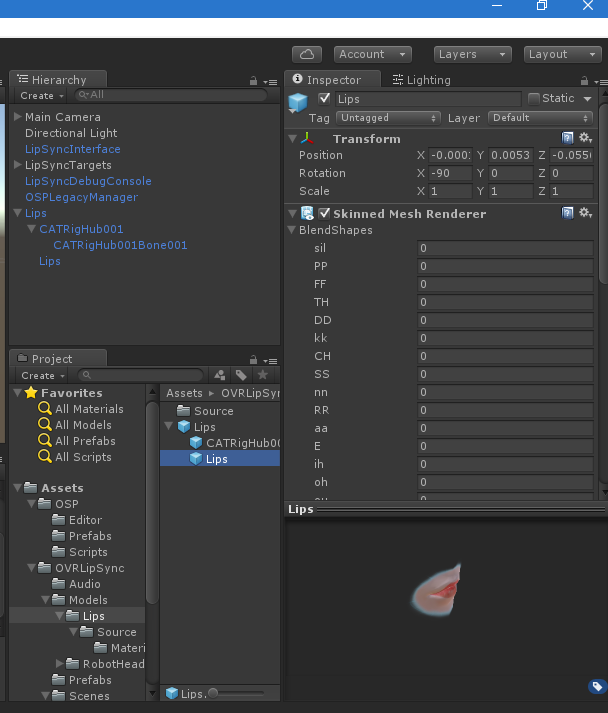

Unity语音口型学习(Oculus发布的OVRLipSync示例)

了解该部分可以参考Oculus发布的OVRLipSync示例。 https://developer3.oculus.com/downloads/ 将下载下来的package导入Unity,可以运行官方Demo。 该Demo中模型的口型动作,可以通过 Maya Cinema4D 3D Studio Max Blender Cheetah 3D XSI Any tool t

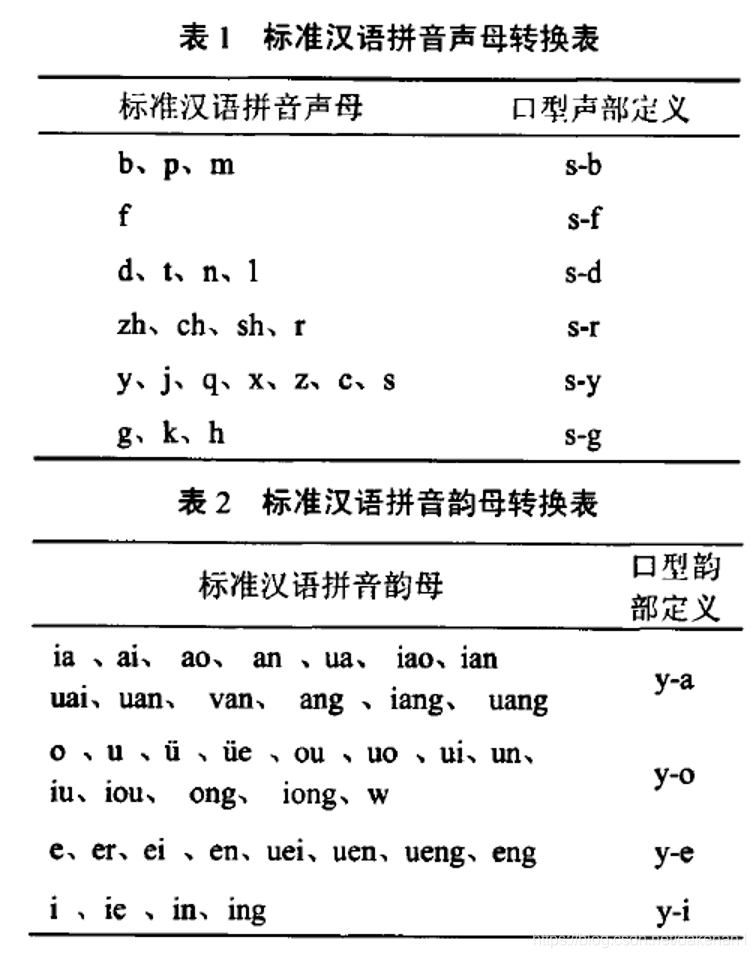

语音驱动的口型同步算法文献汇总

论文一:语音驱动的口型同步算法 核心工作:提出一种口型动画同步算法,预先定义基本口型动作集合,通过权重线性混合构成口型动画和过渡动画,最终拼接得到完整口型动画。 音素:输入的语音信号首先被转化为由一串发音单元构成的序列,这些发音单元成为音素。 视素:序列中的音素会被映射到一个口型动作单元上,这些口型动作单元成为视素。 协同发音: 1. 难题:除了当前正在发音的音素外,该音素之前或之后的一些音素也会

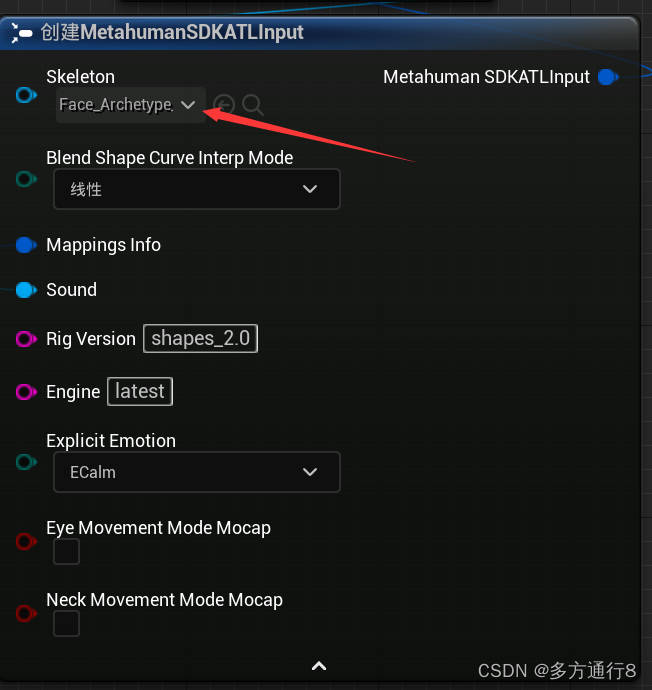

UE5 MetaHuman SDK插件的使用【一、编辑器创建音波与蓝图创建获取音波,语音与嘴唇口型的同步】

目录 打开插件 创建音频 编辑器这直接创建音频: 蓝图中创建和获取音频: 唇语: 声音与嘴唇同步: 方法一【效果不是很好】: 方法二【效果很好,但有一段时间延迟在处理】: 逻辑: 打开插件 MetaHuman SDK插件目前只支持ue5和ue5.1版本。 创建音频 编辑器这直接创建音频: 首先第一步创建音频: 这样音频就创建好了。 蓝图中

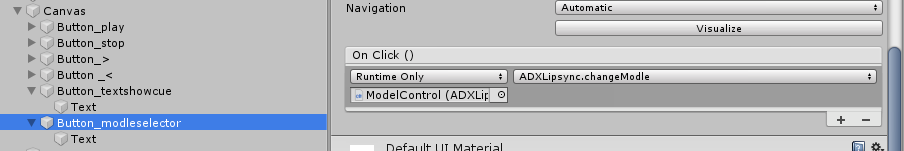

unity+webgl+websocket实时口型+二次元语音老婆

文章开始首先感谢 B站UP: 阴沉的怪咖 提供的最初资源包 一 项目实现 2.gif 体验地址 体验地址 www.aixmao.com不能放视频,看效果去B站链接:B站链接_bilibili UP主提供初始代码地址: Github地址:https://github.com/zhangliwei7758/unity-AI-Chat-Toolkit Gitee地址:https:

Unity语音口型学习(OVRLipSync demo)

附上 下载地址: https://download.csdn.net/download/qq_39735878/12474860 导入资源 运行场景例子

【unity学习笔记】配置模型,实现眨眼和口型效果

一、vriod捏人 1.在vroidstudio软件中捏人 2.导出模型(.vrm) 二、vrid导入unity的插件 1.在Git上搜索、打开univrm。 2.找到release页面找到合适的插件版本。(VRM-0.116.0_0f6c) 3.将univrm导入到工程中(assets)。 三、导入小人 1.在assets中新建文件夹arts,拖入小人。 2.将小人转化为unity可识别

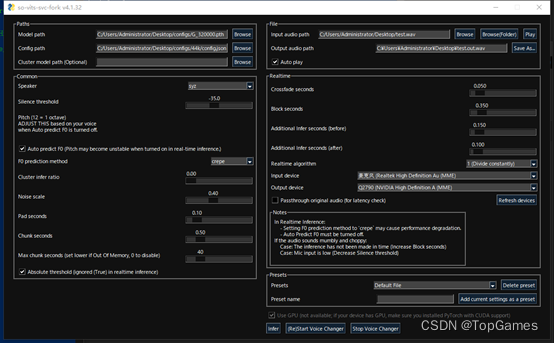

【AI】文本转语音 变声 音色克隆 数字人音视频口型同步AI应用

文本转语音 项目地址:https://github.com/coqui-ai/TTS 环境安装: 下载项目;安装Python,安装项目依赖: pip install TTS 1. 下载安装AI模型: https://github.com/facebookresearch/fairseq/tree/main/examples/mms 模型文件放到:C:\Users\Administra

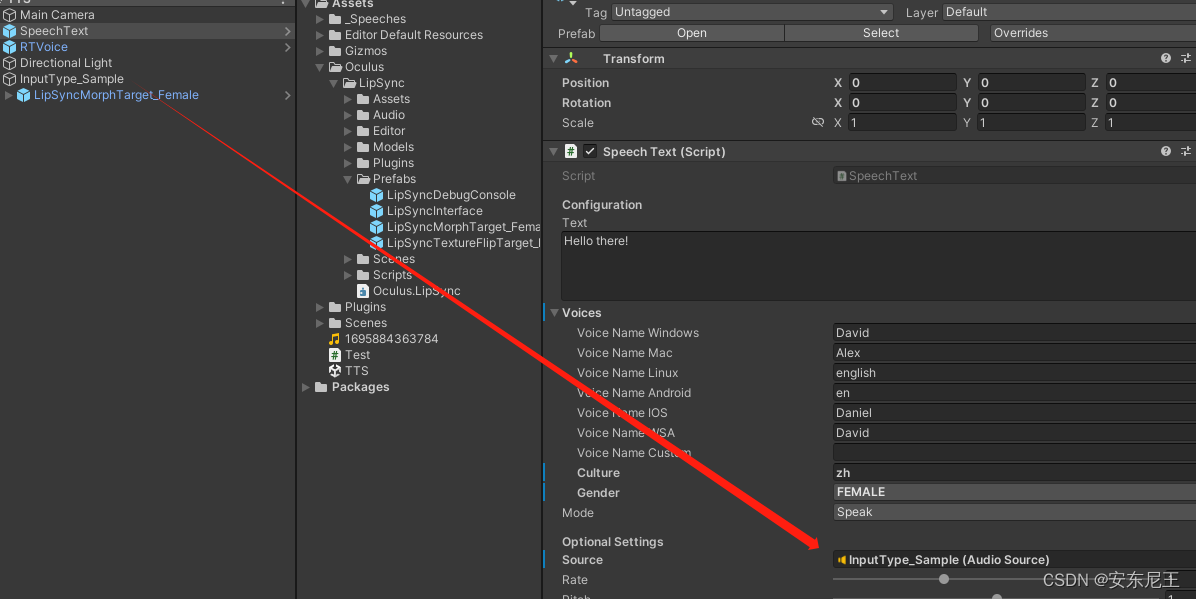

Unity实现文字转语音并且与人物模型口型同步

文章目录 前言一、插件介绍二、导入RTVoice1.插件传送门2.组件配置 三、导入OVRLipSync1.插件传送门2.组件配置 总结 前言 提示:这里可以添加本文要记录的大概内容: 今天我们用Unity实现文字转语音并且与人物模型口型同步,要实现这个功能,我们需要用到两个插件:语音口型同步“OVRLipSync”和文字转语音“RTVoice”。 一、插件介绍 R