本文主要是介绍Unity语音口型学习(Oculus发布的OVRLipSync示例),希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

了解该部分可以参考Oculus发布的OVRLipSync示例。

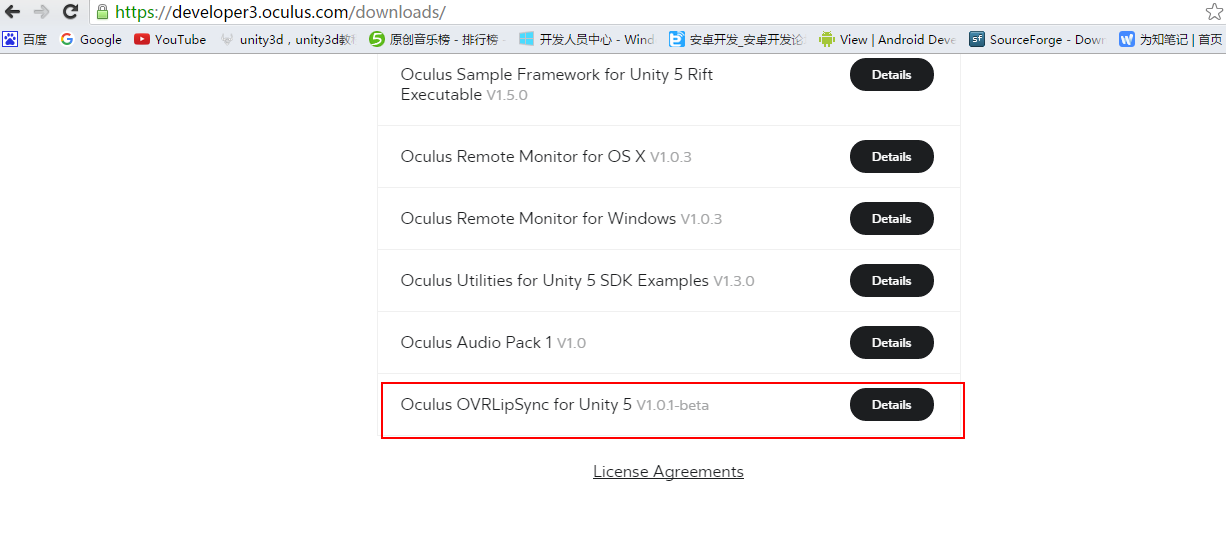

https://developer3.oculus.com/downloads/

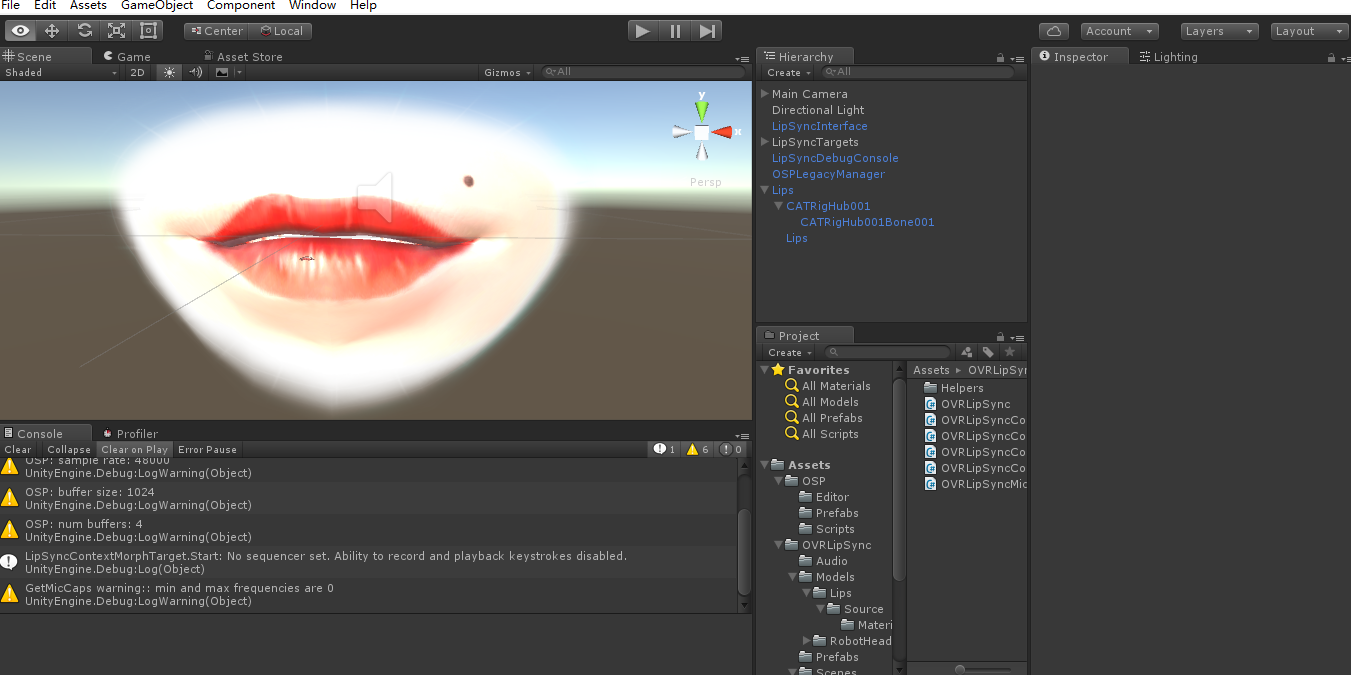

将下载下来的package导入Unity,可以运行官方Demo。

该Demo中模型的口型动作,可以通过

Maya

Cinema4D

3D Studio Max

Blender

Cheetah 3D

XSI

Any tool that supports the FBX format

这几个工具进行设计和制作。详情

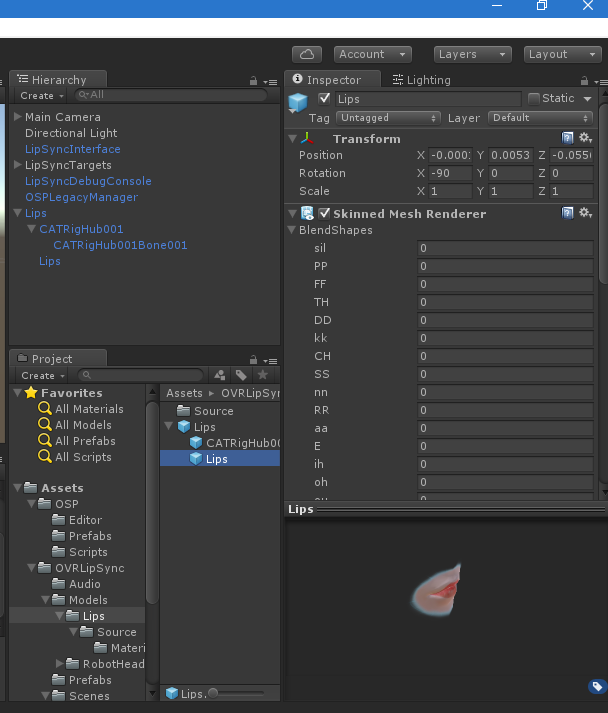

如果我们通过这些工具制作相关口型动作并导入,在Unity中选中模型,在Inspector中会显示在SkinMeshRenderer中。

该Demo中通过Oculus官方提供的语音识别DLL进行实时语音识别并通过(位置..\Assets\Plugins\x86_64中的OVRLipSync.dll)

skinnedMeshRenderer = GetComponent<SkinnedMeshRenderer> ();

skinnedMeshRenderer.SetBlendShapeWeight (0, blendOne);

代码进行控制。详情

暂时先研究到这里,希望有新的了解可以与大家分享。谢谢大家!

这篇关于Unity语音口型学习(Oculus发布的OVRLipSync示例)的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!