位姿专题

【机器人工具箱Robotics Toolbox开发笔记(四)】 机器人位姿变换之位姿变换函数

机器人学的位姿变换相关内容,可以采用下列函数来进行计算。 (1)rpy2r() R = rpy2r (roll, pitch, yaw, options)能够根据一组回转角、俯仰角和偏转角求出对应齐次变换矩阵中的旋转矩阵R(3x3),其中3个角度rpy = [R, P, Y]分别对应于关于x、y、z轴的顺序旋转。 R = rpy2r (rpy, options)与前者相同,但是输入的是一个向量

位姿估计和坐标系变换

SLAM是一个“鸡生蛋和蛋生鸡”的问题,要定位需要重建,一般通过当前sensor看到到场景跟建好的地图进行匹配确定自身的位置。简单的例子:比如你在平面上,别人问你的坐标,那么很显然你得先有坐标系。要重建又需要精确的定位信息,如果没有相机位姿,那么当前帧数据无法统一注册到世界坐标系下。 在SLAM中,所谓的位姿其实指的是相机在世界坐标系中的位姿。位姿包括两方面:位置和姿势,即三维坐标和朝向。如下所

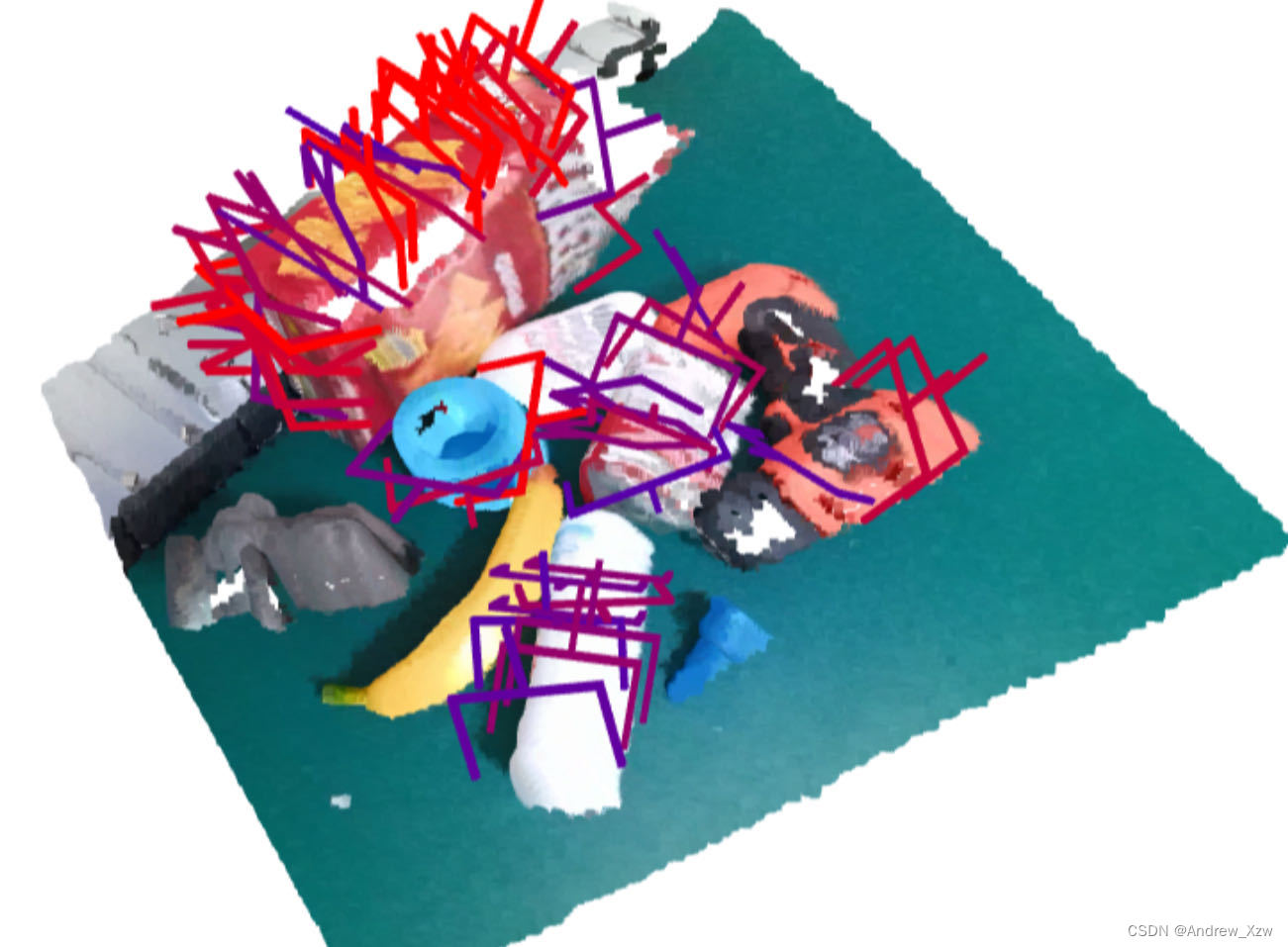

D435相机结合Yolo V8识别出目标物体,并转点云出抓取位姿。

最近项目上需要完成整个识别、定位、到最后的抓取流程。 分享一下,通过使用D435相机并结合Yolo V8识别出目标物体后,抠取出目标物体部分的有效深度图,最后将前景物体部分的RGB D435相机结合Yolo V8识别出目标物体,并转点云出抓取位姿 1、D435相机取流2、D435结合Yolo V8实时检测3、扣取指定物体的深度图3.1 扣取指定物体的mask3.2 根据mask扣取物体有效深度

视觉SLAM位姿估计(总结)

Overview 欢迎访问 持续更新:https://cgabc.xyz/posts/102a40b/ 相关代码: pose_estimation in cggos/slam_park_cg Features Based Method 2D-2D: Epipolar Geometry 2D-2D 对极几何 主要涉及到基础矩阵、本质矩阵和单应性矩阵的求解,并从中恢复出旋转矩阵

Ceres-Solver 从入门到上手视觉SLAM位姿优化问题

概述 欢迎访问 https://cgabc.xyz/posts/740ecb50/,持续更新。 Ceres Solver is an open source C++ library for modeling and solving large, complicated optimization problems. 使用 Ceres Solver 求解非线性优化问题,主要包括以下几部分:

Halcon 相机标定、手眼标定及机器人位姿矩阵的求解

1.相机内外参标定 标定目的:为了获得相机的内参(焦距、畸变系数等)和外参(从世界坐标系转换到摄像机坐标系的旋转矩阵和平移矩阵) 标定步骤: (1)相机固定,在放置物体的平面上放置halcon标定板; (2)拍摄标定板图像,拍摄要求如下图所示: (3)拍摄完毕后,打开halcon相机标定助手: (4)将第二步拍摄到的标定板图像输入,进行标定。 (5)点击标定,内外参即可标定完

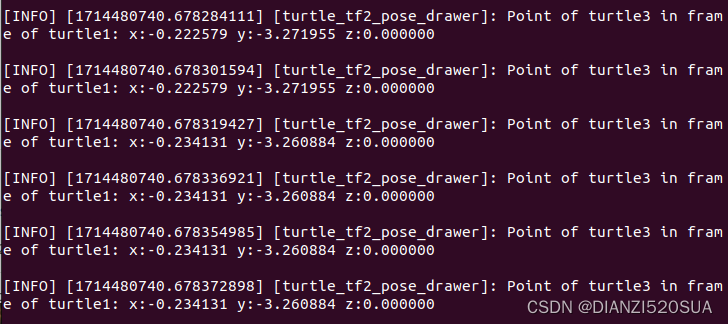

ROS 2边学边练(41)-- 使用基于tf2_ros::MessageFilter带标记(位姿、时间...)的数据类型

前言 此篇将介绍如何利用tf2来使用传感器数据(如单声道和立体声摄像机以及雷达)。 假设我们创建了一只海龟叫turtle3,它的里程计不大好用,为了监视turtle3的活动轨迹,有台头顶摄像机被安装到该海龟的背上(负碑的赑屃),并且实时发布相对于世界坐标系的PointStamped消息(包含位姿和时间)。 有只叫turtle1的海龟想要知道tu

目标检测YOLO实战应用案例100讲-基于YOLOv5的目标检测与6D位姿估计算法研究(中)

目录 3.3 相机成像原理 3.3.1 坐标系的建立及关系 3.3.2 相机标定 3.3.3 相机畸变

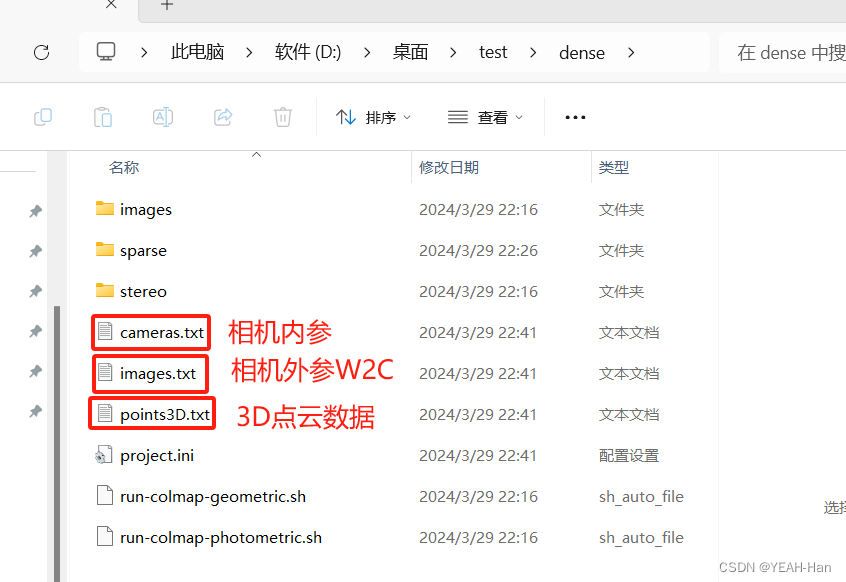

COLMAP(Windows)实现SFM三维重建位姿估计

问题产生: Guassian splatting第一步用colmap进行位姿估计,图片匹配失败,输出图片全靠运气,最少的时候甚至一张都没匹配上,所以想到用colmap软件先进行匹配,再放入高斯训练。 colmap使用步骤: 1.打开colmap.bat 2.新建项目 【File】–> 【New Project】 3. 新建database文件,选择images所在路径 【N

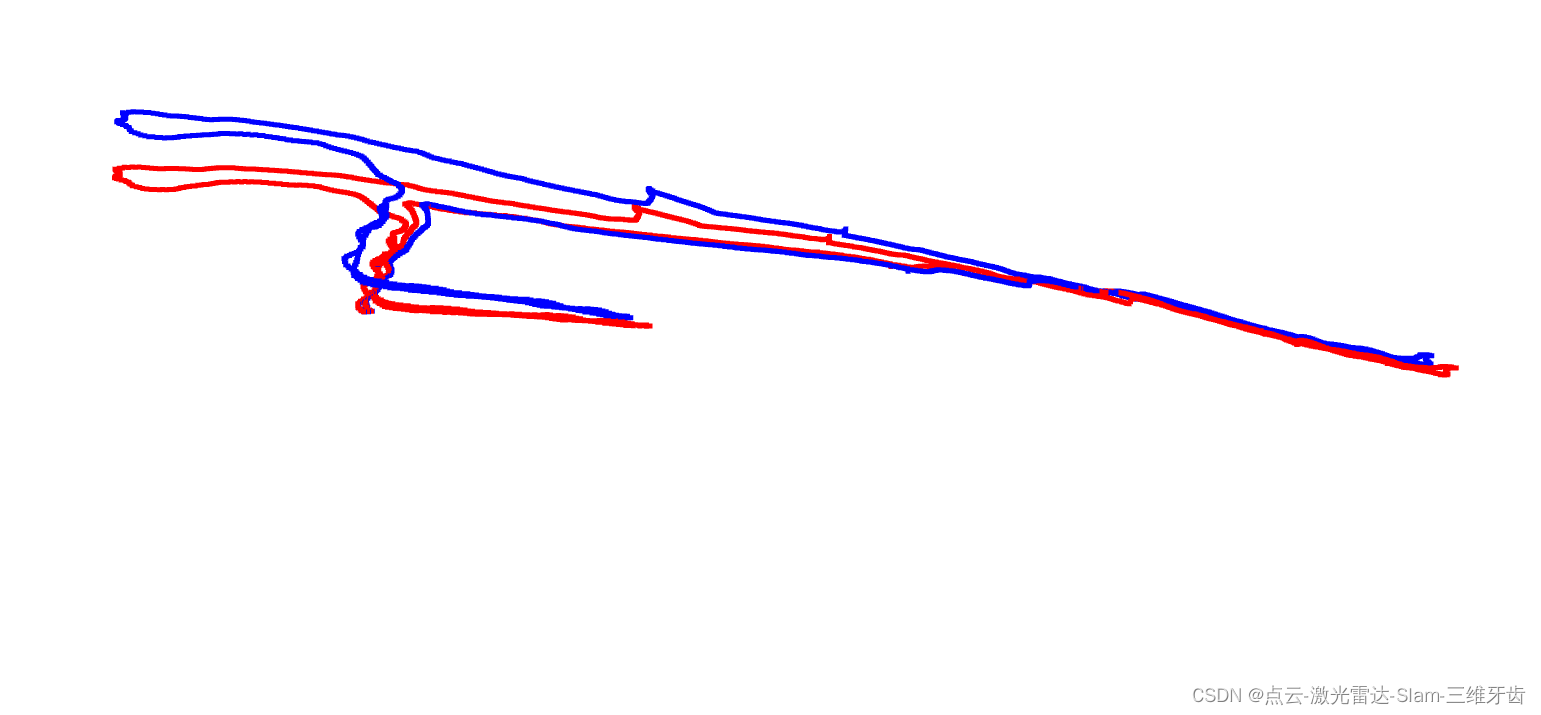

在window系统用 python 做slam回环检测和图优化位姿(附代码思路)

因为 fast lio 没有回环模块,现有的添加回环的一些 github 项目工程又各自有各自的问题,所以我把它每个节点的点云数据和位姿信息保存了下来,自己做一个单独的回环图优化模块,和 LIO 激光里程计模块完全解耦,并且要足够简单,使用一个python代码程序文件即可实现,同时要在window系统也可以运行,经过一些时间的尝试,最后做好了这个代码工具。 特点: 松耦合,以后可以和任意新

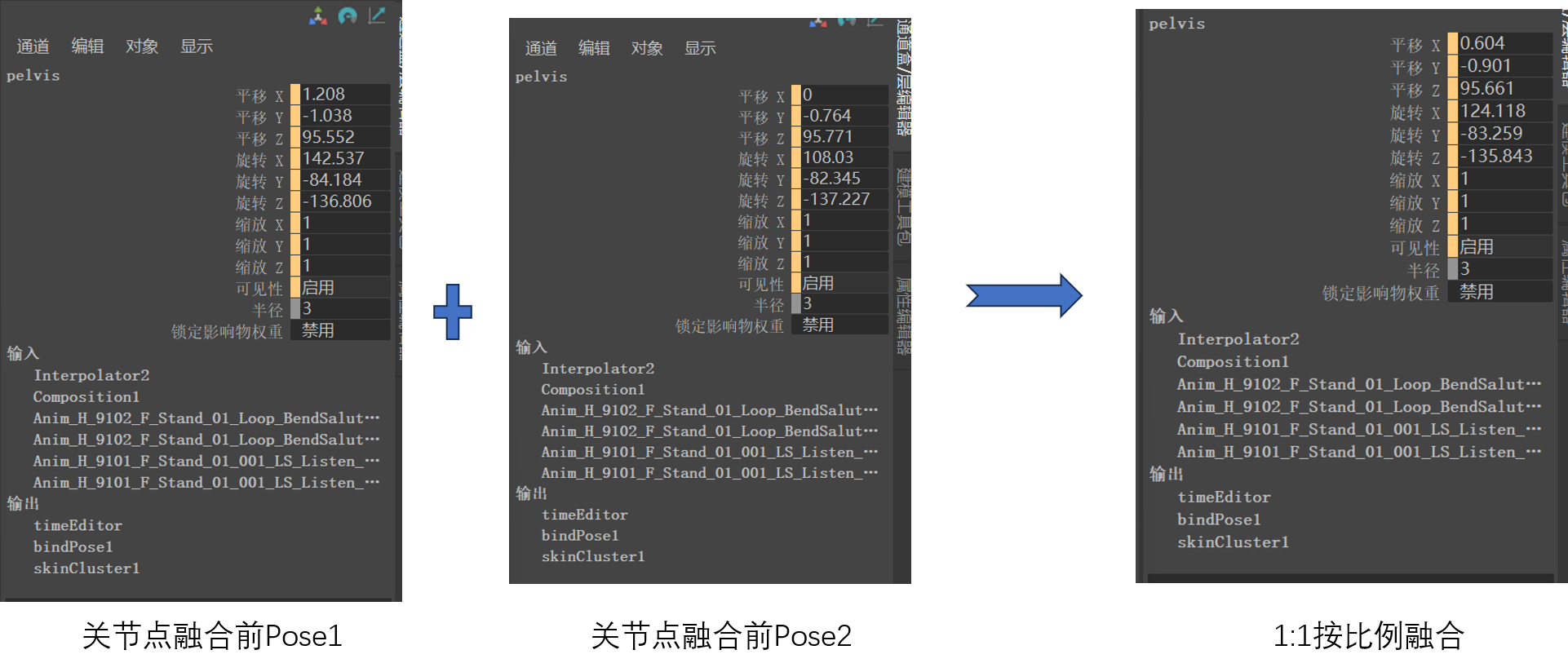

AIGC笔记--关节点6D位姿按比例融合

1--核心代码 6D位姿一般指平移向量和旋转向量,Maya软件中关节点的6D位姿指的是相对平移向量和欧拉旋转向量; 为了按比例融合两个Pose,首先需要将欧拉旋转向量转换为旋转矩阵,在将旋转矩阵转换为四元数,利用球面线性插值实现Pose的融合,融合后的四元数需要重新转换为欧拉旋转向量,整个流程如下:欧拉旋转向量→旋转矩阵→四元数→球面线性插值→旋转矩阵→欧拉旋转

【Android】SLAM:ORB-SLAM 位姿优化

只知道算法描述和代码,而不知道原理是比较扯的事情,还是把原理转载一下。原文链接:http://www.cnblogs.com/luyb/p/5447497.html ORB-SLAM作为单目SLAM,其精度很大程度上决定于帧与帧之间的位姿优化的是否准确。因此优化(optimization)在ORB-SLAM里面扮演了很重要的角色。这一小节探讨一下ORB-SLAM里用到

CVPR2021 | 国防科大:基于几何稳定性分析的物体位姿估计方法

本文转载自机器之心。 物体6D姿态估计是机器人抓取、虚拟现实等任务中的核心研究问题。近些年来,随着深度学习技术和图像卷积神经网络的快速发展,在提取物体的几何特征方面出现了许多需要改善的问题。国防科技大学的研究人员致力于通过将几何稳定性概念引入物体 6D 姿态估计的方法来解决问题。 物体 6D 姿态估计的目的是确定物体从模型坐标系到相机坐标系的刚性变换矩阵。现有方法通常通过求解观测物体与物体三

7机器人位姿的数学描述与坐标变

由上次刚体的空间转动直接切换为机器人相关术语。 1.机器人位姿的数学描述与坐标变换 1.1位姿描述 {B}相对于{A}的姿态描述用3x3矩阵表示为: 式中为三个单位正交主矢量,分别表示刚体坐标系{B}的三个坐标轴XBYBZB在参考系{A}中的方位,∠XBXA表示坐标轴XB与坐标轴XA之间的夹角,其他的类似。 姿态矩阵具有如下特点: 1>共有9个元素,但只有3个是独立的,有6个约束条件:

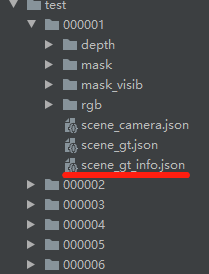

6D位姿估计的理解及BOP数据集参数说明

6D位姿估计的理解及BOP数据集参数说明 一、6D位姿估计 姿态估计在百度上搜会出现“姿态估计问题就是确定某一三维目标物体的方位指向问题”的解释,但是具体来讲确定某一三维目标物体的方位指向问题到底是什么意思呢? 首先,6D表示6个自由度,3个自由度的位移(Translation)和3个自由度的空间旋转(Rotation)。位移即方位,旋转即指向。将它们组合起来便构成了“位姿”。位姿并不是绝对的

CVPR 2022最佳学生论文:单张图像估计物体在3D空间中的位姿估计

©作者 | 陈涵晟 单位 | 同济大学、阿里达摩院 来源 | 机器之心 距离 CVPR 2022 各大奖项公布没多久,来自同济大学研究生、阿里达摩院研究型实习生陈涵晟为我们解读最佳学生论文奖。 本文解读我们获得 CVPR 2022 最佳学生论文奖的工作。论文研究的问题是基于单张图像估计物体在 3D 空间中的位姿。现有方法中,基于 PnP 几何优化的位姿估计方法往往通过深度网络提取 2D-3D

ROS TF坐标变换 - 位姿描述与消息类型

目录 一、位姿描述二、位姿相关消息体类型2.1 geometry_msgs/TransformStamped2.2 geometry_msgs/PoseStamped 在机器人系统中,有许多运动机构和传感器,为了描述他们之间的相对位姿关系,分别为他们定义了各自的坐标系,通过坐标系转换,就可以知道每个时刻各个组件的位姿。 ROS中通过TF包封装了常用的坐标系转换工具,目前ROS使

把点云(point cloud)视作位姿的平移部分, 导出 Tum 格式的位姿

需求:对一个 [N,3] 的 point cloud txt 补充 时间戳跟 单位阵 四元数。输出 Tum 格式的 位姿 txt。方便对 原始 point cloud 使用 EVO 轨迹评测工具,在 相似变换的 尺度上计算两个 点云的整体距离。 import osimport numpy as npdef transform_and_write_txt(input_file, output_f

使用opencv的aruco库进行位姿估计(得到的是旋转矩阵与平移矩阵)

这里面很重要的一点就是说了:使用estimatePoseSingleMarkers估计Marker的位姿,得到的即是即是R和t,R和t应该就是旋转矩阵与平移矩阵。 https://blog.csdn.net/sinat_16643223/article/details/112912961 https://blog.csdn.net/sinat_16643223/article/detail

使用opencv的aruco库进行位姿估计(得到的是旋转矩阵与平移矩阵)

这里面很重要的一点就是说了:使用estimatePoseSingleMarkers估计Marker的位姿,得到的即是即是R和t,R和t应该就是旋转矩阵与平移矩阵。 https://blog.csdn.net/sinat_16643223/article/details/112912961 https://blog.csdn.net/sinat_16643223/article/detail

基于2D激光雷达匹配的充电桩位姿检测

原理 1. 激光雷达滤波,滤除太远的雷达数据,并降采样 2. 对雷达数据进行分割聚类出candidates 3. 通过策略,过滤掉大部分不符合的candidates 4. 对candidates与充电桩模板数据进行PCA、ICP匹配 5. 选择距离最小或者得分最高的一帧作为输出 效果 基于匹配的充电桩V-Mark检测并输出位姿

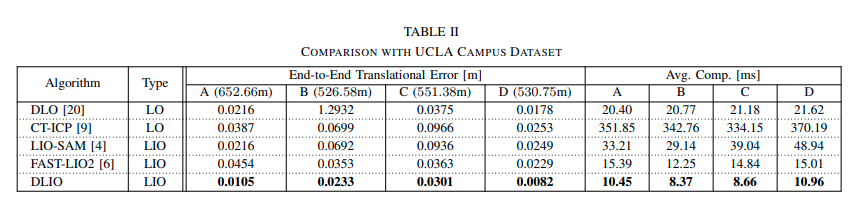

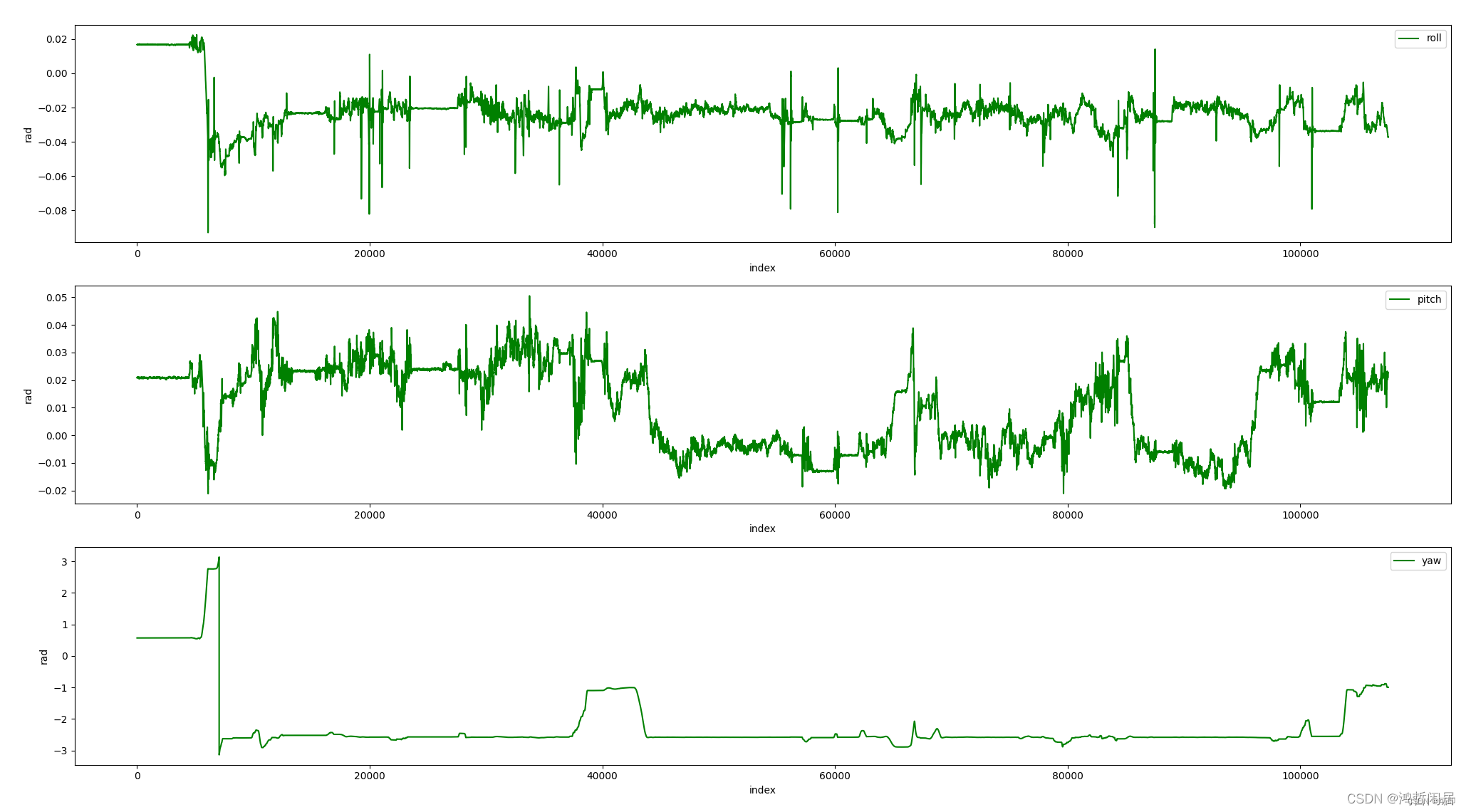

代码浅析DLIO(四)---位姿更新

0. 简介 我们刚刚了解过DLIO的整个流程,我们发现相比于Point-LIO而言,这个方法更适合我们去学习理解,同时官方给出的结果来看DLIO的结果明显好于现在的主流方法,当然指的一提的是,这个DLIO是必须需要六轴IMU的,所以如果没有IMU的画,那只有DLO可以使用了。 1. getNextPose–通过IMU + S2M + GEO获取下一个姿态 下面的函数作用主要是获取下一个姿

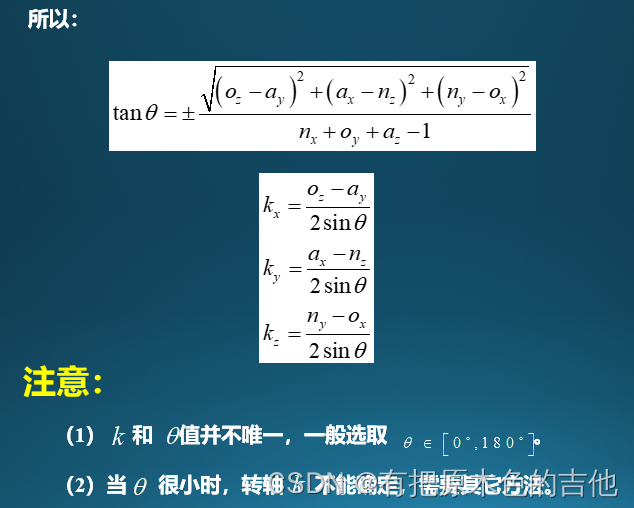

【机器人学】-位姿描述和旋转变换(2)

机器人学基础-旋转变换 空间旋转矩阵中有九个元素,但是这九个元素满足六个约束方程,只有三个独立变量 ABX = [ AXB AYB AYB ] = [ R 11 R 12 R 13 R 21 R 22 R 23 R 31 R 32 R 33 ] \begin{bmatrix}R11 & R12 & R13 \\ R21 & R22&R23\\R31&R32&R33\\ \end{bmatri

位姿变换线性变换与坐标变换

位姿,线性变换与坐标变换.yuque 内旋,外旋, 左乘,右乘很容易把人绕晕是因为缺少一种科学的符号。 自己的符号,如果经常变不稳定,对推理和理解都很不利。 一旦问题复杂起来, 直观和直觉靠不住, 只能靠代数符号来推理 约定 P1: A,B,C…是空间中的标准正交基 P2: [a1,a2,…an] 是系A的基, [b1,b2,…bn] 是系B的基,其中aj 和bj 都是n维列向量 一个坐标系可以

Eigen中三维位姿表示方式以及相互转换

目前三维位姿表示方式主要有旋转矩阵、欧拉角、轴角、四元数等,Eigen库中提供了四元数、欧拉角、旋转矩阵的转换方法: Eigen旋转的表示方式与相互转换 #include <iostream>#include <Eigen/Core>#include <Eigen/Geometry>using namespace std;#define PI (3.141592653589793234