npu专题

LLaMA-Factory仓基础功能架构及NPU/GPU环境实战演练

LLaMA-Factory 基础篇 LLaMA-Factory简介 LLaMA-Factory是一个开源的大规模语言模型微调框架,设计用于简化大模型的训练过程。它提供了一个统一的平台,支持多种大模型的微调,包括LLaMA、BLOOM、Mistral等,旨在帮助用户快速适应和调整这些模型以适应特定的应用场景。LLaMA-Factory通过提供一套完整的工具和接口,使用户能够轻松地对预训练的

RK3588 NPU开发环境搭建

如何在Ubuntu系统(PC)上搭建RK3588 Buildroot Linux的NPU开发环境?即电脑端运行Ubuntu系统,而RK3588板卡运行Buildroot Linux系统的情况下,搭建RK3588 NPU开发环境。 下面是相应的步骤(对应的命令): 0.依赖文件 RKNPU2 工程下载地址:rknn-toolkit2/rknpu2 at master · airockc

rk3568 npu opencv 怎么联系起来

问题: 客户一直再问 关于 3568 npu opencv 的编译内容。 大致了解一些 ,这方面的内容。 网上的资料。 也许这个基本上就是他的逻辑了, 首先界面使用QT来写。 然后,使用 opencv 去读取摄像头。 然后拿到一帧图像之后,使用npu 去识别这个图像。 然后 使用opencv 去将图像显示在qt 上。 我不管 ffmpeg 这里其实涉及到了

RK3588人工智能开发----【1】初识NPU

NPU 的诞生! 随着人工智能和大数据时代的到来,传统嵌入式处理器中的CPU和GPU逐渐无法满足日益增长的深度学习需求。为了应对这一挑战,在一些高端处理器中,NPU(神经网络处理单元)也被集成到了处理器里。NPU的出现不仅减轻了CPU和GPU的负担,还让复杂的计算任务得以高效处理。在典型的工作流中,CPU会首先接收任务,并根据任务的性质将其分配给合适的处理单元,图像处理任务由GPU处

RK3588 技术分享 | 在Android系统中使用NPU实现Yolov5分类检测-迅为电子

随着人工智能和大数据时代的到来,传统嵌入式处理器中的CPU和GPU逐渐无法满足日益增长的深度学习需求。为了应对这一挑战,在一些高端处理器中,NPU(神经网络处理单元)也被集成到了处理器里。NPU的出现不仅减轻了CPU和GPU的负担,还让复杂的计算任务得以高效处理。在典型的工作流中,CPU会首先接收任务,并根据任务的性质将其分配给合适的处理单元,图像处理任务由GPU处理,

openi启智社区 aarch64 npu环境安装飞桨paddlepaddle和PaddleNLP(失败)

以前在启智社区都是编译安装飞桨,这回看到飞桨提供了npu安装包,兴冲冲的以为安装很简单。 之所以安装飞桨,是因为想在启智社区的启智大脑调试环境使用最新的PaddleNLP,结果报错:No module named 'paddle.nn.layer.layers',提issuenpu下import paddlenlp报错:No module named 'paddle.nn.layer.layer

什么是 NPU?NPU 与 GPU 与 CPU 的区别

NPU 是什么?为什么它对在设备上激活生成式人工智能的过程至关重要? NPU专为人工智能设计,并与其他处理器配合工作,加快生成式人工智能体验。 这是人工智能(AI)生成式革命的开端。显而易见,为了满足各个垂直领域对生成式 AI 用例不断增长的需求和运营要求,需要一种专门用于人工智能的新计算架构。随后开始使用神经网络处理器(NPU),该处理器从一开始就旨在生成智能机器。 此外,它利用了各种处理

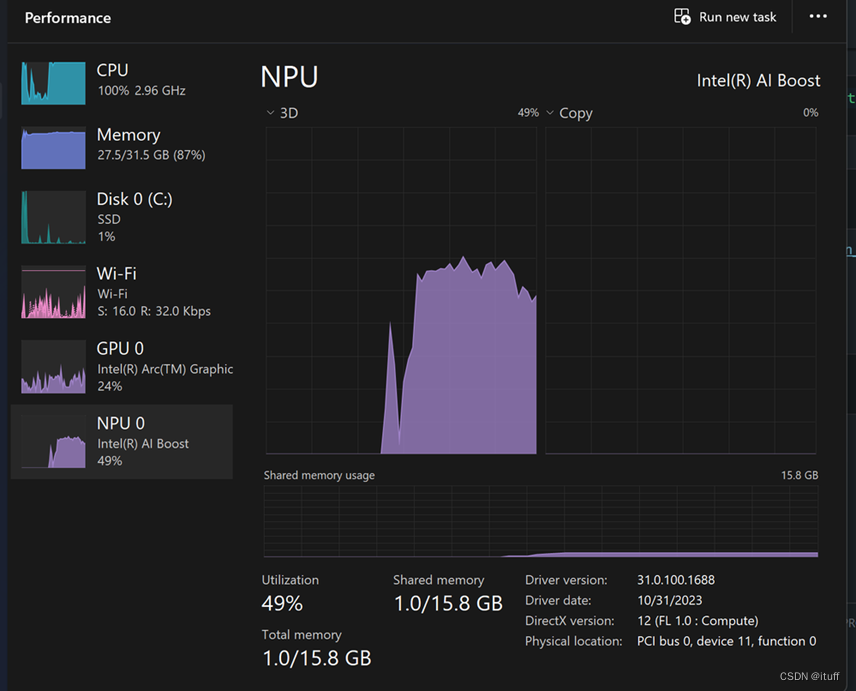

在“AI PC”中使用NPU运行 Phi-3-mini

欢迎关注我的公众号“ONE生产力”,获取更多AI、云计算资讯分享! 前段时间,我做了一系列微软Phi-3-mini小语言模型的教程,很多朋友参考教程进行了实践,其中有一个朋友反馈说模型token推理很慢,没有答道我说的可用程度。我询问了他的硬件配置,他说是才买的联想“AI PC”,配备了Intel Core Ultra 7处理器。这配置可比我用的7840HS强多了,但为何运行效果不佳呢?因为没有

FPGA第二篇,FPGA与CPU GPU APU DSP NPU TPU 之间的关系与区别

简介:首先,FPGA与CPU GPU APU NPU TPU DSP这些不同类型的处理器,可以被统称为"处理器"或者"加速器"。它们在计算机硬件系统中承担着核心的计算和处理任务,可以说是系统的"大脑"和"加速引擎"。这些处理器单元都是计算机系统中的关键组件,它们扮演着不同的角色,为计算机系统提供各种计算和处理能力。 FPGA ~ 第 2 篇 —— FPGA、CPU、GPU、AP

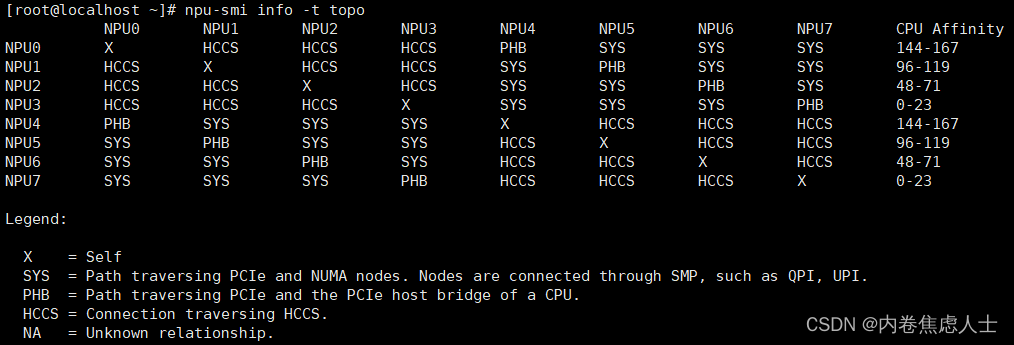

【NPU】A800-9000服务器8*Ascend 910 B的HCCS测试

HCCS集合通信带宽数据 HCCS集合通信带宽数据timeline信息在msprof_*.json文件的HCCS层级展示 summary信息在hccs_*.csv文件汇总。 支持的型号 Atlas 训练系列产品 Atlas A2训练系列产品 测试命令 npu-smi info -t topo 结果展示 NPU0 NPU1 NPU2

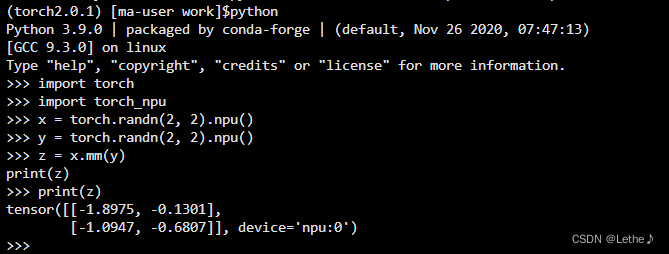

torch-npu的安装

pytorch与CANN的版本有对应关系,请查看网站: https://gitee.com/ascend/pytorch/tree/v5.0.1.1-pytorch1.11.0 根据自己选定的版本,首先安装pytorch和依赖项: # for aarch64pip3 install torch==2.0.1pip3 install pyyamlpip3 install setupto

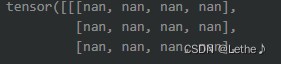

NPU float(“inf“) mask_fill 出现NAN

使用NPU时,采用mask_fill函数,会出错: tensors.masked_fill(mask.unsqueeze(-1), float('inf')) 无法直接使用表达式,会报错 NAN: 取一个较大的值替换即可; tensors.masked_fill(mask.unsqueeze(-1), float(1e10))

CPU、GPU、NPU、VPU和DPU 简介

在SoC(System on Chip)设计中,NPU、GPU、CPU、VPU和DPU是不同类型的处理器单元,它们各自针对不同的计算任务和应用场景进行了优化。下面详细介绍每一种处理器单元的特点、区别以及用途。 CPU (Central Processing Unit) 特点:CPU是通用处理器,负责执行广泛的计算任务和系统管理。它通常包括运算器、控制单元、寄存器和缓存等组件。区别:与其他专用处

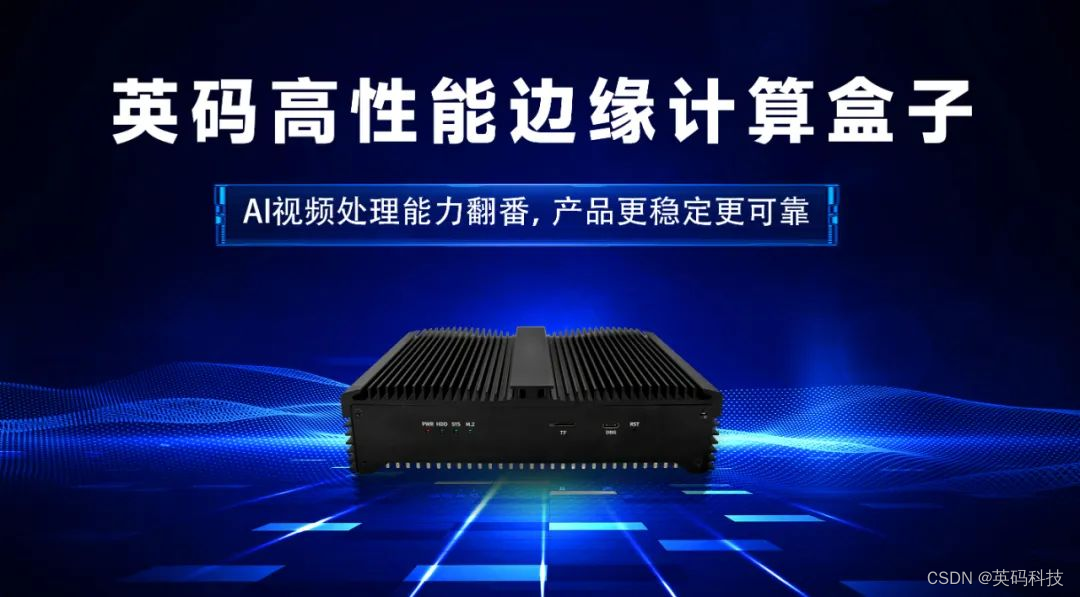

RK3588 CPU+GPU+NPU三位一体AI边缘控制器,应用于工程车辆/轨道交通+疲劳驾驶检测告警

XMS-201采用了Rockchip RK3588八核64位处理器,集成ARM Mali-G610 MP4四核GPU,内置AI加速器NPU,可提供6Tops算力,支持主流的深度学习框架;性能强劲的RK3588可为各类AI应用场景带来更强大的性能表现,适用于机器视觉、边缘计算、智能NVR、智慧大屏等领域。 RK3588处理器,作为一款业界领先的芯片,拥有强大的计算能力和高效的功耗控制。这款处理

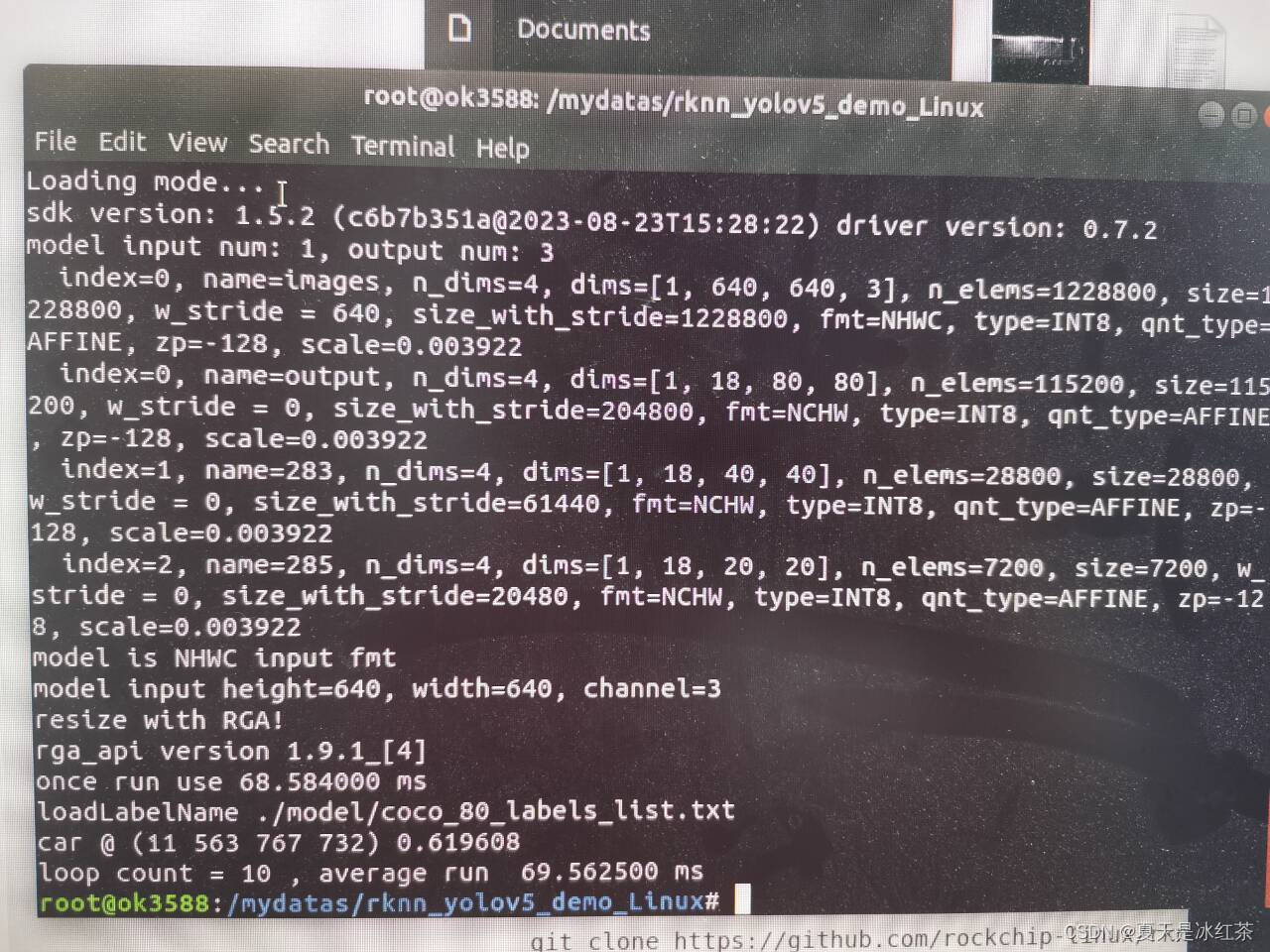

yolov5训练并生成rknn模型部署在RK3588开发板上,实现NPU加速推理

简介 RK3588是瑞芯微(Rockchip)公司推出的一款高性能、低功耗的集成电路芯片。它采用了先进的28纳米工艺技术,并配备了八核心的ARM Cortex-A76和Cortex-A55处理器,以及ARM Mali-G76 GPU。该芯片支持多种接口和功能,适用于广泛的应用领域。 本篇为yolov5部署在RK3588的教程。 一、yolov5训练数据 请选择v5.0版本:Releases

CPU、GPU、IPU、NPU、TPU、LPU、MCU、MPU、SOC、DSP、FPGA、ASIC、GPP、ECU、

CPU: 中央处理器(Central Processing Unit)是一块超大规模的集成电路,是一台计算机的运算核心(Core)和控制核心( Control Unit)。 它的功能主要是解释计算机指令以及处理计算机软件中的数据。 中央处理器主要包括运算器(算术逻辑运算单元,ALU,Arithmetic Logic Unit)和高速缓冲存储器(Cache)及实现它们之间联系的数据(Data)

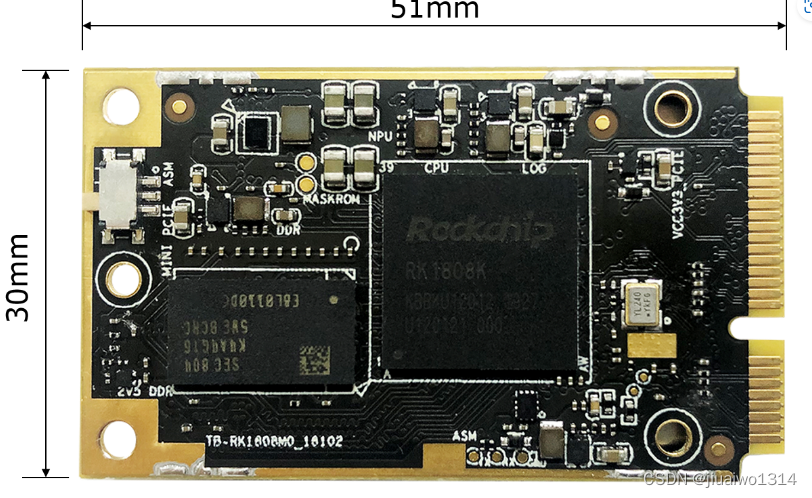

【RK3568+RV1126】NPU算力集成

通过瑞芯微RK3568使用USB RNDIS网络与多个RV1126算力棒进行网络通信,打造多算力集群,同时进行AI运算处理,NPU算力集成不仅能增加算力,更能灵活的控制成本,具有更高的性价比,更低的功耗。 Mini-PCIe接口的RV1126算力棒,单片算力可达2.0TOPS@INT8算力,最高可支持4路1080P@25fps的相机接入及解码,支持TensorFl

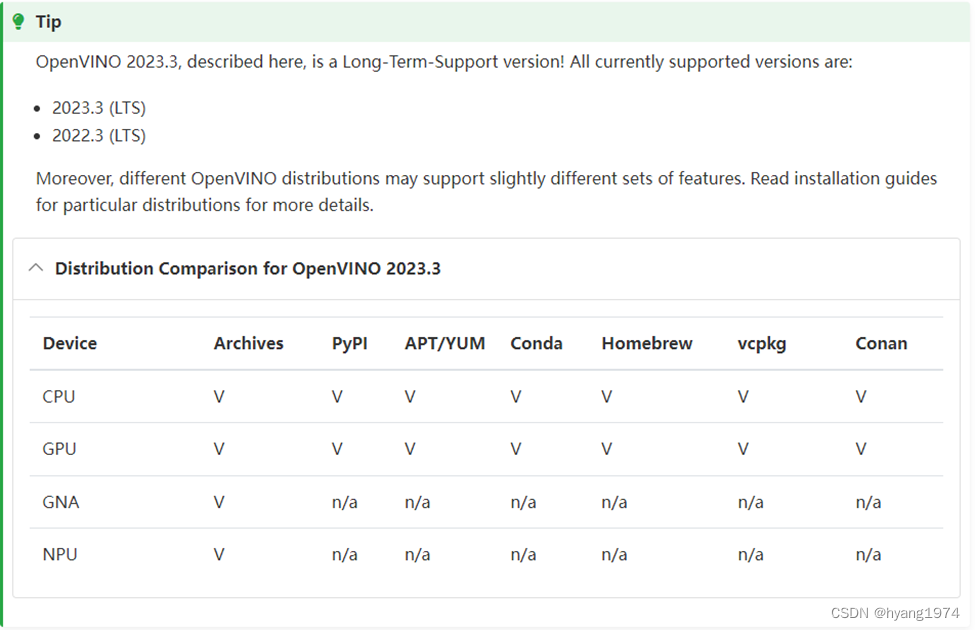

在Meteor Lake平台上使用NPU进行AI推理加速

在Meteor Lake平台上,英特尔通过神经处理单元 (NPU) 将人工智能直接融入芯片中,实现桌面电脑平台的AI推理功能。神经处理单元 (NPU) 是一种专用人工智能引擎,专为运行持续的人工智能推理工作负载而设计。与即将推出的支持深度人工智能集成的 Windows 版本(预计将于 2024 年夏季推出)搭配,Meteor Lake 可能预示着人工智能 PC 时代的开始,计算机可以利用人工智

RK3588平台开发系列讲解(AI 篇)什么是NPU

文章目录 一、什么是NPU二、什么是RKNPU 沉淀、分享、成长,让自己和他人都能有所收获!😄 📢本篇章主要讲解什么是NPU。 一、什么是NPU 📢什么是 NPU 呢? 在谈这个问题之前,可以先来看看什么是 CPU 和 GPU,CPU 就是中央处理器,中央处理器就好像是人类的大脑,主要负责各种逻辑控制和任务调度。所以 CPU的计算能力相对来说不是最强的。G

pytorch模型转换为rknn模型,使用npu推理

一、转换为onnx模型 在yolov5代码中运行export.py,转换为onnx模型,参数根据自己需要修改。 二、创建转换目录 然后在rknn文件夹下,找到onnx2rknn.py、dataset.txt和coco2017数据集,将它们复制到新的文件夹中,作为rknn模型转换目录。将需要转换的onnx模型也放在该目录中。 我的目录结构如图所示,其中第一个文件夹是已经转换成功的生成目录

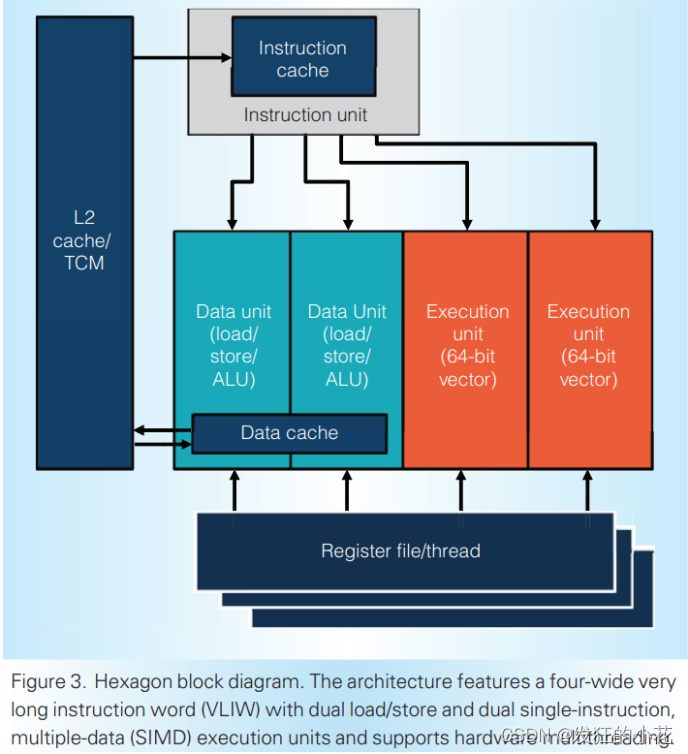

性能优化-高通的Hexagon DSP和NPU

原文来自【 Qualcomm’s Hexagon DSP, and now, NPU 】 本文主要介绍Qualcomm Hexagon DSP和NPU,这些为处理简单大量运算而设计的硬件。 🎬个人简介:一个全栈工程师的升级之路! 📋个人专栏:高性能(HPC)开发基础教程 🎀CSDN主页 发狂的小花 🌄人生秘诀:学习的本质就是极致重复! 目录 一、前言 二、High

2024 极术通讯-“周易”NPU与飞桨完成II 级兼容性测试,助力实现多样化AI部署

导读:极术社区推出极术通讯,引入行业媒体和技术社区、咨询机构优质内容,定期分享产业技术趋势与市场应用热点。 芯方向 Helium 技术讲堂 | 循环缓冲区的使用 当人工智能 (AI) 下沉到各式各样的应用当中,作为市场上最大量的物联网设备也将被赋予智能性。Arm® Helium™ 技术正是为基于 Arm Cortex®-M 处理器的设备带来关键机器学习与数字信号处理的性能提升。本文将着

学习笔记:在华为昇腾NPU上进行深度学习项目【未完待续】

在NPU上做深度学习算法 场景和功能说明系统信息查询1、场景一:非NPU上训练的模型推理1.1 执行方案学习案例 1.2 CPU/GPU训练的模型转.ONNX模型1.3 onnx转om1.4 om推理 昇腾社区链接: 昇腾社区-官网丨昇腾万里 让智能无所不及 场景和功能说明 第一种:在cpu或gpu上训练的模型,但要在NPU上执行模型推理;第二种:在NPU上同步训练、推

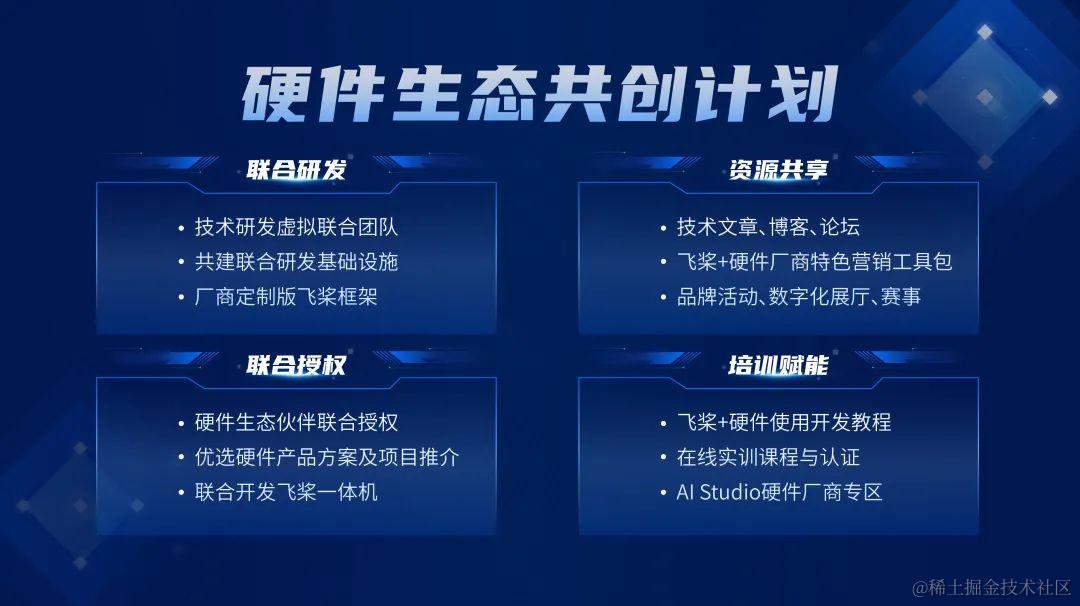

安谋科技“周易”NPU与飞桨完成II级兼容性测试,助力实现多样化AI部署

近日,安谋科技(中国)有限公司(以下简称“安谋科技”)“周易”NPU系列IP与飞桨已完成II级兼容性测试,测试结果显示,双方兼容性表现良好,整体运行稳定。这是安谋科技加入“硬件生态共创计划”后的阶段性成果。 产品兼容性证明 本次II级兼容性测试完成了对计算机视觉、智能文本处理、人像分割三大技术领域总计11个模型的验证。经过双方联合严格测试表明,安谋科技“周易”NPU系列IP在ResNet5

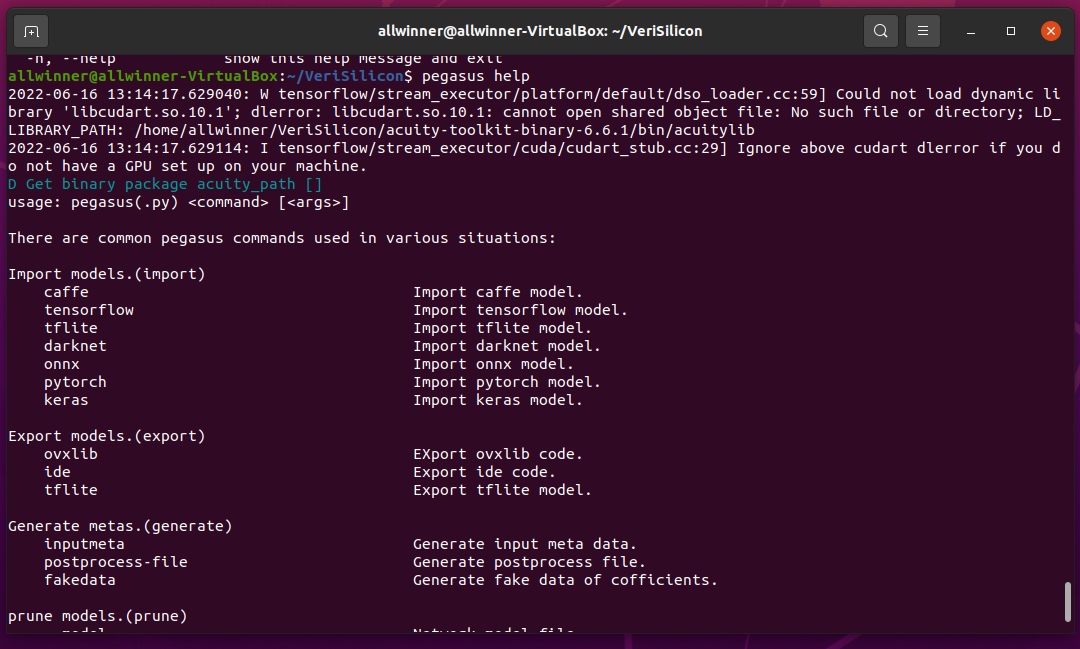

全志V853 NPU开发之工具安装

V853支持最高1T NPU算力,在进行NPU相关开发前,需要先配置NPU开发环境。 Linux系统准备 NPU开发环境依赖于Linux系统,需要先准备 Linux 开发环境。 经测试NPU 工具支持下列 Linux 发行版: Ubuntu 20.04 其他部分 Linux 发行版理论上也可以支持安装部署,但此处未作验证。 本文演示所使用的操作系统为 Ubuntu 20.04.4 LT

【技术科普】CPU、GPU、TPU、NPU分别是什么?哪个最强?

技术日新月异,物联网、人工智能、深度学习等遍地开花,各类芯片名词CPU,GPU, TPU, NPU层出不穷…它们都是什么?又有着什么千丝万缕的关系和区别? 接下来,统一介绍一下: 01 CPU CPU最早用于计算机的控制单元和运算单元,随着计算机技术的发展,CPU逐渐成为了计算机系统中最重要的部分,担负着整个计算机系统的核心任务。 CPU由多个结构组成,其中包括运算器(ALU, Arith