nerf专题

NeRF——AI生成虚拟3D场景视频

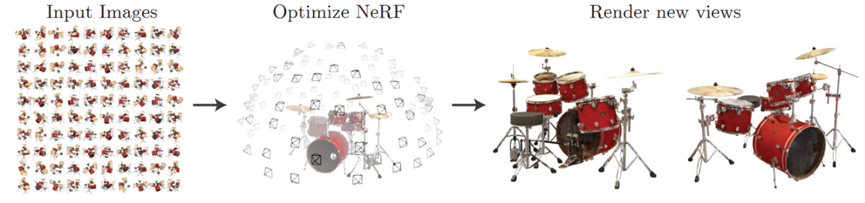

一、NeRF介绍 Neural Radiance Fields (NeRF) 是一种用于3D场景表示和渲染的新兴技术,它通过使用神经网络来模拟和生成逼真的3D场景。NeRF 的主要创新在于它能够从少量的2D图像生成高质量的3D表示,适用于计算机视觉、图形学以及虚拟现实等领域。 二、NeRF基本概念 体积渲染: NeRF 使用体积渲染技术来表示3D场景。体积渲染涉及在3D空间中采样光线,通过

NeRF: Representing Scenes as Neural Radiance Fields for View Synthesis 精读

1 传统视图合成和NeRF(Neural Radiance Fields) 1.1 联系 传统视图合成和NeRF的共同目标都是从已有的视角图像中生成新的视角图像。两者都利用已有的多视角图像数据来预测或合成从未见过的视角。 1.2 区别 1.2.1 几何表示方式 传统视图合成:通常使用显式几何模型(如深度图、网格、点云)或其他图像处理方法(如基于图像拼接或光流的方法)来生成新的视图。这些

NeRF: Representing Scenes as Neural Radiance Fields for View Synthesis 翻译

NeRF:将场景表示为用于视图合成的神经辐射场 引言。我们提出了一种方法,该方法通过使用稀疏的输入视图集优化底层连续体场景函数来实现用于合成复杂场景的新视图的最新结果。我们的算法使用全连通(非卷积)深度网络来表示场景,其输入是单个连续的5D坐标(空间位置(x,y,z)和观察方向(θ,φ)),其输出是该空间位置处的体积密度和与观察相关的发射辐射。我们通过查询沿着相机光线的5D坐标来合成视图,并使用

NeRF从入门到放弃5: Neurad代码实现细节

Talk is cheap, show me the code。 CNN Decoder 如patch设置为32x32,patch_scale设置为3,则先在原图上采样96x96大小的像素块,然后每隔三个取一个像素,降采样成32x32的块。 用这32x32个像素render feature,再经过CNN反卷积预测出96x96的像素,与真值对比。 def _patches_from_c

NeRF从入门到放弃3: EmerNeRF

https://github.com/NVlabs/EmerNeRF 该方法是Nvidia提出的,其亮点是不需要额外的2D、3Dbox先验,可以自动解耦动静field。 核心思想: 1. 动、静filed都用hash grid编码,动态filed比静态多了时间t,静态的hash编码输入是(x,y,z),动态是(x,y,z,t)。 2. 使用flow融合多帧的特征,预测当前时刻的点的前向和后向的fl

NeRF从入门到放弃2:InstantNGP

原始的NeRF每条光线上的点都要经过MLP的查询,才能得到其密度和颜色值,要查询的点非常多,而MLP的推理是比较耗时的。 InstantNGP将空间划分成多个层级的体素(voxels),并且在每个体素内部使用神经网络来预测feature。 而Plenoxels则干脆就不使用神经网络了,它直接在体素中存储场景的辐射亮度和密度信息。通过使用球谐函数(Spherical Harmonics)来近似每

【机器学习】计算机图形和深度学习模型NeRF详解(1)

1.引言 1.1.1. NeRF研究的背景 人们在拍照的时候,往往会中各个角度进行拍摄,以呈现出物体的全貌和美丽。下图的照片,拍摄的是一架楼梯,但是拍摄的角度完全不同: 我们可以看到这些图片都是楼梯的照片,但拍摄的角度不同。摄影师拍了三张照片,因为他们不确定只用一张照片就能捕捉到这么美丽的场景,担心会错过正确的视角。 于是,人们开始思考,是否存在一种方法,可以让摄影师从拍摄的有限图片中捕获

【机器学习】基于NeRF的3D动画渲染

1.引言 1.1.NeRF框架简介 1.1.1. 什么是NeRF框架 NeRF框架,全称为神经辐射场(Neural Radiance Fields)框架,是一个基于深度学习的三维场景重建和渲染技术。 基本概念: NeRF利用全连接神经网络(又称多层感知机MLP)的权重来表示3D场景。它基于辐射场概念、光线可逆及相机成像原理,通过二维图像来重建和渲染三维场景。 工作原理: NeRF从一

辐射神经场(NeRF, Neural Radiance Fields)

辐射神经场(NeRF, Neural Radiance Fields) 辐射神经场(NeRF, Neural Radiance Fields)是一种基于神经网络的方法,用于从二维图像合成高质量的三维场景。这一方法由Ben Mildenhall等人在2020年提出,利用多视角二维图像进行三维重建,生成的场景具有逼真的细节和光照效果。 NeRF的基本原理 NeRF的核心思想是通过神经网络表示场景

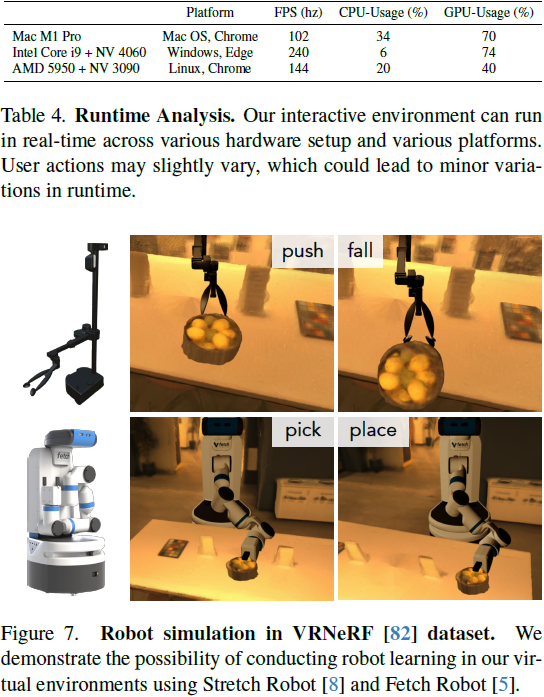

(2024,Video2Game,NeRF,Mesh,物理模块,游戏引擎)通过单个视频实现实时、交互、逼真且兼容浏览器的环境

Video2Game: Real-time, Interactive, Realistic and Browser-Compatible Environment from a Single Video 公众号:EDPJ(进 Q 交流群:922230617 或加 VX:CV_EDPJ 进 V 交流群) 目录 0. 摘要 2. 相关工作 3. Video2Game 3.1 大规模 Ne

Nerf基础学习记录

笔记 什么是nerf一些值得注意的理论点 什么是nerf Nerf 是可以理解成是一种隐式的3D表达方式。 隐式表达可以理解成是用一个条件或者方程来表示一个3D几何,没有实实在在的几何形状。相反,显式表达就诸如mesh, 点云,体素这类的,能够实实在在看到的。Nerf的网络结构非常简单,也就是一个mlp。Nerf主要的目的,就是从给到的大量照片中学习,从而可以渲染任意视角下的RG

【论文笔记】DiL-NeRF: Delving into Lidar for Neural Radiance Field on Street Scenes

原文链接:https://arxiv.org/abs/2405.00900 1. 引言 自动驾驶等应用领域需要逼真的仿真。传统的仿真流程需要手工创建3D资产并构成虚拟环境,但其人力和专业需求使其难以具有可放缩性。 NeRF有不错的仿真能力,但需要大范围覆盖的训练数据以学习潜在的几何、材料特性和光照。在自动驾驶场景中,数据覆盖很稀疏,且相机的轨迹共线。此外,路面纹理较少,进一步引入重建的模糊性

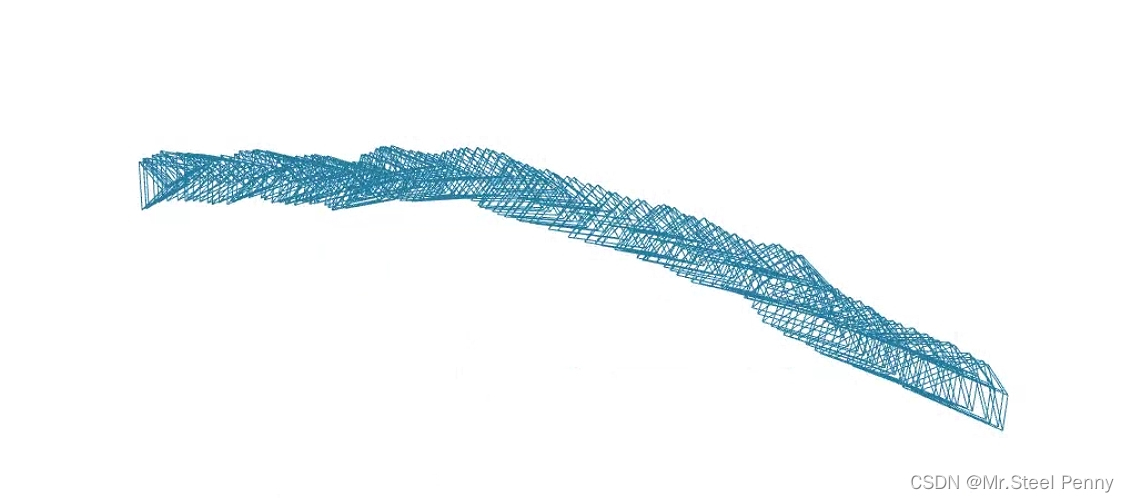

ICRA2024重磅!首个融合LiDAR的NeRF-based SLAM系统

论文标题: SiLVR: Scalable Lidar-Visual Reconstruction with Neural Radiance Fields for Robotic Inspection 论文作者: Yifu Tao1, Yash Bhalgat2, Lanke Frank Tarimo Fu1, Matias Mattamala1, Nived Chebrolu1, and

【文献解析】NeRF的原理是什么

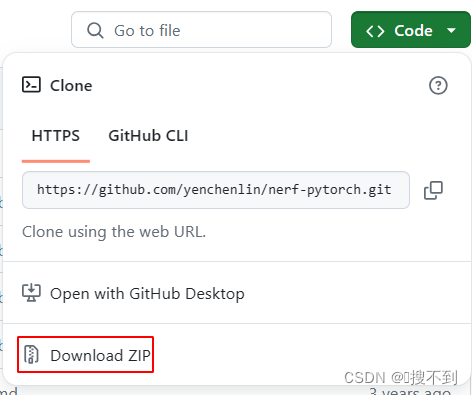

论文:https://arxiv.org/abs/2003.08934 TensorFlow代码:https://github.com/bmild/nerfPyToch代码:https://github.com/yenchenlin/nerf-pytorch 一、文章概述 1.问题导向 从新视点生成照片级真实感输出需要正确处理复杂的几何体和材质反射比属性。目前还没有一种方法可以生成照片级的

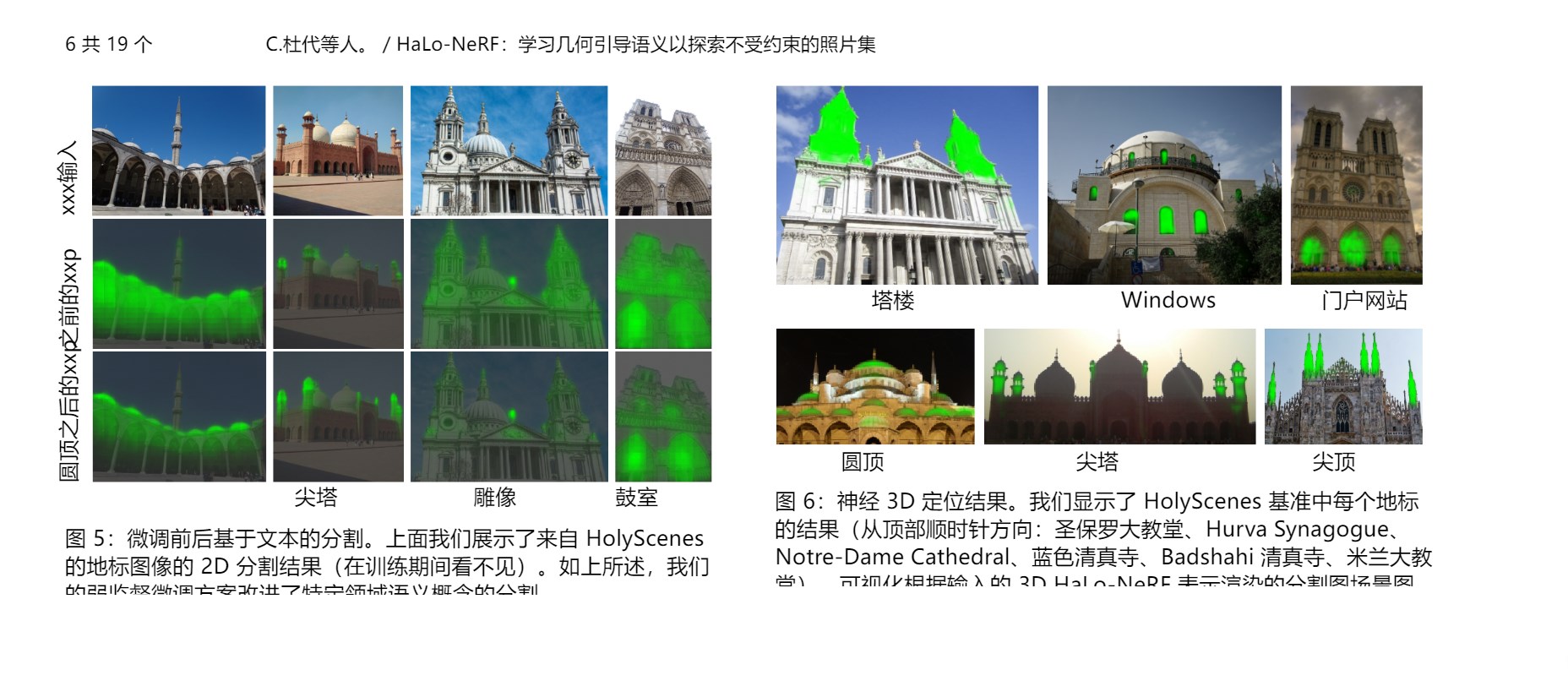

HaLo-NeRF:利用视觉和语言模型对场景的精准定位和细粒度语义理解

包含大量摄影师拍摄的照片的互联网图像集有望实现对大型旅游地标的数字探索。然而,先前的工作主要集中在几何重建和可视化上,忽略了语言在为导航和细粒度理解提供语义界面方面的关键作用。 项目:HaLo-NeRF: Learning Geometry-Guided Semantics for Exploring Unconstrained Photo Collections 更多消息:AI人工智能行业动

NeRF项目代码详解

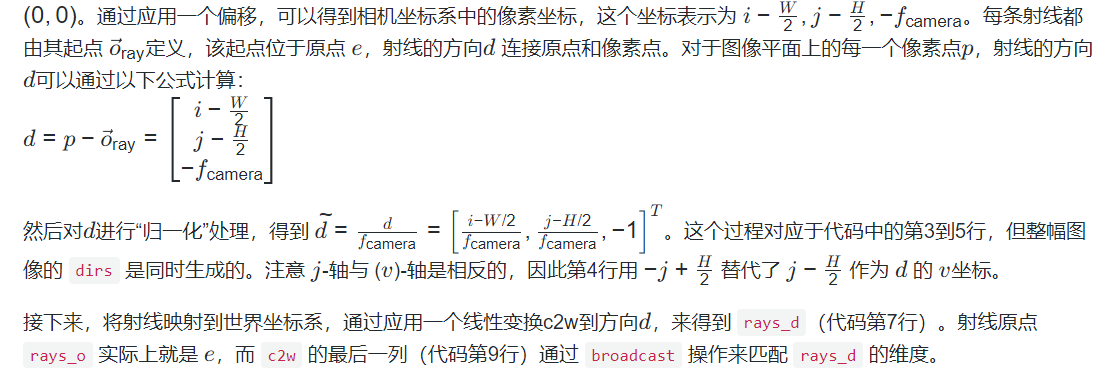

1 项目结构 开源代码:https://github.com/yenchenlin/nerf-pytorch 在上述框架图中,首先重config_parse 中读取文件参数, 然后通过load_blender加载数据,加载的数据包括训练集、验证集和测试集以及摄像机的内外参数; 在creat_nerf中通过get_embeder 获取 视线方向和三维点的位置编码,并初始化NeRF模型

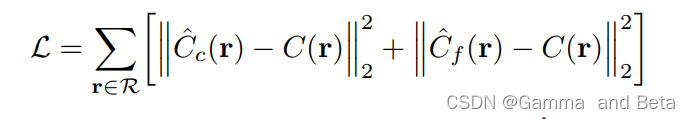

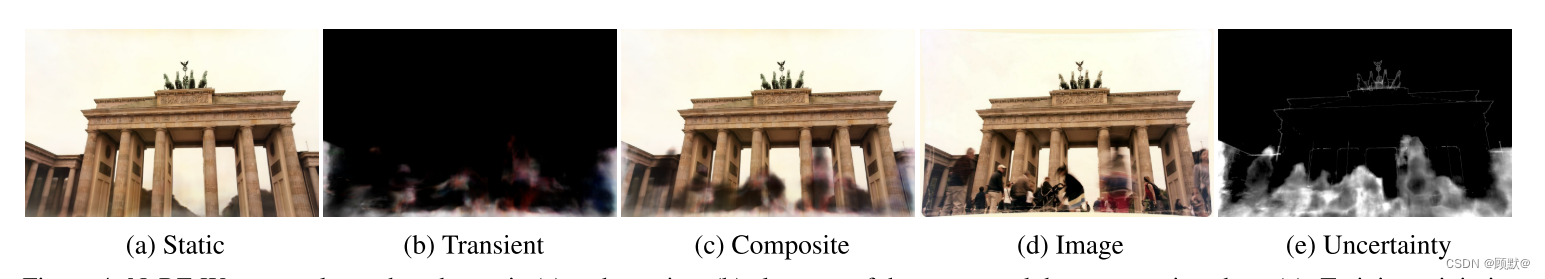

NeRF in the Wild: Neural Radiance Fields for Unconstrained Photo Collections

NeRF in the Wild: Neural Radiance Fields for Unconstrained Photo Collections(野外的 NERF: 用于无约束照片采集的神经辐射场) Abstract 我们提出了一种基于学习的方法来合成新的视图的复杂场景使用只有非结构化的收集野生照片。我们建立在神经辐射场(neRF)的基础上,它使用多层感知机的权重来模拟场景的密度和颜色

【SLAM】在Win10上实现Nerf-Pytorch【GPU版】

文章目录 ReadMe安装依赖 运行下载两个示例数据集:lego和fern训练一个低分辨率的Lego NeRF:训练一个低分辨率蕨类植物NeRF: 更多数据集预训练模型可复现 实现1、下载nerf-pytorch工程2、安装依赖3、下载数据4、运行lego NeRF: ReadMe Github链接 NeRF (神经辐射场)是一种在合成复杂场景的新颖视图方面取得最新成果的方法

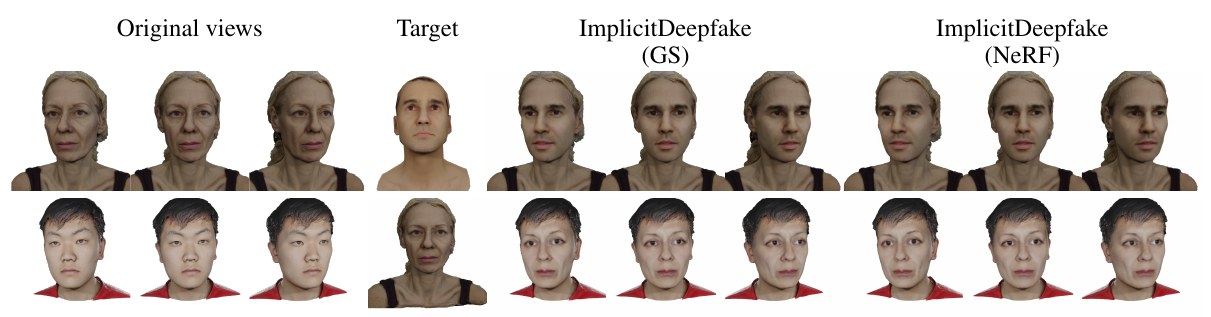

ImplicitDeepfake:通过使用NeRF和高斯溅射的隐式Deepfake生成的合理换脸

ImplicitDeepfake: Plausible Face-Swapping through Implicit Deepfake Generation using NeRF and Gaussian Splatting ImplicitDeepfake:通过使用NeRF和高斯溅射的隐式Deepfake生成的合理换脸 Georgii Stanishevskii1∗ Jakub Steczk

数字人项目 ER-NeRF 的使用和部署详细教程

文章目录 1. ER-NeRF简介2. ER-NeRF部署3. 训练自己的数字人4. 生成数字人视频常见错误 1. ER-NeRF简介 ER-NeRF(官方链接)是一个Talking Portrait Synthesis(对嘴型)项目。即:给一段某人说话的视频,再给定一段音频,经过该模型后处理后,可将原视频的嘴型与音频保持一致。 该模型的有优点: 可以做到实时响应。即模型比较

【nerf-pytorch代码】Ubuntu20.04系统环境搭建

目录 安装nvidia驱动 安装anaconda 安装CUDA 安装CUDNN 克隆nerf-pytorch代码 创建并激活虚拟环境 安装PyTorch 安装其他的库 运行DEMO 安装nvidia驱动 打开软件与更新 我选的是阿里源,也可以选清华源,都可以的。 选择适合自己的版本,先进行应用更改在进行重新启动。 然后就可以啦!真的太方便辽! 安装an

nope-nerf代码复现

代码地址 GitHub - ActiveVisionLab/nope-nerf: (CVPR 2023) NoPe-NeRF: Optimising Neural Radiance Field with No Pose Prior 进行环境配置(时间有点久,耐心等待) git clone https://github.com/ActiveVisionLab/nope-nerf.gitcd