mnn专题

MNN框架下的特征图格式问题

这两个星期在将一个手势关键点检测的Pytorch模型转化成MNN模型,转化完了之后进行测试,用的是MNN的Python接口。最开始的测试代码如下 import MNNinterpreter = MNN.Interpreter("test.mnn")session = interpreter.createSession()input_tensor = interpreter.getSessi

【mnn】——模型文件参数修改(python)

mnn, python 转载自:MNN模型文件参数修改(python) 生成python接口 这一步是通过flatc命令生成MNN模型结构的python接口。 cd MNN-master/schema/default/flatc -p --all-gen MNN.fbs 执行完之后会生成MNN文件夹,这个文件夹包含了所有解析MNN模型结构的接口。 我们回过来看看MNN.fbs里

【mnn】——模型离线量化流程代码浅析

mnn, 离线量化 1. 前言 mnn的离线量化,需要首先将其他模型转换成mnn的模型表达,再进行量化。 这里我们采用MAX_ABS进行weight权重量化,KL散度进行激活值的量化,int8对称量化。 2. Code 2.1 mnn模型读入与解析 std::unique_ptr<MNN::NetT> netT;{std::ifstream input(modelFile);st

Python- ocr识别模型(MNN模型)预测

import MNNimport cv2import numpy as npimport timedef normlize_with_pad(img, width, height, ratio):h, w = img.shape[:2] # 长边缩放为min_sideif h / w > height / width * ratio:val = int(img[-1,-1])try:img

【详细讲解MNN介绍,安装和编译】

🌈个人主页:程序员不想敲代码啊🌈 🏆CSDN优质创作者,CSDN实力新星,CSDN博客专家🏆 👍点赞⭐评论⭐收藏 🤝希望本文对您有所裨益,如有不足之处,欢迎在评论区提出指正,让我们共同学习、交流进步! MNN介绍,安装和编译 什么是MNN?MNN的特点安装和编译MNN注意事项 什么是MNN? MNN(Mobile Neural Network)是一个由阿里

MNN:轻量级深度学习推理框架的优雅之选

在深度学习领域,推理框架的选择对于模型的应用至关重要。MNN,作为阿里巴巴开源的一款轻量级深度学习推理框架,凭借其出色的性能和易用性,逐渐成为了众多开发者的首选。本文将为大家详细介绍MNN的特点、安装及编译过程,带您领略这一优雅之选的魅力。 一、MNN:轻量级推理框架的璀璨明星 MNN(Mobile Neural Network)是一款专为移动端设备设计的轻量级深度学习推理框架。它支持多种深度

MNN介绍、安装和编译

MNN是一个轻量级的深度学习推理框架,由阿里巴巴公司开发。它支持多种硬件平台,包括CPU、GPU和NPU,并提供高效、高性能的深度学习模型推理服务。下面是MNN的安装和编译步骤: 下载MNN源代码 在MNN的GitHub页面(https://github.com/alibaba/MNN)上,点击"Clone or download"按钮,然后选择合适的下载方式,如下载zip文件或使用Git命令

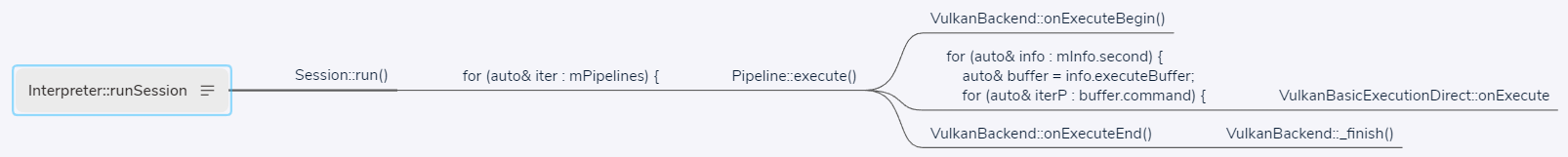

MNN 执行推理(九)

系列文章目录 MNN createFromBuffer(一) MNN createRuntime(二) MNN createSession 之 Schedule(三) MNN createSession 之创建流水线后端(四) MNN Session 之维度计算(五) MNN Session 之几何计算(六) MNN Session 之 CPU 算子(七) MNN Session 之 V

重磅| 淘宝轻量级的深度学习端侧推理引擎 MNN 开源

淘宝上的移动AI技术 现在你也可以在自己的产品中使用啦! 与 Tensorflow、Caffe2 等同时覆盖训练和推理的通用框架相比,MNN 更注重在推理时的加速和优化,解决在模型部署的阶段的效率问题,从而在移动端更高效地实现模型背后的业务。这和服务器端 TensorRT 等推理引擎的想法不谋而合。 在大规模机器学习应用中,考虑到大规模的模型部署,机器学习的推理侧计算量往往是训练

【端智能】MNN CPU性能优化年度小结

简介 2020年5月,MNN发布了1.0.0版本,作为移动端/服务端/PC均适用的推理引擎,在通用性与高性能方面处于业界领先水平。 这之后,我们并没有停止脚步,而是继续在 CPU/GPU/NPU 持续发力。其中,CPU 作为最普适易用的计算资源,我们在多种架构,多种精度模式下继续进行优化,使 MNN 整体的CPU性能进一步提升:AVX2 架构下性能提升 70%-100%,ARM / ARM

端智能研发核心套件,MNN 工作台深度解析

MNN 工作台开源地址: 开源地址:https://github.com/alibaba/MNN 背景 随着移动互联网的快速发展,人工智能在移动端上的应用越来越广泛,端智能在图像识别、视频检测、数据计算等核心场景发挥着重要作用。众所周知,Python 是算法进行端智能研发的首选语言,目前阿里巴巴内已经建立了端智能的研发生态,包含 Python 虚拟机,系列的数据/视觉等运行时 Python 扩

在Raspberry Pi 4上安装NCNN/MNN深度学习框架(aarch64+armv7l)

注意:如果尚未安装 OpenCV,请先安装它。 ncnn Raspberry 64-bit (aarch64) # check for updates (64-bit OS is still under development!)$ sudo apt-get update$ sudo apt-get upgrade# install dependencies$ sudo ap

【深度学习】MNN ImageProcess处理图像顺序,逻辑,均值,方差

文章目录 介绍Opencv numpy等效的MNN处理 介绍 MNN ImageProcess处理图像是先reisze还是后resize,均值方差怎么处理,是什么通道顺序?这篇文章告诉你答案。 Opencv numpy 这段代码是一个图像预处理函数,用于对输入的图像进行一系列处理,以便将其用于某些机器学习模型的输入。 cv2.imdecode(np.fromfile(im

香橙派--编译MNN报错,关于汇编的嵌套展开

先看报错: /home/orangepi/MNN-master/source/backend/cpu/arm/arm64/bf16/ARMV86_MNNPackedMatMulRemain_BF16.S:158: Fatal error: macros nested too deeply 再看代码: PostTreatLH8:FMAX v9, v15, v16, v17, v18FMAX

MNN学习笔记(七):修改ONNX的resize算子转换器

一、需求 最近在转换一个超分模型的时候,对应动态输入需要让模型自动推理当前层的尺度,但是Resize层在转MNN的时候,参数已经被写死,转换成功的模型没办法去自适应的匹配当前图像输入大小,超分模型的输出与预期不一致。 二、处理流程 2.1 初步定位 首先用MNN的官方工具MNNV2Basic.out,具体用法可以参考资料[1],打印出每一层的输入和输出, 然后观察输入输出的文件大小变化,可

MNN学习笔记(六):配置visual studio项目

这个其实很简单,原因是MNN项目组已经提供了编译好的库: 1.下载编译好的MNN库 下载地址为:https://github.com/alibaba/MNN/releases 下载两个文件:Source.code和MNN-WindowsX64-0.2.1.7.zip 2.在visual studio上进行配置 注意visual studio版本为2017,我习惯把这些库都跟openc

MNN学习笔记(五):caffe物体检测模型部署

1.模型转换 首先下载caffe模型,下载地址为: https://github.com/C-Aniruddh/realtime_object_recognition 然后将caffe模型转换成mnn模型: ./MNNConvert -f CAFFE --modelFile MobileNetSSD_deploy.caffemodel --prototxt MobileNetSSD_dep

MNN框架学习(四):tensorflow图像分类模型部署

1.模型转换 先下载tensorflow的模型,下载地址为: https://github.com/tensorflow/models/tree/master/research/slim 然后,使用编译好的MNN工具转换模型: ./MNNConvert -f TF --modelFile mobilenet_v1_1.0_224_frozen.pb --MNNModel mobilenet

pytorch转onnx转mnn并验证

pytorch训练的模型在实际使用时往往需要转换成onnx或mnn部署,训练好的模型需先转成onnx: import sysimport argparseimport torchimport torchvisionimport torch.onnxfrom mobilenetv2 import MobileNetV2if __name__ == '__main__':model=Mo

MNN开发环境搬砖记录

MNN是一个轻量级的深度神经网络推理引擎,在端侧加载深度神经网络模型进行推理预测。目前,MNN已经在阿里巴巴的手机淘宝、手机天猫、钉钉,优酷等20多个App中使用,覆盖直播、短视频、搜索推荐、商品图像搜索、互动营销、权益发放、安全风控等场景。此外,IoT等场景下也有若干应用。 特点 轻量性 针对端侧设备特点深度定制和裁剪,无任何依赖,可以方便地部署到移动设备和各种嵌入式设备中。iOS平台:a

【深度学习】yolov7 pytorch模型转onnx,转ncnn模型和mnn模型使用细节

文章目录 前言1.前置1.1 安装必要的库1.2 .pt 权重转ncnn 和mnn所需要的权重 2、编码C++项目1.ncnn2.mnn 总结 前言 yolov7 pytorch模型转onnx,转ncnn模型和mnn模型使用细节,记录一下 git仓库: yolov7 https://github.com/WongKinYiu/yolov7 ncnn:https://githu

2020年度开源新锐项目,MNN等你Pick!

各位小哥哥小姐姐你们好: MNN 参与了由 InfoQ 发起组织的2020年度十大开源新锐项目榜单评选活动。经过项目初筛,该项目已获得入选提名机会,下轮的冲榜,需要大家帮忙投票啦! 应该投票的选项在这☝ 现在橙子来给大家画个重点~~~ 投票入口(或扫描下方二维码): https://www.infoq.cn/talk/sQ7eKfv1KW1A0kUafBgv 投票编号:27号 MNN 投票

聊一聊MNN在端智能生态中的应用

前言 2019年5月,淘系技术开源了深度学习推理引擎MNN,加入到人工智能开源社区中来。自打开源起,MNN就一直是开源社区的性能标杆之一,是众多后来者的挑战的目标。这固然是来自行业的认可,却也拉开了推理引擎间的性能军备竞赛。这或多或少,背离了我们的初心 —— 人工智能只是工具,靠比拼工具在一时一地的优劣,不能帮助我们繁荣AI应用生态。 帮助MNN不断成长的,除了我们在性能上的不断压榨,还有众

淘系专家带你初探端智能与MNN(上篇)

作者|舒会(玄裳) 出品|阿里巴巴新零售淘系技术部 关注「淘系技术」微信公众号,回复“MNN”即可获取两次直播完整版 PPT 及视频回放链接;点击下方「阅读原文」获取 MNN 开源地址,欢迎大家 star 我们哦~ 舒会(玄裳) MNN 项目核心负责人之一阿里巴巴淘系技术高级技术专家先后任职于美国 Amazon、GoogleGoogle ML Kit Founding Members之

深度学习推理引擎:MNN pk TNN

前阵子腾讯新推理引擎TNN发布:推理引擎新选择,腾讯优图开源TNN,ncnn的性能升级版,公开PK了阿里的MNN。近日,MNN开发团队对此测评进行了友好而又不失水准的回应。 本文转载自淘系技术。 每当有深度学习框架开源时,我们也和广大的吃瓜群众一样,期冀着是不是能有一波新的浪潮,把端侧AI托上一个新的高度。但同时,出于同行们对MNN的认可,我们几乎每一次都会在对比的榜单上出镜,有时甚至是唯一竞