本文主要是介绍MNN开发环境搬砖记录,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

MNN是一个轻量级的深度神经网络推理引擎,在端侧加载深度神经网络模型进行推理预测。目前,MNN已经在阿里巴巴的手机淘宝、手机天猫、钉钉,优酷等20多个App中使用,覆盖直播、短视频、搜索推荐、商品图像搜索、互动营销、权益发放、安全风控等场景。此外,IoT等场景下也有若干应用。

特点

轻量性

- 针对端侧设备特点深度定制和裁剪,无任何依赖,可以方便地部署到移动设备和各种嵌入式设备中。

- iOS平台:armv7+arm64静态库大小5MB左右,链接生成可执行文件增加大小620KB左右,metallib文件600KB左右。

- Android平台:so大小500KB左右,OpenCL库300KB左右,Vulkan库300KB左右。

通用性

- 支持

Tensorflow、Caffe、ONNX等主流模型文件格式,支持CNN、RNN、GAN等常用网络。 - 支持 149 个

TensorflowOp、47 个CaffeOp、74 个ONNXOp;各计算设备支持的MNN Op数:CPU 110个,Metal 55个,OpenCL 29个,Vulkan 31个。

- 支持iOS 8.0+、Android 4.3+和具有POSIX接口的嵌入式设备。

- 支持异构设备混合计算,目前支持CPU和GPU,可以动态导入GPU Op插件,替代CPU Op的实现。

高性能

- 不依赖任何第三方计算库,依靠大量手写汇编实现核心运算,充分发挥ARM CPU的算力。

- iOS设备上可以开启GPU加速(Metal),常用模型上快于苹果原生的CoreML。

- Android上提供了

OpenCL、Vulkan、OpenGL三套方案,尽可能多地满足设备需求,针对主流GPU(Adreno和Mali)做了深度调优。 - 卷积、转置卷积算法高效稳定,对于任意形状的卷积均能高效运行,广泛运用了 Winograd 卷积算法,对3x3 -> 7x7之类的对称卷积有高效的实现。

- 针对ARM v8.2的新架构额外作了优化,新设备可利用半精度计算的特性进一步提速。

易用性

- 有高效的图像处理模块,覆盖常见的形变、转换等需求,一般情况下,无需额外引入libyuv或opencv库处理图像。

- 支持回调机制,可以在网络运行中插入回调,提取数据或者控制运行走向。

- 支持只运行网络中的一部分,或者指定CPU和GPU间并行运行。

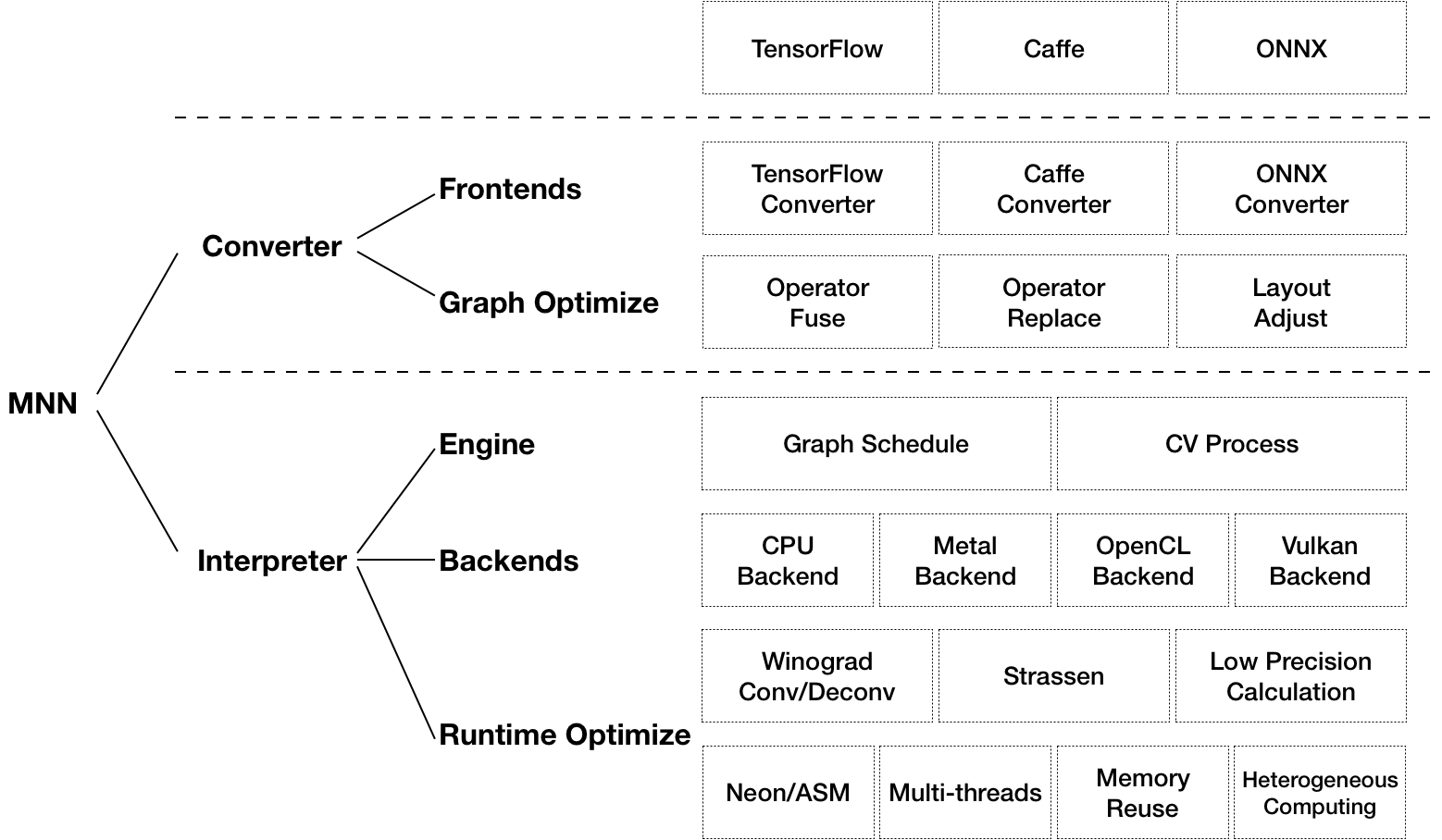

架构设计

MNN可以分为Converter和Interpreter两部分。

Converter由Frontends和Graph Optimize构成。前者负责支持不同的训练框架,MNN当前支持Tensorflow(Lite)、Caffe和ONNX(PyTorch/MXNet的模型可先转为ONNX模型再转到MNN);后者通过算子融合、算子替代、布局调整等方式优化图。

Interpreter由Engine和Backends构成。前者负责模型的加载、计算图的调度;后者包含各计算设备下的内存分配、Op实现。在Engine和Backends中,MNN应用了多种优化方案,包括在卷积和反卷积中应用Winograd算法、在矩阵乘法中应用Strassen算法、低精度计算、Neon优化、手写汇编、多线程优化、内存复用、异构计算等。

MNN使用工作流:

在端侧应用MNN,大致可以分为三个阶段,分别是训练,模型转换和推理。虽然MNN也提供了训练模型的能力,但主要用于端侧训练或模型调优。在数据量较大时,依然建议使用成熟的训练框架,如TensorFlow、PyTorch等。除了自行训练外,也可以直接利用开源的预训练模型。

这里记录如何在UBUNTU18.04上将其跑起来

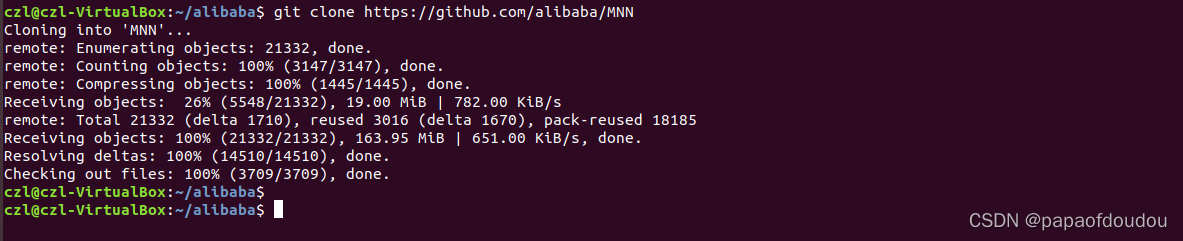

获取代码:

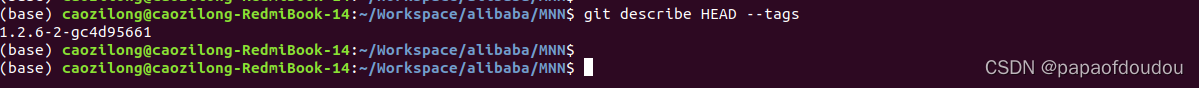

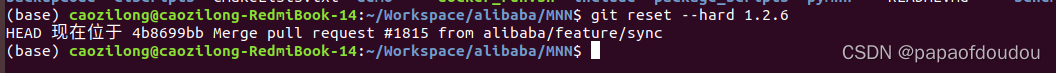

为了避免节外生枝,我们选择一个距离最新版最近的TAG,可以看到最新版距离最近的TAG 1.2.6有两个提交,我们就用1.2.6.

配置

进入MNN 顶层目录,执行:

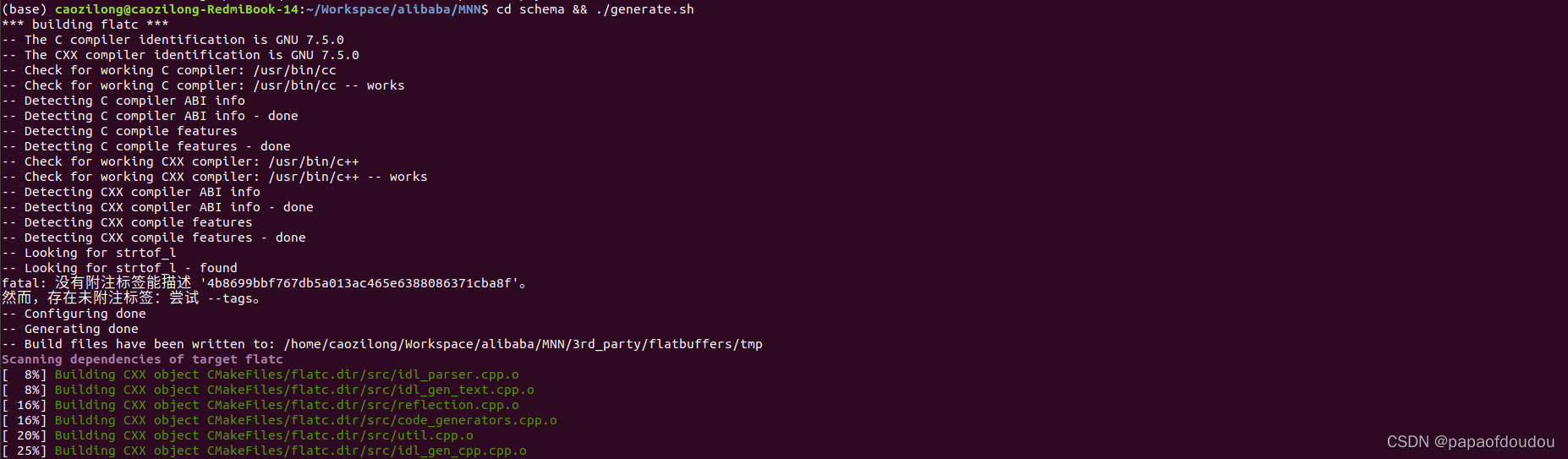

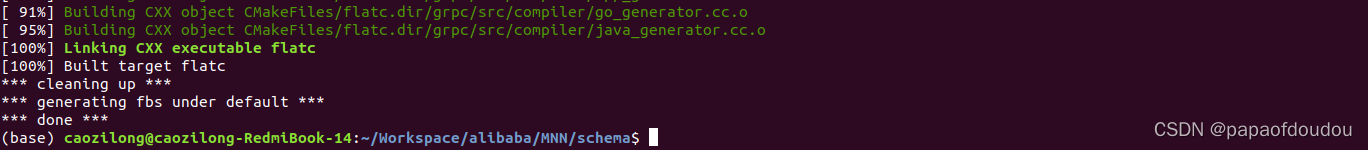

cd schema && ./generate.sh

编译

进入顶层目录:

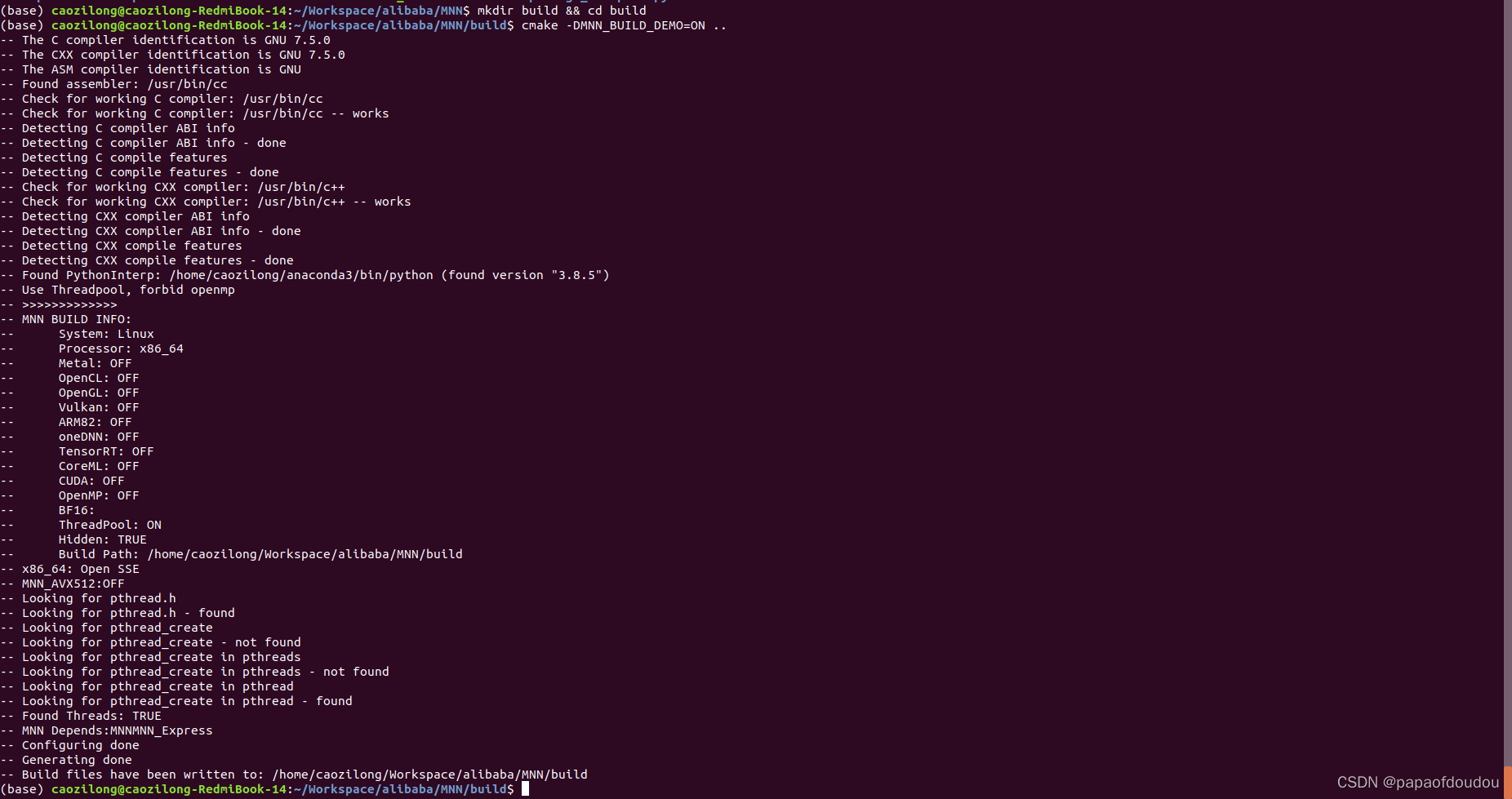

mkdir build && cd build

cmake -DMNN_BUILD_DEMO=ON ..

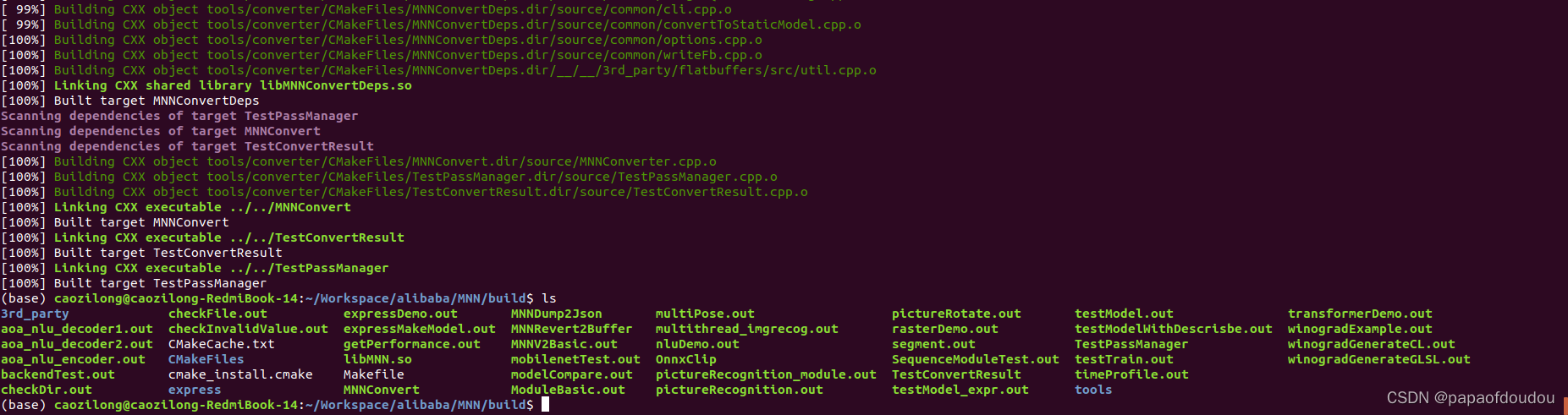

make -j8

执行编译:

模型转换

使用一个姿态转换模型 https://github.com/czy2014hust/posenet-python/raw/master/models/model-mobilenet_v1_075.pb

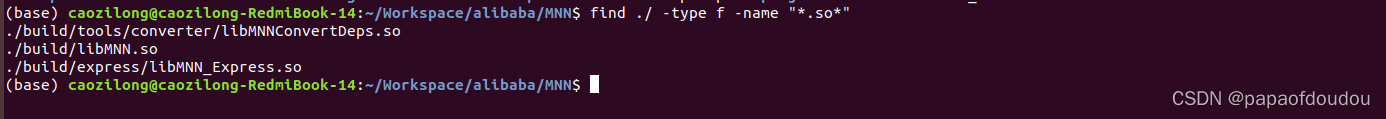

编译模型转换工具:

cd MNN/

./schema/generate.sh

mkdir build

cd build

cmake .. -DMNN_BUILD_CONVERTER=true && make -j4

这里生成了模型转换工具,其实这一步可以和上面合起来一起做,第一次操作不太懂,走一些弯路反而会增进了解。编译后的目录除了生成可执行程序之外,还生成了一些动态库,可能是为了方便二次开发。

模型转换,模型转换用例在:MNN/demo/exec/multiPose.cpp文件

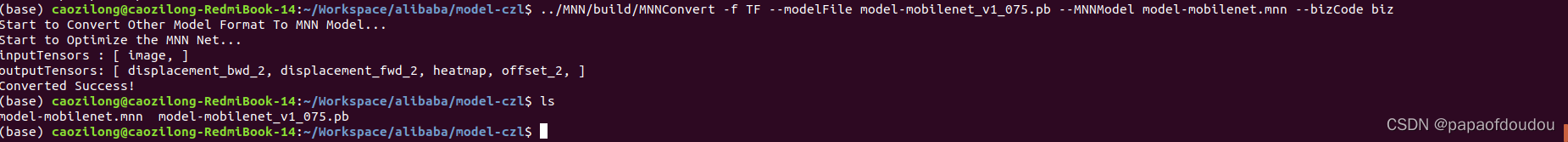

在模型目录下输入如下命令

../MNN/build/-f TF --modelFile model-mobilenet_v1_075.pb --MNNModel model-mobilenet.mnn --bizCode biz

转换结果如上图,接下来进行验证:

在build目录下,输入命令:

./multiPose.out ../../model-czl/model-mobilenet.mnn /home/caozilong/Workspace/pt/beauty.jpeg pos.png运行得到的结果图像pose.png我们打开它,可以看到关键点都被正确标注出来。

语义分割模型:

语义分割模型:

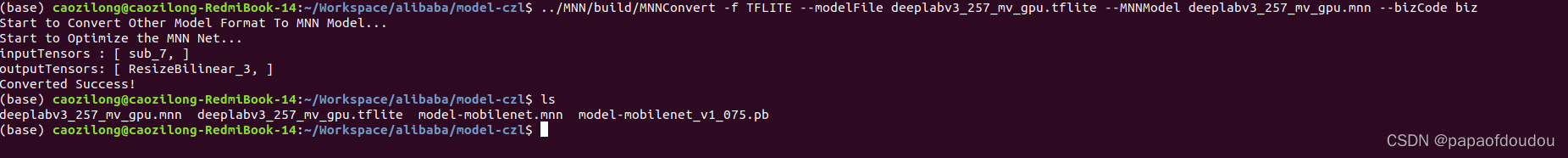

测试代码是从这里./MNN/demo/exec/segment.cpp, 下载原始模型文件,之后转换:

https://storage.googleapis.com/download.tensorflow.org/models/tflite/gpu/deeplabv3_257_mv_gpu.tflite![]() https://storage.googleapis.com/download.tensorflow.org/models/tflite/gpu/deeplabv3_257_mv_gpu.tflite

https://storage.googleapis.com/download.tensorflow.org/models/tflite/gpu/deeplabv3_257_mv_gpu.tflite

执行命令:

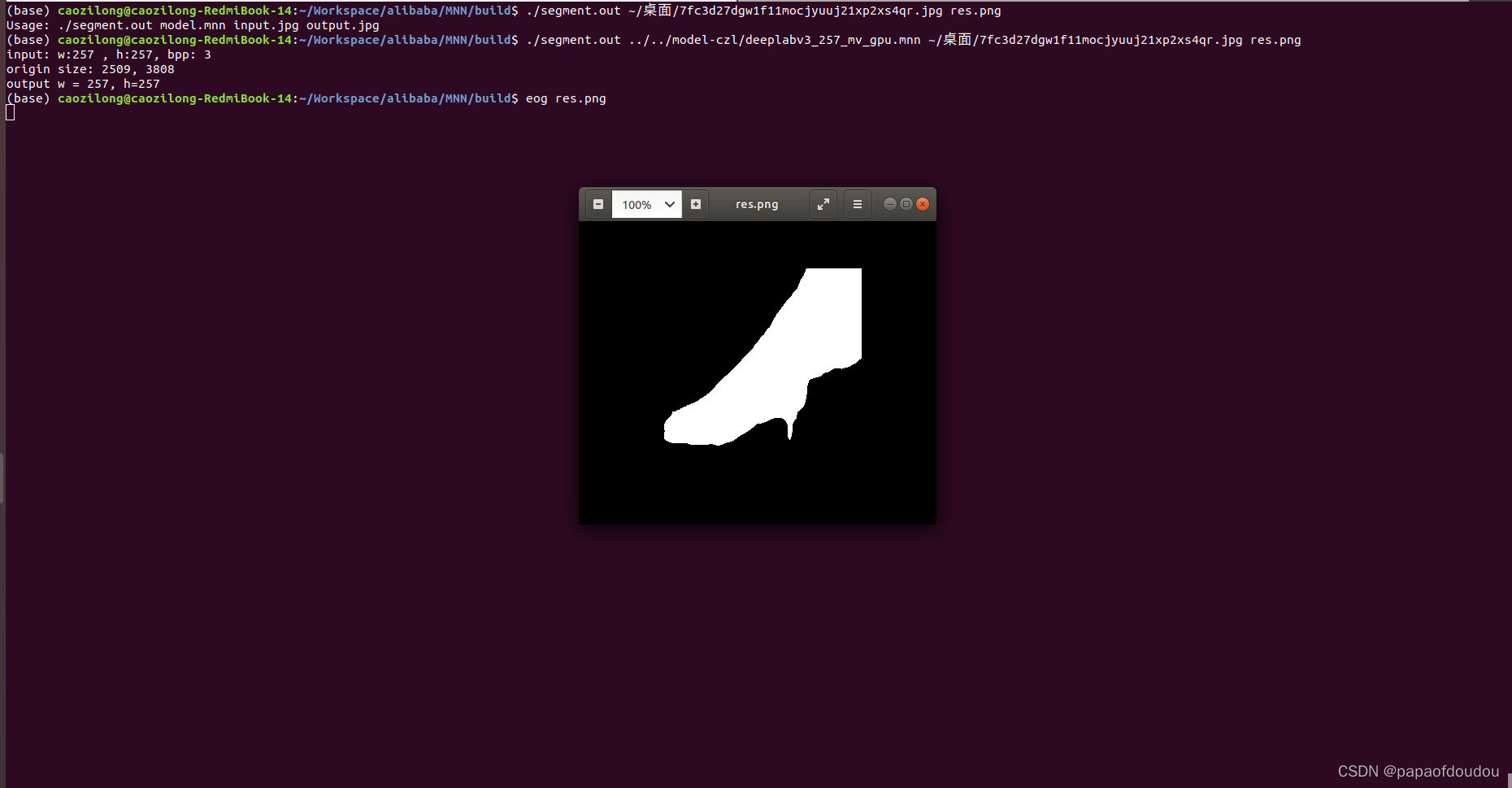

./segment.out ../../model-czl/deeplabv3_257_mv_gpu.mnn ~/桌面/7fc3d27dgw1f11mocjyuuj21xp2xs4qr.jpg res.png

图像识别模型:

下载模型:

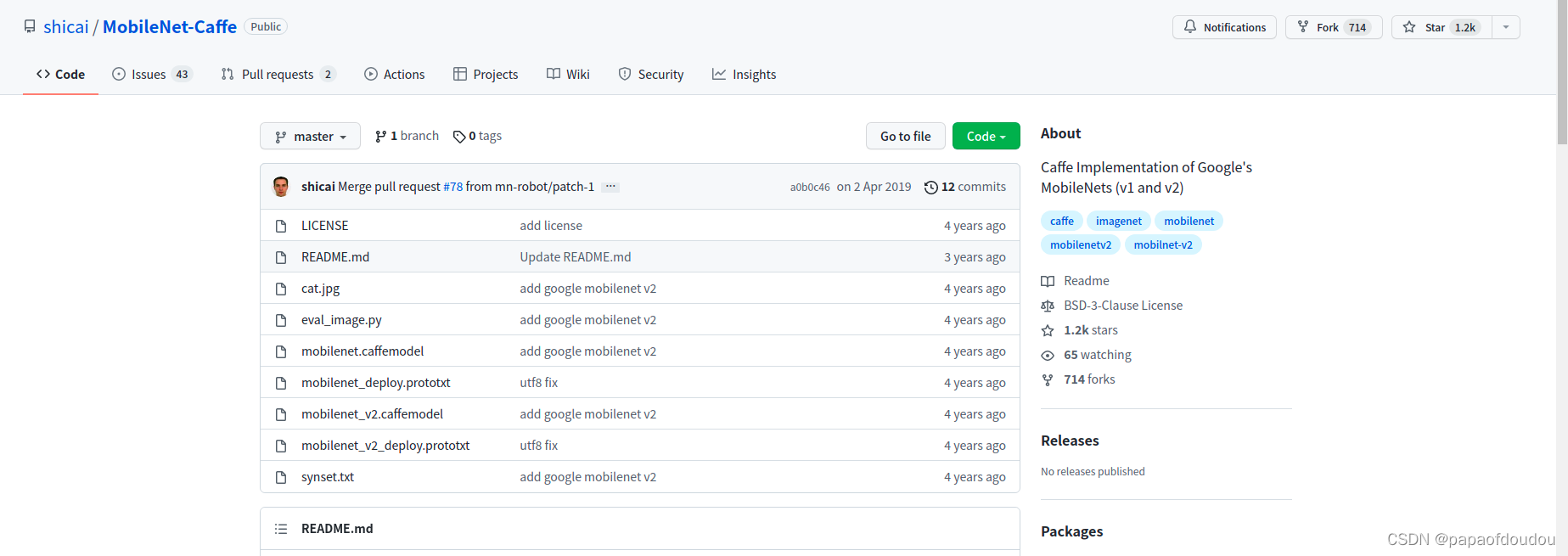

git clone https://github.com/shicai/MobileNet-Caffe

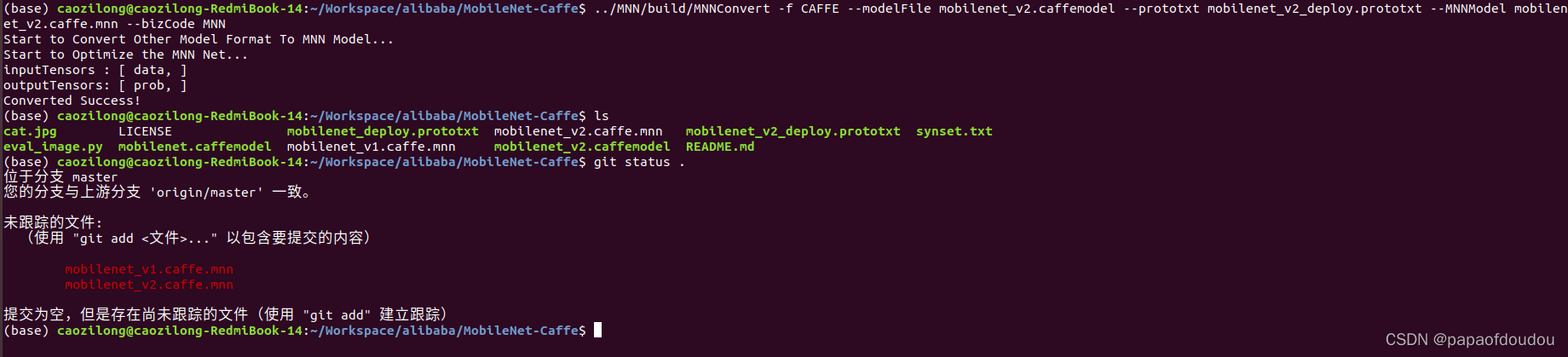

转换模型:

使用模型,原图:

检测结果

mobilenet是个分类网络,最后一层是softmax层,分别计算出十种分类的概率,下图可以看出,右边的列表示的小数是属于左边目标类别的概率。

总结

MNN全套工具环境使用的是Native ELF的开发方式,每个工具都是ELF文件,这一点和NCNN是共同的。本人一直使用底层语言开发,不太喜欢(擅长)脚本语言编程,这么说应该会暴露年龄了吧。:)

参考文档:

示例工程 · 语雀

结束!

这篇关于MNN开发环境搬砖记录的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!