dehazing专题

去雾笔记01-SRKTDN: Applying Super Resolution Method to Dehazing Task

文章目录 Abstract1. Introduction2. Related Work3. Method3.1. Network Architecture Abstract 们提出了一种结合超分辨方法和知识转移方法的模型。我们的模型由一个教师网络、一个去雾网络和一个超分辨率网络组成。 1. Introduction ECNU KT团队提出了一个知识蒸馏[20]模型,即知识转

FFA-Net: Feature Fusion Attention Network for Single Image Dehazing (AAAI 2020)用于单图像去叠的特征融合注意力网络

用于单图像去叠的特征融合注意力网络 https://arxiv.org/pdf/1911.07559.pdf Xu Qin1*Zhilin Wang2∗Yuanchao Bai1Xiaodong Xie1†Huizhu Jia1 1School of Electronics Engineering and Computer Science, Peking University 2School

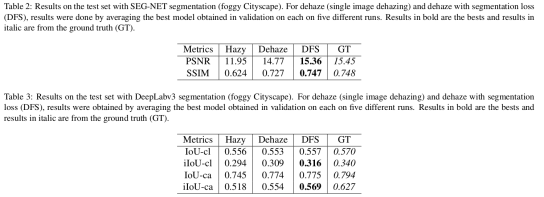

论文笔记(七):DFS--Learning of Image Dehazing Models for Segmentation Tasks

Abstract 为了评估它们的性能,现有的除雾方法通常依赖于所产生的距离测量形象及其相应的基本事实。尽管能够产生视觉上良好的图像,但是使用基于像素或甚至感知的度量通常不能保证所产生的图像适合用作诸如分割的低级计算机视觉任务的输入。为了克服这个弱点,我们提出了一种新颖的端到端图像去雾方法,适合用作图像分割程序的输入,同时保持生成图像的视觉质量。受Generative Adversarial

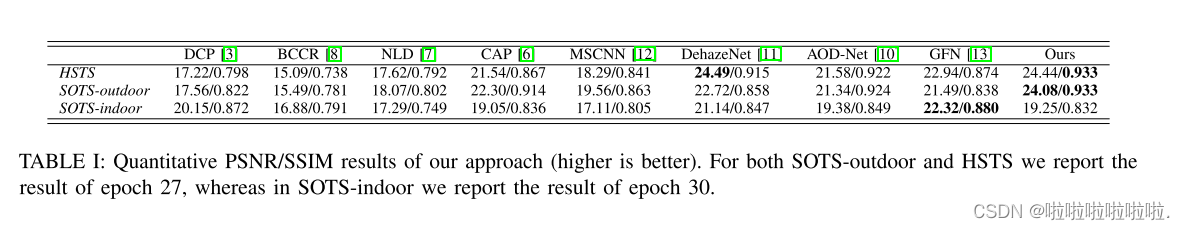

Unsupervised Single Image Dehazing Using DarkChannel Prior Loss(使用暗通道先验损失的无监督单图像去雾)

概述: 由于收集匹配的清晰和模糊图像的固有限制,基于先验和基于学习的方法诉诸于综合数据的训练; 由室内图像和相应的深度信息构建。在处理室外场景时,这可能会导致域转移。我们提出了一种通过最小化众所周知的暗通道先验 (DCP) 能量函数的完全无监督的训练方法。我们不使用合成数据向网络提供,而是仅使用真实世界的户外图像,并通过直接最小化DCP来调整网络的参数。尽管我们的 “深度DCP”

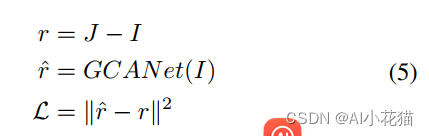

Gated Context Aggregation Network for Image Dehazing and Deraining(GCANet)

1 总体概述 GCANet是端到端去雾的一篇代表性的文章,它摒弃以往使用手工设计的先验以及大气散射模型的使用,直接通过原始有雾图像估计出无雾图像J与有雾图像I之间的残差,图像恢复阶段直接使用网络输出的残差与输入有雾图像I之间的加和完成去雾过程。 文章本身最大的贡献: 1、借鉴并使用了平滑空洞卷积消除以往空洞卷积存在的网格伪影以及特征相关性不强的问题,提出了一个门限子网络,用于依据不同level

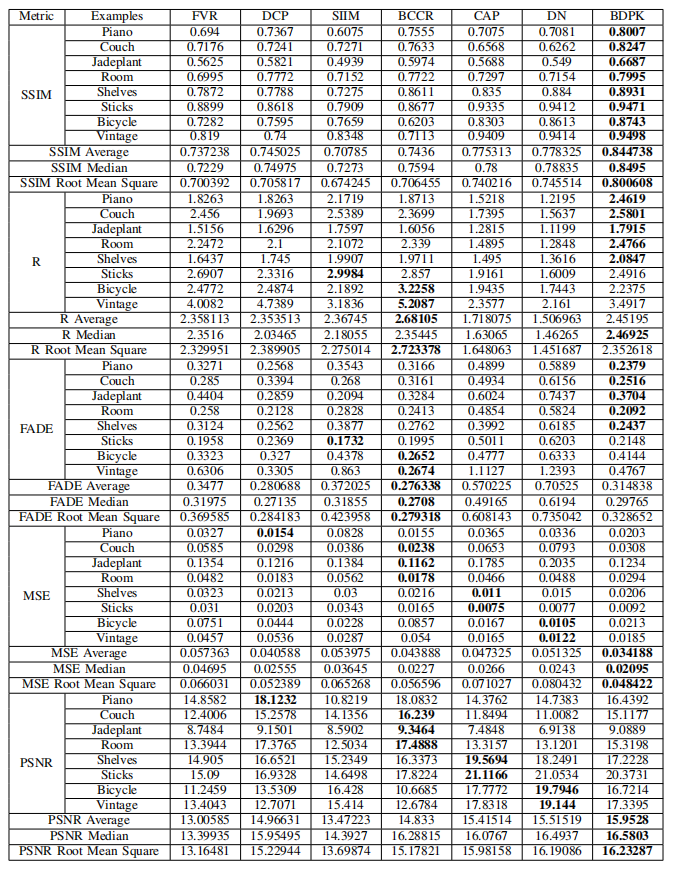

BDPK: Bayesian Dehazing Using Prior Knowledge (翻译)

BDPK: Bayesian Dehazing Using Prior Knowledge (翻译) 摘要 — 大气散射模型(ASM)在模糊图像恢复中得到了广泛的应用。然而,当输入的模糊图像不能完全满足模型假设的均匀大气甚至光照条件时,恢复的反射率可能会偏离真实场景。在本文中,我们打破了这些限制,重新定义了一个更可靠的ASM (RASM),它非常适合各种实际场景。在RASM的基础上,我们提出了一

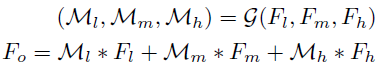

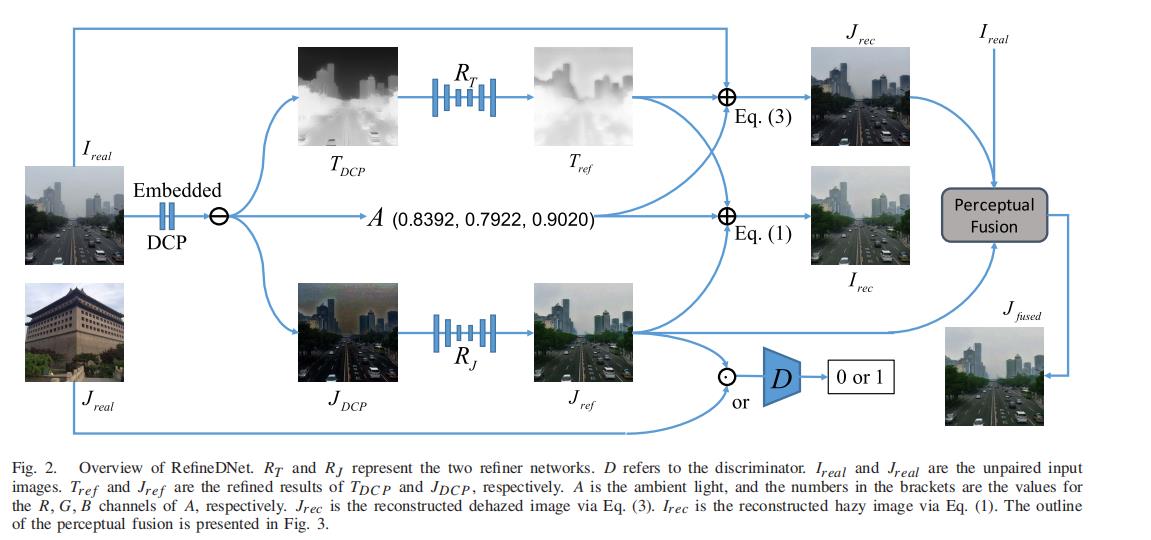

RefineDNet: A Weakly Supervised Refinement Framework for Single Image Dehazing弱监督框架

我们提出了一个两阶段的弱监督dehazing框架,RefineDNet。 在第一阶段,RefineDNet在恢复可见性之前采用暗通道-----恢复可见性 在第二阶段,对结果细化,通过使用未配对的雾状清晰图像进行对抗性学习--------提高真实性(只需要去除伪影—弱监督) 为了得到更合格的结果,我们还提出了一种有效的感知融合策略来融合不同的去杂输出。 基于学习的视觉效果好,基于先验的去雾效果好。

论文翻译:Single Image Dehazing via Conditional Generative Adversarial Network

摘要 本文提出了一种从模糊图像中直接恢复清晰图像的算法。这个问题是高度不适定的,大多数现有的算法往往使用手工制作的特征,如暗通道,颜色差异,最大对比度。与此相反,我们基于条件生成反求网络(cGAN)来解决这一问题,其中清晰图像由端到端的可训练神经网络来估计。与基本cGAN中的生成网络不同,我们提出了一种编码器和解码器结构,使其能产生更好的结果。为了生成逼真清晰的图像,我们进一步修改了基本的cGA

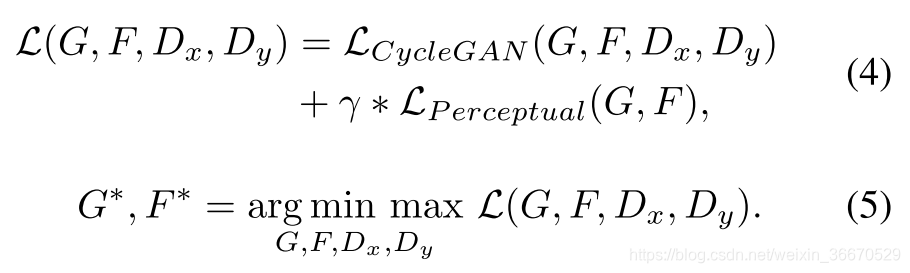

Cycle-Dehaze: Enhanced CycleGAN for Single Image Dehazing

摘要 在这篇文章中,我们提出了一个端到端的网络,称为Cycle-Dehaze,为单一图像去雾问题,它配对的有雾图像和其对应的图像进行训练。也就是说,我们通过以不成对的方式加入干净和模糊的图像来训练网络。此外,所提出的方法不依赖于大气散射模型参数的估计。我们的方法通过结合循环一致性和感知损失来增强CycleGAN方法,以提高纹理信息恢复的质量,并生成视觉上更好的无雾霾图像。典型地,用于去雾的深度学

GCANet(Gated Context Aggregation Network for Image Dehazing and Deraining)图像去雾去雨

雾化处理可以由以下模型表示(corruption model): I ( x ) :有雾的图片 J ( x ) :去雾的图片 A : 全球大气光 t ( x ) :中间的转换映射,取决于未知的深度信息,介质透射图 以往的去雾方法是用回归方法加上人为设计的先验条件来估计A或t(x),但问题是现实中这两项很难得到。该论文中使用的方式是直接学习原图和雾图之间的残差。

《RefineDNet: A Weakly Supervised Refinement Framework for Single Image Dehazing》论文阅读

《RefineDNet: A Weakly Supervised Refinement Framework for Single Image Dehazing》论文阅读 文章目录 《RefineDNet: A Weakly Supervised Refinement Framework for Single Image Dehazing》论文阅读论文简介摘要介绍本文主要贡献 提出的网络框架