本文主要是介绍时序预测 | Matlab基于BiTCN-LSTM双向时间卷积长短期记忆神经网络时间序列预测,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

时序预测 | Matlab基于BiTCN-LSTM双向时间卷积长短期记忆神经网络时间序列预测

目录

- 时序预测 | Matlab基于BiTCN-LSTM双向时间卷积长短期记忆神经网络时间序列预测

- 预测效果

- 基本介绍

- 程序设计

- 参考资料

预测效果

基本介绍

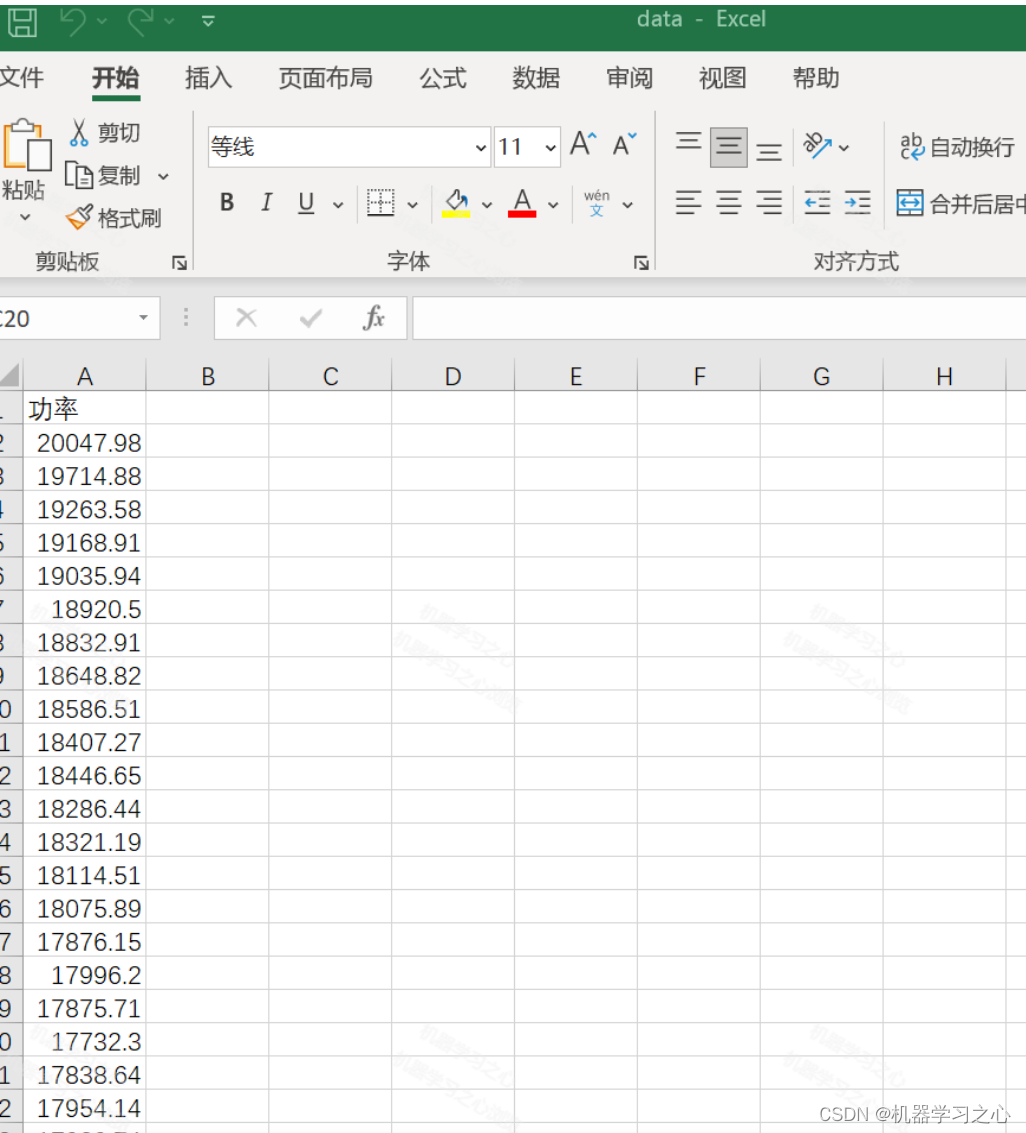

1.Matlab基于BiTCN-LSTM双向时间卷积长短期记忆神经网络时间序列预测(完整源码和数据),单变量时间序列预测,运行环境matlab2023及以上,excel数据,方便替换;

2.评价指标RMSE、MAPE、MAE、MSE、R2等;

3.程序语言为matlab,程序可出预测效果图,误差分析图。

4.代码特点:参数化编程、参数可方便更改、代码编程思路清晰、注释明细。

BiTCN-LSTM(双向时间卷积长短期记忆神经网络)是一个结合了时间卷积网络(Temporal Convolutional Networks, TCN)和长短时记忆网络(Long Short-Term Memory, LSTM)的混合模型,专门设计用于处理时间序列预测任务。该模型试图通过结合两种强大的深度学习架构来捕捉时间序列数据中的长期和短期依赖关系。

双向时间卷积网络(Bi-directional TCN):

TCN 使用因果卷积(Causal Convolutions)来处理时间序列数据,并通过膨胀卷积(Dilated Convolutions)来增加感受野(Receptive Field),从而捕捉长期依赖关系。

双向TCN则允许模型在两个方向上(正向和反向)同时处理时间序列数据,这有助于捕捉更多的上下文信息。

长短时记忆网络(LSTM):

LSTM 是一种特殊的循环神经网络(RNN),通过引入记忆单元和门控机制来解决传统RNN在处理长期依赖时的梯度消失和梯度爆炸问题。

LSTM 能够学习并记住时间序列数据中的长期依赖关系,并将其用于预测任务。

结合这两种技术,BiTCN-LSTM 能够更有效地处理复杂的时间序列预测问题。它首先通过双向TCN捕捉时间序列数据中的局部特征和长期依赖关系,然后将这些特征传递给LSTM进行进一步的处理和预测。

这种混合模型在处理具有复杂动态和长期依赖的时间序列数据时可能表现出优越的性能。然而,它也需要更多的计算资源和调参技巧来充分发挥其潜力。

需要注意的是,虽然 BiTCN-LSTM 在理论上看起来很有前途,但在实际应用中,其性能和效果还需要根据具体的任务和数据集进行验证和调整。同时,该模型可能并不是所有时间序列预测任务的最佳选择,因此在选择模型时需要仔细考虑任务的特点和需求。

程序设计

- 完整源码和数据获取方式资源出下载Matlab基于BiTCN-LSTM双向时间卷积长短期记忆神经网络时间序列预测 。

% 添加残差块到网络lgraph = addLayers(lgraph, layers);% 连接卷积层到残差块lgraph = connectLayers(lgraph, outputName, "conv1_" + i);% 创建 TCN反向支路flip网络结构Fliplayers = [FlipLayer("flip_" + i) % 反向翻转convolution1dLayer(1, numFilters, Name = "convSkip_"+i); % 反向残差连接convolution1dLayer(filterSize, numFilters, DilationFactor = dilationFactor, Padding = "causal", Name="conv2_" + i) % 一维卷积层layerNormalizationLayer % 层归一化spatialDropoutLayer(dropoutFactor) % 空间丢弃层convolution1dLayer(filterSize, numFilters, DilationFactor = dilationFactor, Padding = "causal") % 一维卷积层layerNormalizationLayer % 层归一化reluLayer % 激活层spatialDropoutLayer(dropoutFactor, Name="drop" + i) % 空间丢弃层];% 添加 flip 网络结构到网络lgraph = addLayers(lgraph, Fliplayers);% 连接 flip 卷积层到残差块lgraph = connectLayers(lgraph, outputName, "flip_" + i);lgraph = connectLayers(lgraph, "drop" + i, "add_" + i + "/in3");lgraph = connectLayers(lgraph, "convSkip_"+i, "add_" + i + "/in4");% 残差连接 -- 首层if i == 1% 建立残差卷积层% Include convolution in first skip connection.layer = convolution1dLayer(1,numFilters,Name="convSkip");lgraph = addLayers(lgraph,layer);lgraph = connectLayers(lgraph,outputName,"convSkip");lgraph = connectLayers(lgraph,"convSkip","add_" + i + "/in2");elselgraph = connectLayers(lgraph,outputName,"add_" + i + "/in2");end% Update layer output name.outputName = "add_" + i;

end

% CSDN 机器学习之心

参考资料

[1] https://blog.csdn.net/kjm13182345320/article/details/128577926?spm=1001.2014.3001.5501

[2] https://blog.csdn.net/kjm13182345320/article/details/128573597?spm=1001.2014.3001.5501

这篇关于时序预测 | Matlab基于BiTCN-LSTM双向时间卷积长短期记忆神经网络时间序列预测的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!