本文主要是介绍阅读文献:LeViT: a Vision Transformer in ConvNet’s Clothing for Faster Inference,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

LeViT: a Vision Transformer in ConvNet’s Clothing for Faster Inference

1.四个问题

要解决什么问题

在高速状态下,平衡图像分类方法的精度和效率

用什么方法解决

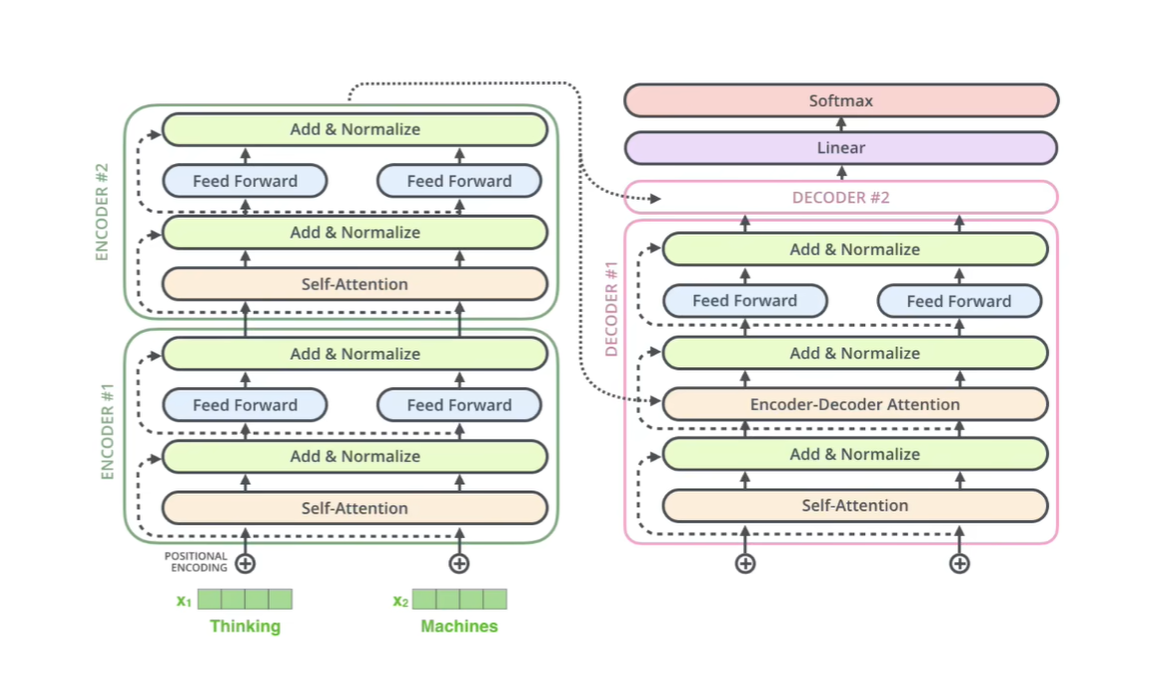

提出一种网络模型LeViT方法,在ViT模型基础上,引入卷积模块而不是学习类卷积特征的转换器组件,用特征金字塔替换Transformer中用以的结构(类似LeNet架构)

- 本文的贡献是允许 ViT 模型在宽度和空间分辨率方面缩小的技术:

- 使用注意力作为下采样机制的多级转换器架构;

- 一个计算效率高的补丁描述符,它减少了第一层中的特征数量;

- 一种学习的、每头平移不变的注意力偏差,取代了 ViT 的位置嵌入;

- 重新设计的 Attention-MLP 模块,可提高给定计算时间的网络容量

效果如何

在速度或精度权衡方面强于现有的方法,与用于数据中心或手机特征提取的其他高效神经网络相比,LeViT 在可比精度下快 1.5 到 5 倍。

还存在什么问题

没有进行试验,没有证明任何有效性,也没有发现问题

论文简介

摘要: 我们设计了一系列图像分类架构,在高速状态下优化精度和效率之间的权衡。 我们的工作利用了基于注意力的架构的最新发现,这些架构在高度并行的处理硬件上具有竞争力。我们重新审视了大量关于卷积神经网络的文献中的原理,将它们应用于转换器,特别是分辨率降低的激活图。我们还介绍了注意力偏差,这是一种在视觉转换器中整合位置信息的新方法。

因此,我们提出了 LeVIT:一种用于快速推理图像分类的混合神经网络。我们在不同的硬件平台上考虑不同的效率衡量标准,以最好地反映广泛的应用场景。我们广泛的实验凭经验验证了我们的技术选择,并表明它们适用于大多数架构。总体而言,LeViT 在速度/精度权衡方面明显优于现有的 convnets 和视觉转换器。例如,在 80% ImageNet top-1 准确率下,LeViT 在 CPU 上比 EfficientNet 快 5 倍。我们在https://github.com/facebookresearch/LeViT 发布代码

网络结构:

LeViT在transformer架构中集成了ResNet stage。在各个stage中,该体系结构类似于一个visual transformer:一个带有交替MLP和激活块的残差模块。下面是注意块的修改。

实验结果:

这篇关于阅读文献:LeViT: a Vision Transformer in ConvNet’s Clothing for Faster Inference的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!