本文主要是介绍Focal and Global Knowledge Distillation——目标检测网络的知识蒸馏,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

Paper地址:https://arxiv.org/abs/2111.11837

GitHub链接:https://github.com/yzd-v/FGD

方法

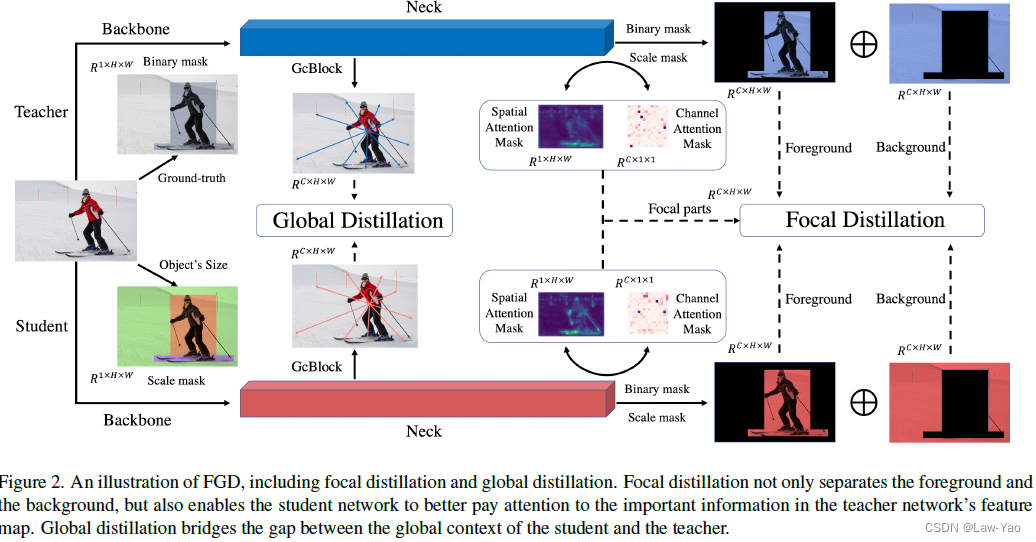

FGKD(Focal and Global Knowledge Distillation)通过Focal distillation与Global distillation的结合,兼顾了Instance-level信息、Spatial/Channel Attention以及全局相关性信息。

首先定义前背景分离Mask、Attention等,然后基于Feature map计算Focal distillation(由Feature loss与Attention loss构成)

这篇关于Focal and Global Knowledge Distillation——目标检测网络的知识蒸馏的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!