具身专题

论文速读|ROS-LLM:具有任务反馈和结构化推理的具身智能ROS 框架

论文地址:https://arxiv.org/pdf/2406.19741 ROS-LLM 框架旨在通过集成大型语言模型(LLM)和机器人操作系统(ROS),实现对机器人的直观编程。该框架支持通过聊天界面接收自然语言提示,并能够根据 ROS 环境中的传感器读数自动提取和执行行为。框架支持三种行为模式:序列、行为树和状态机。此外,通过模仿学习,用户可以向系统添加新的机器人动作。该研究通过实验

具身智能(Embodied Intelligence)概述

目录 一、引言 二、具身感知 三、具身交互 四、具身智能体 五、虚拟到现实 一、引言 最近无论是斯坦福机器人炒虾,还是特斯拉官宣机器人进厂,都赚足了眼球,实力证明了具身智能(Embodied Intelligence)的火爆。 先不说具身智能是实现AGI的关键环节,也是未来研究的重要方向,从发论文的角度来看,今年的各大顶会,比如CVPR,具身智能就排了热门研究领域

具身智能特点及实现路线

多模态——多功能的“小脑” 人类具有眼耳鼻舌身意,说明对于物理世界的充分感知和理解,是意识和智慧的来源。而传统AI更多的是被动观测,主要是“看”(计算机视觉)和“读”(文本NLP),这就使得智能体Agent缺乏对外部环境的通用感知能力。 多模态大模型,可以积累和分析2D/3D视觉、LiDAR激光、Voice声音等多维信息,基于真实交互,为具身大模型积累高质量数据,深度理解并转化为机器指令,来控

大模型时代的具身智能系列专题(一)

通用具身机器人 具身智能定义 从图灵定义看,知识由感知、智能体环境交互获得,具身智能要拥有足够的知识完成机器人任务。从字面上理解就是具有身体的智能,可以从交互中学习并有可能涌现新能力。近期的具身智能更多和大模型和端到端有关,是通过学习的方式涌现的智能。 机器人形态 未来机器人的四种形态:人形机器人、仿生机器人、变胞机器人、共融机器人。 人形机器人是近期最受关注的机器人形态,人形机器人的一个

具身智能的视觉-语言-动作模型综合综述论文

近期arXiv公开了关于具身智能(Embodied AI)中的视觉-语言-动作模型(Vision-Language-Action Models,简称VLAs)的综合综述论文。介绍了VLAs的概念,它们是为了处理多模态输入而设计的模型,包括视觉、语言和动作模态。这些模型对于具身AI至关重要,因为它们需要理解和执行指令、感知环境并生成适当的动作。 文章讨论了单模态模型的发展,包括计算机视觉、自然语言

大模型时代的具身智能系列专题(七)

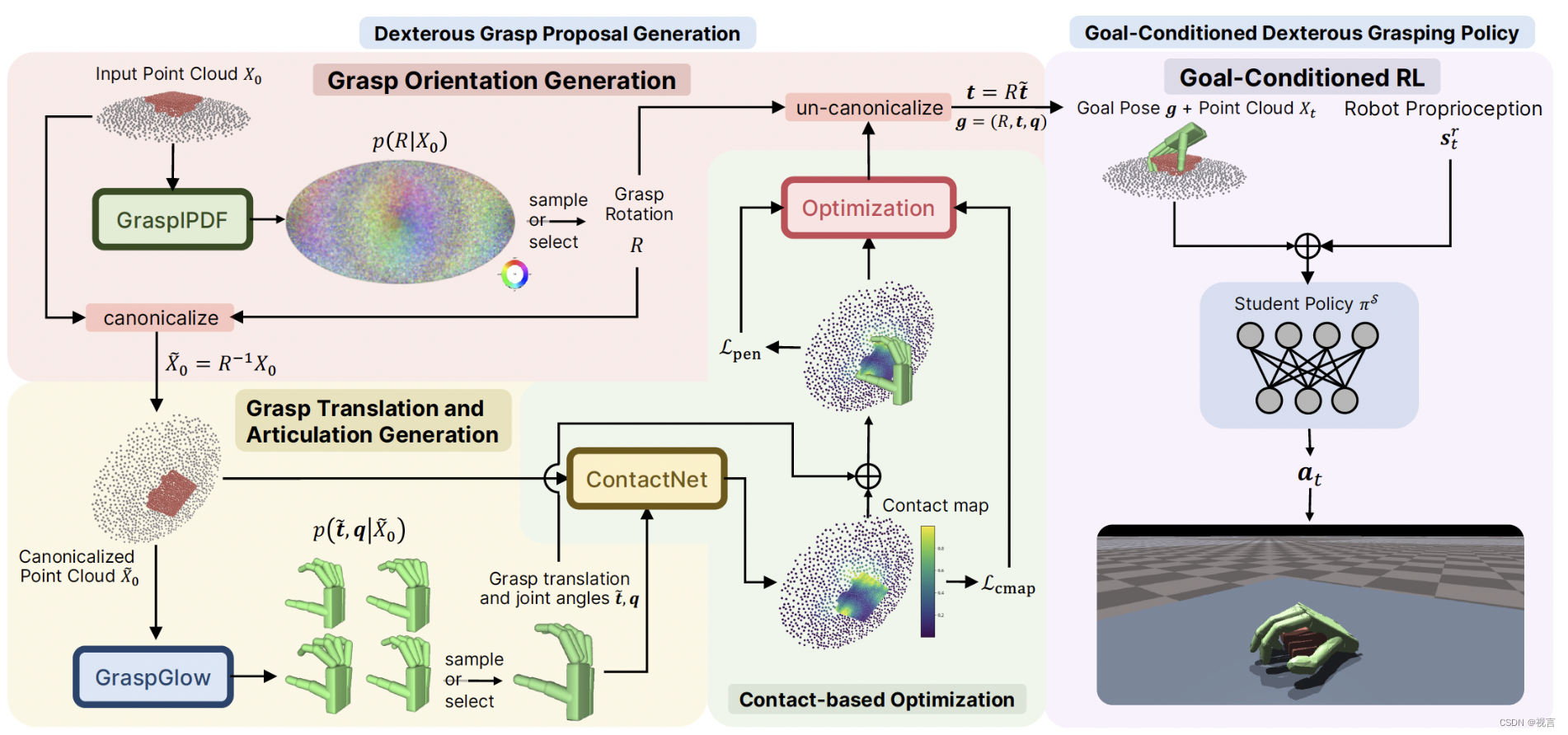

北大王鹤团队 王鹤,北京大学前沿计算研究中心助理教授,本科毕业于清华大学,博士毕业于斯坦福大学,师从美国三院院士Leonidas. J Guibas教授。他创立并领导了具身感知与交互实验室(EPIC Lab),实验室立足三维视觉感知与机器人学,重点关注具身机器人在三维复杂环境中的感知和交互问题,研究目标是以可扩增地方式发展高泛化性的机器人视觉和控制系统。研究成果覆盖物体抓取、功能性操控、灵巧操作

大模型时代的具身智能系列专题(六)

UCSD 王小龙组 王小龙是UCSD电子与计算机工程系的助理教授。他曾在加州大学伯克利分校与Alexei Efros和Trevor Darrell一起担任博士后研究员,在CMU RI获得了机器人学博士学位,师从Abhinav Gupta。他的研究重点是通过视频和物理机器人交互数据来学习3D和动态表示。促进机器人技能的学习,目标是使机器人能够在真实物理世界中与各种对象和环境有效互动。近期其团队分别

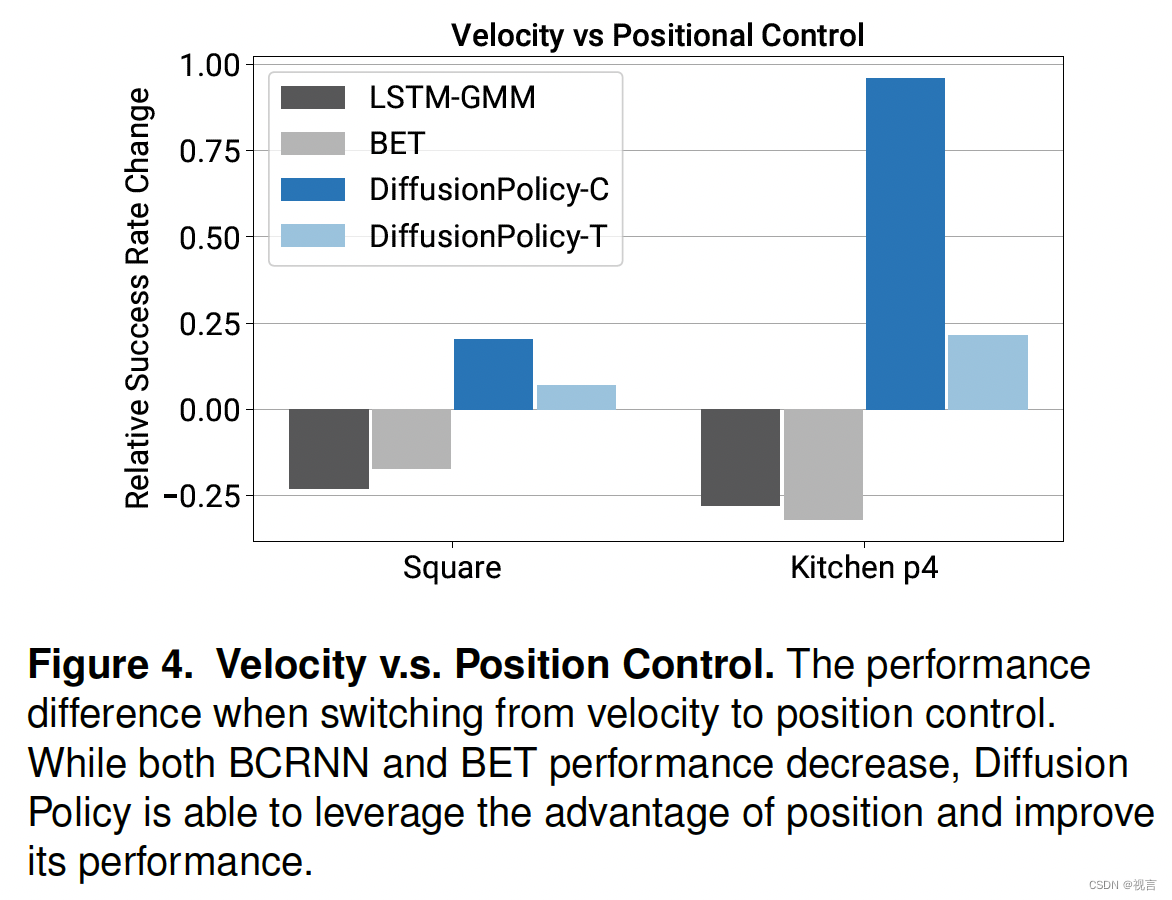

大模型时代的具身智能系列专题(五)

stanford宋舒然团队 宋舒然是斯坦福大学的助理教授。在此之前,他曾是哥伦比亚大学的助理教授,是Columbia Artificial Intelligence and Robotics Lab的负责人。他的研究聚焦于计算机视觉和机器人技术。本科毕业于香港科技大学。 主题相关作品 diffusion policy diffusion policy 扩散策略是一种生成机器人行为的新方

具身智能的物理世界与人类的物理世界有何不同

具身智能的物理世界是指人工智能系统通过传感器和执行器与物理环境进行交互的世界。在这个世界中,人工智能系统可以感知周围的环境,执行各种任务,并与人类和其他物理实体进行交互。 人类的物理世界则是指人类生活和活动的物理环境,包括自然环境和人造环境。人类通过感官和运动系统与物理世界进行交互,感知周围的事物,执行各种任务,并与其他人类和物理实体进行交互。 虽然具身智能的物理世界和人类的物理世界有

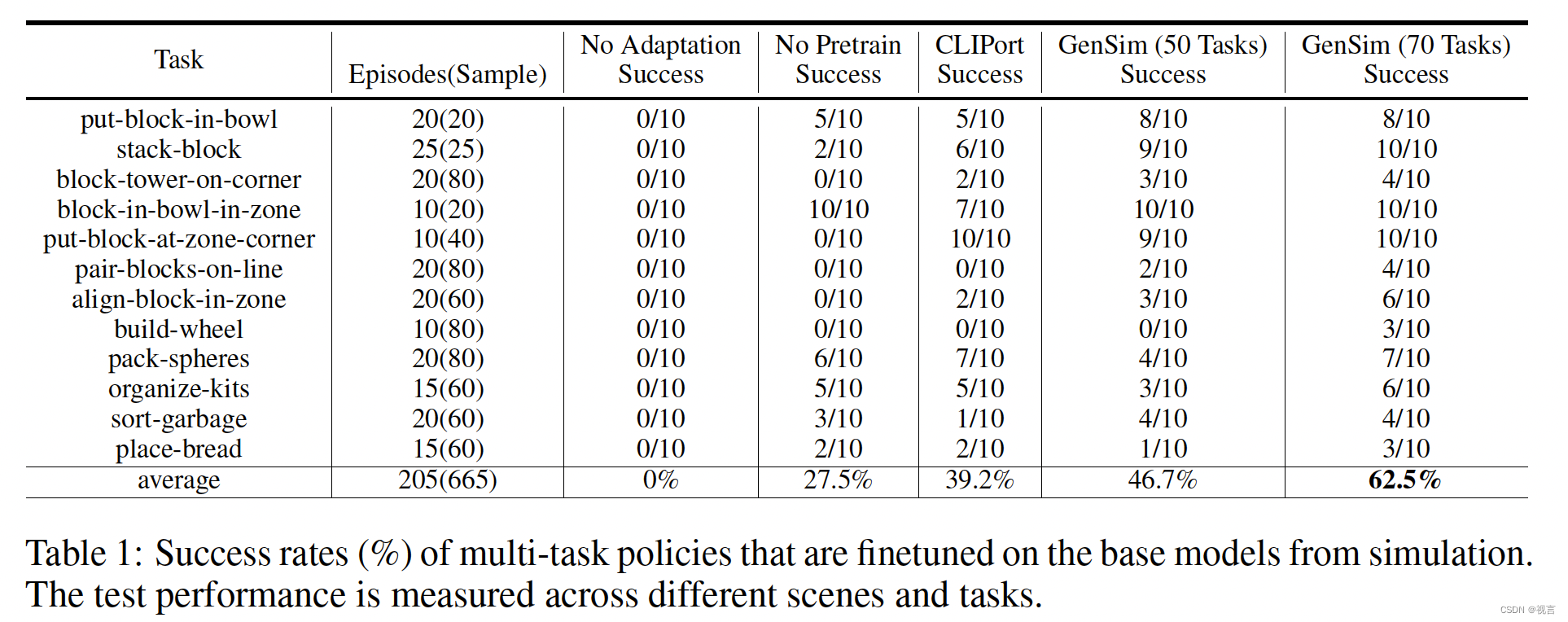

大模型时代的具身智能系列专题(三)

清华高阳团队 高阳为清华叉院助理教授,本科毕业于清华大学计算机系,博士毕业于UC Berkeley。博士导师是Vision领域的大牛Trevor Darrell,读博期间和Sergey Levine合作开始强化学习方面的探索,博后跟随Pieter Abbeel做强化学习,合作的导师都是RL+Robotics这个领域的大牛。研究方向为计算机视觉和机器人的结合领域,教会机器人通过“看”去操纵周围的事

具身触觉社区| “大咖面对面”第一期活动顺利举行

4月27日,由中国人工智能学会认知系统与信息处理专委会组织的“具身触觉社区”第一期“大咖面对面”分享活动顺利举行,我们邀请到了美国麻省理工学院(MIT)博士、视触觉传感器的奠基人、GelSight指尖传感器发明人李瑞老师为社区带来了非常精彩的报告!近200名来自高校、科研院所、工业部门等行业的同学、老师、专家学者参与了本次活动,并在讲座结束后与李瑞老师进行了热烈的交流。我们非常高兴地看到产学研各界

具身智能狂潮背后:泡沫还是技术革命的前奏?

2024年机器人浪潮继续汹涌着,机器人领域从未像今天一样火热,目前学术界、工业界在这样的热潮下议论纷纷,到底是泡沫还是爆发的前夕?实际上,判断一个事情是否是泡沫,要从技术底层去思考,有了技术底座就会诞生应用,如果技术弭平了市场需求,那么爆发是自然而然地。 就如同判断VR是否是泡沫,在VR元年的时候,也是这样类似的热潮,如今退却之后,大浪淘沙,很多公司稳住了,长期来看VR尤其是MR稳中向好,无论是V

具身智能机器人实现新里程碑!新型3D世界模型问世

随着人工智能技术的不断进步,视觉-语言-动作(VLA)模型在机器人控制、自动驾驶、智能助手等领域展现出了广阔的应用前景。这类模型能够将视觉、语言、动作等多模态信息进行融合,实现从感知到决策的端到端学习。然而,现有的VLA模型大多基于二维视觉输入,缺乏对三维物理世界的深入理解和交互能力。此外,它们往往采用从感知到动作的直接映射方式进行决策,忽略了复杂环境动态和行动后果之间的关联。这与人类先建立内在世

人工智能产业应用--具身智能

五、下一个浪潮 (一) 跳出缸中脑——虚实结合 在探索人工智能的边界时,“跳出缸中脑——虚实结合”这一概念提出了一个引人深思的视角,尤其是在具身智能的领域。具身智能是一种思想,强调智能体通过与其环境的直接物理互动来实现智能行为。然而,当这一概念与大型语言模型(如GPT系列)结合时,它揭示了一条全新的路径,即如何将这些高度发达的计算模型与现实世界相连接。 大型语言模型,作为一种先进的人工智能技

基于具身智能的移动操作机器人系统发展研究

来源:中国工程院院刊 作者:兰沣卜,赵文博,朱凯,张涛 “人工智能技术与咨询” 发布 编者按:具身智能是新一轮科技革命与产业变革中的战略性技术,是当前世界各国重点竞争的前沿高地之一;移动操作机器人系统因其优秀的运动、规划、执行能力成为具身技术首选的硬件载体;基于具身智能的移动操作机器人系统作为实现跨领域、多场景、多功能的自主具身智能平台,将成为引领未来新一代信息技术和人工智能发展的

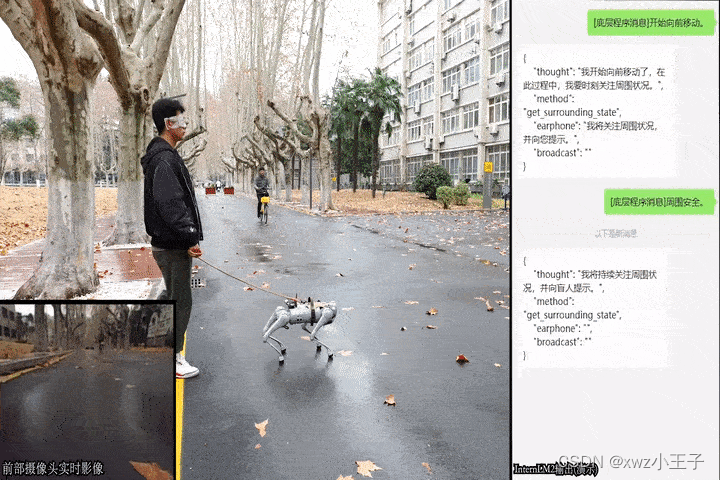

大模型赋能机器狗,西工大离线具身智能研究取得新突破!

“啪嗒啪嗒…”,一只机器狗在街上迈着规律的步伐,拉着牵引绳的盲人,在它的带领下越过沿路障碍,平稳地行走着。电子导盲犬能否取代传统导盲犬,解决视障人士一犬难求的困境?西工大团队在此方面开展研究攻关,并取得了新的突破。 近日,西北工业大学光电与智能研究院联合中国电信人工智能研究院在探索离线具身智能应用方面取得阶段性进展。具身智能,即具有物理实体,能够通过传感器和执行器与环境进行实时互动,执行相应指令

英伟达GTC2024大会开幕,发布机器人003计划,引领具身智能新时代

一、背景 在全球科技创新的前沿阵地,2024年3月的英伟达GPU技术大会(GTC)再次成为全球瞩目的焦点。在此次盛会上,英伟达公司创始人兼首席执行官黄仁勋先生不仅展示了其公司在加速计算和生成式AI领域的最新突破,更震撼发布了具有里程碑意义的“通用机器人003计划”,预示着人工智能与人形机器人深度融合的具身智能时代正式拉开帷幕。 此图片来源于网络 汇聚全球顶尖人形机器人研发力量,GTC2

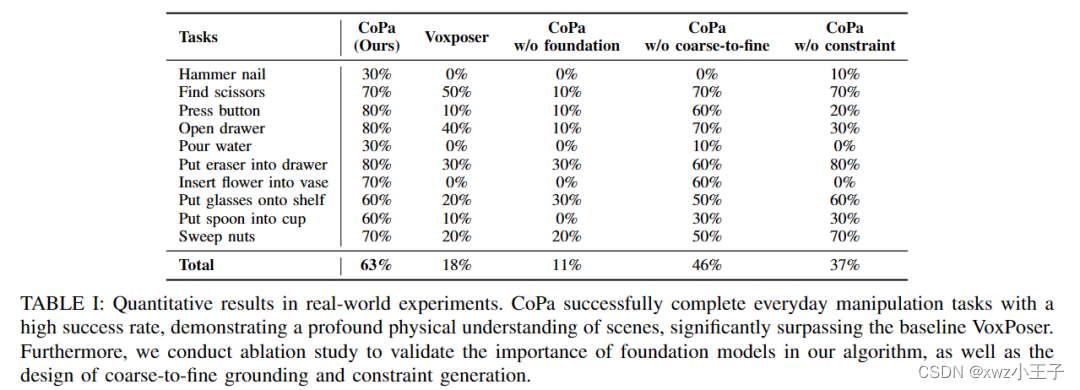

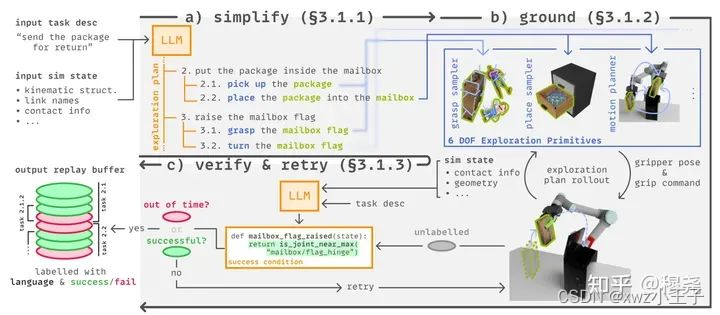

一句指令就能冲咖啡、倒红酒、锤钉子,清华具身智能CoPa「动」手了

近期,具身智能方向取得了诸多进展。从谷歌的 RT-H 到 OpenAI、Figure 联合打造的 Figure 01,机器人的交互性、通用性越来越强。 如果未来机器人成为人们日常生活的助手,你期待它们能够完成哪些任务?泡一杯热气腾腾的手冲咖啡,整理桌面,甚至帮你精心安排一场浪漫的约会,这些任务,只需一句指令,清华的具身智能新框架「CoPa」都能完成。 CoPa(Robotic Manipula

Figure 01掀起了具身智能的崭新篇章

在人工智能的发展历程中,OpenAI始终扮演着创新的先锋角色。最近,他们与Figure公司的合作成果尤为引人注目,这一合作将多模态大模型技术成功应用于Figure 01机器人的开发中,为人类与机器的互动开辟了全新的时代。该机器人不仅能够与人类进行深入的对话交流,而且在最近的演示中,其展现出的互动能力令人印象深刻。 Figure公司在获得了包括OpenAI在内的多位重量级投资者的支持后,正式发布了

每周AI新闻(2024年第8周)谷歌推出开源大模型Gemma | Groq自研AI芯片 | 英伟达成立GEAR研究具身智能体

这里是陌小北,一个正在研究硅基生命的碳基生命。正在努力成为写代码的里面背诗最多的,背诗的里面最会写段子的,写段子的里面代码写得最好的…厨子。 每周日解读每周AI大事件。 大厂动向 【1】谷歌推出最强开源大模型Gemma 谷歌发布开源模型Gemma,Gemma主打轻量级、高性能,有20亿、70亿两种参数规模,能在笔记本电脑、台式机、物联网设备、移动设备和云端等不同平台运行。性能方面,Gemm

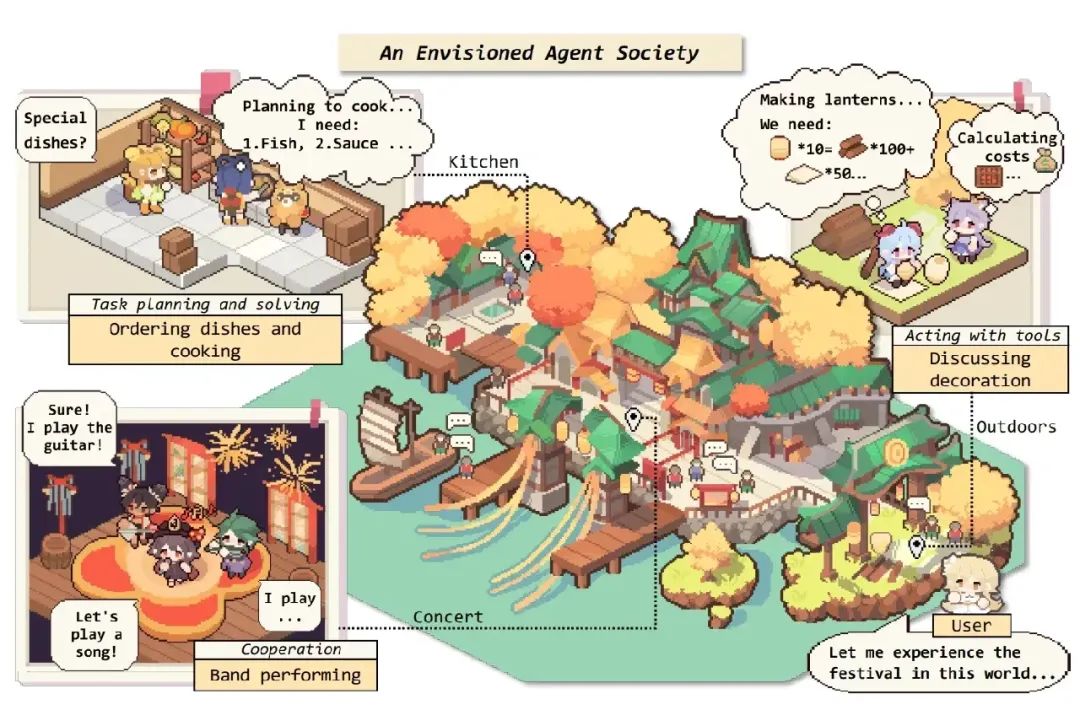

AI Agent十大研究方向,数字员工、超级个体、具身智能与之密切相关

最近发布的几个关于2024趋势的重磅报告,无一例外都提到了AI Agent。 埃森哲在《技术展望2024》报告中指出,96%的企业高管认为AI Agent生态系统应用将在未来3年内为他们的组织带来重大机遇。 报告认为,随着人工智能向智能体演进,自动化系统将能够自主决策和行动。智能体不仅会为人类提供建议,还将代表人类采取行动。人工智能将继续生成文本、图像和洞察,而AI Agent将自行决定如何处

【具身智能】RT-2:视觉-语言-动作模型(VLA)

文章目录 前言一、视觉-语言-动作(VLA)模型二、利用 VLM 控制机器人三、实验四、 Demo五、总结 前言 Robotic Transformer 2(RT-2)是由谷歌 DeepMind 新推出的大语言模型,它为人类提供了通过纯语言命令来优化机器人控制的能力。与此前的大模型不同,RT-2是一种新型的视觉-语言-动作(VLA)模型,它可以从网络和机器人数据中学习,并

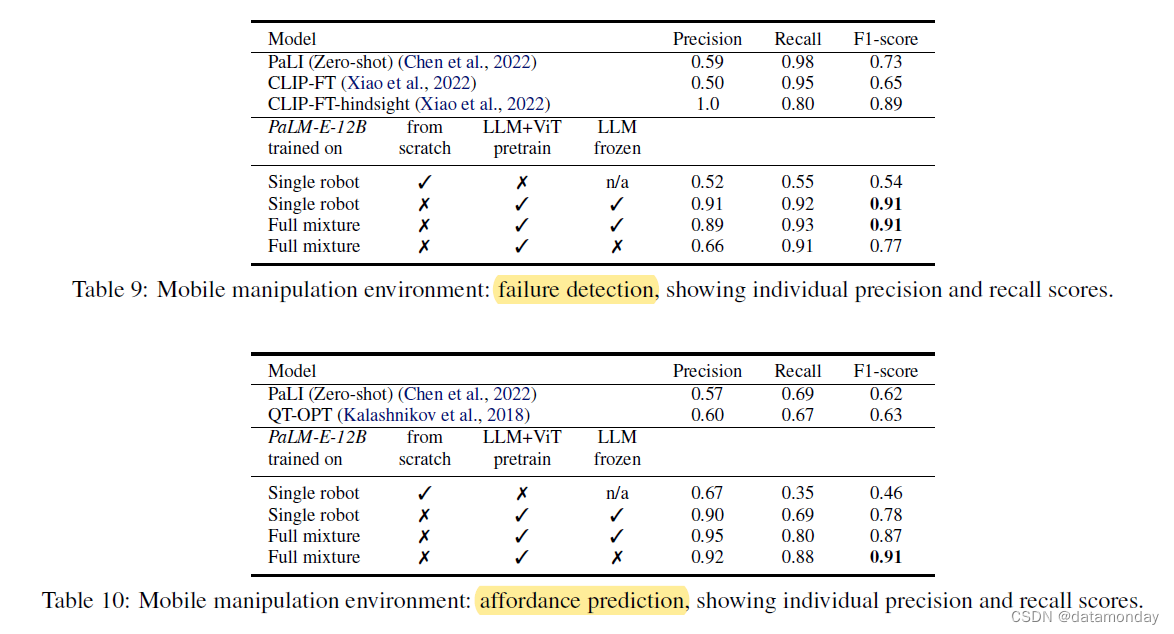

【EAI 001】PaLM-E: 用于具身智能相关任务的多模态语言模型

论文标题:PaLM-E: An Embodied Multimodal Language Model 论文作者:Danny Driess, Fei Xia, Mehdi S. M. Sajjadi, Corey Lynch, Aakanksha Chowdhery, Brian Ichter, Ayzaan Wahid, Jonathan Tompson, Quan Vuong, Tianhe