textcnn专题

【python 走进NLP】从零开始搭建textCNN卷积神经网络模型

无意中发现了一个巨牛的人工智能教程,忍不住分享一下给大家。教程不仅是零基础,通俗易懂,而且非常风趣幽默,像看小说一样!觉得太牛了,所以分享给大家。点这里可以跳转到教程。人工智能教程 1、众所周知,tensorflow 是一个开源的机器学习框架,它的出现大大降低了机器学习的门槛,即使你没有太多的数学知识,它也可以允许你用“搭积木”的方式快速实现一个神经网络,即使没有调节太多的参数,模型的表现一般还

NLP-分类模型-2014-文本分类:TextCNN【使用 “CNN”+ 预训练的 “词向量” --> 处理 “句子级别” 的文本分类】

《TextCNN 原始论文:Convolutional Neural Networks for Sentence Classification》 一、概述 1、TextCNN 是什么? 我们之前提前CNN时,通常会认为是属于CV领域,用于计算机视觉方向的工作,但是在2014年,Yoon Kim针对CNN的输入层做了一些变形,提出了文本分类模型textCNN。与传统图像的CNN网络相比, te

NLP06:基于TextCNN的中文文本分类

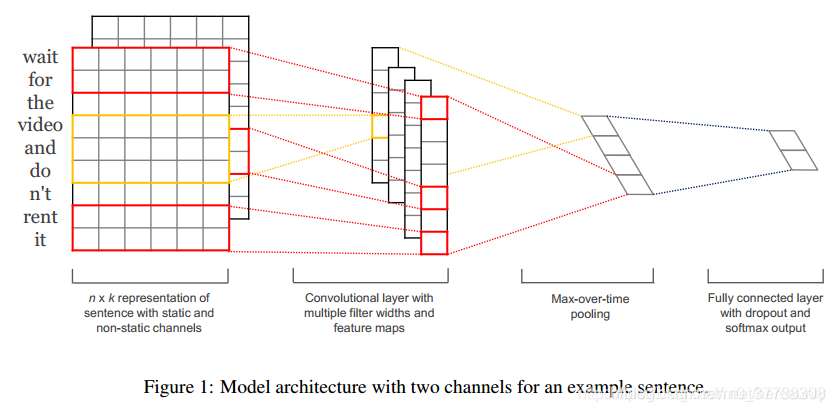

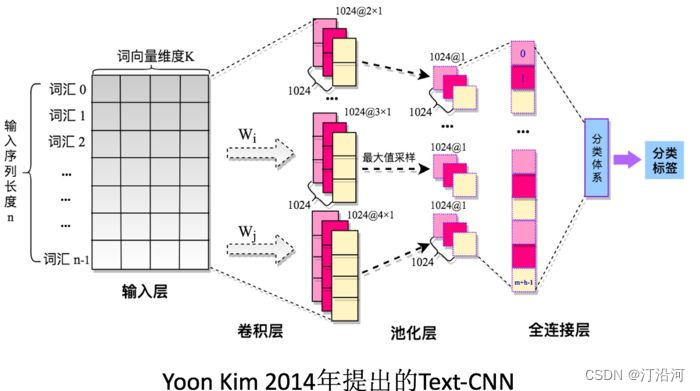

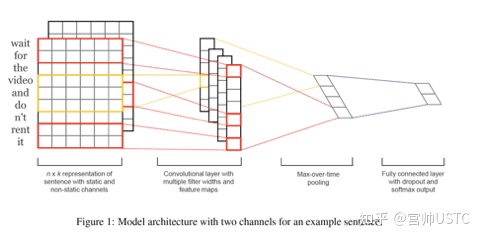

公众号:数据挖掘与机器学习笔记 1.TextCNN基本原理 主要看第二张图: 第一层为输入层,输入是一个 n × k n \times k n×k的矩阵,图中为 7 × 5 7 \times 5 7×5。其中 n n n为句子中的单词数, k k k为词向量维度。词向量可以是预训练好的,也可以在网络中重新开始训练。第一张图中输入有两个矩阵,其中一个使用的预训练好的向量,另一个则作为训

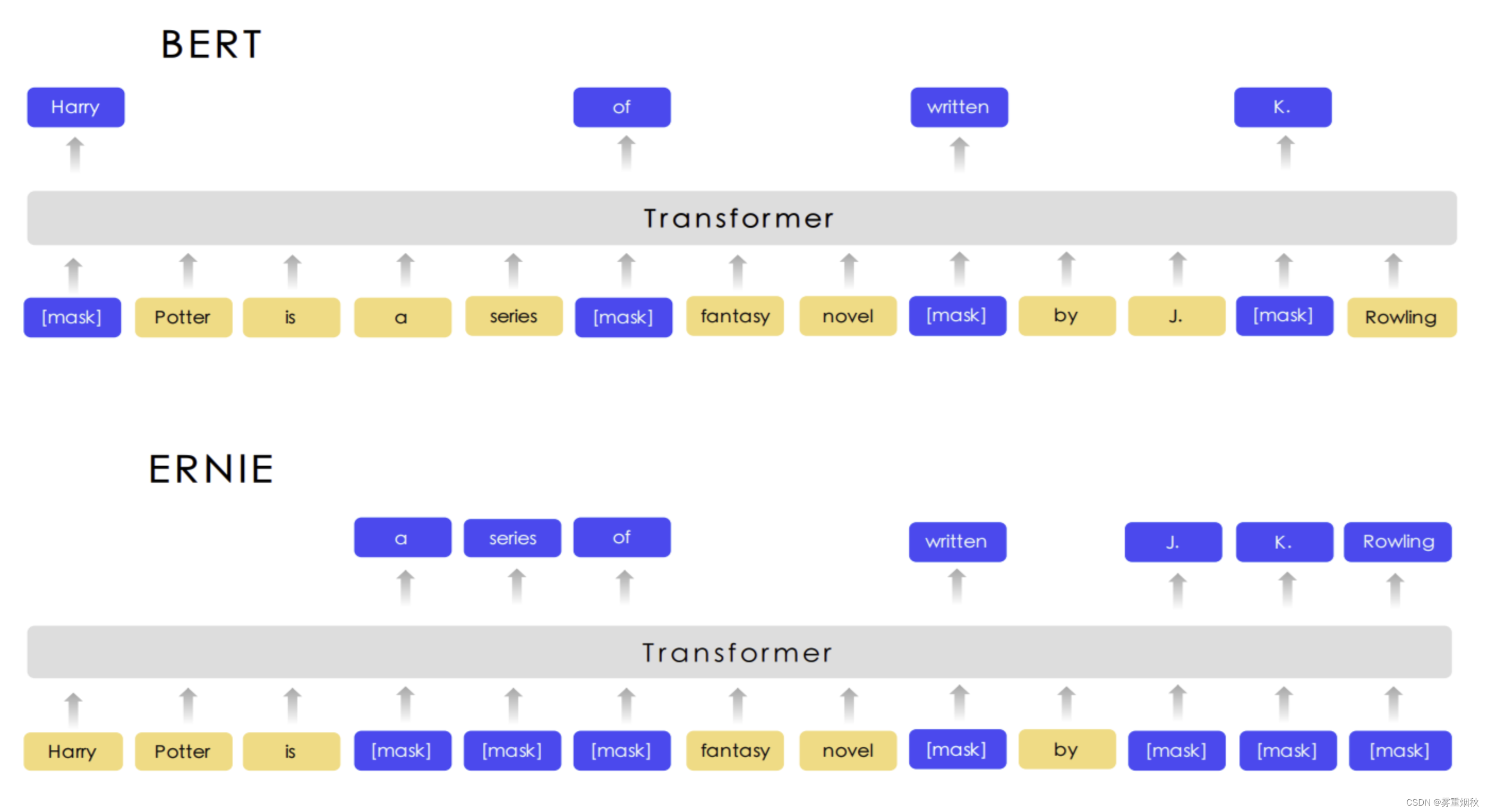

NLP实战入门——文本分类任务(TextRNN,TextCNN,TextRNN_Att,TextRCNN,FastText,DPCNN,BERT,ERNIE)

本文参考自https://github.com/649453932/Chinese-Text-Classification-Pytorch?tab=readme-ov-file,https://github.com/leerumor/nlp_tutorial?tab=readme-ov-file,https://zhuanlan.zhihu.com/p/73176084,是为了进行NLP的一些典型

自然语言处理中的RNN、LSTM、TextCNN和Transformer比较

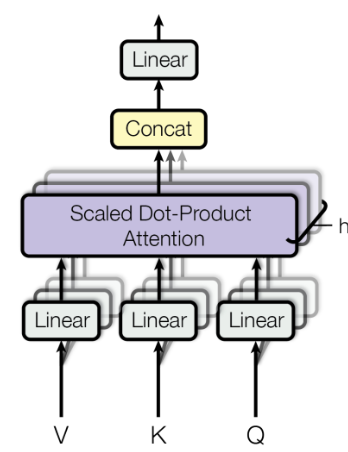

引言 在自然语言处理(NLP)领域,理解和应用各种模型架构是必不可少的。本文将介绍几种常见的深度学习模型架构:RNN(循环神经网络)、LSTM(长短期记忆网络)、TextCNN(文本卷积神经网络)和Transformer,并通过PyTorch代码展示其具体实现。这些模型各具特点,适用于不同类型的NLP任务。 1. 循环神经网络(RNN) 概述 RNN是一种用于处理序列数据的神经网络。与传统

【模型架构】学习RNN、LSTM、TextCNN和Transformer以及PyTorch代码实现

一、前言 在自然语言处理(NLP)领域,模型架构的不断发展极大地推动了技术的进步。从早期的循环神经网络(RNN)到长短期记忆网络(LSTM)、Transformer再到当下火热的Mamba(放在下一节),每一种架构都带来了不同的突破和应用。本文将详细介绍这些经典的模型架构及其在PyTorch中的实现,由于我只是门外汉(想扩展一下知识面),如果有理解不到位的地方欢迎评论指正~。 个人感觉NLP的

基于LSTM的新闻中文文本分类——基于textCNN与textRNN

构建词语字典 def build_vocab(file_path, tokenizer, max_size, min_freq):# 定义词汇表字典:使用 vocab_dic = {} 初始化一个空字典,用于存储每个词及其出现频率vocab_dic = {}with open(file_path, 'r', encoding='UTF-8') as f:for line in tqdm(f):l

TextCNN:文本分类卷积神经网络

模型原理 1、前言2、模型结构3、示例3.1、词向量层3.2、卷积层3.3、最大池化层3.4、Fully Connected层 4、总结 1、前言 TextCNN 来源于《Convolutional Neural Networks for Sentence Classification》发表于2014年,是一个经典的模型,Yoon Kim将卷积神经网络CNN应用到文本分类任务,

卷积神经网络和TextCNN(原理+代码)

卷积神经网络(Convolutional Neural Network, CNN)是一种前馈神经网络,它的人工神经元可以响应一部分覆盖范围内的周围单元,对于大型图像处理有出色表现。 ##概况 卷积神经网络(Convolutional Neural Networks / CNNs / ConvNets)与普通神经网络非常相似,它们都由具有可学习的权重和偏置常量(biases)的神经元组成。每

TextCNN:模型原理

模型原理 1、前言2、模型结构3、示例3.1、词向量层3.2、卷积层3.3、最大池化层3.4、Fully Connected层 4、总结 1、前言 TextCNN 来源于《Convolutional Neural Networks for Sentence Classification》发表于2014年,是一个经典的模型,Yoon Kim将卷积神经网络CNN应用到文本分类任务,

TextCNN文本分类快速上手

这里写目录标题 TextCNN介绍:Docker从0安装Docker基于镜像安装容器打包操作(生成镜像时使用的命令)安装时命令 页面访问模型训练API访问性能测试其他查看显卡信息 TextCNN介绍: 1.支持语义识别和分类置信度输出。 2.训练速度快,3000样本在1-3分钟。 3.推理性能佳,5K-10K/秒。 平均单条推理速度在0.2秒。 单个模型占用GPU约1

深入TextCNN(一)详述CNN及TextCNN原理 - 知乎 (zhihu.com)

深入TextCNN(一)详述CNN及TextCNN原理 - 知乎 (zhihu.com) https://zhuanlan.zhihu.com/p/77634533?from_voters_page=true

TextCNN的复现

TextCNN的复现–pytorch的实现 对于TextCNN的讲解,可以参考这篇文章 Convolutional Neural Networks for Sentence Classification - 知乎 (zhihu.com) 接下来主要是对代码内容的详解,完整代码将在文章末尾给出。 使用的数据集为电影评论数据集,其中正面数据集5000条左右,负面的数据集也为5000条。 py

【阅读笔记】TextCNN

Kim Y . Convolutional Neural Networks for Sentence Classification[J]. Eprint Arxiv, 2014. 本文介绍了一种使用 pre-trained word vectors 作为 CNN 输入的 sentence-level 分类器。模型结构比较简单,但也有不少巧思。 TextCNN 的网络结构如下图所示,将句子中词向量

在极客云的GPU 上成功让textcnn跑起来

期间遇到的问题我来整理一下 版本不兼容,注意,我在本机上做实验,用的tf和keras分别是1.40.和2.1.5,在云服务器上一开始爆出了“sofmax的axis的问题,解决方法就是修改版本tf修改为1.4.0keras修改为2.0.8,结果不再报错 我以前的tensorflow版本是1.4.1和keras版本2.1.5。 降级到tensorflow版本1.4.0和keras版本

文本分类(TFIDF/朴素贝叶斯分类器/TextRNN/TextCNN/TextRCNN/FastText/HAN)

目录 简介TFIDF朴素贝叶斯分类器 贝叶斯公式贝叶斯决策论的理解极大似然估计朴素贝叶斯分类器TextRNNTextCNNTextRCNNFastTextHANHighway Networks 简介 通常,进行文本分类的主要方法有三种: 基于规则特征匹配的方法(如根据喜欢,讨厌等特殊词来评判情感,但准确率低,通常作为一种辅助判断的方法)基于传统机器学习的方法(特征工程 + 分类算法

2 文本分类入门:TextCNN

论文链接:https://arxiv.org/pdf/1408.5882.pdf TextCNN 是一种用于文本分类的卷积神经网络模型。它在卷积神经网络的基础上进行了一些修改,以适应文本数据的特点。 TextCNN 的主要思想是使用一维卷积层来提取文本中的局部特征,并通过池化操作来减少特征的维度。这些局部特征可以捕获词语之间的关系和重要性,从而帮助模型进行分类。 nn.Conv2d

2 文本分类入门:TextCNN

论文链接:https://arxiv.org/pdf/1408.5882.pdf TextCNN 是一种用于文本分类的卷积神经网络模型。它在卷积神经网络的基础上进行了一些修改,以适应文本数据的特点。 TextCNN 的主要思想是使用一维卷积层来提取文本中的局部特征,并通过池化操作来减少特征的维度。这些局部特征可以捕获词语之间的关系和重要性,从而帮助模型进行分类。 nn.Conv2d

自然语言处理(NLP):08 TextCNN在短文本分类应用介绍

TextCNN 短文本分类案例分享,学习更多工业界案例:数据分析可视化技术、TextCNN论文原理、词向量技术、tensorboardx效果可视化工具、TextCNN 短文本分类案例分享总结,让大家彻底掌握TextCNN 在文本分类领域应用,有任何问题请留言或者加入交流群:NLP技术交流群 ,让我们一起学习NLP。 自然语言处理(NLP):08 TextCNN在短文本分类应用介绍 自然语言处理(

基于word2vec和TextCNN的新闻标题分类器

一、背景 本人做新闻爬虫工作,由于工作需要,经常需要将一个列表页中的a标签链接进行提前并进行抓取,但问题是,如何确定一个列表页大概率是新闻页面那? 起初,通过一些规则的方法,比如新闻高频词来确定是否是新闻列表页,但由于热词更新的滞后以及无热词页面,规则匹配的效果变得很差,故放弃了该方案。后期,通过总结新闻标题的模式发现, 新闻和非新闻的标题内容在用词以及语义上存在明显的区别,如果规则

天池零基础入门NLP竞赛实战:Task4 基于深度学习的文本分类2.2-Word2Vec+TextCNN+BiLSTM+Attention分类

Task4 基于深度学习的文本分类2.2-Word2Vec+TextCNN+BiLSTM+Attention分类 完整代码见:NLP-hands-on/天池-零基础入门NLP at main · ifwind/NLP-hands-on (github.com) 模型架构 模型结构如下图所示,主要包括WordCNNEncoder、SentEncoder、SentAttention和FC模块。

文本分类(5)-TextCNN实现文本分类

利用TextCNN对IMDB Reviwe文本进行分类,数据集地址:https://pan.baidu.com/s/1EYoqAcW238saKy3uQCfC3w 提取码:ilze import numpy as npimport loggingfrom keras import Inputfrom keras.layers import Conv1D, MaxPool1D, Dense,

【Deep Learning A情感文本分类实战】2023 Pytorch+Bert、Roberta+TextCNN、BiLstm、Lstm等实现IMDB情感文本分类完整项目(项目已开源)

🍊作者最近在看了大量论文的源代码后,被它们干净利索的代码风格深深吸引,因此也想做一个结构比较规范而且内容较为经典的任务 🍊本项目使用Pytorch框架,使用上游语言模型+下游网络模型的结构实现IMDB情感分析 🍊语言模型可选择Bert、Roberta 🍊主神经网络模型可选择BiLstm、LSTM、TextCNN、Rnn、Gru、FNN、Attention共7种 🍊语言模型

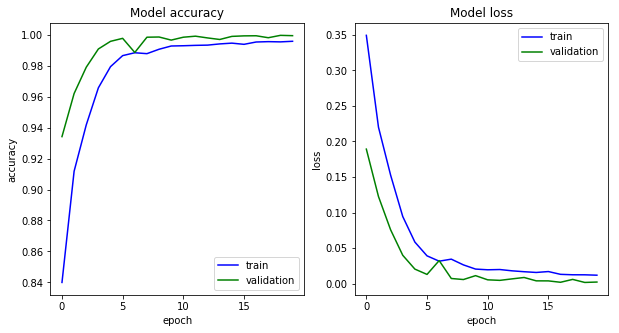

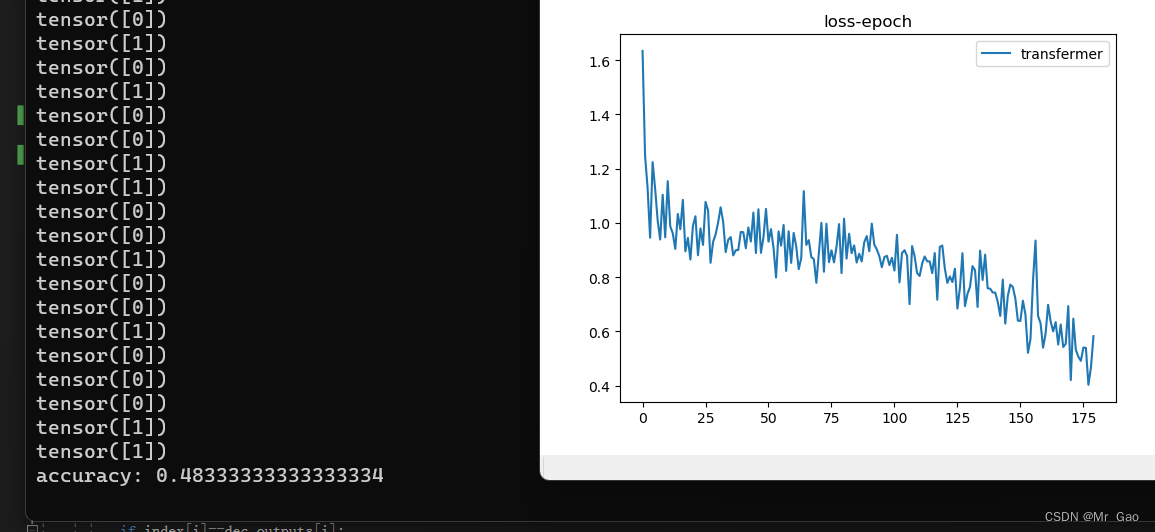

python pytorch- TextCNN TextRNN FastText Transfermer (中英文)文本情感分类实战(附数据集,代码皆可运行)

python pytorch- TextCNN TextRNN FastText Transfermer 文本情感分类实战(附数据集,代码皆可运行) 注:本次实验,主要注重代码实现这些模型,博主的数据集质量较差,模型评估效果并不是十分理想,后续同学们可以自行使用自己的数据集去运行这些模型,训练自己的优质模型。数据集我会上传到我得资源当中,大家可以自行下载。 最近博主做了基于深度学习的文本情感分