perceptron专题

(感知机-Perceptron)—有监督学习方法、非概率模型、判别模型、线性模型、参数化模型、批量学习、核方法

定义 假设输入空间(特征空间)是 χ \chi χ ⊆ R n \subseteq R^n ⊆Rn,输出空间是y = { + 1 , − 1 } =\{+1,-1 \} ={+1,−1} 。输入 x ∈ χ x \in \chi x∈χ表示实例的特征向量,对应于输入空间(特征空间)的点;输出 y ∈ y \in y∈y表示实例的类别。由输入空间到输出空间的如下函数: f ( x ) = s

用nltk包出现的三个问题 报错显示 缺少 punkt_tab、averaged_perceptron_tagger、wordnet 这三个文件

用nltk包出现的三个问题 报错显示 缺少 punkt_tab、averaged_perceptron_tagger、wordnet 这三个文件 报错是分开来的,你自己缺少哪一个就下哪一个,我这里总共是缺少三个文件,所以我依次去下载的 首先 在自己的虚拟环境中建立一个nltk_data文件夹,然后去里面建立三个文件夹(这三个文件夹的命名看你报错的内容里面提到的),然后分别去下载对缺少的文件

机器学习:感知机--Perceptron

机器学习:感知机–Perceptron 感知器是具有二进制输入和阶梯激活函数的神经元。 输入:0或者1 输出:0或者1 激活函数:阶梯函数 举例 (1)与门 H(x)表示阶梯函数,或者说Heaviside函数 y = H ( x 1 + x 2 − 1.5 ) y = H(x_1+x_2-1.5) y=H(x1+x2−1.5) (2)或门 y = H ( x 1 + x

深度学习pytorch——感知机(Perceptron)(持续更新)

什么是感知机? 感知机是由美国学者FrankRosenblatt在1957年提出来的。感知机是作为神经网络(深度学习)的起源的算法。因此,学习感知机的构造也就是学习通向神经网络和深度学习的一种重要思想。 感知机接收多个输入信号,输出一个信号。这里所说的“信号”可以想象成电流或河流那样具备“流动性”的东西。像电流流过导线,向前方输送电子一样,感知机的信号也会形成流,向前方输送信息。但是,和实际的

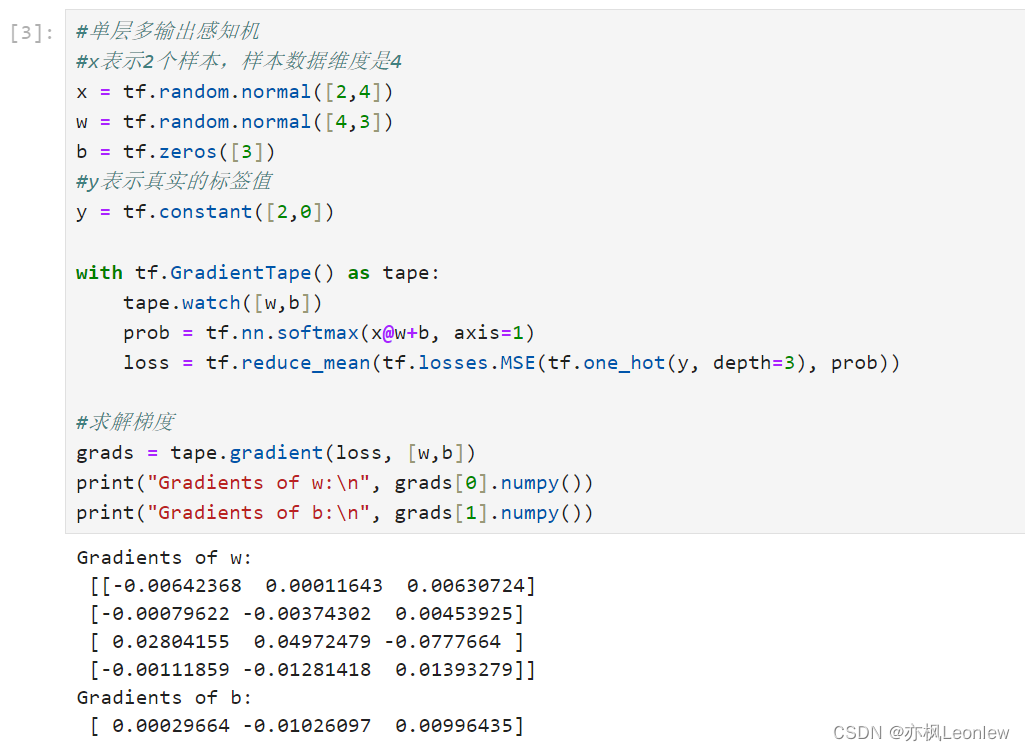

Tensorflow2.笔记 - 单层感知机(单输出,多输出)Single Layer Perceptron

本笔记主要记录单层感知机的相关内容,包括单层单输出,和单层多输出。 import tensorflow as tfimport numpy as nptf.__version__#单层单输出感知机,逻辑回归很类似,主要区别就是激活函数和损失函数不同#单层感知机的激活函数通常使用sign函数#逻辑回归的激活函数通常使用sigmoid#参考资料:https://blog.cs

多层感知机(MultiLayer Perceptron,MLP)python实现

多层感知机(MultiLayer Perceptron,MLP)是一种人工神经网络模型,通常用于处理分类问题。它是一种前馈神经网络(Feedforward Neural Network),由多个层次组成,每个层次包含多个神经元。 MLP 的基本组成包括: 输入层(Input Layer): 接收输入特征的层。每个输入特征都对应于输入层中的一个节点。 隐藏层(Hidden Layers):

OR perceptron(感知机 )

OR 感知器 OR 感知器跟 AND 感知器相同,在下图中,除了下移,OR 感知器与 AND 感知器有相同的分割线。你对权重或者偏差做怎样的设置可以实现这个效果。用下面的 AND 感知器来创造一个 OR 感知器。 方法: 1.整体提升权值 2.减小bias

perceptron 感知机

感知器 Perceptron 现在你看到了一个简单的神经网络如何做决策:输入数据,处理信息,然后给出一个结果作为输出!现在让我们深入这个大学录取的案例,来学习更多输入数据如何被处理。 数据,无论是考试成绩还是评级,被输入到一个相互连接的节点网络中。这些独立的节点被称作感知器 或者神经元。它们是构成神经网络的基本单元。每一个依照输入数据来决定如何

感知机(perceptron)

一、感知机 1、相关概念介绍 感知机(perceptron)是二分类的线性分类模型,属于监督学习算法。输入为实例的特征向量,输出为实例的类别(取+1和-1)。 2、(单层)感知机存在的问题 感知机不能拟合XOR函数,它只能产生线性分割面。 3、总结 二、多层感知机 1、多层感知机思路 多层感知机思路就

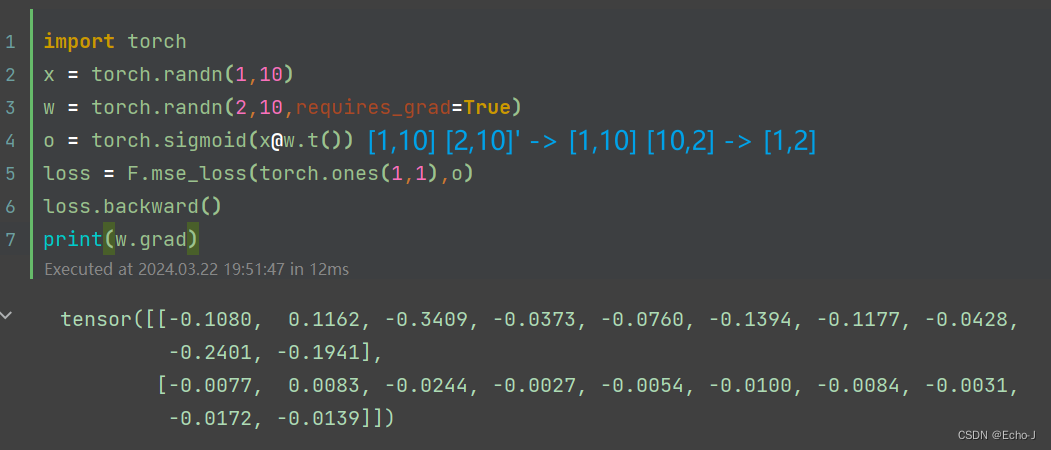

NLP 学习笔记 1:pytorch基础操作以及Perceptron 和 FF networks实现

一些自己的nlp学习笔记 一:一些基础的pytorch操作 1 tensor的建立 import torchimport numpy as npx = torch.Tensor(2,3) # 建立两行三列的torch tensorprint(x.type()) # type是Tensor类的一个mothod,返回Python string# torch.FloatTens