mlp专题

机器学习项目——基于机器学习(RNN LSTM 高斯拟合 MLP)的锂离子电池剩余寿命预测方法研究(代码/论文)

完整的论文代码见文章末尾 以下为核心内容和部分结果 摘要 机器学习方法在电池寿命预测中的应用主要包括监督学习、无监督学习和强化学习等。监督学习方法通过构建回归模型或分类模型,直接预测电池的剩余寿命或健康状态。无监督学习方法则通过聚类分析和降维技术,识别电池数据中的潜在模式和特征。强化学习方法通过构建动态决策模型,在电池运行过程中不断优化预测策略和调整参数。上述方法不仅可以提高预测精度,还可以在

复现反向传播BP算法:手动实现与Sklearn MLP对比分析【复现】

完整代码 import numpy as npimport matplotlib.pyplot as pltfrom sklearn.datasets import make_moonsfrom sklearn.model_selection import train_test_splitfrom sklearn.datasets import load_breast_cancerfr

KAN vs MLP

KAN基于表示定理:任意一个多元函数,可以用多个单元函数复合(例如+法)表示出来。 不需要用特别深的神经网络。 定理的不好的点:没有描述单元函数本身有多复杂。 原作者如何基于定理设计KAN kan = 残叉分枝+样条分支 (spline branch)样条函数是一个分段多项式函数 基础储备: 本文关注于:KAN和MLP的比较,关注于算法的计算复杂度,参数量+forward float

【求助帖】用PyTorch搭建MLP网络时遇到奇怪的问题

求助:我在测试自己搭建的通用MLP网络时,发现它与等价的参数写死的MLP网络相比效果奇差无比,不知道是哪里出了问题,请大佬们帮忙看下。 我写的通用MLP网络: class MLP(nn.Module):def __init__(self, feature_num, class_num, *hidden_nums):super().__init__()self.feature_num = fea

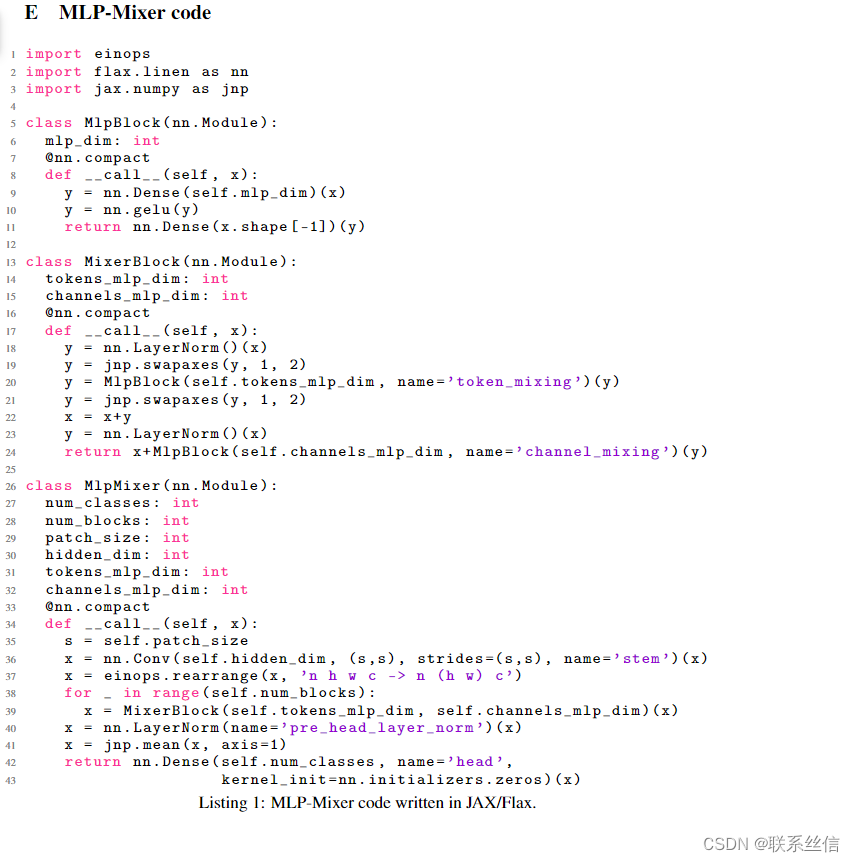

【模块缝合】【NIPS 2021】MLP-Mixer: An all-MLP Architecture for Vision

文章目录 简介代码,from:https://github.com/huggingface/pytorch-image-models【多看看成熟仓库的代码】MixerBlock paper and code: https://paperswithcode.com/paper/mlp-mixer-an-all-mlp-architecture-for-vision#code 简

论文阅读Rolling-Unet,卷积结合MLP的图像分割模型

这篇论文提出了一种新的医学图像分割网络Rolling-Unet,目的是在不用Transformer的前提下,能同时有效提取局部特征和长距离依赖性,从而在性能和计算成本之间找到良好的平衡点。 论文地址:https://ojs.aaai.org/index.php/AAAI/article/view/28173 1,动机(Motivation) 现阶段主流医学图像分割模型大多基于CNN和Tran

【论文+代码】VISION PERMUTATOR 即插即用的多层感知器(MLP)模块

目录 论文模块创新点 代码模块分析代码讲解 论文 本文的研究成果在项目的实现过程中起到了至关重要的作用。以下是本文的详细信息: 文章链接: VISION PERMUTATOR: A PERMUTABLE MLP-LIKE ARCHITECTURE FOR VISUAL RECOGNITION 模块 创新点 在多个方面进行了创新和改进,以下是项目的主要创新点: 代码

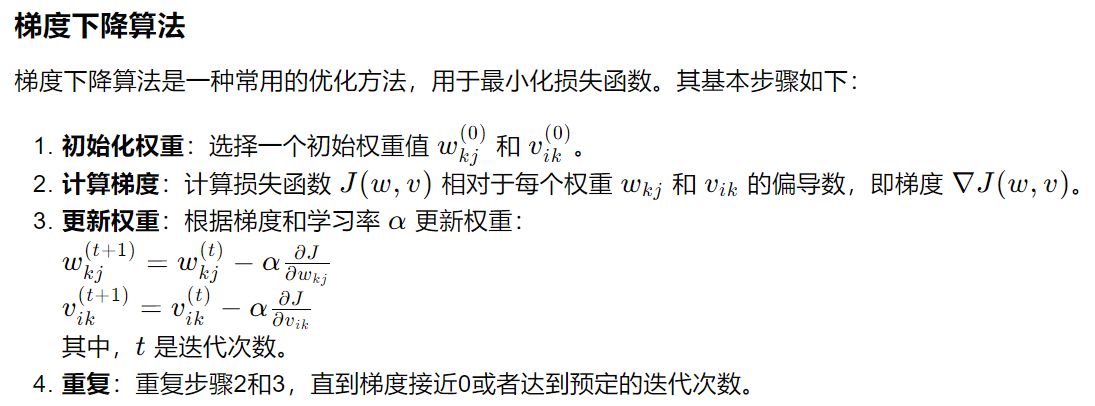

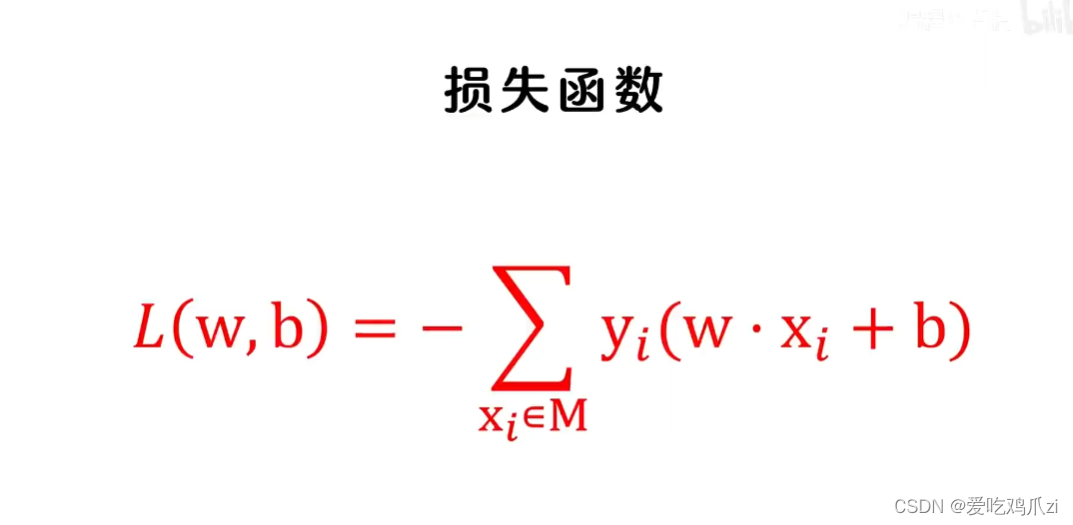

前馈神经网络FNN、多层感知机MLP和反向传播推导

目录 一、前馈神经网络FNN 激活函数的使用 二、多层感知机MLP MLP的典型结构 多层感知机MLP的特点 和前馈神经网络FNN的区别 三、传播推导 1、前向传播(Forward propagation) (1)输入层到隐藏层 (2)隐藏层到输出层 2、反向传播(Backward propagation) (1)正向传播(Forward Pass) (2)反向传播(Ba

机器学习-MLP预测

本文使用机器学习MLP对数据进行预测。 1、数据 1.1 训练数据集: medol.xlsx文件示例 otv3015-1.9153622093018-1.9634097763021-1.7620284083024-1.789477583 1.2 预测数据集 test.xlsx文件示例 ot35163519 2、模型训练 train.py import pandas as

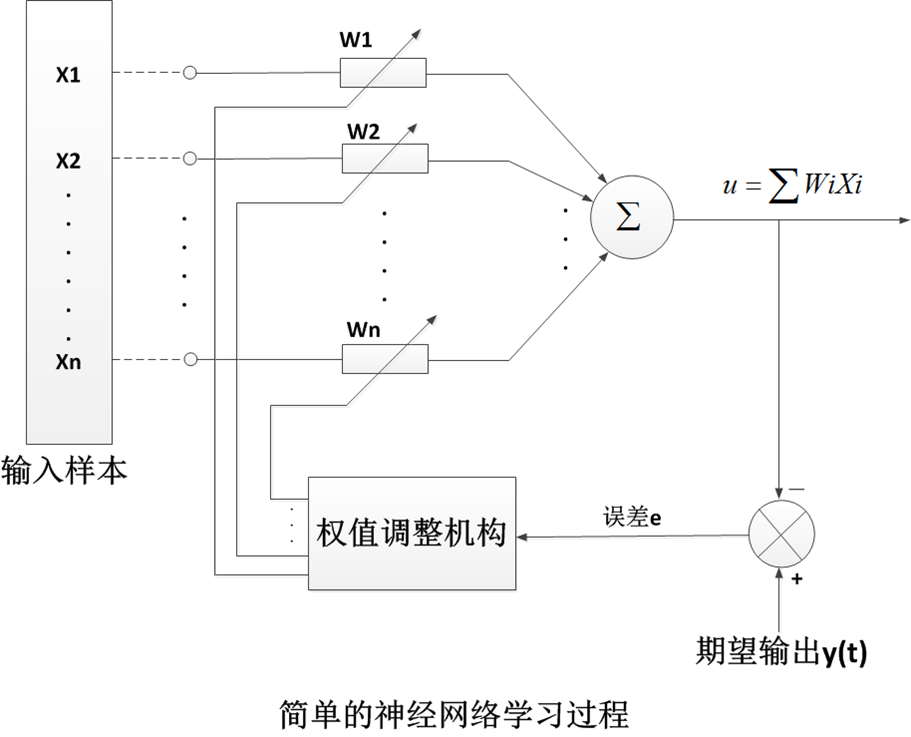

MLP(多层神经网络)与人工神经网络

ANN的特点 (1) 高度的并行性 人工神经网络是由许多相同的简单处理单元并联组合而成,虽然每个单元的功能简单,但大量简单单元的并行活动,使其对信息的处理能力与效果惊人。 (2) 高度的非线性全局作用 神经网络系统是由大量简单神经元构成的,每个神经元接受大量其他神经元的输入,通过非线性输入、输出关系,产生输出影响其它神经元。网络就是这样互相制约相互影响,实现从输入状态空间到输出状态空间非线

多层感知机(MLP)示例

通过5个条件判定一件事情是否会发生,5个条件对这件事情是否发生的影响力不同,计算每个条件对这件事情发生的影响力多大,写一个多层感知机模型pytorch程序,最后打印5个条件分别的影响力。 一 在多层感知机(MLP)模型中,输入特征(本例中的5个条件)通过多个全连接层进行非线性变换,最终产生输出。与线性模型不同,MLP能够学习特征之间的复杂交互,并且通过隐藏层的激活函数引入非线性。 影响

MLP实现fashion_mnist数据集分类(2)-函数式API构建模型(tensorflow)

使用函数式API构建模型,使得模型可以处理多输入多输出。 1、查看tensorflow版本 import tensorflow as tfprint('Tensorflow Version:{}'.format(tf.__version__))print(tf.config.list_physical_devices()) 2、fashion_mnist数据集分类模型 2.1 使用

MLP手写数字识别(2)-模型构建、训练与识别(tensorflow)

查看tensorflow版本 import tensorflow as tfprint('Tensorflow Version:{}'.format(tf.__version__))print(tf.config.list_physical_devices()) 1.MNIST的数据集下载与预处理 import tensorflow as tffrom keras.datasets

深入理解多层感知机MLP

1. 基础理论 神经网络基础: 目标:了解神经网络的结构,包括神经元、权重、偏置和激活函数。 神经网络是由多个层次的神经元组成的网络,它模拟了人脑处理信息的方式。每个神经元可以接收输入、处理输入并生成输出。这一过程涉及到权重、偏置和激活函数的使用。让我们详细探讨这些组成部分及其在神经网络中的角色。 神经元(Neuron) 神经元是神经网络的基本单元。在生物学中,神经元接收来自其他神经细胞

Python中实现多层感知机(MLP)的深度学习模型

深度学习已经成为机器学习领域的一个热门话题,而多层感知机(MLP)是最基础的深度学习模型之一。在这篇教程中,我将向你展示如何使用Python来实现一个简单的MLP模型。 什么是多层感知机(MLP)? 多层感知机(MLP)是一种前馈神经网络,它包含一个输入层、一个或多个隐藏层以及一个输出层。每个层都由一系列的神经元组成,神经元之间通过权重连接。MLP能够学习输入数据的非线性特征,因此在复杂问题的

Keras 入门课1 -- 用MLP识别mnist手写字符

#Keras 入门课1: 使用Keras写一个mlp 本系列课程代码,欢迎star: https://github.com/tsycnh/Keras-Tutorials mlp就是multilayer perceptron,多层感知机。数据集用的是经典的mnist,数字分类问题。 首先导入keras的各种模块 keras.datasets 里面包含了多种常用数据集,如mnist,cifar1

基于MLP算法实现交通流量预测(Pytorch版)

在海量的城市数据中,交通流量数据无疑是揭示城市运行脉络、洞察出行规律的关键要素之一。实时且精准的交通流量预测不仅能为交通规划者提供科学决策依据,助力提升道路使用效率、缓解交通拥堵,还能为公众出行提供参考,实现个性化导航服务,进而提升整个城市的运行效能。然而,交通流量受到众多因素的交织影响,如天气变化、特殊事件、节假日效应、时段特性等,其动态变化规律呈现出显著的非线性、时变性和不确定性,这无疑给预测

2021年机器学习什么风向?谷歌大神Quoc Le:把注意力放在MLP上

来源:机器之心本文约2600字,建议阅读5分钟Attention is all you need. [ 导语 ]在机器学习领域里有一句俗话:「Attention is all you need」,通过注意力机制,谷歌提出的 Transformer 模型引领了 NLP 领域的大幅度进化,进而影响了 CV 领域,甚至连论文标题本身也变成了一个梗,被其后的研究者们不断重新演绎。 技术潮流总有变化的

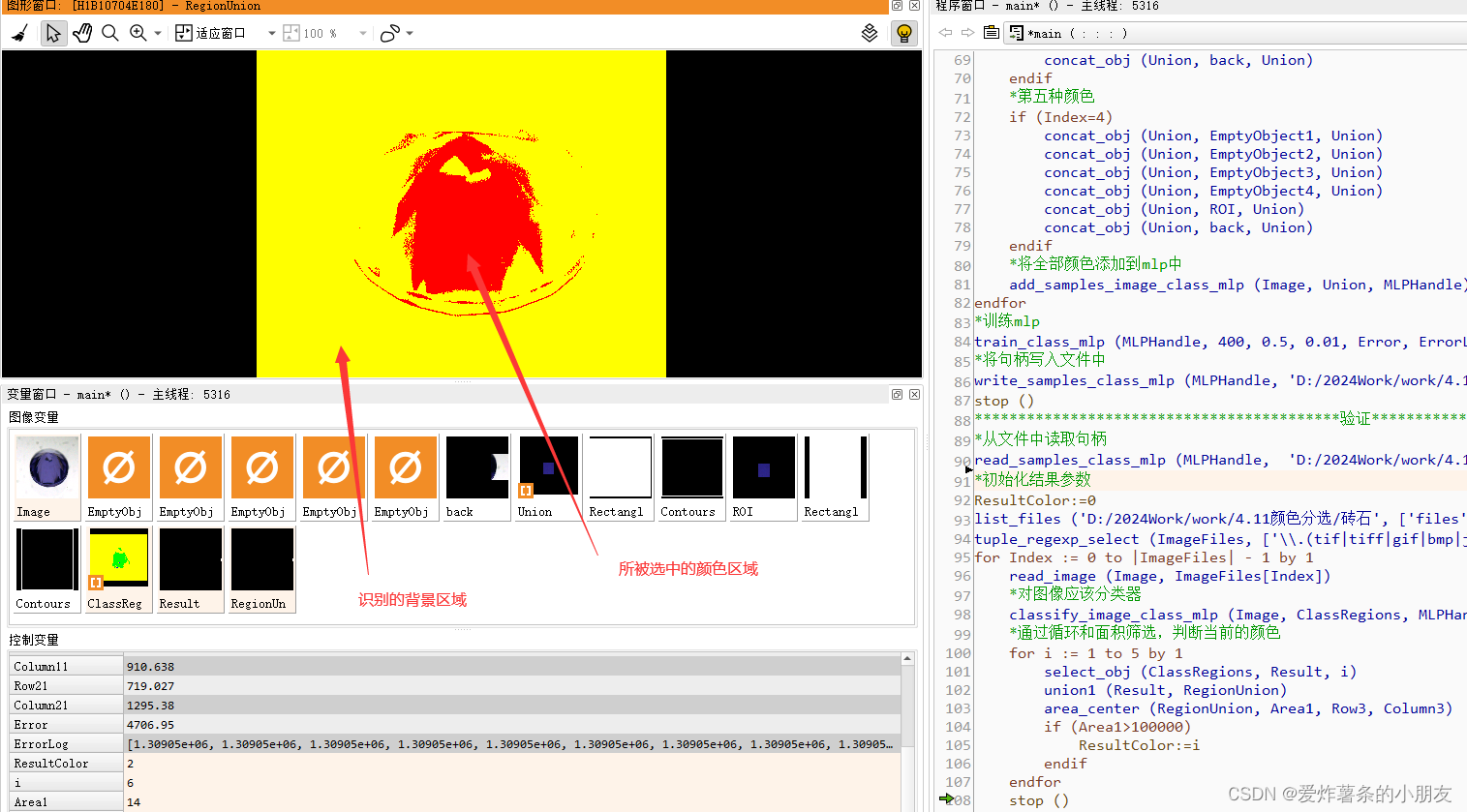

Halcon颜色抽取-多产品颜色(MLP)

前言 //颜色抽取,单产品多区域https://blog.csdn.net/m0_51559565/article/details/135216905 由于在颜色抽取上面,我已经发了一篇博客了,是单产品多区域的情况。所以对于细分原理上就不过多的描述了。 本文主要是针对多产品多颜色的情况进行说明。实际生产线中,往往会出现n种产品同时存在的情况,他们可能颜色不同,或者颜色及其相近。其中本文章就

theano中的concolutional_mlp.py学习

(1) evaluate _lenet5中的导入数据部分 1 # 导入数据集,该函数定义在logistic_sgd中,返回的是一个list 2 datasets = load_data(dataset) 3 4 # 从list中提取三个元素,每个元素都是一个tuple(每个tuple含有2个元素,分别为images数据和label数据) 5 tr

多层感知机-----自我神经MLP入门笔记

多层感知机(Multilayer Perceptron, MLP)是一种常见的人工神经网络(Artificial Neural Network, ANN)模型,它由多个人工神经元组成的多层结构。每个神经元都与前一层的所有神经元连接,并且每条连接都有一个对应的权重。MLP通常包括输入层、若干个隐藏层和输出层。 在输入层,神经元接收输入数据,并将其传递到下一层。隐藏层接收来自上一层的输入,并通过

pytorch 实现多层神经网络MLP(Pytorch 05)

一 多层感知机 最简单的深度网络称为多层感知机。多层感知机由 多层神经元 组成,每一层与它的上一层相连,从中接收输入;同时每一层也与它的下一层相连,影响当前层的神经元。 softmax 实现了 如何处理数据,如何将 输出转换为有效的概率分布,并应用适当的 损失函数,根据 模型参数最小化损失。 线性意味着单调假设:任何特征的增大都会导致模型输出的增大(如果对应的权重为正),或者导致模 型输出的

科罗拉多州立大学发布 CSU-MLP 模型,用随机森林算法预测中期恶劣天气

: By 超神经 内容一览:近期,来自美国科罗拉多州立大学与 SPC 的相关学者联合发布了一个基于随机森林的机器学习模型 CSU-MLP,该模型能够对中期 (4-8天) 范围内恶劣天气进行准确预报。目前该成果刊已发表在《Weather and Forecasting》期刊上。 关键词:恶劣天气 机器学习 随机森林 作者 | 缓缓 编辑 | 三羊 天气预报尤其是恶劣天气预报对人们日常

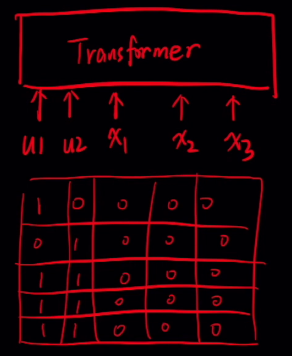

学习笔记【mlp与self-attention】

mlp与self-attention mlp是针对一维向量的,参数是固定的,输入的形状是固定的。能够对全局的每一个元素进行感知self-attention实质上是一种更通用的mlp。是针对序列的,参数是可以根据输入进行调整的,能够确保序列中的每一个token能够感知其他token。二者都能够进行全局感知 相关工作 (1)MLP-Mixer 概要:通过不断堆积Mixer层(与transfor

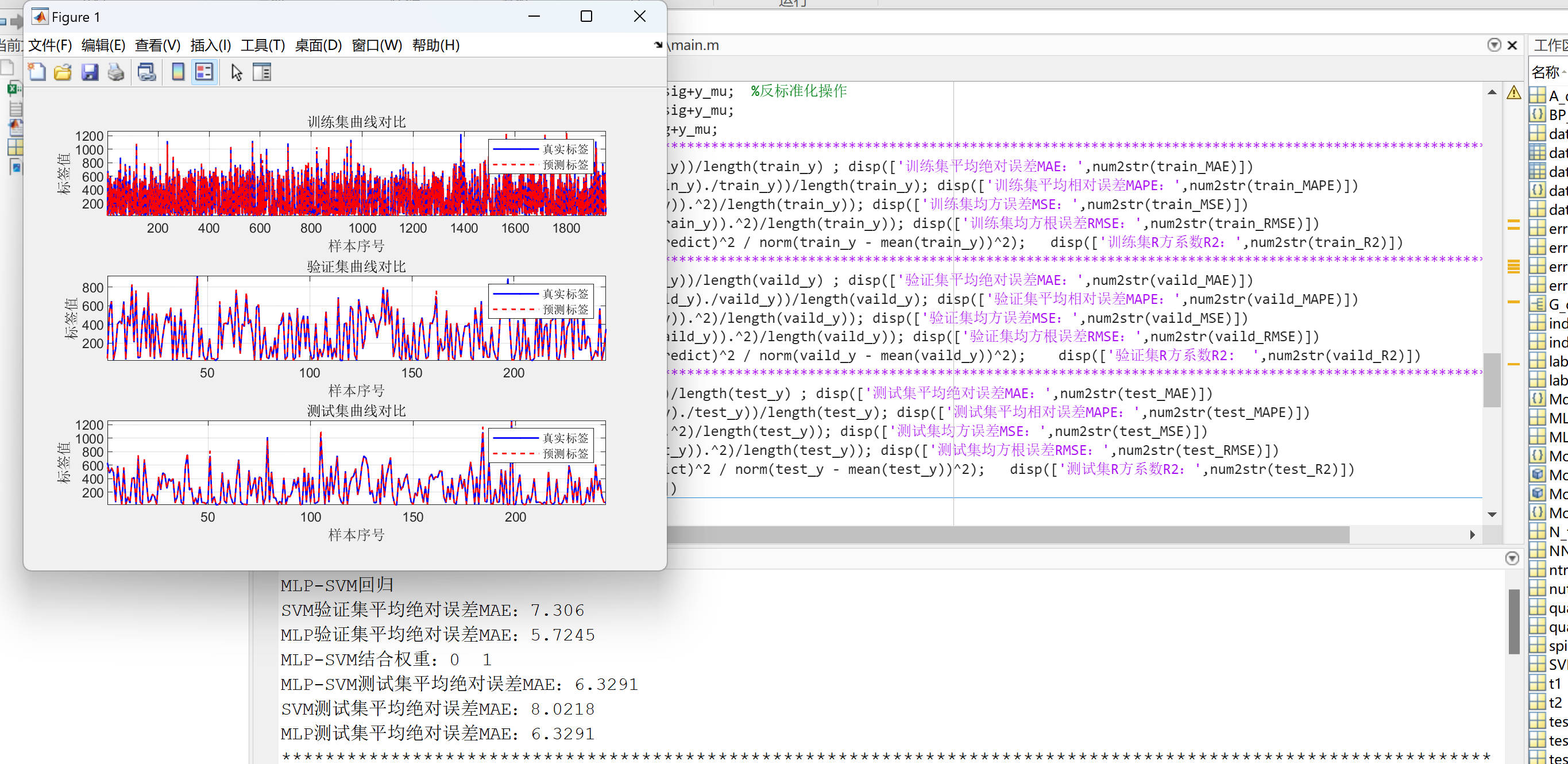

MLP-SVM回归预测(matlab代码)

MLP-SVM回归预测matlab代码 数据为Excel股票预测数据。 数据集划分为训练集、验证集、测试集,比例为8:1:1 模块化结构: 代码将整个流程模块化,使得代码更易于理解和维护。不同功能的代码块被组织成函数或者独立的模块,使得代码逻辑清晰,结构化程度高。 可视化结果: 代码中包含了对训练过程和预测结果的可视化,真实标签与预测标签的对比等,有助于直观地评估模型的性能和结果的准确性。

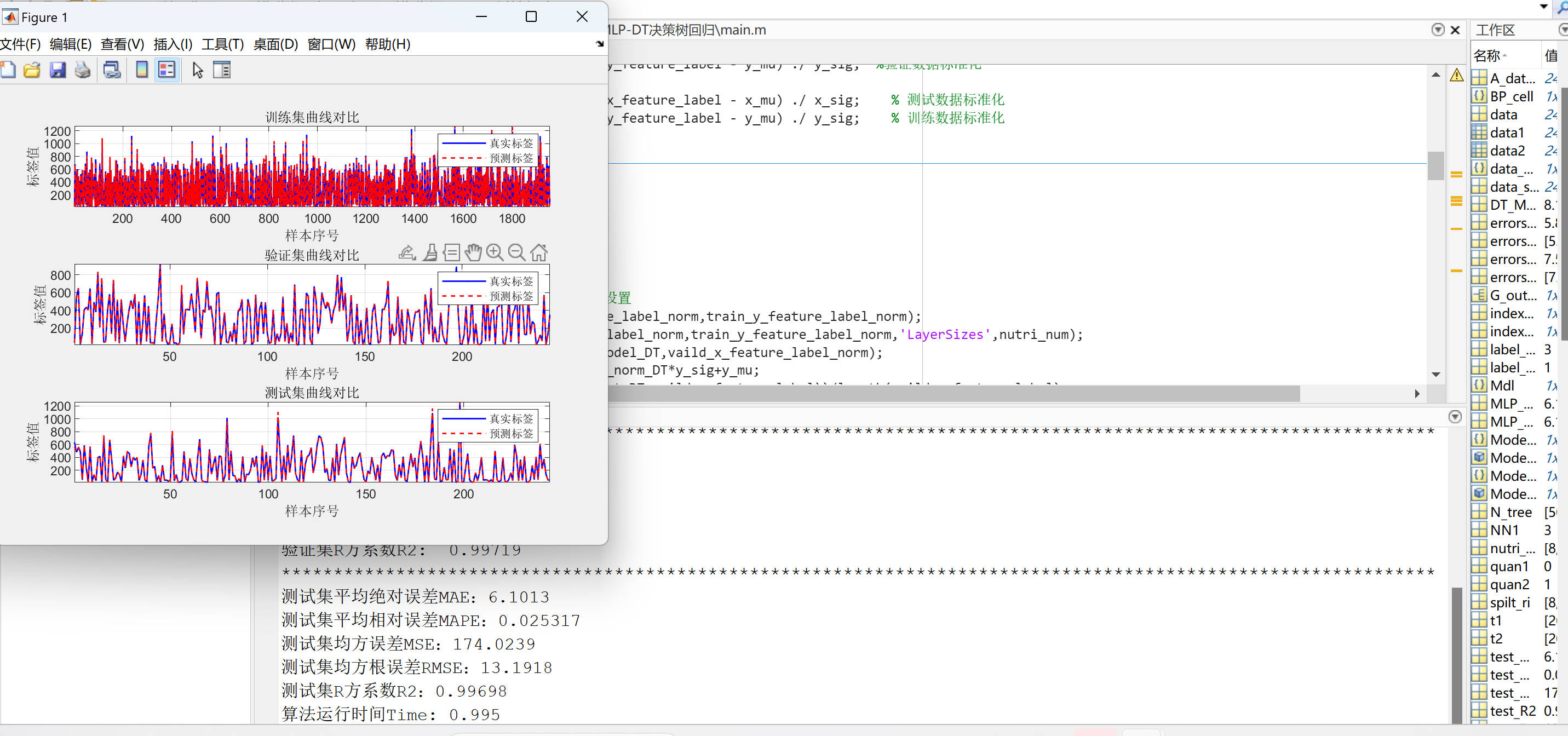

MLP-DT决策树回归预测(matlab代码)

MLP-DT决策树回归预测matlab代码 数据为Excel股票预测数据。 数据集划分为训练集、验证集、测试集,比例为8:1:1 模块化结构: 代码将整个流程模块化,使得代码更易于理解和维护。不同功能的代码块被组织成函数或者独立的模块,使得代码逻辑清晰,结构化程度高。 可视化结果: 代码中包含了对训练过程和预测结果的可视化,真实标签与预测标签的对比等,有助于直观地评估模型的性能和结果的准确