本文主要是介绍“PowerInfer:消费级GPU上的高效大语言模型推理引擎“,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

PowerInfer是由上海交通大学IPADS实验室开发的一个高效大语言模型(LLM)推理引擎,专为个人电脑(PC)上的消费者级GPU设计。它通过利用LLM推理中的高局部性,实现了快速且资源消耗低的模型推理,这一局部性主要体现在神经元激活的幂律分布上,即少数“热”神经元频繁激活,而大多数“冷”神经元则在特定输入下激活。

PowerInfer基于大型语言模型(LLM)在推理时神经元激活的局部性特征。这种局部性表现为神经元激活的幂律分布,即少数热激活的神经元在多数情况下被频繁使用,而大多数冷激活的神经元则在特定输入下才被激活。利用这一原理,PowerInfer设计了一个GPU-CPU混合推理引擎。它将热激活的神经元预加载到GPU中,以便快速访问,而将冷激活的神经元的计算任务分配给CPU。这种设计显著减少了GPU的内存占用和CPU-GPU之间的数据传输,从而提高了整体的推理效率。

PowerInfer还集成了自适应预测器和神经元感知的稀疏操作,进一步提升了计算效率。自适应预测器可以根据模型的实时运行情况动态调整,而神经元感知的稀疏操作则优化了稀疏矩阵的计算。

PowerInfer的这些设计使其能够在个人电脑的消费级GPU上高效地运行大语言模型,同时保持较低的资源消耗。总的来说PowerInfer的优势在于其专为个人电脑的消费级GPU设计的高效推理能力,这使得它在资源受限的环境下也能发挥出色的性能:

- 性能优化:通过识别并优先处理频繁激活的神经元(热神经元),PowerInfer能够在GPU上实现快速推理,同时将不常激活的神经元(冷神经元)的计算任务分配给CPU,从而优化了资源使用。

- 资源利用:这种混合使用GPU和CPU的方法减少了对GPU内存的需求,并且降低了两者之间的数据传输,提高了整体的计算效率。

- 易用性:PowerInfer提供了简洁的安装和部署流程,支持跨平台使用,包括Linux、Windows和macOS,使得用户可以轻松地在不同操作系统上运行大型语言模型。

- 模型兼容性:它支持多种流行的稀疏模型,包括Falcon、Llama2等,为用户提供了灵活性和选择空间。

- 量化技术:PowerInfer支持模型量化,特别是INT4量化,这有助于减少模型的存储占用和提高推理速度,进一步适应资源受限的设备。

- 开源社区:作为一个开源项目,PowerInfer拥有活跃的社区支持,这意味着它能够快速迭代,不断加入新特性,并得到广泛的性能优化和问题修复。

- 性能评估:提供了详细的性能评估数据,用户可以清晰地了解其在不同模型和硬件配置下的性能表现。

PowerInfer的开源性质,加上其活跃的社区和不断更新的特性,使其成为一个在消费级硬件上部署和运行大语言模型的强大工具。开发者和研究人员可以利用PowerInfer在本地PC上高效地进行LLM推理,无需昂贵的服务器级硬件。

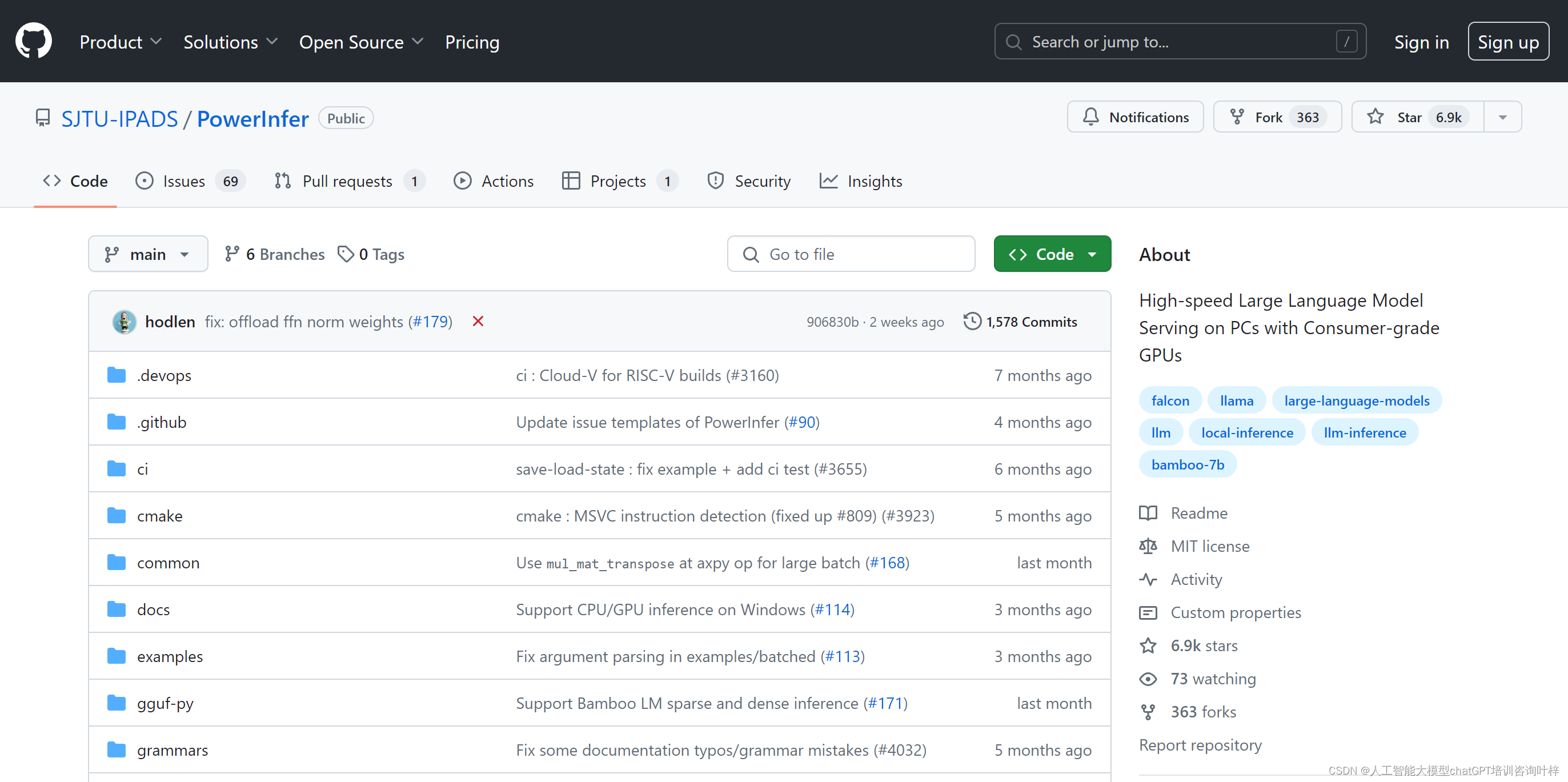

PowerInfer项目可以在GitHub上找到,以下是该项目的链接:

PowerInfer: High-speed Large Language Model Serving on PCs with Consumer-grade GPUs

通过这个链接,用户可以访问PowerInfer的源代码、文档、安装指南和其他相关信息。

这篇关于“PowerInfer:消费级GPU上的高效大语言模型推理引擎“的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!