本文主要是介绍HPT发布HyperGAI 多模态大模型:性能领先GPT-4V,全面胜过Gemini Pro,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

前言

HyperGAI研究团队自豪地宣布推出HPT——新一代领先的多模态大型语言模型(Multimodal Large Language Model, Multimodal LLM)。作为人工通用智能(Artificial General Intelligence, AGI)构建的基石,HPT跨入多模态理解的新时代奠定了基础。与传统的仅文本LLM不同,多模态LLM旨在理解包括文本、图像、视频等在内的多种模态输入。

-

Huggingface模型下载:https://huggingface.co/HyperGAI/HPT

-

AI快站模型免费加速下载:https://aifasthub.com/models/HyperGAI

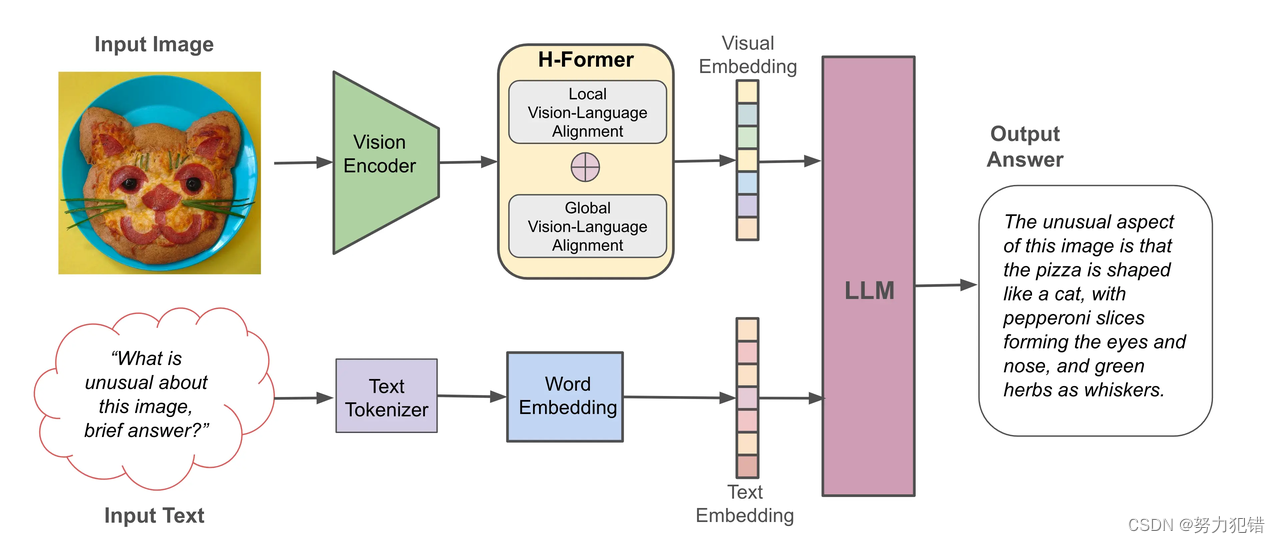

HPT的工作原理

HPT旨在训练一个多模态基础模型,该模型擅长广泛的复杂视觉语言理解任务,包括执行深入推理、分析图表、图解、自然图像等。HPT的创新特性H-Former,作为视觉与语言模态之间的桥梁,通过将视觉数据转换为语言标记,使得LLMs能够理解视觉内容。

HPT的亮点与特性

-

HPT框架:提出的Hyper-Pretrained Transformers(HPT)框架,是一种全新的多模态LLM预训练框架。它能够以高效和可扩展的方式训练出一个大型的多模态基础模型,这个模型能够理解多种模态的输入。

-

HPT Pro与HPT Air:发布了两种不同尺寸的HPT模型——HPT Pro和HPT Air。HPT Pro是解决极其复杂多模态任务的最强模型,而HPT Air则是一个成本效益高、能够解决广泛视觉和语言任务的高效版本。

-

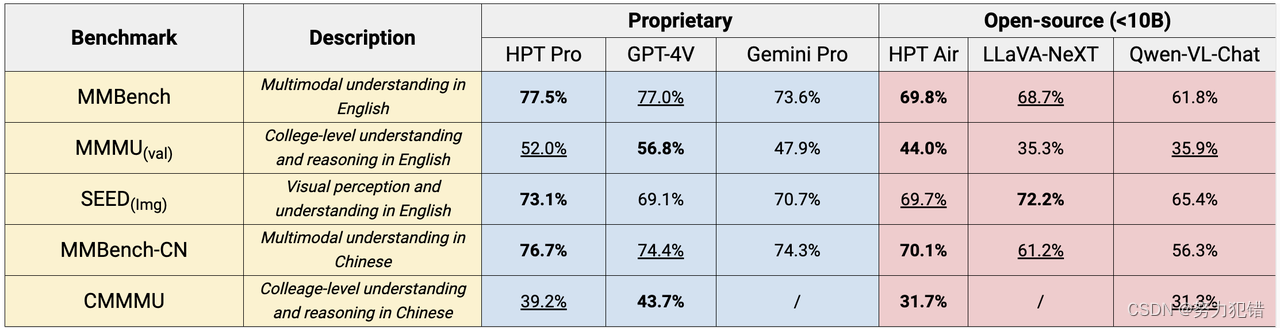

性能表现:在MMBench和SEED-Image基准测试中,HPT Pro超越了如GPT-4V和Gemini Pro等更大的竞争对手,并在极具挑战性的MMMU基准测试中展现了与一些更大的最新模型相匹敌的竞争性能。同时,HPT Air也在MMMU基准测试中实现了同等或更小尺寸模型中的最佳结果,并且通过开源免费提供HPT Air模型,用于研究和商业用途。

多模态基准测试中的强大表现

对HPT模型的多模态理解能力进行了一系列具有挑战性的多模态基准测试评估。这些基准测试包含大学水平的主题知识和深入推理要求(如MMMU和CMMMU),或者在各种视觉和语言任务中需要常识和空间理解(如SEED (img), MMBench和MMBench-CN)。在多项基准测试中,HPT Pro和HPT Air显示出了优于如GPT-4V, Gemini Pro和Qwen-VL等领先竞争者的卓越性能。

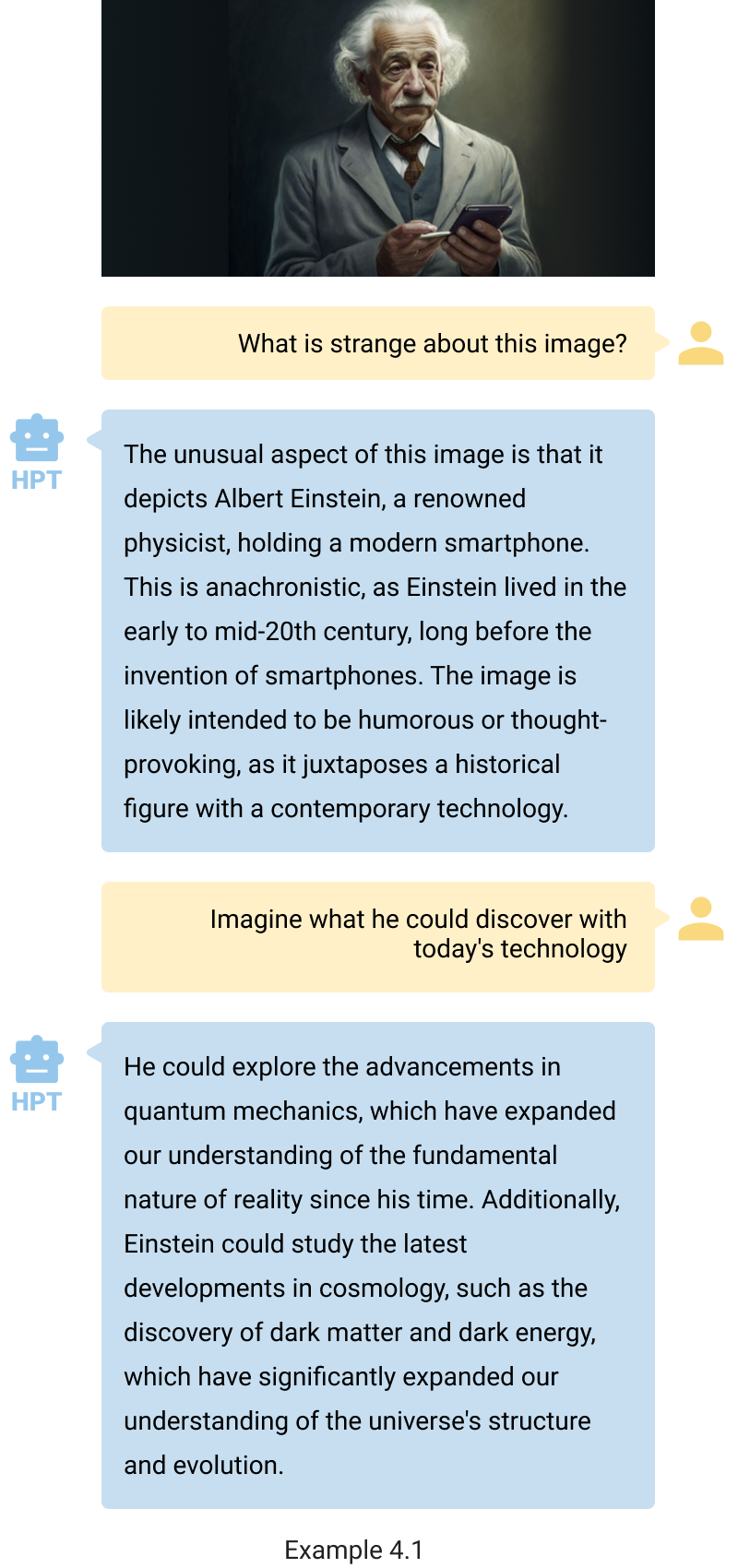

HPT模型在实际应用中的表现

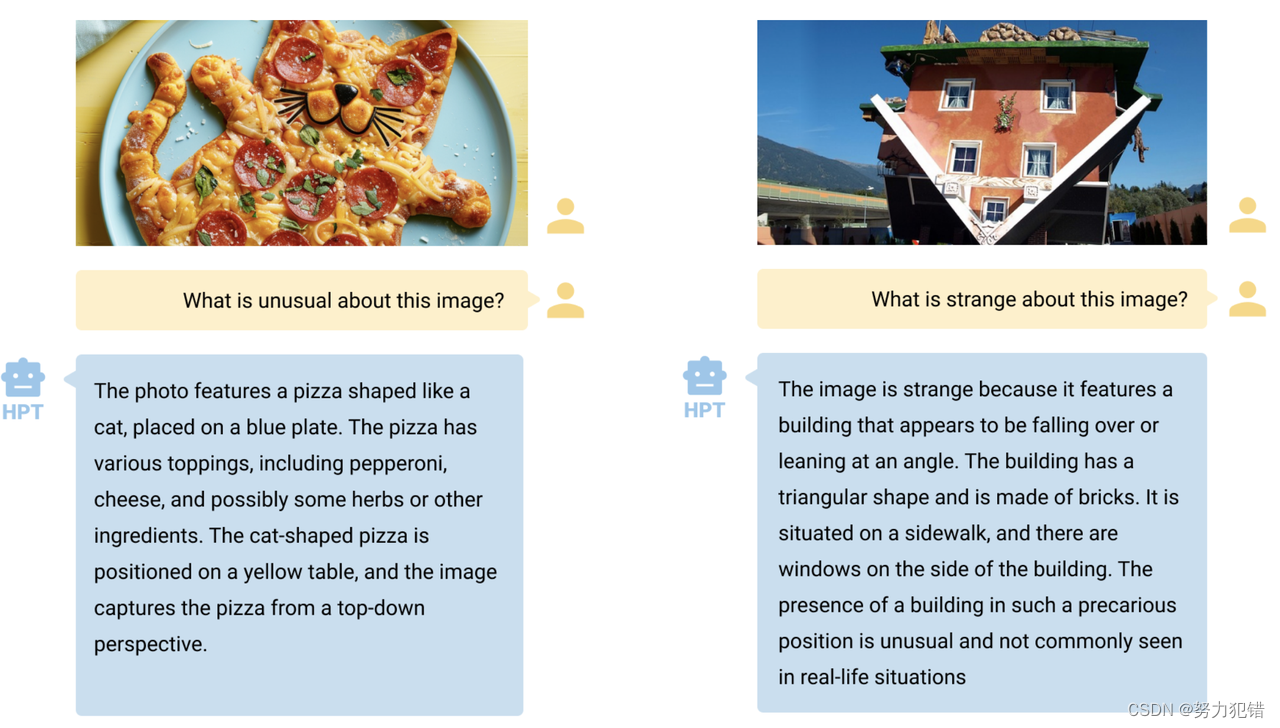

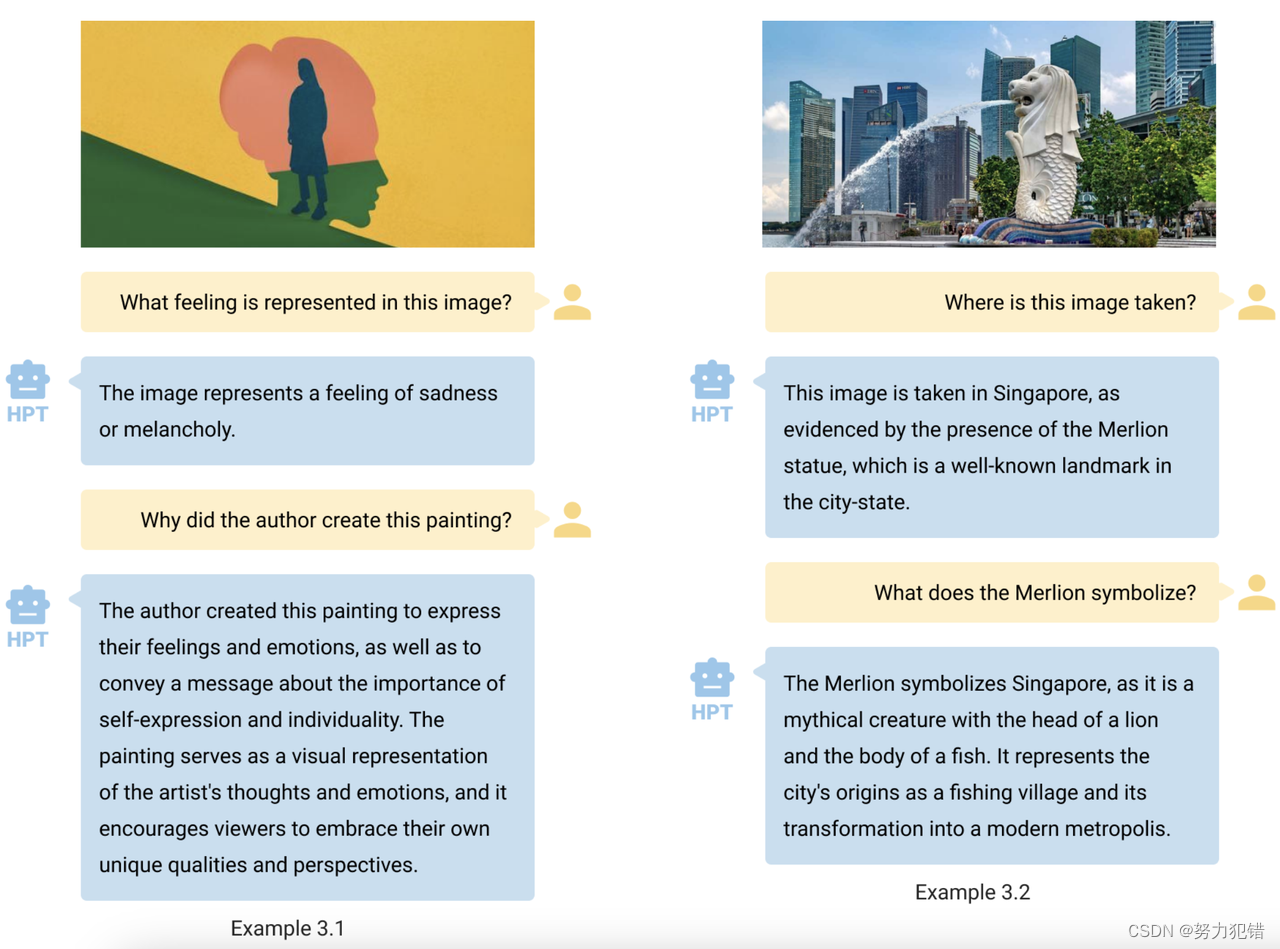

HPT不仅在理解方面强大,而且极具创造力。它能够理解并描述视觉图像的内容,解读图表、图解并回答以数据为基础的科学问题。此外,HPT在理解概念艺术、提供有用的建议方面也表现出色,能够根据图像内容推荐菜肴并提供应对晕船的建议。

HPT示例效果:

-

查看、描述并遵循指令

-

了解概念艺术

-

创意

未来展望

总之,HPT作为一个创新的多模态LLM预训练框架,为构建能够理解文本和视觉等多种输入类型的多模态基础模型提供了一个灵活和可扩展的框架。通过在多项基准测试中与最新的竞争者相比展现出高竞争性的结果,HPT展示了令人印象深刻的多模态能力。

模型下载

Huggingface模型下载

https://huggingface.co/HyperGAI/HPT

AI快站模型免费加速下载

https://aifasthub.com/models/HyperGAI

这篇关于HPT发布HyperGAI 多模态大模型:性能领先GPT-4V,全面胜过Gemini Pro的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!