本文主要是介绍Stable Diffusion 绘画入门教程(webui)-ControlNet(姿态预处理器openpose),希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

本片文章接着上篇文章ControlNet介绍他的控制类型,本篇介绍的预处理器为openpose

预处理器:openpose

模型:control_v11p_sd15_openpose

没下载模型的看上篇文章去下载一下哦,不然用不了

文章目录

- 一、干什么用的

- 二、详细用法

- 1、选大模型

- 2、写提示词

- 3、基础参数设置

- 4、启用controlNet

- 三、其他

一、干什么用的

这个处理器主要用于控制姿态,通常的实战用法用于:

1、控制人物身体姿势

2、控制人物手指(经常出现手指畸形或多手指用这个很方便控制住)

3、控制人物表情

如下图,控制整体大概姿势(我没写芭蕾舞,所以生成的姿态像,但像坐着二傻的姿态,哈哈哈,这就是有趣的地方啦)

二、详细用法

和之前一样,流程依然是:

1、选大模型

2、写提示词

3、基础参数设置

4、启用controlNet(上传图片、选择controlNet模型、调节controlNet参数)

1、选大模型

我这里用的是“majicMIXrealistic_v6.safetensors ”,根据自己喜好选择合适大模型即可

2、写提示词

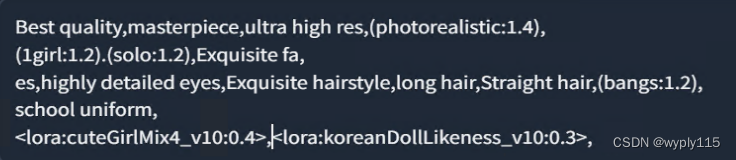

依然是画质、主体、主体细节、人物服装和其他,加上lora

反向提示词配上通用的即可(不知道的伙伴参考之前的文章)

3、基础参数设置

这里注意的是宽和高尽量和之前一致哦,可以通过后边的controNet有个按钮,点一下就直接同步过来,不用手填。

4、启用controlNet

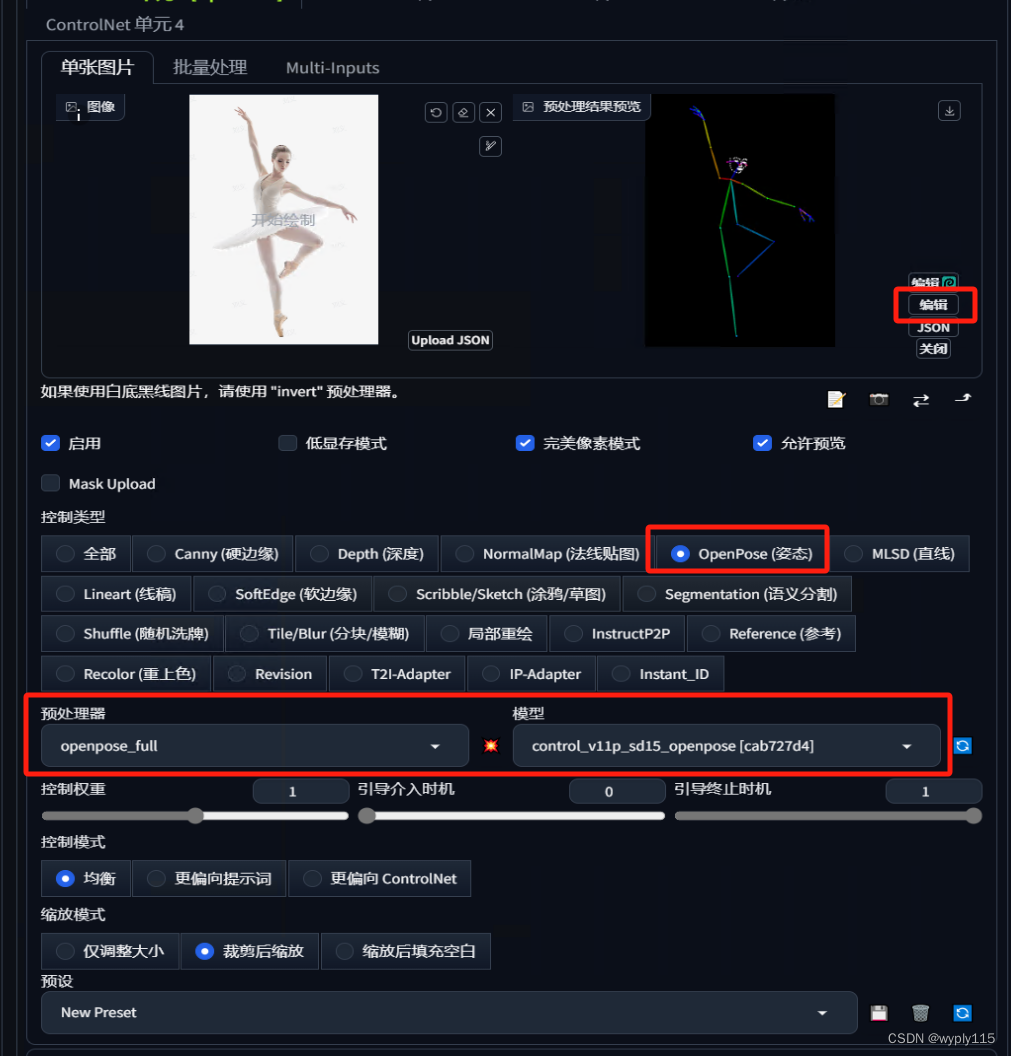

这里要控制整体姿态,用的是openpose

点击预处理器右边的爆炸图标,上边就可以看到预处理结果啦

然后点击预处理结果右下角的编辑,可以随意编辑火柴人调节姿态

三、其他

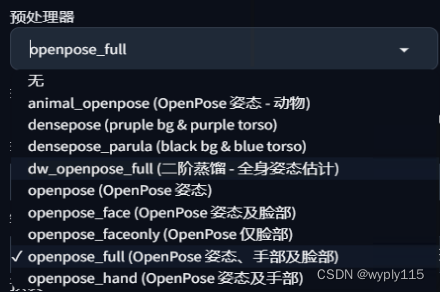

注意,姿态的预处理器还有其他几个

我自己使用的经验,一般手指比较清晰能识别出来的话,或者你手动调整能调整好就用带手部的预处理器,如果不行就用只识别姿态的处理器。

脸部的话因为点比较多,最好是近景特写脸部得照片用脸部的识别,否则生成的图像可能不太符合你的口味🤣。

这篇关于Stable Diffusion 绘画入门教程(webui)-ControlNet(姿态预处理器openpose)的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!