本文主要是介绍李宏毅deep learning theory P1 can shallow network fit any function,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

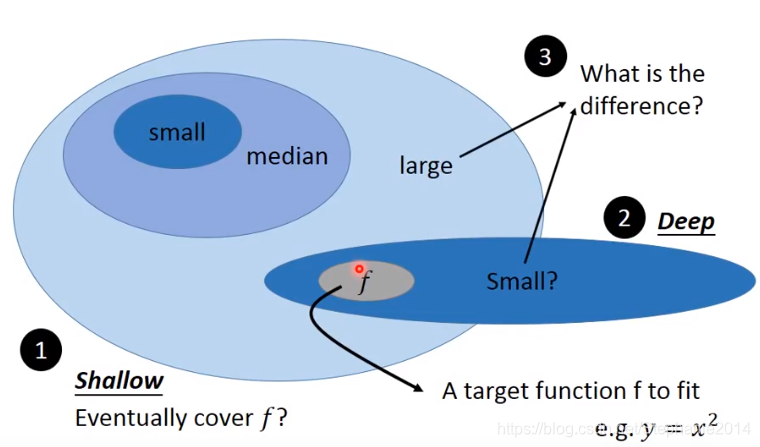

shallow的network已经可以fit any function,deep的有什么优势

deep的network和shallow训练出来的有什么不同

1. can shallow network fit any function?

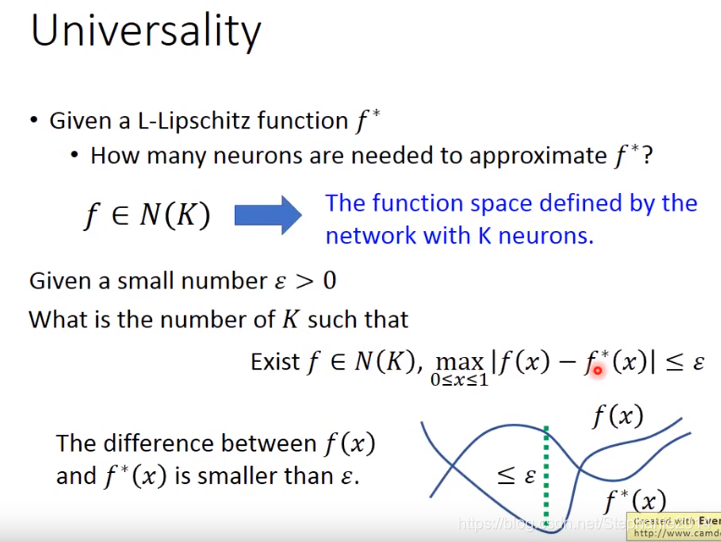

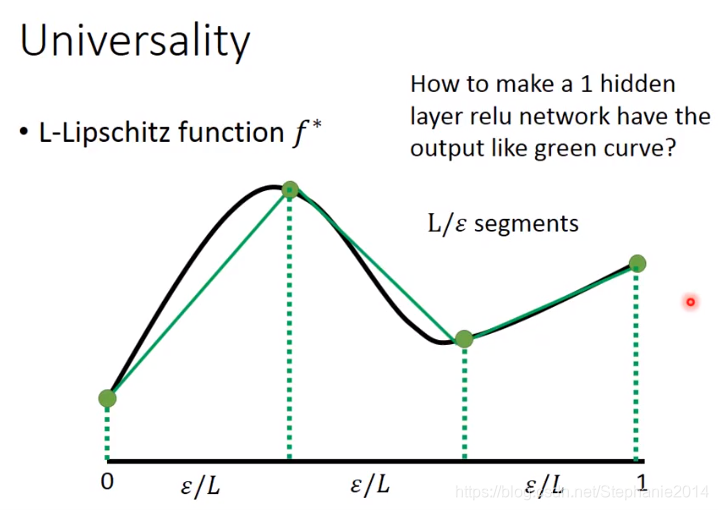

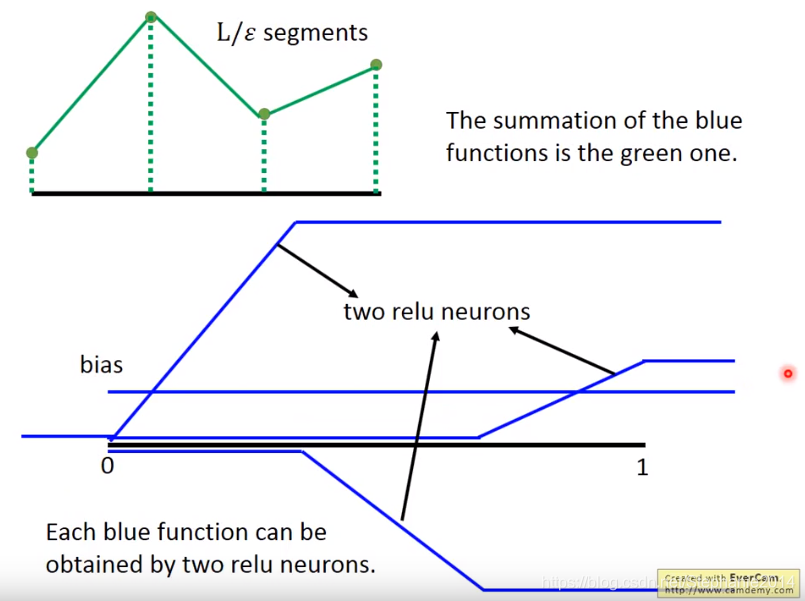

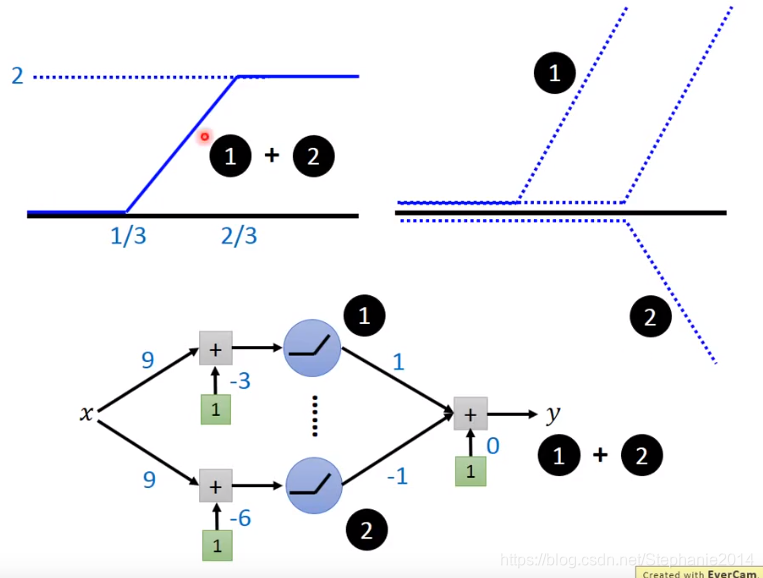

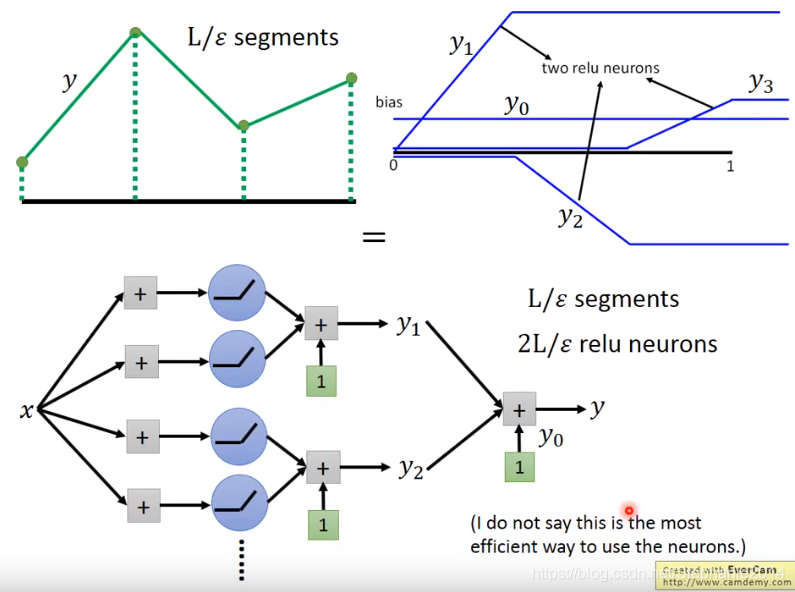

用神经网络去拟合一个L-lipschitz的函数,使得最大的差值error小于epsilon,需要分L/epsilon个segment,需要L/epsilon个神经元拟合

因此对于任何L-lipschitz的函数都可以用一层hidden layer的reLU去fit

这篇关于李宏毅deep learning theory P1 can shallow network fit any function的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!