本文主要是介绍带延迟的随机逼近方案(Stochastic approximation schemes):在网络和机器学习中的应用,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

1. 并行队列系统中的动态定价Dynamic pricing

1.1 系统的表述

一个含有并行队列的动态定价系统,该系统中对于每个队列有一个入口收费(entry charge) ,且系统运行的目标是保持队列长度接近于某个理想的配置。

这里是这个系统的几个关键假设:

a. 存在 K 个并行队列(parallel queues):每个队列 i 都有一个入口收费,这个收费可能会根据队列的当前状态动态变化。

b. 队列长度观测:表示在时间 n 的第 i 个队列的长度。节点 i 并不能看到队列的准确状态

,而是看到一个之前的状态

。这里的

可以理解为观测延迟或者是系统状态更新的时间差。

c. 观测误差:实际队列长度被假设为入口收费

的函数

加上一个误差项

,这个误差项的绝对值被限制在一个上限

以内。这表明虽然有观测误差,但误差是有上限的。

d. 理想队列长度配置:系统试图维持队列长度接近于一个理想配置。这个理想配置代表了系统的优化目标,即每个队列都试图保持其长度接近于这个配置。

总结来说,这个系统试图通过调整每个队列的入口收费来控制队列长度,尽管存在观测延迟和有限的观测误差。系统的目标是保持队列长度接近于预先定义的理想状态,这可能是为了优化服务时间、最小化排队时间或者是均衡负载。在实际应用中,这样的模型可以用于交通管理、服务中心排队系统,或者是计算资源分配等场景。

1.2 对于系统的简单表述

如果对于理解上面的系统有困难的朋友,我来用更简单的方式解释这个系统。

想象有好几个排队的地方,每个地方都要收费进入。这些就是并行队列,每个队列都有自己的价格。

a. 多个队列:有很多个队列,每个队列入口都有不同的费用。

b. 队列长度:每个队列有很多人在排队。但是负责这个队列的人不能实时知道现在队伍有多长,他们只能知道一段时间前队伍有多长。

c. 价格和队列长度的关系:队列有多长,部分取决于它的价格。价格高了,可能排队的人就少;价格低了,可能就排很多人。但是,这个关系不是完全准确的,有一点误差。

d. 理想的队列长度:系统想让每个队列的长度都维持在一个理想状态,不太长也不太短。

总的来说,这个系统就是通过调整每个队列的入口费用来控制每个队列的长度,让它们尽量保持在一个理想的状态。这种方法在很多地方都有用,比如帮助减少交通堵塞,或者让服务更高效。

1.3 动态定价模型

这个描述提出了一种用于管理并行队列系统中队伍长度的动态定价模型。让我们详细解释一下:

1.3.1 目标

目的: 本地和动态地管理价格

为了:确保队伍长度趋向于“理想状况”

1.3.2 提出的解决方案

公式:

其中:

参数说明:

:在时间 n 时,队列i 的当前价格。

:调整率。

:在时间

时的当前队列长度。

:理想的队列长度。

:队列长度反馈的时间延迟。

p:价格调整的边界参数。

1.3.3 解决方案实质

如果当前队列长度高于理想状态: 提高价格以减少新进入者。

如果当前队列长度低于理想状态:降低价格以鼓励更多进入者。

1.3.4 实际应用

该模型可以应用于各种需要队列管理的场景,如售票系统、服务中心或交通管理。通过根据当前队列长度与理想长度的比较来动态调整价格,目的是优化流程和减少等待时间,从而提高效率和顾客满意度。

该模型的成功依赖于准确确定理想队列长度、调整率以及系统对这些价格变化的响应能力。这需要仔细的校准和可能的实时数据分析,以进行有效的调整。

1.4 图像表达

这张图展示了一个包括用户、链接、数据包来源和价格设定者的系统的方框图。

在这个系统中:

- 用户(User):生成数据包并根据价格决定是否发送数据包。

- y(t):在时间t的队列长度,可以被视为系统的当前状态。

- p(t):在时间t的价格,由价格设定者确定。

- Delay D1:数据包从用户到达队列的延迟。

- 队列(y1(t) 到 y4(t)):这是系统中的四个并行队列,每个队列都可以独立调整价格来控制数据包的流入。

- 链接(Link):处理从各个队列传出的数据包的出口链接。

- 价格设定者(Price Setter):根据队列长度y(t)动态调整价格p(t),并且可能会有延迟D2。

- Delay D2:价格调整影响用户的延迟。

整个系统的目标是通过动态调整价格,使得每个队列的长度趋向于理想状态,以此来优化整个系统的运作效率。价格设定者必须考虑到从用户到队列的延迟(D1)和从价格设定者到用户的延迟(D2),以确保价格信号能够准确反映当前队列的状态。

2. 分散的社会感知

这是一个在无向图上运行的去中心化或社会感知算法。

我们来详细解释一下:

2.1 图表示

图:它由一组节点

和一组边

组成。

节点:每个节点代表网络中的一个感测器或代理。

边:边将两个节点连接起来,表示它们可以进行通信或相互感知。

2.2 本地迭代过程

每个节点的处理器:每个节点 i 运行一个本地迭代过程,意味着处理过程是分布式的,并且没有中央控制权。

迭代方程:

解释:

:在迭代

时,节点

的当前状态或值。

:集合

的基数,即节点

拥有的邻居数量。

:节点

的邻居集。

:在迭代

时,邻居

的当前状态或值。

:在迭代

时,节点

感知或观察到的值。

:与节点

关联的偏差或基准值。

:与节点

关联的缩放因子或权重。

:一个随时间递减的因子,它可能是平均或学习率的一部分。

2.3 去中心化感知

本地迭代是一种去中心化计算形式。它允许每个节点基于其邻居的值、自己的感测数据以及一些固有属性(如偏差和缩放因子)来更新自己的值。随着时间的推移,这个过程预计将导致达成共识或稳定状态,节点对感测环境有共同的理解,尽管缺乏中央协调者。

这种类型的算法常用于分布式传感器网络,在这样的网络中,每个传感器节点本地处理信息,网络整体上收敛到全局决策或状态估计。在中央数据处理不切实际或不可能的场景中特别有用,例如大规模环境监测或去中心化控制系统。

2.4 分布式传感器网络

在您上传的图像中,我们看到一个传感器网络的示意图,其中包括不同类型的传感器。这里是对图中内容的解释:

温度计(Thermometer):用三角形表示,可能代表具有特定功能的高精度传感器,用于测量温度。

便宜的传感器(Cheap sensor):用圆圈表示,可能指的是低成本、低精度或少数功能的传感器。

虚拟传感器(Virtual sensor):用菱形表示,它们可能不是实际物理设备,而是通过算法或软件合成的传感器,其数据可能来自于其他多个传感器的数据融合。

图中的数字可能代表传感器节点的标识符,而不同的形状和颜色用于区分传感器类型。这种网络可以用于环境监测、健康监测或其他需要多点传感器数据的应用。传感器之间可能会相互通信,共享数据,或者将数据发送到中央处理点。在去中心化感知算法中,这些传感器可以独立运行算法,通过本地通信达到全局目标,比如环境参数的监测或预测。

2.5 传感器网络在不同条件下的信号处理结果

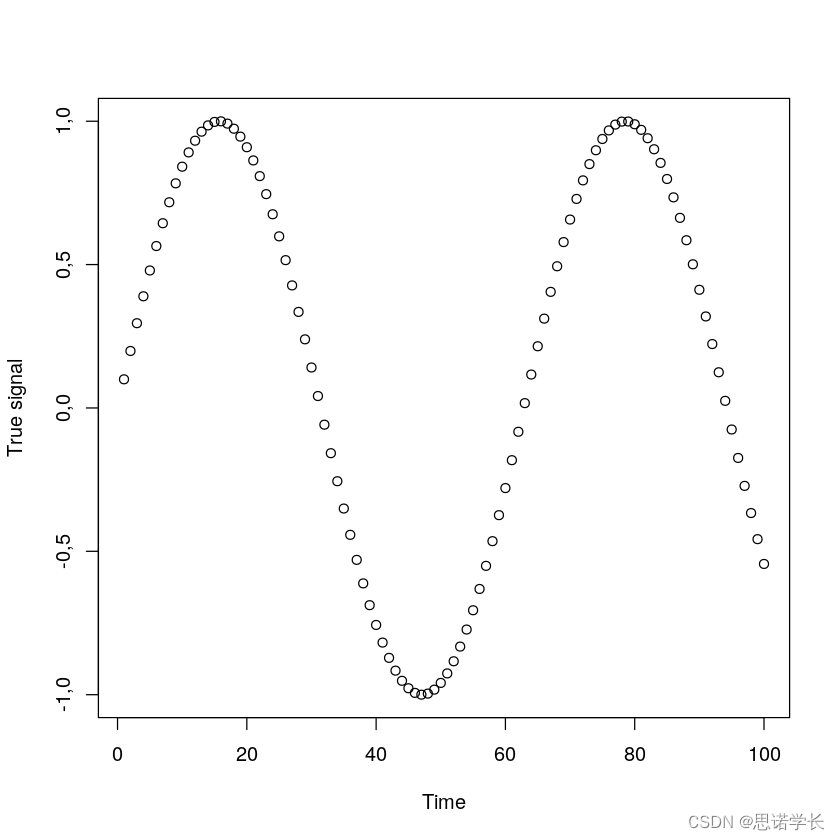

a. 真实信号 (True signal):第一张图显示了一个时间序列的真实信号,是一个周期函数的样本点,如正弦波或余弦波。

b.观察结果 (Observations):第二张图表展示了对真实信号的多个观察结果,每个观察结果都有噪声,可能代表不同传感器的读数。这些观察结果表现出了一定的变异性,说明传感器可能存在误差或噪声。

c. 无通信情况 (Without communication):第三张图表显示了在传感器网络中无通信情况下的信号估计结果。即使没有通信,也使用了一种迭代算法来更新每个传感器的估计值。我们可以看到,即使没有节点间的通信,估计的信号仍然能够跟踪真实信号的大体形状,但存在一些偏差。

您提供的公式似乎是一个迭代更新规则,用于更新某个参数或变量的值。这里是公式的标准形式:

这里是各部分的含义:

:下一个时刻(第

次迭代)节点

的参数值。

:当前时刻(第

次迭代)节点

的参数值。

:在第

次迭代时节点

观察到的值。

:节点

的偏差或基准值。

:节点

的缩放因子或权重。

:学习率或步长,它决定了更新的幅度有多大。

这个公式看起来像是一个简单的学习规则,用于基于观察结果调整 的值。在每次迭代中,

会向

这个比例调整的方向移动,调整的幅度由学习率决定。这可以看作是一种简单的线性回归更新,或者是机器学习中梯度下降步骤的一部分,旨在最小化预测误差。

d. 社会过滤算法 (Social filtering algorithm):最后一张图表展示了应用社会过滤算法后的信号估计结果。这个算法允许传感器相互通信,并且使用邻居的信息来更新自己的估计。我们可以看到,这种方法显著提高了信号估计的准确性,估计的信号更加接近真实信号,噪声和偏差得到了很大程度的减少。

您提供的社会过滤算法公式是一个在分布式网络中用于信息融合和共识达成的算法。公式如下:

这个迭代公式用于计算下一个时间步的节点的估计值

,基于以下几个组成部分:

:这是节点

所有邻居节点

的当前估计值

的平均值。这个部分体现了网络中的社会化信息交换,即每个节点将其邻居的信息平均化来更新自己的状态。

:节点

的邻居数量,即

集合的基数。

:在时间步

节点

的观测值。

:节点

的偏差或基准值。

:节点

的缩放因子或权重。

:这个部分是基于节点

的观测值

对

进行调整的项,它考虑了节点的个体观测值与当前估计值之间的差异,并通过一个固定的学习率(这里是 0.1)进行缩放。

整个公式结合了本地信息(如观测值和偏差)和社交信息(邻居的状态)来更新每个节点的状态。这种机制旨在使网络中的所有节点最终达成一致的状态估计,同时考虑到每个节点的个体观测。这在无中心化网络中尤为有用,如传感器网络、机器人群体和社交网络分析等场合。

通过比较这些图,我们可以看出,使传感器网络中的节点相互通信,可以显著提高整个网络对于真实信号的估计质量。这种方法在实际应用中非常有用,特别是在需要高精度监测的环境中。

3. 随机逼近Stochastic approximation

3.1 随机逼近的定义

随机逼近(Stochastic Approximation)是一种用于在不确定性条件下寻找函数最优点的数学方法。典型的随机逼近方案通常具有以下形式:

在这个方程中,包含了以下几个经典要素:

a. 前一个估计(The previous guess):是在第

次迭代中的参数估计值。

b. 小更新量(a small-update):这是迭代过程中的调整量,由步长参数控制其幅度。更新量由两部分组成:

确定性函数(A deterministic function):,通常是目标函数的梯度或是一个引导搜索方向的函数。

零均值噪声(A noise with zero mean):,代表噪声或随机误差,其期望值为零,用以模拟随机过程中的不确定性。

c. 投影函数:这是为了确保迭代过程的良好行为而设计的一个函数。它通常用于将更新后的估计值“投影”回一个可行的或受限的空间内,以保证解不会偏离预定的约束区域。

随机逼近是许多机器学习和优化算法的基础,特别是当优化问题涉及到随机变量或噪声时。例如,在随机梯度下降(Stochastic Gradient Descent, SGD)算法中,通常是在当前点

处的损失函数的梯度的估计,而

是由于样本抽取引入的噪声。步长

通常会随着迭代的进行逐渐减小,以确保算法最终收敛到最优点。

3.2 练习

3.2.1 在时间n后罐子里有多少个球?

一开始,罐子里有1个黑球和1个白球。在每一个时间点n = 1, 2, 3, ...,都会从罐子里随机取出一个球,然后不管取出的是黑球还是白球,都会放回去,并且额外加入一个黑球。因此,在n个时间点之后,将会额外加入n个黑球。

时间n后罐子中球的总数 = 初始球数 + 加入的黑球数

3.2.2 {yn}的递归更新规则

的值取决于第n个取出的球是黑色还是白色,以及每一步都会增加一个黑球的事实。

如果第n个球是黑色的,那么,因为又增加了一个黑球。

如果第n个球是白色的,那么,因为无论如何都会增加一个黑球。

然而,告诉我们增加的球的颜色:

但是由于每次都会增加一个黑球,并且 仅表示取出的球是否为黑色(而不是增加的球),所以更新规则简化为:

3.2.3 {xn}的递归更新规则以及作为随机逼近stochastic approximation的重写

我们有。所以对于

,我们需要考虑新的球总数和新的黑球数。

利用第2部分中的递归更新规则,我们得到:

由于 ,我们可以将

重写为

。将这个代入

的方程,我们得到:

现在,让我们将其重写为一个随机逼近。随机逼近的一般形式是:

将这与我们的方程进行比较,我们可以将

看作是

,

看作是

,更新步长

看作是

。因为我们的更新只取决于随机抽取

而不是当前状态的确定性函数,所以没有明确的

。

因此,用随机逼近的术语来说,我们的方程变成了:

这里,起到了减小步长的作用,

代表了更新中的随机部分,其中

根据抽出球的颜色引入随机性

4. 收敛定理:ODE方法Convergence theorem: The O.D.E approach

收敛定理是随机逼近理论中的一个核心概念,它涉及到随机过程的长期行为如何接近一个确定性过程。您提到的定理用常微分方程(O.D.E.)的方法来描述了这种行为。这里用中文解释一下这个定理:

4.1 定理

在适当的假设下,随机逼近序列的行为limk→+∞ wk,其中

当趋向于无穷大时的极限,与常微分方程

在

趋向于无穷大时的极限行为是相同的limt→+∞ w(t),。这里

是以下常微分方程的解:

4.2 常微分方程方法的收敛性

该定理的含义是,在一定条件下,随机过程 的长期行为可以通过解常微分方程来理解。在许多应用中,如随机梯度下降,

表示目标函数的梯度,而

是逐渐减小的步长序列,

是随机噪声项。

必要的假设:

定理中提到的适当的假设通常包括但不限于:

步长序列满足某些条件,例如,它们是递减的且和为无穷大但平方和有限(这保证了足够的“探索”,同时随机波动总体上趋于减少)。

函数是光滑的,并且满足一些特定的性质,比如 Lipschitz 连续。

随机项的期望值是零,且具有一定的独立性和有界性质。

结论:

如果这些假设得到满足,那么随机逼近序列 的极限行为将与解决

得到的路径

的行为一致。换句话说,尽管

包含随机性,但在无限时间的极限下,它的行为就像是一个没有噪声的确定性系统。这为理解和分析随机逼近过程提供了一个强有力的工具。

4.3 直观上为什么这是正确的?

回想一下,用于数值逼近常微分方程轨迹的标准“欧拉方案”形式为:

其中,且

是一个小的步长。

随机逼近迭代与此的两个不同之处在于:

1. 常数时间步长 可能被变化的时间步长

替代(例如

)。

2. 噪声项 的存在。

这就是为什么随机逼近方案可以被视为常微分方程的一个带噪声的离散化。在没有噪声的情况下,如果我们取,那么随机逼近就退化为欧拉方案,可以逼近

的轨迹。

当我们引入变化的步长,就像在随机逼近方案中那样,我们实际上是在模拟一个随着时间变化的动态系统,其中步长随迭代次数增加而减小。这模拟了物理系统中的“冷却”过程,例如退火算法中的冷却,其中时间随着系统的“冷却”而变慢。

加入噪声项 可以看作是对系统引入随机扰动,这些扰动可以帮助系统跳出局部最小值,从而有可能找到全局最小值。在随机逼近方案中,虽然噪声可能会导致路径偏离确定性轨迹,但随着步长的减小,系统应该逐渐稳定到一个状态,该状态对应于常微分方程的稳态解。

所以,即使随机逼近方案包括了噪声和变化的步长,但随着时间的推移,它的长期行为是收敛的(convergence),并且与相应的常微分方程的解的行为趋于一致,这是因为噪声项的影响平均来看会被减小,而变化的步长会确保最终的稳定性。这就是为什么随机逼近在足够长的时间内能够逼近常微分方程解的行为的直观理由。

4.4 理论分析方法

这个定理及其基于常微分方程(O.D.E.)的方法之所以重要,是因为它们提供了一种分析和理解随机逼近算法长期行为的框架。这个框架对于设计和理解这类算法特别有用,尤其是在以下两种主要的理论分析方法中:

4.4.1 概率方法

这种方法在统计学家中很流行,它侧重于分析算法的随机性质,如收敛速度、置信区间、以及在不确定性下的性能。概率方法通常涉及复杂的概率论和随机过程理论。

4.4.2 O.D.E.方法

这种方法在工程师中更受欢迎,它将随机逼近算法与确定性的动态系统联系起来。这种联系允许研究者将算法的长期行为视为一个确定性系统的行为,这通常更容易分析和理解。

4.4.3 O.D.E.方法的优势

4.4.3.1 直观性

通过将随机逼近算法与确定性动态系统联系起来,可以更直观地理解算法的行为。工程师可以利用他们对物理系统和动态系统的直观理解来分析算法。

4.4.3.2 简化分析

常微分方程通常比随机过程更易于分析,因为它们不涉及随机性。

4.4.3.3 设计新算法

O.D.E.方法可以作为设计新算法的有用工具。如果有一个确定性的常微分方程能够收敛到期望的状态,那么通过对应的随机逼近可以构造一个概率性的算法,它在长期内也会收敛到相同的状态。

4.4.3.4 强健性和稳定性

在设计控制系统和工程系统时,理解系统如何在各种条件下稳定地运行是至关重要的。O.D.E.方法提供了一种评估算法在各种扰动下稳定性的方式。

总之,O.D.E.方法提供了一种强大的框架,用于分析和设计随机逼近算法。它强调了确定性动态系统的角度,这种角度可以帮助设计新算法,并理解现有算法在长时间内的行为。这个方法桥接了理论分析和实际应用之间的鸿沟,使算法设计者能够从确定性的动态系统的直观理解中受益。

5. 异步随机逼近算法

我们有I个处理器,每个处理器i在每次迭代k时都会更新其值。

5.1 每个处理器遵循的更新规则

递归更新重写为随机逼近

给定的更新规则为:

其中, 是一个随机变量,它满足:

以概率

,

以概率

.

给定的更新规则重写为随机逼近的形式,我们需要考虑每个处理器的更新是如何随机地依赖于当前状态 的。在这个场景中,每个处理器在每一步都有一定的概率

选择应用函数

来更新其状态,或者有概率

保持当前状态不变。因此,更新过程具有随机性,这正是随机逼近方法的特点。

在随机逼近的语境中,我们通常考虑更新项的期望值。对于上述规则,更新项的期望值可以写作:

因此,我们可以将更新规则视为:

这个表达式体现了随机逼近的核心思想:每一步的更新是当前状态的函数,加上一个随机项。这里的随机项是由 和概率

共同决定的。随机逼近方法通常用于求解随机优化问题或在不确定性环境中进行学习和适应。

将这个更新规则重写为随机逼近的形式,我们可以得到:

并且

将

这里的随机逼近可以看作是在随机环境下对确定性递归序列的模拟。

关联的常微分方程(O.D.E.)是随机逼近过程的确定性等价物,可以表达为:

其中,是时间t的状态。

对于算法的收敛性,我们可以得出以下结论:

a. 如果存在一个固定点使得

,并且这个固定点是局部稳定的,那么随机逼近算法可能在概率意义上收敛到这个固定点。

b. 这个收敛过程是随机的,意味着即使在期望值上收敛到

,每次迭代的结果也可能因为随机变量

而有所不同。

c. 收敛速度可能受到概率的影响,因为这决定了更新步骤的频率。

d. 如果函数是线性的或者可以被线性化,并且系统中的随机性可以被适当控制,那么可以使用Lyapunov函数或其他稳定性理论来进一步分析系统的行为和收敛性质。

总结来说,这个异步随机逼近算法在给定条件下,可以期望它会收敛到某个稳定状态,但是这个收敛过程是受到随机因素影响的。收敛的具体性质取决于更新函数\(h\)、概率\(p_i\)以及系统的其他参数。

我们有一个单一的处理器,它使用带有观察延迟的方案来更新参数。更新规则如下:

这里,是一些噪声,

是观察的延迟。我们假设:

1. 对于每次更新,延迟 遵循参数为

的几何分布。

2. 是一个Lipschitz函数,即

。

3. 迭代是有界的,即。

在这些假设下,我们可以证明该算法的行为类似于没有延迟的情况下的常微分方程:

5.2 延迟的影响

考虑到延迟的存在,更新规则使用了之前时间步的信息来计算当前时间步的更新。这意味着每次更新可能并不是基于当前最准确的状态信息。然而,根据上述假设,我们可以推断即使有这样的延迟,长期来看,算法的行为仍然类似于其对应的不带延迟的常微分方程。

5.3 关键点

Lipschitz连续性:Lipschitz条件确保了函数 \( h \) 的局部变化是有限的,这有助于控制因延迟而产生的误差。

有界迭代:迭代有界意味着算法不会因为累积的误差而发散。

几何分布的延迟:几何分布的延迟意味着大多数更新将具有较小的延迟,较大的延迟出现的频率较低,这有助于减轻延迟对算法性能的影响。

5.4 收敛速度

虽然这个结果表明算法最终会表现得像对应的常微分方程一样,但它并没有告诉我们关于收敛速度的信息。延迟可能会减慢收敛,特别是如果延迟较大或者 \( h \) 函数在某些区域变化很大时。因此,尽管长期行为可能是相似的,短期内算法可能会表现出不同的动态,特别是在收敛到稳定点的路径上。

这篇关于带延迟的随机逼近方案(Stochastic approximation schemes):在网络和机器学习中的应用的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!