本文主要是介绍Revisiting RCNN: On Awakening the Classification Power of Faster RCNN,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

1、hard FP

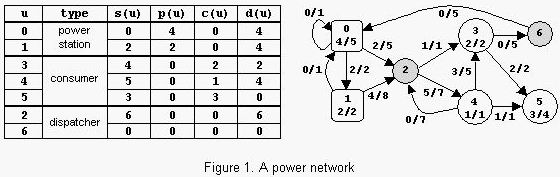

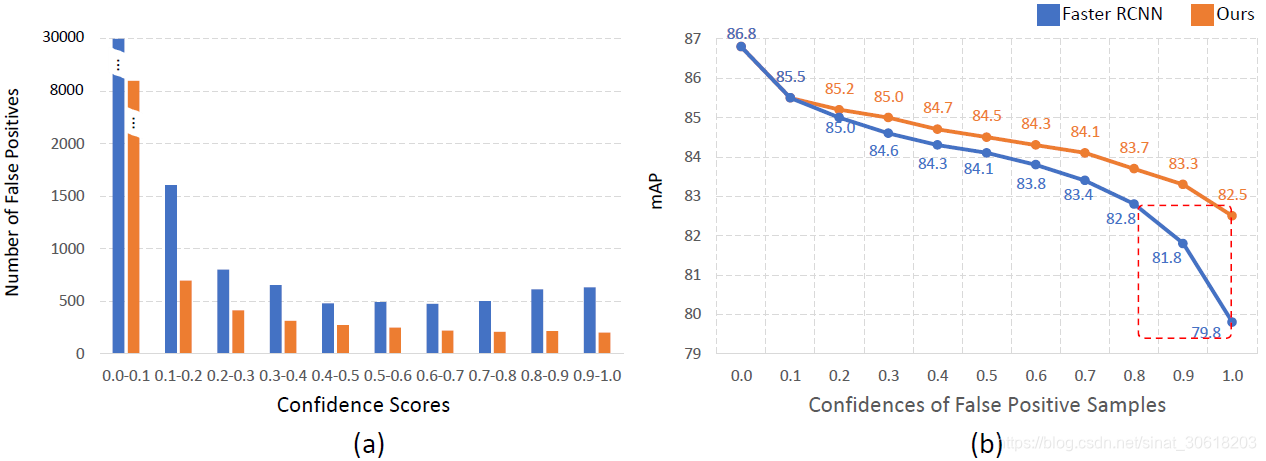

1)极少量的高置信度FP是mAP明显下降的主要原因

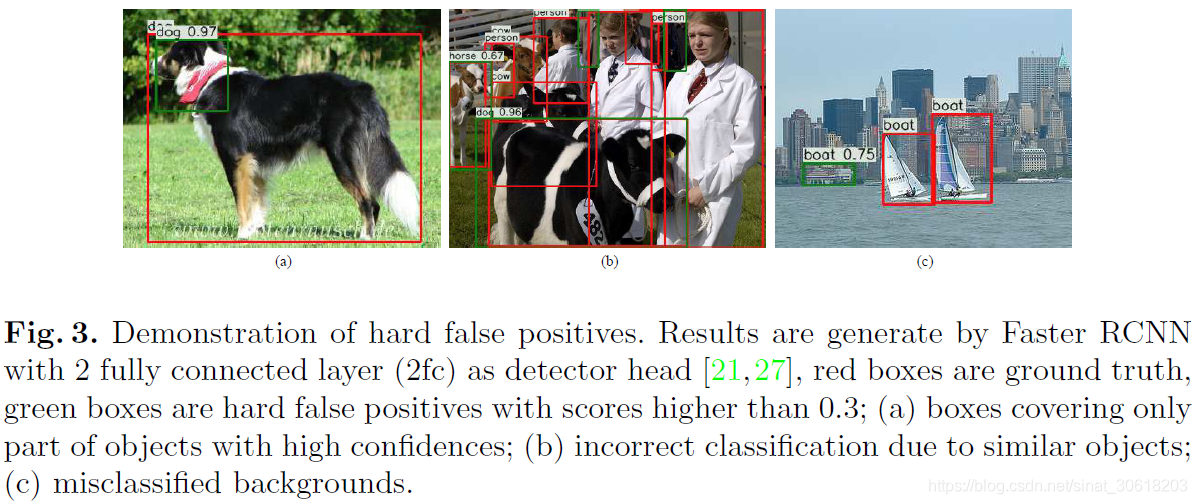

2)hard FP主要有三种:

- 框只覆盖部分目标(IoU小):只覆盖了有辨别力的part

- 相似类之间的区分错误:不同类之间share有辨别力的part;分类器不够强大

- 背景错分为目标:背景pattern与目标相似;感受野过大,包含了相邻的目标物体

* 均由suboptimal分类器导致

2、Faster R-CNN的弊端

1)分类和定位的目标不同,因此共享的特征对两个任务来说并不是最优的

* 分类需要translation invariant特征;定位需要translation covariant特征

2)多任务学习有相互促进的作用,但multi-task loss的最优,对于子任务的loss来说并不是最优的

* MTL适用于backbone较弱的情况,当backbone足够强大时,multi-task无法发掘backbone的潜力

3)proposal的不同目标共享相同的感受野,对于小目标是冗余的,对大目标来说不够(但是不同大小的anchor在roi pooling之后对应的feature map范围不同,所以这一点不能理解)

* 尽管一些网络采用了multi-scale策略,但multi得远远不够

4)sub-sampling操作可能会引入严重的unalignment,例如一个像素的偏移,下采样32倍后,会导致32个像素的偏移

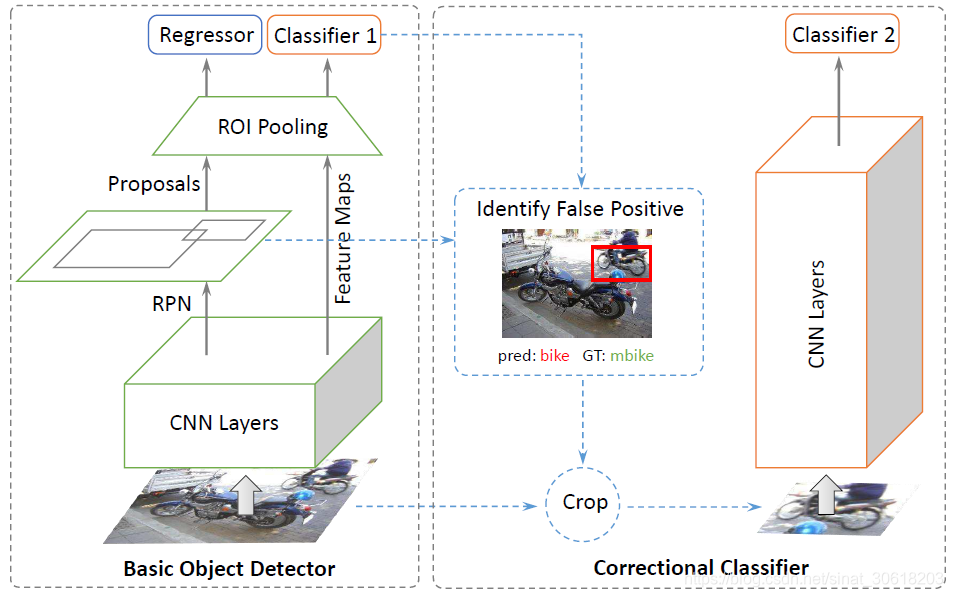

4、Decoupled Classification Refinement (DCR)网络

1)Faster R-CNN输出检测结果,作为region proposal,每个proposal的置信度为score_frcnn

2)根据proposal,在原图上crop-resize相应区域到固定size(相当于把ROI Pooling放到了原图上,但ROI Pooling的感受野明显更大)

3)用hard FP训练类似于R-CNN结构的强分类器,每个proposal的置信度为score_dcr

4)test时,score = score_frcnn * score_dcr,只用score_dcr结果很差,因为rcnn无定位功能,是强分类器,倾向于crop中出现部分目标就预测为正

* DCR和Faster R-CNN不共享参数

这篇关于Revisiting RCNN: On Awakening the Classification Power of Faster RCNN的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!