本文主要是介绍P48类神经网络训练不起来怎么办- BatchNormalization,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

背景

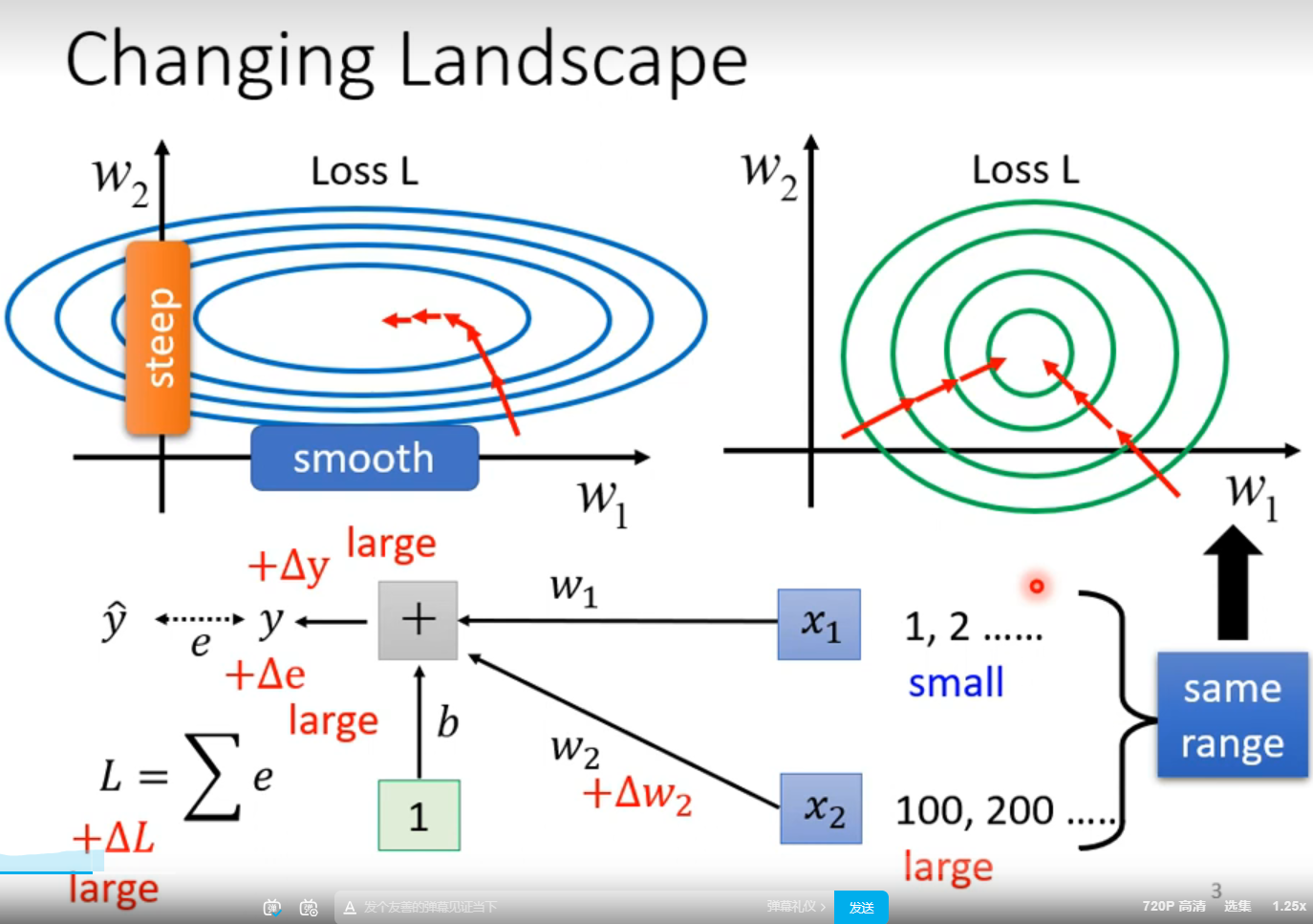

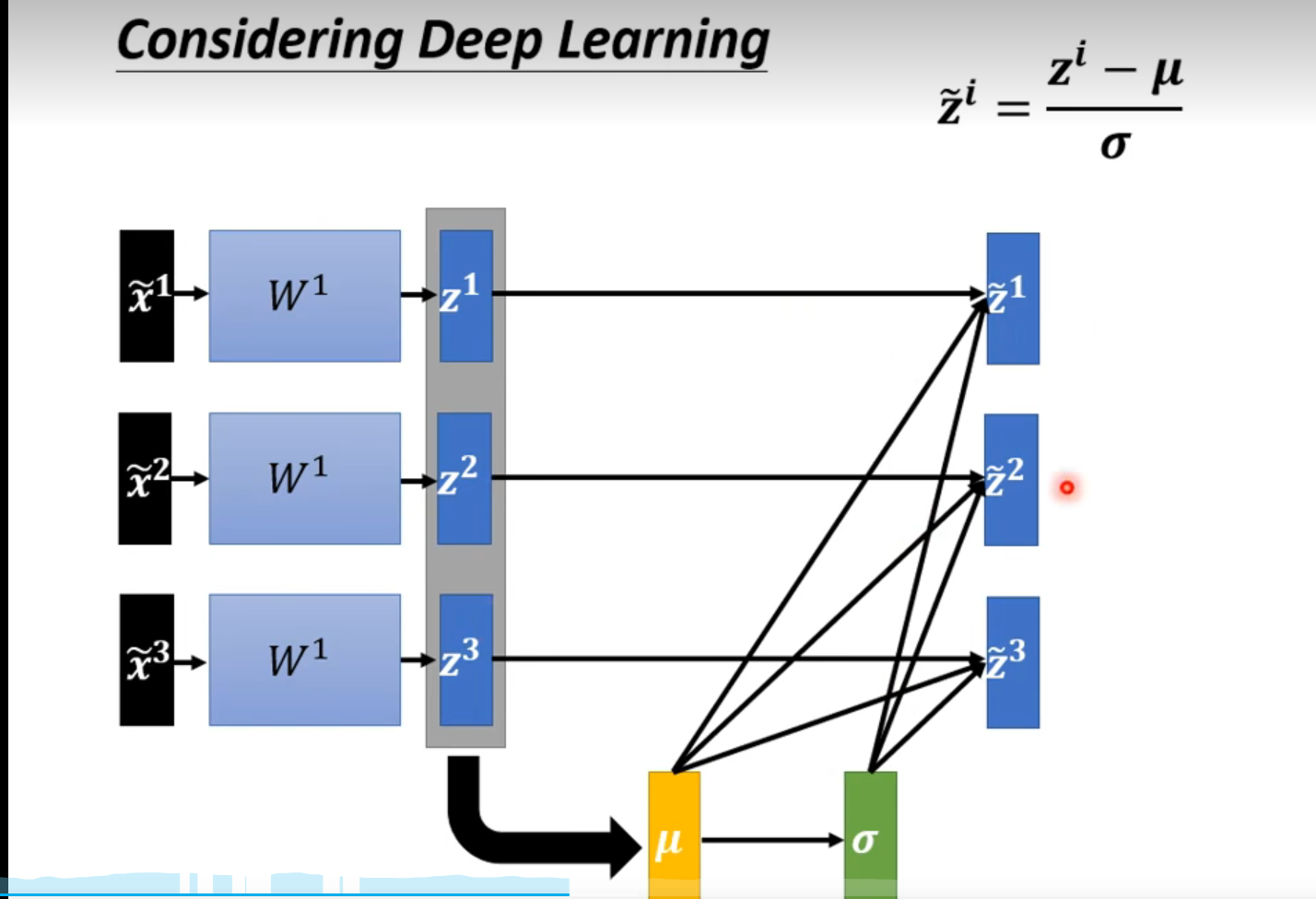

- batch normalization --> 目标把山铲平-- > 可以得到更好的error surface ,让 training 更容易。

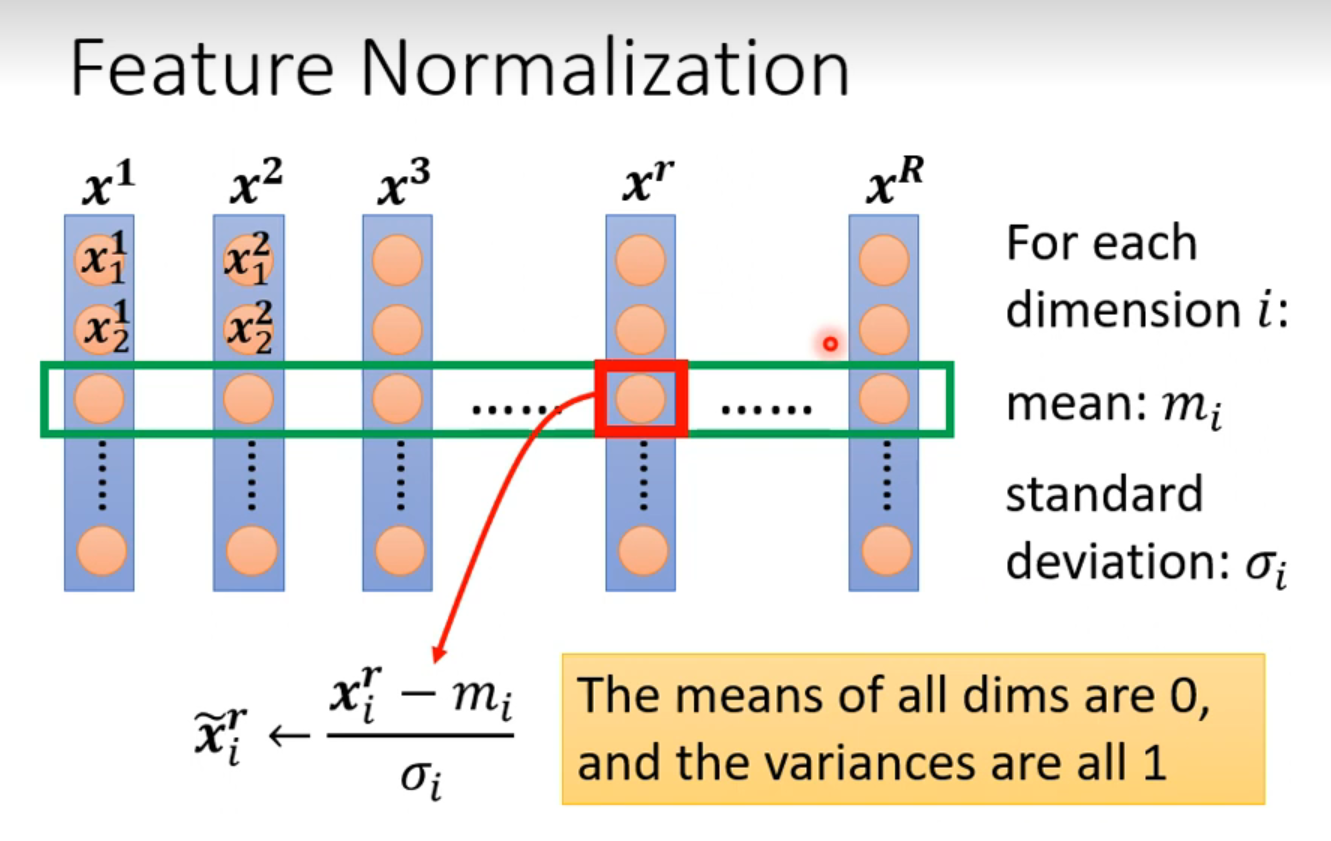

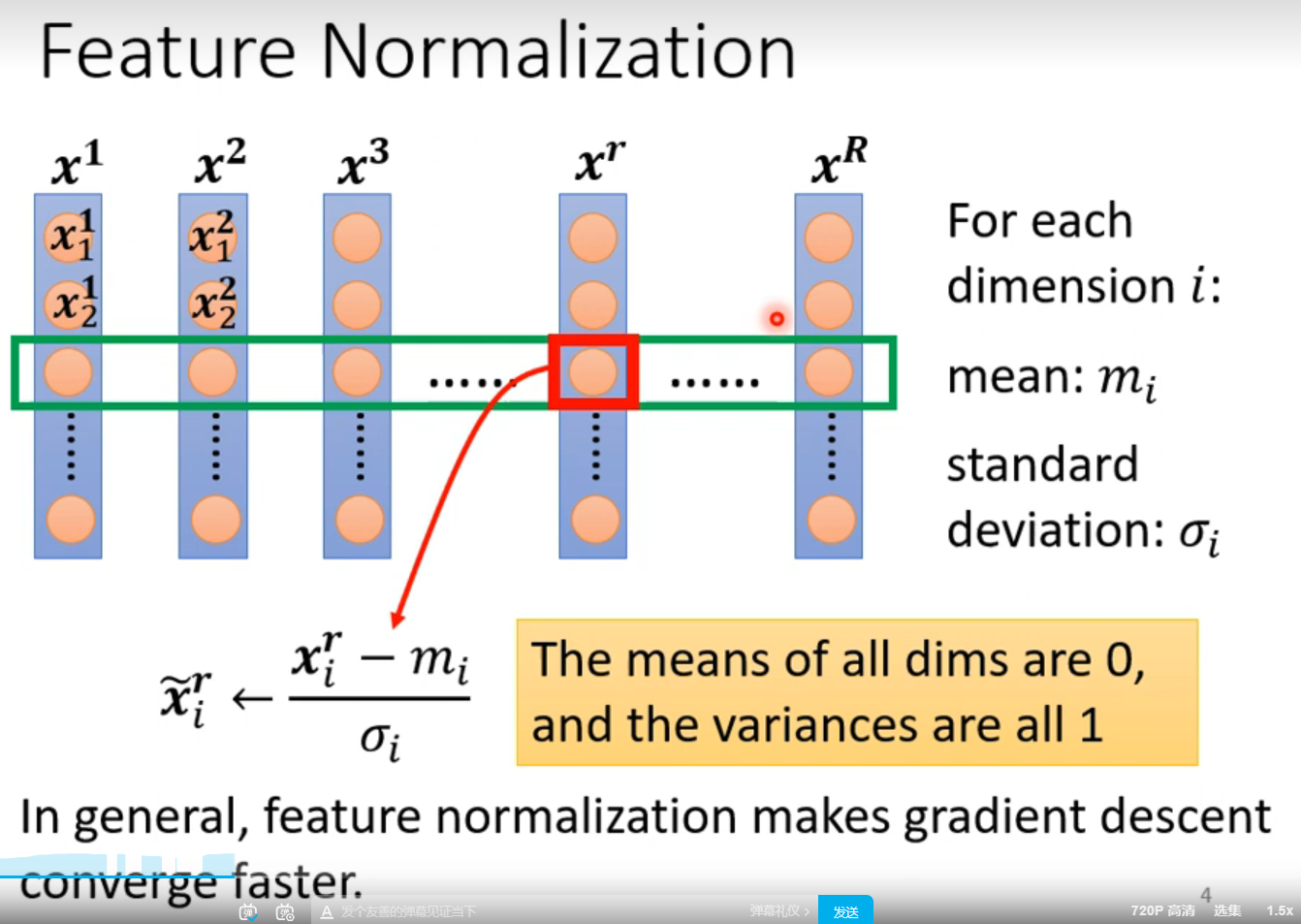

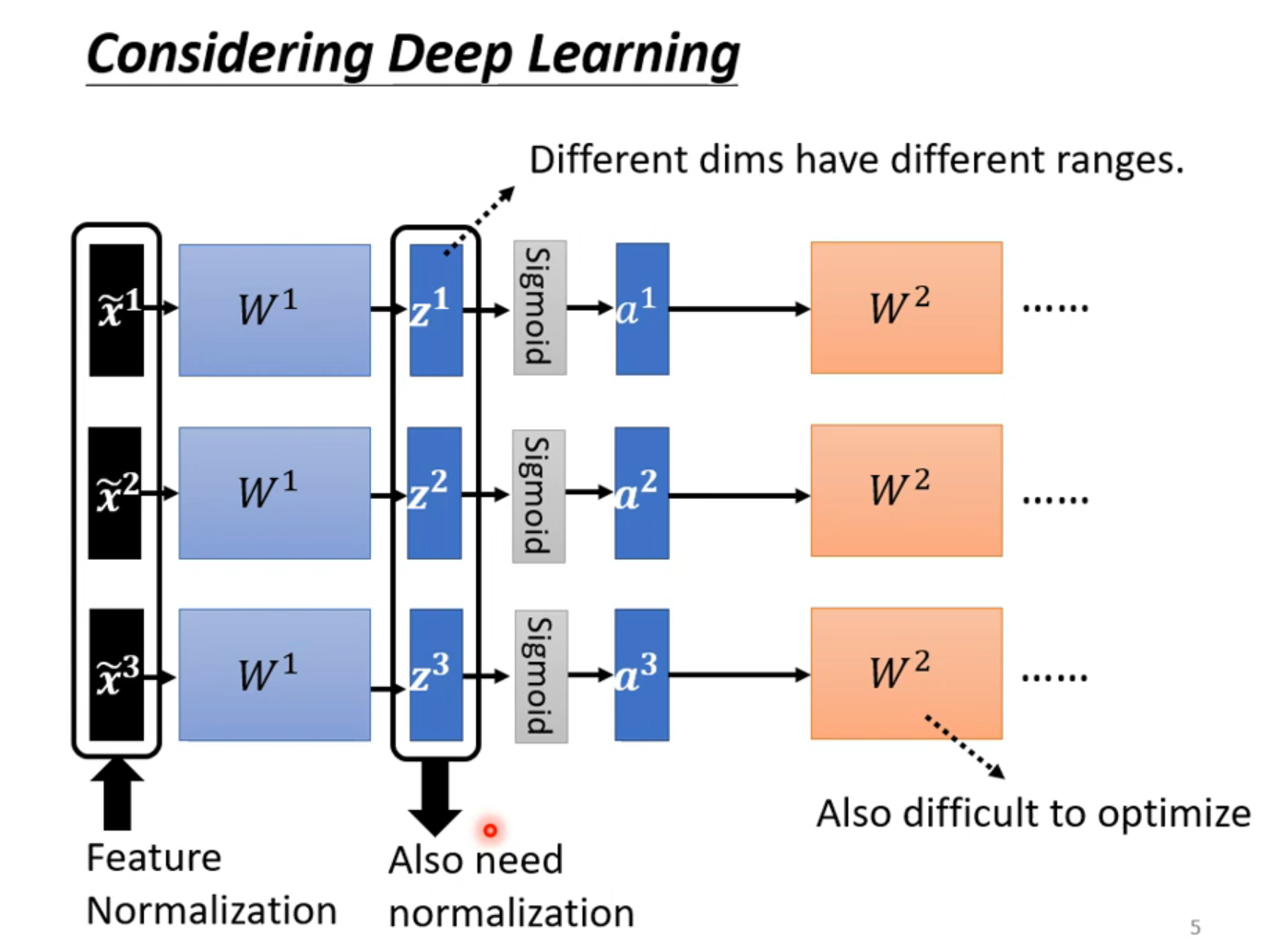

W2 很大,W2 的一点变化,能引起较大的梯度值,W1,很小,对梯度的影响比较小,两者的影响不平衡,为了保证影响力一样,将她们缩放到同样的范围

BN

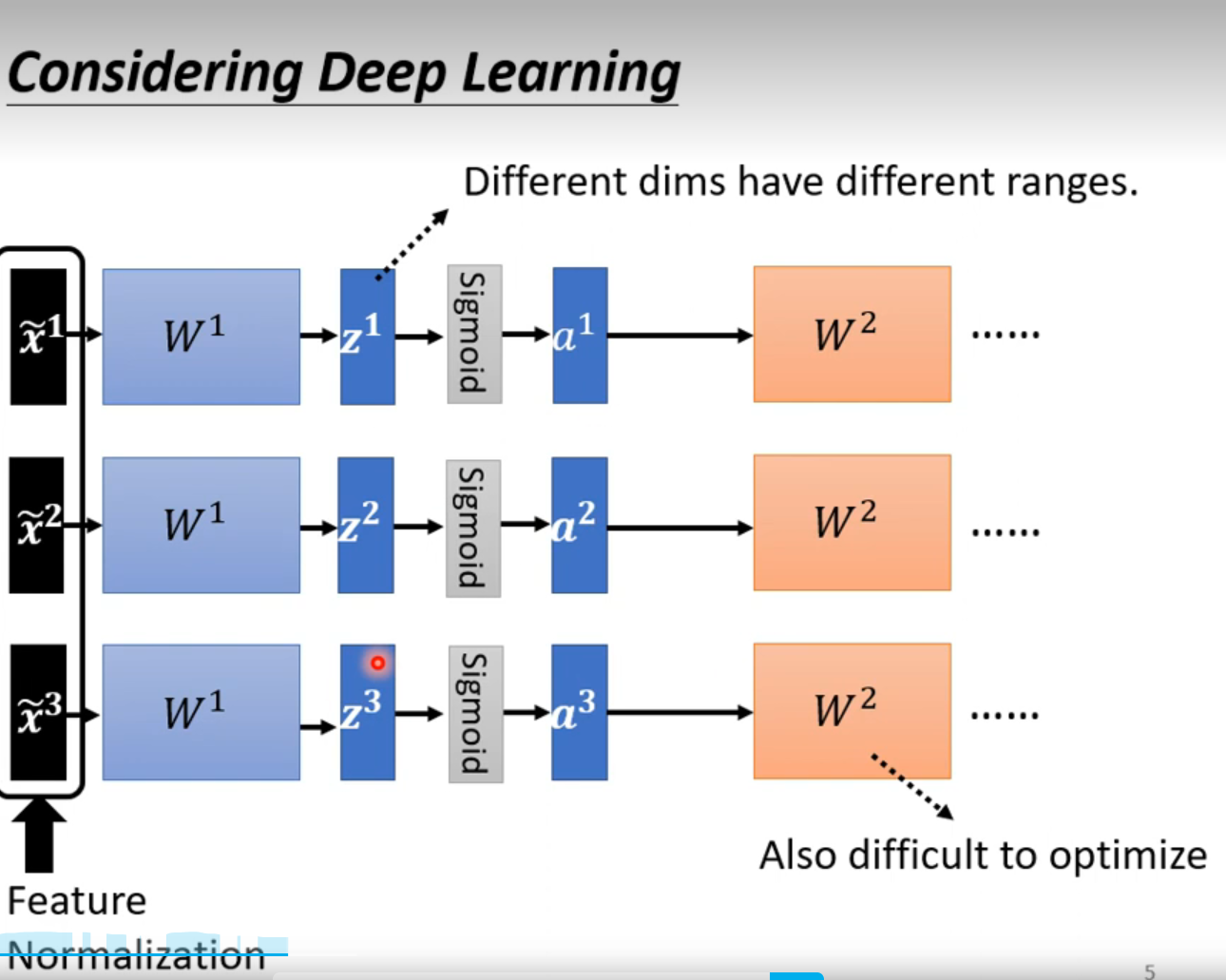

z的数值范围也不一样,也要进行归一化

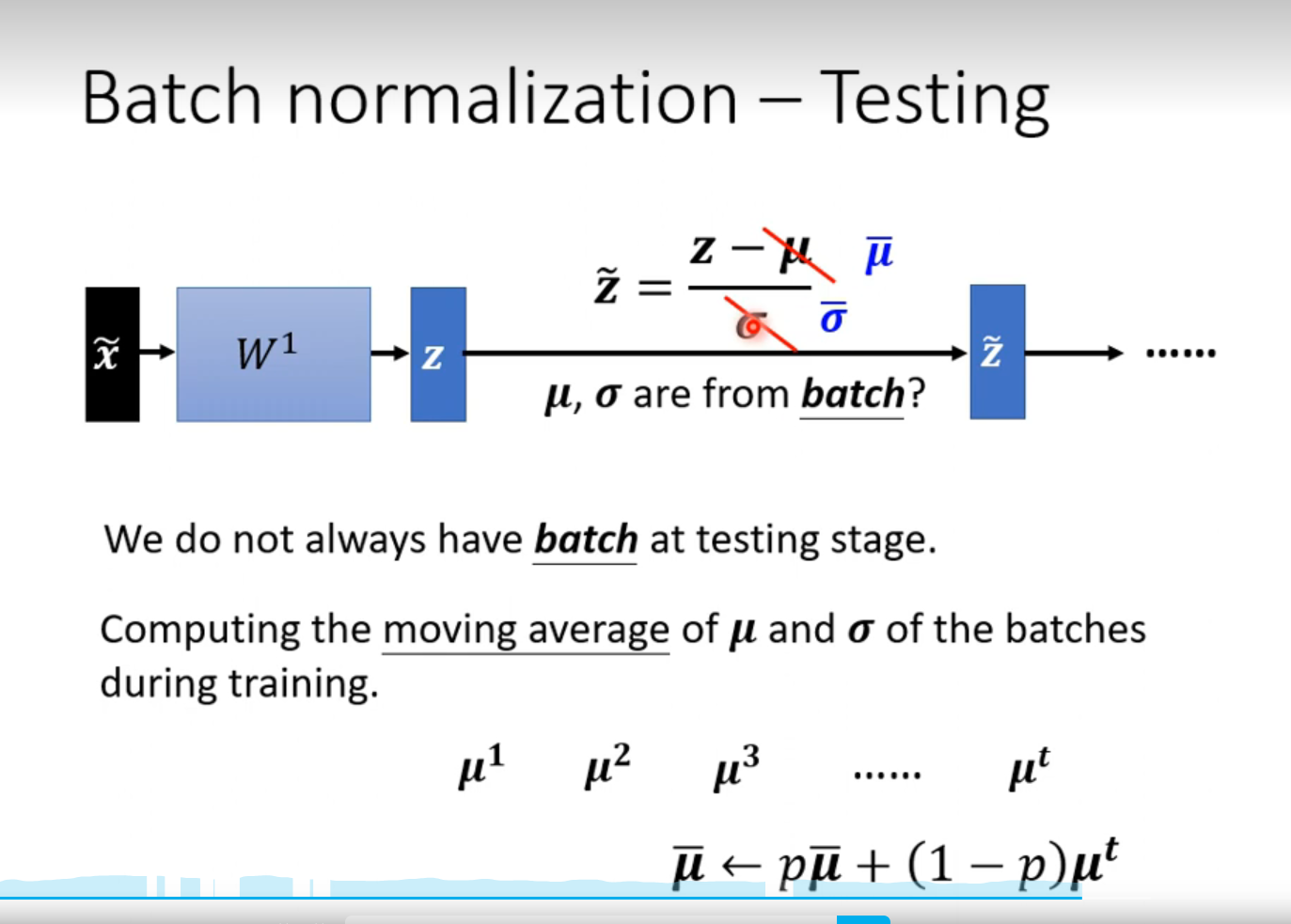

Testing

用训练时的 mu sigma

这篇关于P48类神经网络训练不起来怎么办- BatchNormalization的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!