本文主要是介绍Datawhale第十二期组队学习--Python爬虫编程实践 Task02:bs4、xpath和正则表达式re,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

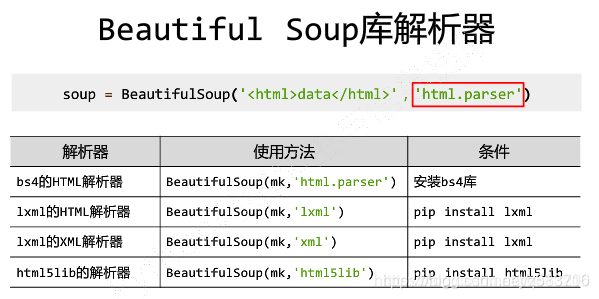

一. Beautiful Soup

缺点:

- 基于HTML DOM 的,会载入整个文档,解析整个DOM树,因此时间和内存开销都会大很多,所以性能要低于lxml。

- 匹配效率还是远远不如正则以及xpath的,一般不推荐使用,推荐正则的使用。

代码:

# 2.1.4 实战:中国大学排名定向爬取import requests

from bs4 import BeautifulSoup

import bs4url = 'http://www.zuihaodaxue.cn/zuihaodaxuepaiming2019.html'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/80.0.3987.163 Safari/537.36'}res = requests.get(url, headers=headers)

soup = BeautifulSoup(res.content.decode(), 'html.parser')

# print(soup.prettify())

tbody = soup('tbody')

# print(tbody)

# print(tbody[0].children)

# 学校排名信息

result = []

if tbody:for tr in tbody[0].children:# if tr != '\n' and type(tr) != "<class 'bs4.element.Comment'>":# print(type(tr))if tr != '\n' and not isinstance(tr, bs4.element.Comment):school_info = []# AttributeError: 'Comment' object has no attribute 'children'for index, td in enumerate(tr.contents[:4]):# print('td=', td)if index == 0:school_info.append(td.string)elif index == 1:school_info.append(td.string)elif index == 3:school_info.append(td.string)result.append(school_info)

# print(result)

# 格式不好看

# "{0:^4}\t{1:^6}\t{2:^10}"

print("%-10s %20s %s" % ('排名', '学校', '总分'))

for i in result:print("%-10s %20s %s" % (i[0], i[1], i[2]))二. XPath

在XPath中,有七种类型的节点:元素、属性、文本、命名空间、处理指令、注释以及文档(根)节点。

XML文档是被作为节点树来对待的。

下面列出了最常用的路径表达式:

- nodename 选取此节点的所有子节点。

- / 从根节点选取。

- // 从匹配选择的当前节点选择文档中的节点,而不考虑它们的位置。

- . 选取当前节点。

- … 选取当前节点的父节点。

- @ 选取属性。

- /text() 提取标签下面的文本内容

如:- /标签名 逐层提取

- /标签名 提取所有名为<>的标签

- //标签名[@属性=“属性值”] 提取包含属性为属性值的标签

- @属性名 代表取某个属性名的属性值

代码:

# coding:utf-8

#

import requests

from lxml import etreeurl = 'http://www.dxy.cn/bbs/thread/626626#626626'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/80.0.3987.163 Safari/537.36'}res = requests.get(url, headers=headers)

# print(res.text)

tree = etree.HTML(res.text)

# print(tree)

auth = tree.xpath('//div[@class="auth"]/a')

content = tree.xpath('//td[@class="postbody"]')

# print(len(auth))

# print(len(content))

for index, i in enumerate(content):print('author=', auth[index].xpath('text()')[0], i.xpath('string(.)').strip())print('*'*100)三. re

正则表达式语法由字符和操作符构成。

常用操作符

- . 表示任何单个字符

- [ ] 字符集,对单个字符给出取值范围 ,如[abc]表示a、b、c,[a‐z]表示a到z单个字符

- [^ ] 非字符集,对单个字符给出排除范围 ,如[^abc]表示非a或b或c的单个字符

- * 前一个字符0次或无限次扩展,如abc* 表示 ab、abc、abcc、abccc等

- + 前一个字符1次或无限次扩展 ,如abc+ 表示 abc、abcc、abccc等

- ? 前一个字符0次或1次扩展 ,如abc? 表示 ab、abc

- | 左右表达式任意一个 ,如abc|def 表示 abc、def

- {m} 扩展前一个字符m次 ,如ab{2}c表示abbc

- {m,n} 扩展前一个字符m至n次(含n) ,如ab{1,2}c表示abc、abbc

- ^ 匹配字符串开头 ,如^abc表示abc且在一个字符串的开头

- $ 匹配字符串结尾 ,如abc$表示abc且在一个字符串的结尾

- ( ) 分组标记,内部只能使用 | 操作符 ,如(abc)表示abc,(abc|def)表示abc、def

- \d 数字,等价于[0‐9]

- \w 单词字符,等价于[A‐Za‐z0‐9_]

re库的主要功能函数:

- re.search() 在一个字符串中搜索匹配正则表达式的第一个位置,返回match对象

- re.search(pattern,

string, flags=0) re.match() 从一个字符串的开始位置起匹配正则表达式,返回match对象 - re.match(pattern, string, flags=0) re.findall() 搜索字符串,以列表类型返回全部能匹配的子串

- re.findall(pattern, string, flags=0) re.split()

将一个字符串按照正则表达式匹配结果进行分割,返回列表类型 - re.split(pattern, string, maxsplit=0,

flags=0) - re.finditer() 搜索字符串,返回一个匹配结果的迭代类型,每个迭代元素是match对象

- re.finditer(pattern, string, flags=0) re.sub()

在一个字符串中替换所有匹配正则表达式的子串,返回替换后的字符 - re.sub(pattern, repl, string, count=0, flags=0)

flags : 正则表达式使用时的控制标记:

- re.I --> re.IGNORECASE : 忽略正则表达式的大小写,[A‐Z]能够匹配小写字符

- re.M --> re.MULTILINE : 正则表达式中的^操作符能够将给定字符串的每行当作匹配开始

- re.S --> re.DOTALL : 正则表达式中的.操作符能够匹配所有字符,默认匹配除换行外的所有字符

代码:

# coding:utf-8# 2.3.4 实战:淘宝商品比价定向爬虫

import re

import requests# 获取页面html

def get_html_text(url):headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/80.0.3987.163 Safari/537.36','cookie': 'miid=1535482570367186800; cookie2=6e87dd11b48dc75f227cf036d0f6bbe4; v=0; _tb_token_=f30be8ee41773; cna=uVskEQsl1BUCAat42oaQHKSA; tk_trace=oTRxOWSBNwn9dPyorMJE%2FoPdY8zZPEr%2FCrvCMS%2BG3sTRRWrQ%2BVVTl09ME1KrXdbYQyWDzjYhOx%2BUhHxroKQnemVLj0tU1xd75TGkzn3M%2BOx%2BRxMZtWd9pBWDUD8hgWXixe51H1qGhS3lPHKNV5oHwqAoM4jWOpy3fFSzsKRMIK7SLYeVxYSkdRYiH0LpoDWhDU399Yy5RCyBbezDJsMU%2BDy5JkyvlE58OeXQk2CHXicUxVDORUhrJsHE7AIWHzsDJty%2FWAT43VBG8dqxzgHmQZtX1CAck0aRxzrEBNwgMmcBBYK4HfOPALv2qkU%2BV%2FsHWuRS1JTvQXDbJonfcv4Q; hng=CN%7Czh-CN%7CCNY%7C156; thw=cn; t=7d095be8dae051b617612fc7f71d2f73; _samesite_flag_=true; dnk=%5Cu5F20719923505; tracknick=%5Cu5F20719923505; tg=0; sgcookie=EBXkkWPDmBc28Ae7TLO1q; uc3=lg2=VT5L2FSpMGV7TQ%3D%3D&id2=UoH5Z3NI%2FVRAOA%3D%3D&vt3=F8dBxdGMQvj9crMoa0s%3D&nk2=ttSzTPETU5LGukk%3D; csg=b64efe69; lgc=%5Cu5F20719923505; skt=5f1d40fba83c080d; existShop=MTU4NjQzODEzMg%3D%3D; uc4=nk4=0%40tAIH2w1hONUpvO6BX3cAYkdYxnENJQ%3D%3D&id4=0%40UOnmPLs9OcRO0eJtal2%2BZ2sfX2x9; _cc_=URm48syIZQ%3D%3D; tfstk=cfMCBA44RwbIxDb8C2taTpqF3We5ZzX_jO4ZAfdMKBUPymoCixW4lpnLAN6TMl1..; enc=9BidDucCCWfSGNd7u1LfxaL%2BbxWtMcDLAWI2KvRlpnlRlLuJwIm%2FYWgJUmGrRZXl7bgb85k9ZWyrPW%2BxhGtHng%3D%3D; mt=ci=-1_0; uc1=cookie16=URm48syIJ1yk0MX2J7mAAEhTuw%3D%3D&cookie21=VFC%2FuZ9aiKCaj7AzMHh1&cookie15=UIHiLt3xD8xYTw%3D%3D&existShop=false&pas=0&cookie14=UoTUPcqYgnhT0Q%3D%3D&tag=8&lng=zh_CN; l=eBjd8dAmq3WMRSGkBO5whurza77OrQdfh1PzaNbMiIHca1uR1iDNVNQccDRvRdtjgt5veFtykJ0GkRE9SyULRKgKqelyRs5mpi9wRe1..; isg=BD09zAcBP_1k85iHhgNU689STJk32nEs9qHNn_-BuRRlNltowymW_JHk4GpwsYnk; JSESSIONID=E554CC8A495277CB6B6EB9F72C62F530'}try:r = requests.get(url, headers=headers)# print(res.text)# pattern = '<script>(.*?)g_page_config = (.*?)</script>'# r = re.compile(pattern, re.S).findall(res.text)# print(type(res[0]))# print(res[0])r.raise_for_status()r.encoding = r.apparent_encodingreturn r.textexcept:return ''# 解析页面数据

def parse_html(glist, html):try:# 使用正则表达式提取信息# 商品价格# price_list = re.findall(r'<div class="price g_price g_price-highlight">(.*?)<span>¥</span>(.*?)<strong>(\d?)</strong></div>', html)# # 商品名称# name_list = re.findall(r'<div class="row row-2 title"><a>(.*?)</a></div>', html)price_list = re.findall(r'\"view_price\"\:\"[\d\.]*\"', html)name_list = re.findall(r'\"raw_title\"\:\".*?\"', html)print('name=', name_list)for i in range(len(price_list)):price = eval(price_list[i].split(":")[1]) # eval()在此可以去掉""name = eval(name_list[i].split(":")[1])glist.append([price, name])return glistexcept:print("解析失败")return []def print_goods_list(glist):tplt = "{0:^4}\t{1:^6}\t{2:^15}"print(tplt.format("序号", "商品价格", "商品名称"))count = 0for g in glist:count = count + 1print(tplt.format(count, g[0], g[1]))q = '书包'

start_url = "https://s.taobao.com/search?q=" + q

info_list = []

page = 3count = 0

for i in range(page):count += 1try:url = start_url + "&s=" + str(44 * i)html = get_html_text(url) # 爬取urlparse_html(info_list, html) # 解析HTML和爬取内容print("\r爬取页面当前进度: {:.2f}%".format(count * 100 / page), end="") # 显示进度条except:continue

print()

print_goods_list(info_list)这篇关于Datawhale第十二期组队学习--Python爬虫编程实践 Task02:bs4、xpath和正则表达式re的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!