本文主要是介绍室内低光语义分割框架 LISU: Low-light indoor scene understanding 论文阅读,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

论文标题:LISU: Low-light indoor scene understanding with joint learning of reflectance restoration

代码:GitHub - noahzn/LISU: Low-light Indoor Scene Understanding

期刊:ISPRS Journal of Photogrammetry and Remote Sensing, 2022

链接:https://www.researchgate.net/publication/356854492_LISU_Low-light_indoor_scene_understanding_with_joint_learning_of_reflectance_restoration

摘要:

使用CNN的语义分割已经取得了很不错的成绩,但是当训练数据较少时,网络无法在光照变化下取得令人满意的分割结果。在本论文,作者研究了在室内低光环境中的语义分割,并且提出了一个真实的和一个渲染的低光数据集用于评估结果。作者提出了一个用于低光分割的多任务网络 LISU,网络由两条分支组成,一条分支是语义分割分支,另一条分支是反射图修复分支。两条分支的深度特征级联起来以提升语义分割的结果。实验结果显示:语义信息可以帮助修复反射图,而修复的反射图更进一步帮助语义分割分支取得更好的效果。同时作者还尝试使用渲染数据进行模型预训练,并再次将最终的mIoU提升了7.2%。 本研究由欧盟INGENIOUS项目资助,作者代码和数据集已开源。

方法:

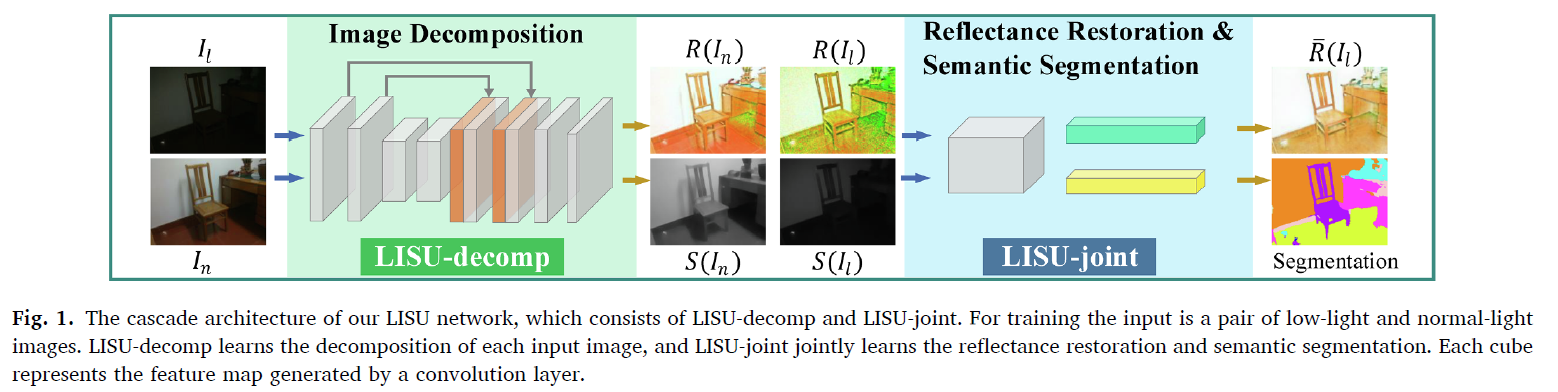

提出的LISU网络是一个级联网络,由LISU-decomp和LISU-joint组成。作者首先将一副图像通过LISU-decomp进行本征分解得到反射图和光照图。

I = R(I)⋅S(I).

直接在反射图上进行分割可以提升分割性能,因为反射图上没有光照的影响,像素颜色表达的是物体本身的颜色。根据Retinex理论,同一场景在不同光照下,反射图是不变的,只有光照图是不一样的,因此在理想情况下,一个物体在不同光照下的反射图上都是不变的,作者根据这一点决定在低光图像的反射图上进行语义分割。

作者首先利用自监督学习先训练了一个图像分解网络:输入一张图像,网络输出图像的反射图和光照图。随后将低光图像的光照图和低光图像的反射图一起输入进LISU-joint进行反射图修复和语义分割的联合学习。

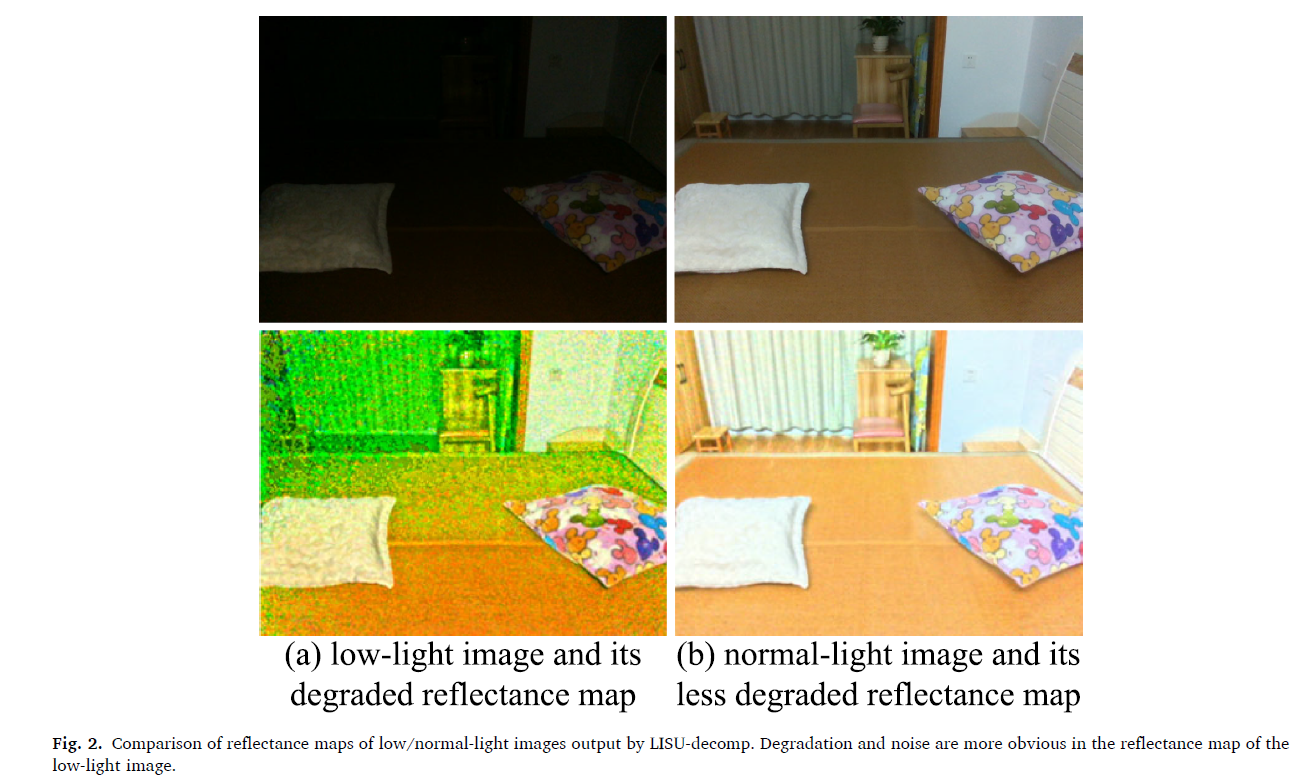

为什么要联合学习反射图修复呢?因为低光图像分解得到的反射图质量特别差 (degraded reflectance map),损失了很多信息,因此作者希望修复反射图来得到更好的反射图特征。

网络结构:

作者使用的网络是一个基于U-Net的多任务网络,网络共用一个encoder,但是两个不同的任务有两个不同的decoder学习。同时,两个解码器的特征被联结到一起进行特征的融合。

这个多任务网络的损失函数由反射图恢复损失以及交叉熵损失组成:

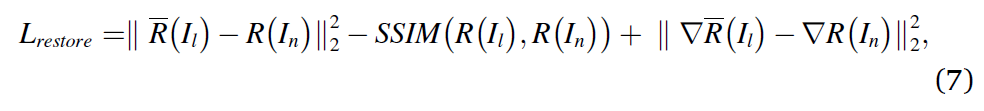

其中,反射图修复损失定义为:

数据集:

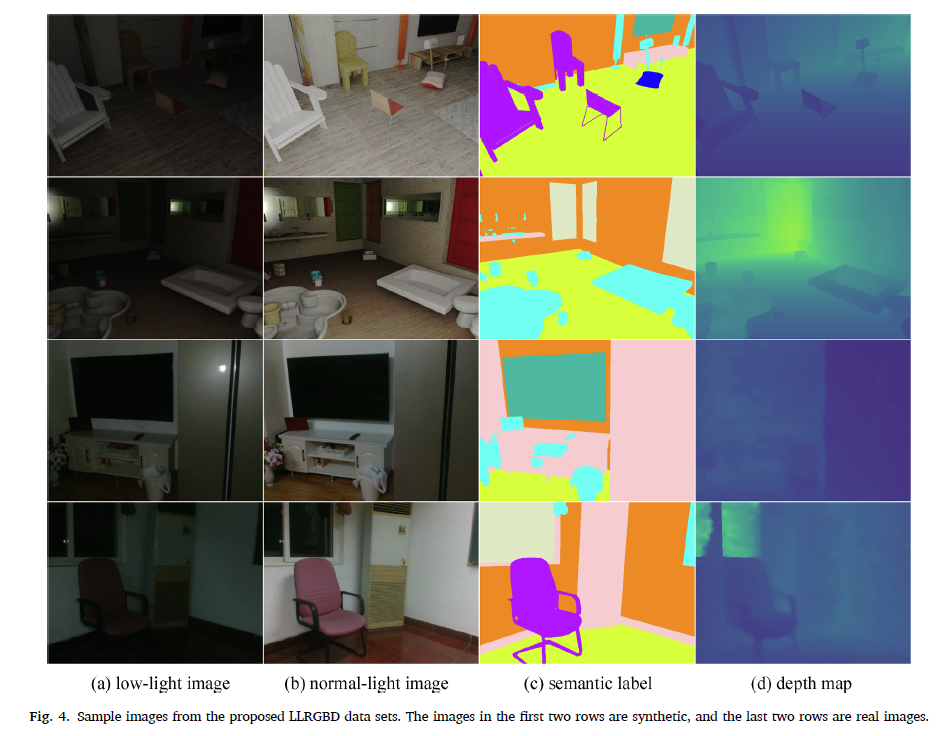

作者提出了一个新的数据集叫LLRGBD,包含LLRGBD-real:一个小型真实数据集,以及LLRGBD-synthetic,一个大型的渲染数据集。数据集中的每个场景都有低光和正常光照的成对图像。

实验:

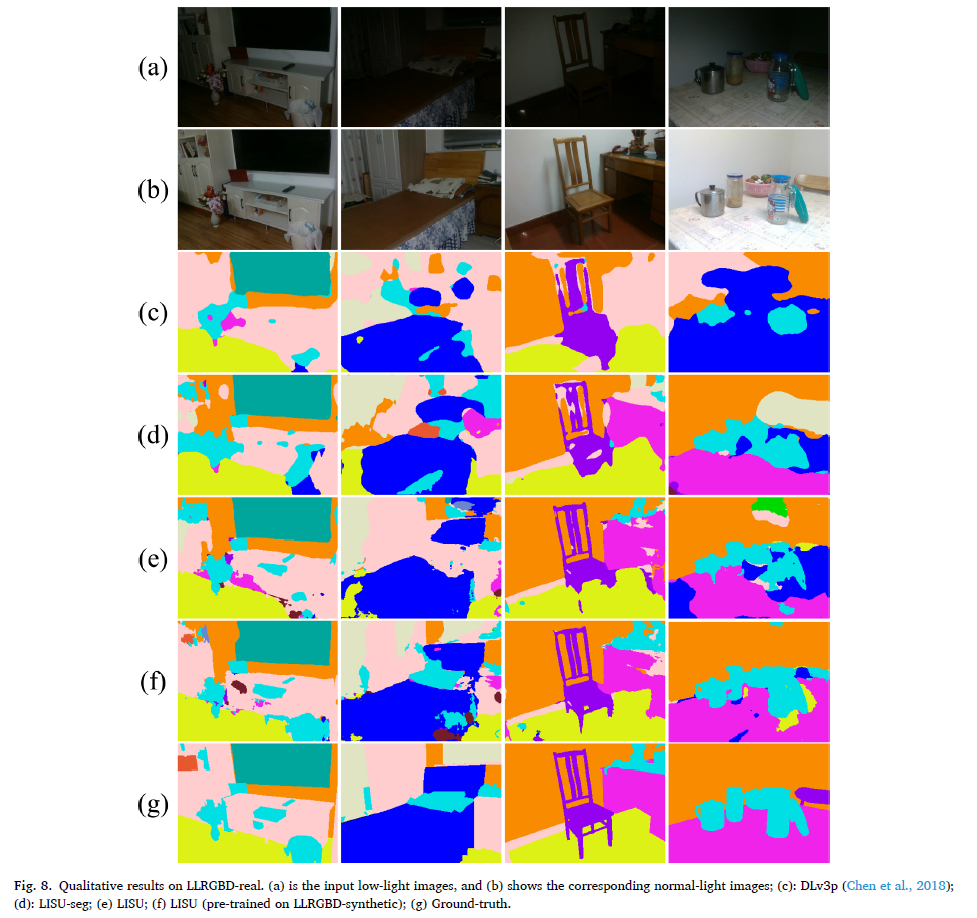

作者进行了多组实验,证明了提出方法在低光室内数据集上分割的有效性。

失败例子:

同时,作者提到了在低光情况下拍摄照片时,会有一些反光材质比如玻璃引起白色过曝斑点。这些斑点会影响分解网络生成正确的反射图从而影响最终分割结果。

总结:

这篇文章开创性地研究了低光室内语义分割的课题,这个课题好像还挺少有人研究的。但是也有一定的意义,比如低光的室内导航,不知道这个方法能不能迁移到夜晚室外路面的分割呢?

这篇关于室内低光语义分割框架 LISU: Low-light indoor scene understanding 论文阅读的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!