本文主要是介绍一文彻底搞懂CNN - 卷积和池化(Convolution And Pooling),希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

Convolutional Neural Network

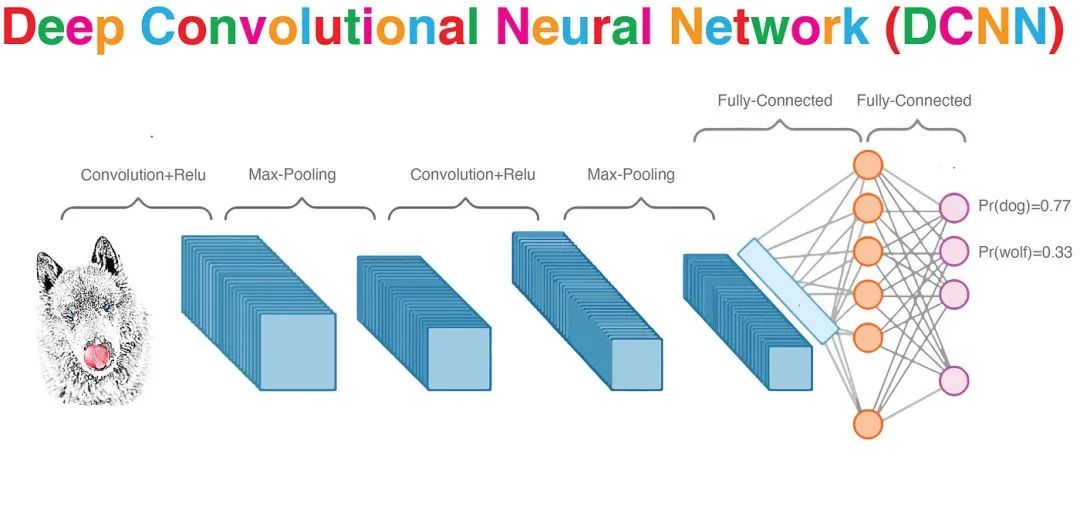

CNN(卷积神经网络)最核心的两大操作就是卷积(Convolution)和池化(Pooling)。卷积用于特征提取,通过卷积核在输入数据上滑动计算加权和;池化用于特征降维,通过聚合统计池化窗口内的元素来减少数据空间大小。

Convolution And Pooling

一、_卷积(Convolution)

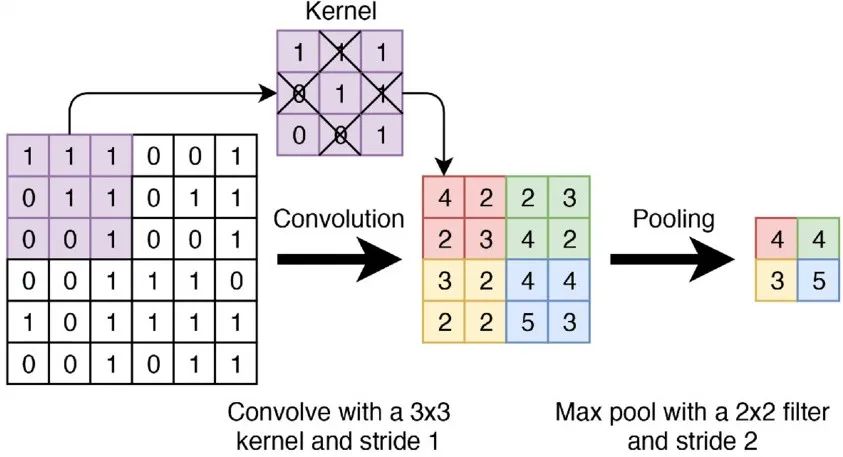

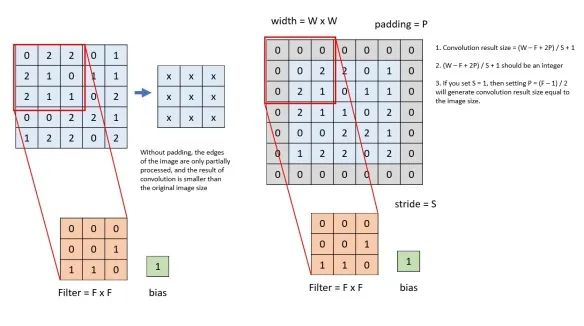

卷积(Convolution):卷积是一种数学运算,在CNN中,它通过滑动窗口(也称为卷积核或滤波器)在输入图像或特征图上滑动,并计算窗口内元素与对应卷积核元素的加权和(包括偏置项),从而生成输出特征图。

Convolution

卷积是一种特殊的线性运算,用于提取图像中的局部特征。CNN通过使用一个或多个卷积核(也称为滤波器或特征检测器)在输入数据(如图像)上进行滑动窗口操作来提取特征。

-

卷积核(Convolution Kernel): 一个可学习的权重矩阵,其大小通常远小于输入图像的大小,用于在输入图像上滑动并进行元素级的乘法累加操作。

-

特征图(Feature Map):卷积操作的结果,每个特征图都代表了输入图像在不同卷积核下的特征响应。

Convolution

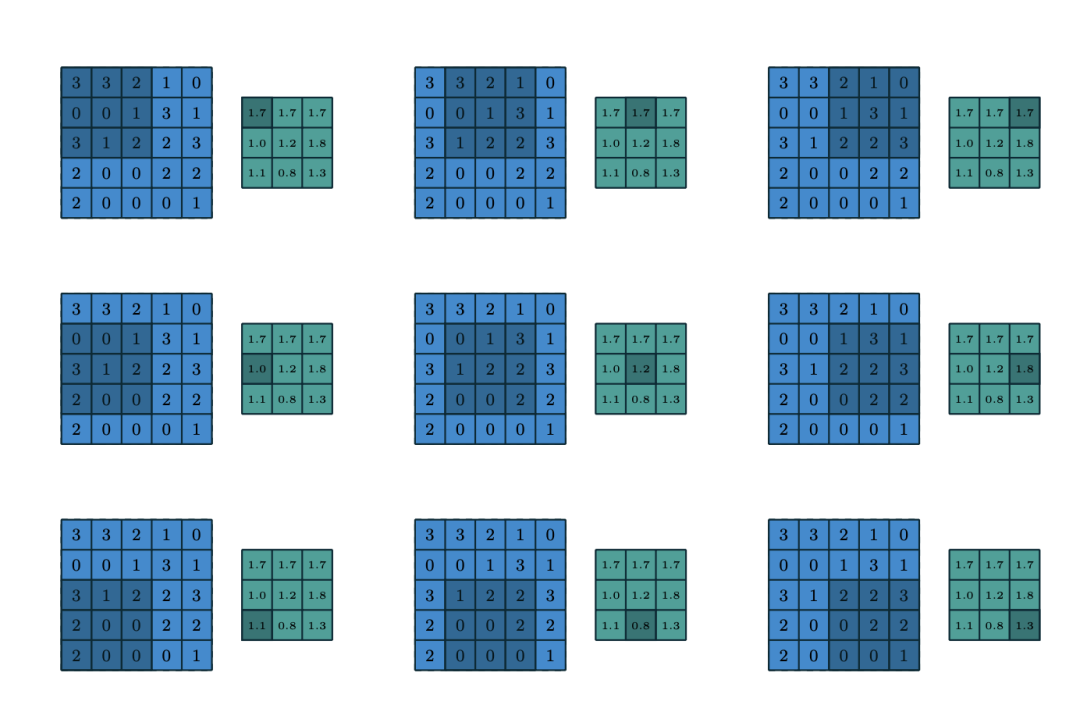

卷积的计算过程:通过卷积核在输入数据上滑动,计算每个位置上的加权和(包括偏置项),并可能应用激活函数,以生成输出特征图。

-

选择卷积核:卷积核是一个可学习的参数矩阵,其大小(如3x3、5x5等)和数量(即输出特征图的通道数)是超参数。

-

滑动窗口:将卷积核在输入图像或特征图上按指定步长(stride)滑动,每次滑动都计算窗口内元素与卷积核的加权和。

-

计算加权和:对于每个滑动位置,将窗口内元素与卷积核对应位置的元素相乘后求和,并加上偏置项(如果有的话),得到输出特征图上对应位置的元素值。

-

添加激活函数:通常,卷积操作后会接一个激活函数(如ReLU),以增加网络的非线性特性。

Convolution

卷积的重要参数:卷积的重要参数主要包括卷积核大小(Kernel Size)、步长(Stride)以及填充(Padding),它们共同决定了卷积层的输出特征图的尺寸和特性。

-

卷积核大小(Kernel Size):决定了感受野的大小,即每次卷积操作能够覆盖的输入区域大小。

-

步长(Stride):决定了卷积核在输入图像或特征图上滑动的距离。步长为1表示每次滑动一个像素,步长大于1则表示每次滑动多个像素。

-

填充(Padding):在输入图像或特征图的边缘添加额外的零值,以控制输出特征图的尺寸。常见的填充方式有“valid”(无填充)和“same”(填充后输出尺寸与输入相同)。

-

通道数(Channels):对于输入图像,通道数指的是颜色通道数(如RGB图像的通道数为3)。对于卷积层,输出特征图的通道数由卷积核的数量决定。

Convolution

_二、池化(Pooling)_

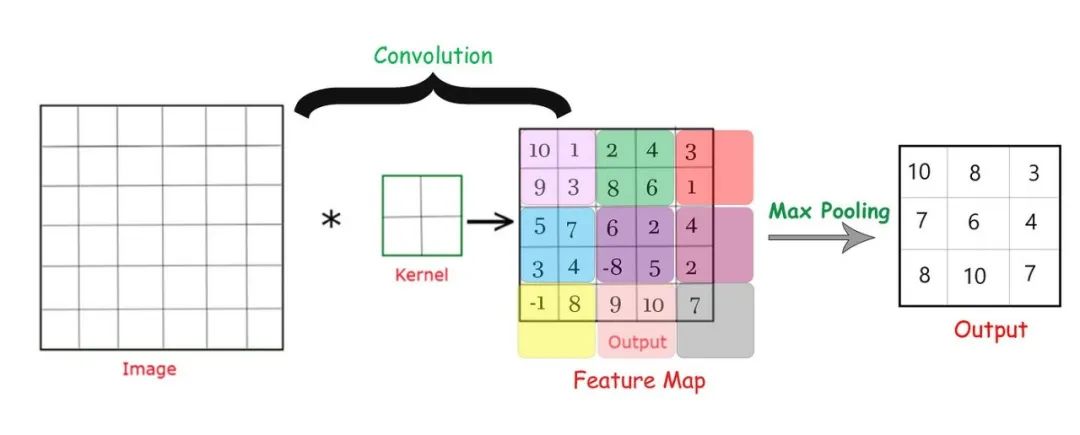

**池化(Pooling):**池化是卷积神经网络中的一种下采样操作。它通过定义一个空间邻域(通常为矩形区域),并对该邻域内的特征进行统计处理(如取最大值、平均值等),从而生成新的特征图。池化操作通常紧随卷积层之后。

-

特征降维:池化操作通过减少特征图的尺寸,降低了后续卷积层的计算量和参数数量,从而提高了计算效率。

-

特征提取:通过池化操作,CNN能够进一步提取输入数据的特征,使模型能够学习到更加抽象和高级的特征表示。

-

防止过拟合:池化操作通过减少特征图的维度和参数数量,降低了模型的复杂度,从而在一定程度上防止了过拟合现象的发生。

Pooling

池化操作在降低特征图空间大小的同时,保持了特征的空间层次结构,有助于减少计算量并提高模型的泛化能力。

Pooling

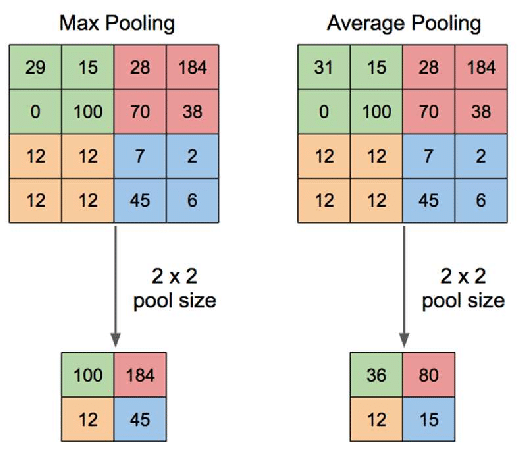

**池化的常见类型:****池化操作有多种方式,其中最常见的是最大值池化(Max Pooling)和 平均池化(Average Pooling)。**它们分别通过选取局部区域内的最大值和平均值来减少特征图的尺寸。

-

最大值池化(Max Pooling):

-

原理: 在定义的池化窗口内,选取所有元素中的最大值,并将该最大值作为池化结果输出到下一层特征图的对应位置。

-

特点: 能够保留更多的纹理信息,减少因卷积层参数误差造成的估计均值偏移,使模型对特征的具体位置变化更加鲁棒。

-

平均池化(Average Pooling):

-

原理: 在定义的池化窗口(如2x2、3x3等)内,计算所有元素的平均值,并将该平均值作为池化结果输出到下一层特征图的对应位置。

-

特点: 能够保留更多的背景信息,减少因邻域大小受限造成的估计值方差增大,使提取的特征更加平滑。

Pooling

池化的重要参数:池化窗口大小和步长是决定池化层输出尺寸的关键参数,窗口大小定义了覆盖区域,步长决定了滑动距离。

-

池化窗口大小(Kernel Size):定义了池化操作的窗口大小,通常是一个正方形(如2x2、3x3等)。窗口大小决定了池化操作在输入数据上滑动时覆盖的区域大小。

-

步长(Stride):步长定义了池化窗口在输入数据上滑动的距离。如果步长与窗口大小相同,则池化操作不会重叠。如果步长小于窗口大小,则池化操作会重叠。

Pooling

如何学习AI大模型?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高

针对所有自学遇到困难的同学们,我帮大家系统梳理大模型学习脉络,将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

👉[CSDN大礼包🎁:全网最全《LLM大模型入门+进阶学习资源包》免费分享(安全链接,放心点击)]()👈

学习路线

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

这篇关于一文彻底搞懂CNN - 卷积和池化(Convolution And Pooling)的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!