vectors专题

Educational Codeforces Round 1C. Nearest vectors(极角排序+long double 精度)

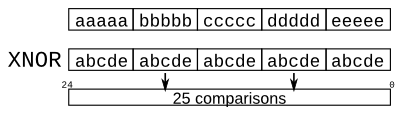

题目链接 题意:给你一堆的向量,问你向量之间的夹角最小的是那一对。 解法:极角排序,然后枚举相邻的一对就可以啦,但是坑爹的是double精度不够,使用long double 读入使用cin。。。 #include<bits/stdc++.h>using namespace std;#define LL long long#define pb push_back#define X f

加载org.Hs.eg.db为什么出现error: $ operator is invalid for atomic vectors报错和解决方法

在Bioconductor上已经有人提了问题,并且有了回答(地址:https://support.bioconductor.org/p/9136329/) 简单的说,就是Rstduio出来背锅,最新的RSQLite(v2.2.6)和Rstudio存在冲突,以后要么是RSQLite迁就RStduio,要么就是Rstudio迁就RQLite。 不过目前也不是不能用,以下是解决方法 方法1 手动设

OK6410A 开发板 (三) 13 u-boot-2021.01 boot 解析 U-boot 镜像运行部分 boot 详细解析2 relocate_vectors

从链接角度分析 u-boot.bin 的构成从运行的角度分析 u-boot.bin 前 64byte 的 relocate relocate_vectors 的实现 #ifdef CONFIG_HAS_VBAR// 虽然走的是这一套,但是找到的协处理器cp15的C12的实现(DDI0301H_arm1176jzfs_r0p7_trm.pdf)和下面的内容对不上// 那就分析 #else

HDLBits——Vectors

HDLBits —— Vectors Vectors(向量;总线) 要求: 构造一个电路,拥有 1 个 3 bit 位宽的输入端口,4 个输出端口。其中一个输出端口直接输出输入的向量,剩下 3 个输出端口分别各自输出 3 bit 中的 1 bit。上图中,箭头上的小斜杠旁边的数字代表该向量(总线)的位宽,用于将向量同 wire 信号区别开来。 Solution: module top

ARM64 Exception vectors

ARM64 异常向量即 Exception vectors 参见源D1.10.2描述。 When the PE takes an exception to an Exception level that is using AArch64, execution is forced to an address thatis the exception vector for the excepti

是否有可能从python中的句子语料库重新训练word2vec模型(例如GoogleNews-vectors-negative300.bin)?

是否有可能从python中的句子语料库重新训练word2vec模型(例如GoogleNews-vectors-negative300.bin)? http://www.voidcn.com/article/p-dsovbvsv-bun.html NLP 利器 Gensim 库的使用之 Word2Vec 模型案例演示(基于 word2vec-google-news-300 预训练模型,附下

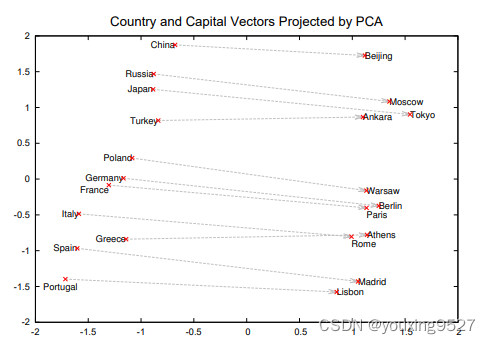

CS224n | (2) Word Vectors and Word Senses

原文地址 cs224n系列博客笔记主要基于cs224n-2019,后续也会新增 CS224n-2020 里的更新部分:CS224n-2020 并未更新 Note 部分,但课程的部分课件进行了教学顺序上的调整与修改(Suggested Readings 也相应变动),需要注意的是三个 Guest Lecture 都是全新的。 本文为 Lecture 02 Word Vectors and Wor

斯坦福CS224n课程笔记1-introduction and Word vectors 2019

Human language and word meaning 语言是一个低带宽的信息传输方式,相比于5G,这决定了语言的熵会很高。 How do we have usable meaning in a computer? one-hot的字词表示: 词语维度是很高的,而且有很多衍生的词语,接近于无限的维度。词语之间没有相似度,即one-hot向量是正交的,相似词语和不相似词语之间都是正交

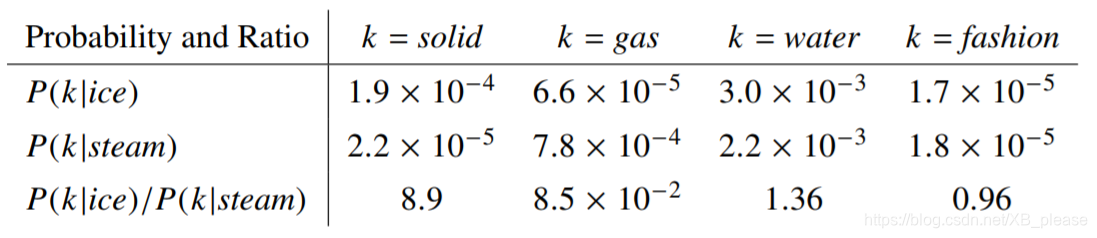

论文GloVe: Global Vectors for Word Representation(学习笔记)

来源:EMNLP 一:解决了什么问题? 1. 直接获取全局语料库统计信息的词向量模型,GloVe并非基于语料库中整个的稀疏矩阵或局部上下文窗口进行训练,而是通过训练词-词共现矩阵中的非零元素,从而有效利用统计信息。 二:怎么解决的问题?

extern far void vectors();中far是什么意思

在16位编译器(Turbo C)中常见,这跟内存寻址有关。 PC机的内存地址是由段地址和偏移地址组成(汇编中常见的词),每个段不能超过64K地址。因此在段内寻址,只要用到偏移地址就够了,因段地址寄存器所存的段地址是不变的,用指针时,只16位够了(仅表示偏移地址)这类地址称为近指针(near型);当要跨段时,即要指明所要存取的段地地和偏移地址时,这时段寄存器中所存段地址要改变,因

已解决 NU1102 找不到版本为 (= 4.5.0) 的包 System.Numerics.Vectors

这两天被这个问题搞得真的是头疼,百度也找不到答案,去官网也得到这个答案很是摸不着头脑 我重装了4次 Visual Studio 2019 重装了3次Visual Studio 2017 不管是社区版还是企业版还是专业版都不行 让我一度以为这是不是个bug。。。 解决办法: 打开"vs2019" >找到"工具" > “NuGet包管理器” > “程序包管理器设置” > 选择"程序包源" >点击

GloVe学习:Global Vectors for Word Representation

GloVe: Global Vectors for Word Representation 什么是GloVe? 正如GloVe: Global Vectors for Word Representation论文而言,GloVe的全称叫Global Vectors for Word Representation,它是一个基于全局词频统计(count-based & overall statist

Coursera 机器学习 -- Matrices and Vectors 笔记(线性代数复习课)【第一周】

Matrices and Vectors Matrices(矩阵) 矩阵:是由数字组成的,并且在[]中的。它是由行和列组成。 例如下图中,左侧就是一个4×2的矩阵,而右侧是一个2×3的矩阵,而通常表示一个矩阵是几行几列的写法便是R^4×2,代表着它是4×2的矩阵。 再看下图,通过A来标识具体矩阵的某个元素,例如A11=1402,代表的就是A这个矩阵的第一行,第一列的元素是1402,A4

手搓GPT系列之:单词向量(Word Vectors)的基本原理

前面一篇文章介绍了通过gensim操作单词向量的demo,有兴趣的同学可以移步这里。这一篇将给大家介绍该算法背后的原理。说起原理,我们实际上很难真正理解和解释那些词义(word meaning/semantics)、词形(morphology)、词性(part of speech)等信息是如何被编码到这些高维实数向量中的。但是我们实际上已然做到这一点。这种“我们不理解,但是却做到了”的情况,在现

高维概率论:各向同性 isotropic random vectors

Isotropic是高维随机向量中非常重要且基础的一个性质,中文翻译叫各向同性,嗯......单从名字上理解它的涵义感觉确实有些困难......(不过比鲁棒性的翻译要好太多了) Isotropic在概率论中的实质含义就是“unit variance”,而当我们去研究一个均值是0方差是1的随机变量是非常容易的。对于高维随机向量来说,对variance的限定就变成了对covariance的限定。is

GloVe: Global Vectors for Word Representation阅读总结

论文:GloVe: Global Vectors for Word Representation cs224视频:https://www.bilibili.com/video/BV1pt411h7aT?t=4017&p=3 目录 一、背景介绍 二、实验方法 三、模型理解 1、和其他模型的关系 2、模型复杂度 四、实验结果 0、实验设置 1、单词类比任务(word analogy

5.Vectors Transformation Rules

在上节,有个问题:向量分量的转换方式 与 新旧基底的转换方式相反 用例子来感受一下, 空间中一向量V,即该空间的一个基底:e1、e2 v = e1 + e2 现把基底 e1 、 e2 放大两倍。变成 基向量放大了两倍, 但对于向量v ,其向量组件缩小了两倍。 它们两个 做了相反的事, 基向量放大, 某向量的向量组件缩小。 但V是不变的。 当使用新的基向量测量V时,V