smo专题

机器学习算法实践-SVM中的SMO算法

前言 前两篇关于SVM的文章分别总结了SVM基本原理和核函数以及软间隔原理,本文我们就针对前面推导出的SVM对偶问题的一种高效的优化方法-序列最小优化算法(Sequential Minimal Optimization, SMO)的原理进行总结并进行相应的Python实现。 坐标上升算法(Coordinate Ascent) 在SMO算法之前,还是需要总结下坐标上升算法,因为SMO算法的

SVM(三) SMO优化算法求解

SMO优化算法(Sequential minimal optimization) SMO算法由Microsoft Research的John C. Platt在1998年提出,并成为最快的二次规划优化算法,特别针对线性SVM和数据稀疏时性能更优。关于SMO最好的资料就是他本人写的《Sequential Minimal Optimization A Fast Algorithm for

Python3:《机器学习实战》之支持向量机(2)简化版SMO

Python3:《机器学习实战》之支持向量机(2)简化版SMO 转载请注明作者和出处:http://blog.csdn.net/u011475210代码地址:https://github.com/WordZzzz/ML/tree/master/Ch06操作系统:WINDOWS 10软件版本:python-3.6.2-amd64编 者:WordZzzz Python3机器学习实

SVM-SMO算法C++实现

SMO程序 #include <iostream>#include <stdlib.h>#include <string>#include <math.h>#include "matrix.h"#include <fstream>#include <sstream>#include <stack>using namespace std;#define MAX_SIZE_OF_T

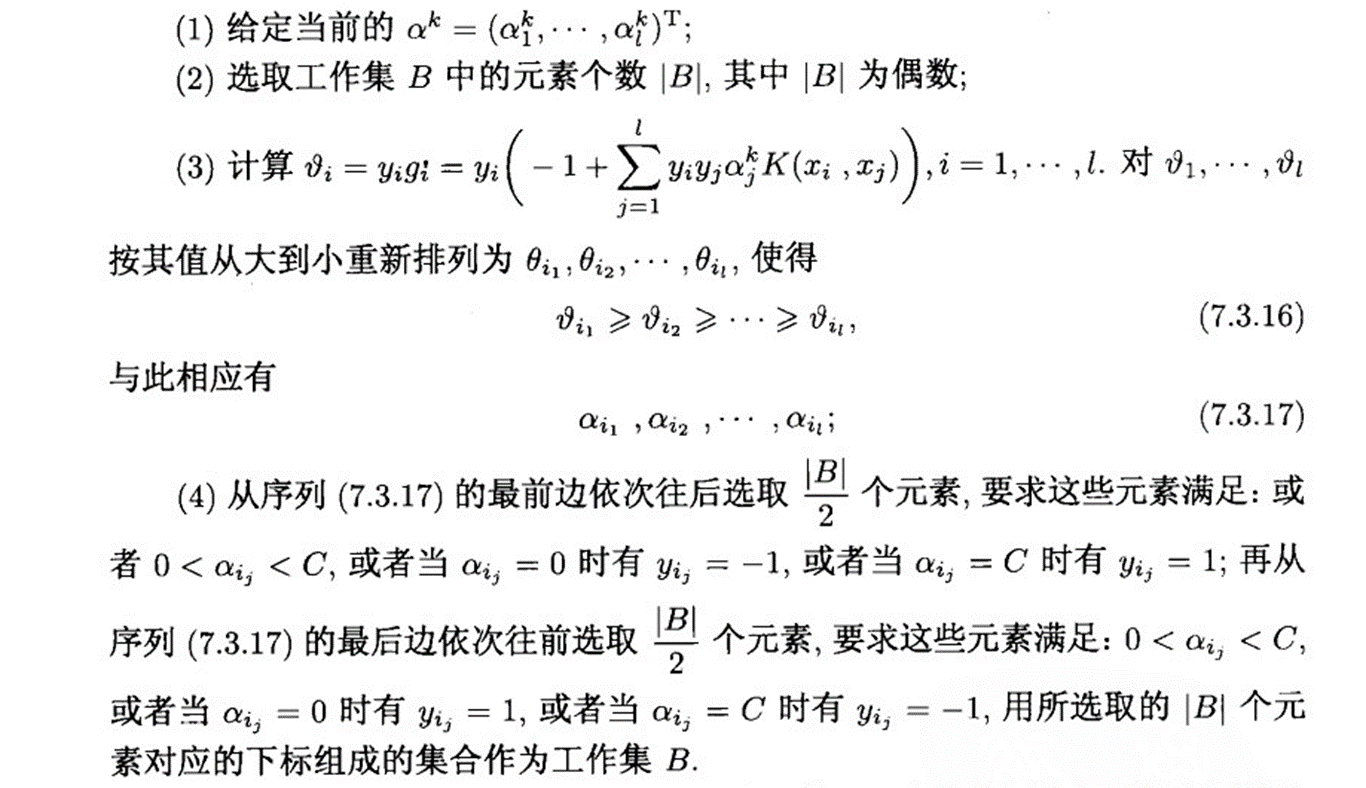

复现SMO算法:序列最小优化的启发式方法【三、算法原理揭秘-2】

接下来的内容将转向SMO算法的第二个核心组成部分——选择要优化的乘数的启发式方法。在这篇博客中,我们将探讨算法如何通过启发式选择策略高效地识别和更新拉格朗日乘数。通过对比直接优化的分析方法和启发式方法的策略选择,我们能够更全面地理解SMO算法在解决支持向量机(SVM)优化问题中的独特优势。 启发式方法 二、选择要优化的乘数的启发式方法1.外层循环 - 选择 α 1 \alpha_1 α1

复现SMO算法:深入探索序列最小优化的分析方法【三、算法原理揭秘-1】

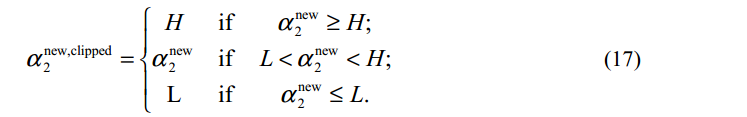

在这篇深入探讨序列最小优化(SMO)算法的第一部分中,我们专注于算法核心的第一个组成部分——求解两个拉格朗日乘数的分析方法。我们将逐步展开详细的数学推导,明确如何从约束的确定到乘数的优化更新,直至找到最优解。在介绍这一复杂的过程时,我们将特别注意保持逻辑的清晰性和步骤的精确性,确保即使是初学者也能跟随每一个推导步骤。 一、求解两个拉格朗日乘数的分析方法 SMO算法的一个关键创新是将大型二次规划

支持向量机(三)序列最小最优化算法(SMO)

在支持向量机(一)和支持向量机(二)两篇文章中,我们分别介绍了线性可分的支持向量机和线性向量机,从中可知,我们最终的目的是要计算得出支持向量对应的拉格朗日乘子α,但是我们并没有说怎么算。这篇文章主要介绍了序列化最小优化算法,用来计算α。在介绍之前我们先简单介绍一下其中用到的核函数。 核函数 首先我们看下面的两个图:

SVM——(七)SMO(序列最小最优算法)

在说SMO (Sequential minimal optimization)之前,先介绍一种与之类似的算法,坐标上升(下降)算法. 1.Coordinate ascent 所谓坐标上升(下降)指的是同一个算法,只是若实际问题是求极大值则是上升,反之为下降。我们知道梯度下降算法在每次迭代过程中都是沿着梯度的(反)方向进行的;而坐标下降算法则是在每次迭代中分步沿着你n个(n为特征维度)方向进行的

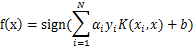

SMO Algorithm流程

SMO Algorithm流程 SMO Algorithm Input: T T T = (x1,y1),(x2,y2),...,(xN,yN)(x1,y1),(x2,y2),...,(xN,yN){(x_{1},y_{1}),(x_{2},y_{2}),...,(x_{N},y_{N})} ,精度 ϵ ϵ \epsilon Output:近似解 y^ y ^ \hat{y

SEO与 SMO 的区别

SEO和SMO都是为网站带来流量的方法,但二者截然不同。搜索引擎优化(SEO)是一种在搜索引擎结果页面上提高网站流量的技术,而社交媒体优化(SMO)则是一种让更多用户看到社交媒体内容的技术。 阅读本文,进一步了解 SEO 和 SMO 以及它们之间的区别。 什么是SEO? SEO是一种提高网站在搜索引擎结果页面上排名的技术。SEO基本上是一种通过搜索引擎增加网站流量的方法。SEO最根本的基础

Matlab Simulink 基于SMO的电流传感器容错切换控制研究

Matlab Simulink 基于SMO的电流传感器容错切换控制研究 在矢量控制框架下研究滑模观测器与电流传感器的切换 可设置传感器卡死,漂移等故障 ID:59100687947198163

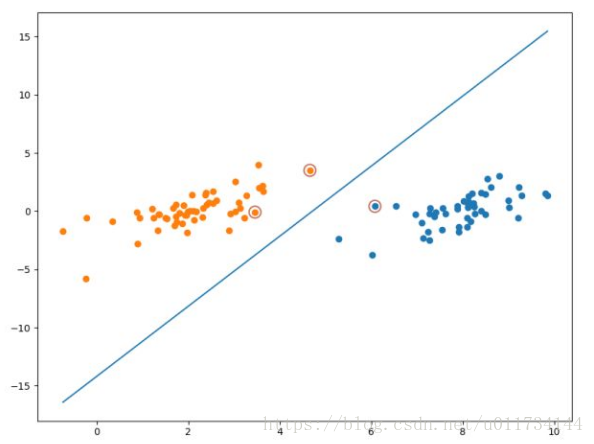

支持向量机(SVM) | 核技巧于SMO算法的实现

01 核技巧 关于支持向量机,我们有这样的共识: 支持向量机是一种分类器,之所以叫“机”是因为它会产生一个二值决策结果,是一种决策机;支持向量机的泛化误差较低,即,有良好的学习能力,且学到的模型具有很好的推广性,因此被认为是监督学习中最好的定式算法;支持向量机通过求解一个二次优化问题来最大化分类间隔,在过去,训练SVM常采用非常复杂且低效的二次规划求解方法;1998年,Platt提出SMO

支持向量机(SVM) | SMO算法实现

01 起 在统计学习方法|SVM这篇文章中,我们学习了支持向量机的原理和理论上的算法实现,我们一起回忆一下,支持向量机可以处理三种类型的数据: 线性可分支持向量机——求解策略,硬间隔最大化线性支持向量机——求解策略,软间隔最大化非线性支持向量机——求解策略,核技巧+软间隔最大化 我们提出一个问题 当数据量很大时,以上提出的算法求解复杂度呈指数上升,算法会变得十分低效,该怎么办呢?

Python3:《机器学习实战》之支持向量机(3)完整版SMO

Python3:《机器学习实战》之支持向量机(3)完整版SMO 转载请注明作者和出处:http://blog.csdn.net/u011475210 代码地址:https://github.com/WordZzzz/ML/tree/master/Ch06 操作系统:WINDOWS 10 软件版本:python-3.6.2-amd64 编 者:WordZzzz Python3机器学习实战之支持向

SVM实现之SMO算法

转自http://blog.csdn.net/zouxy09/article/details/17292011 终于到SVM的实现部分了。那么神奇和有效的东西还得回归到实现才可以展示其强大的功力。SVM有效而且存在很高效的训练算法,这也是工业界非常青睐SVM的原因。 前面讲到,SVM的学习问题可以转化为下面的对偶问题: 需要满足的KKT条件:

[G+smo] gsMultiPatch 类

1. gsMultiPatch类 gsMultiPatch类的继承关系 重要函数 得到几何信息: /// Dimension of the parameter domain (must match for all patches). int parDim() const /// Dimension of the geometry (mu

[G+smo]边界和角点

1. 确定多片模型中各个片的顺序 借助Paraview.打开Pipeline brower下方的information选项卡,可以看到Data Hierarchy中的multi-block dataset. 选定其中一个block, 可以查看其几何区域和边界的范围。由这个信息可以确定片的顺序。 打开gsview.pvd -> Properties Apply -> filters Alphab

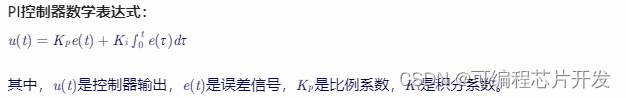

基于双闭环PI的SMO无速度控制系统simulink建模与仿真

目录 1.课题概述 2.系统仿真结果 3.核心程序与模型 4.系统原理简介 5.完整工程文件 1.课题概述 基于双闭环PI的SMO无速度控制系统simulink建模与仿真,基于双闭环PI的SMO无速度控制系统主要由两个闭环组成:一个是电流环,另一个是速度环。电流环作为内环,主要负责电流的快速跟踪控制;速度环作为外环,负责速度的精确控制。这种双闭环结构可以有效提

薛峰:从SEO到SMO

2019独角兽企业重金招聘Python工程师标准>>> 剥开一颗巧克力,这是很容易被人们忽略的瞬间。然而,如果在那片薄薄的包装锡纸上,读到一句打动内心的句子,这个瞬间就会立即变得不同。的确,享受巧克力的丝滑口感与隽永语句的扣人心弦共同交融的瞬间,也许可以算得上是村上春树所说的一种“小确幸”吧——确实而简单的小幸福,正是“小清新”们推崇的生活理念。 而你自己想说的话也可能会出现在那片薄薄

支持向量机smo算法C语言,SVM支持向量机(四)R语言实现、SMO算法

一、求解支持向量机。 上篇笔记讲到,如何求解拉格朗日乘子向量。基本的想法就是,每次选出两个乘子,对其他的乘子赋值,此时,只剩两个乘子。问题变成了一个两元一次方程和求二元函数最小值的问题。如果乘子可以更新(既违反了KKT条件),则把其中一个乘子用令一个乘子代替,带入到二元函数中,再求函数取最小值时(通过公式可以看出这是一个开口向上的抛物线),未知数的值。重复上面的过程直到所有的乘子都稳定下来,不再

机器学习---SVM目标函数求解,SMO算法

1. 线性可分支持向量机 1.1 定义输入数据 假设给定⼀个特征空间上的训练集为: 其中,(x , y )称为样本点。 x 为第i个实例(样本)。 y 为x 的标记: 当y = 1时,x 为正例;当y = −1时,x 为负例 正负用(-1,1)表示的原因:最大的作用就是标记,你也可以⽤(2,-3)来标记。只是为了⽅便,y /y = y ∗ y 的过程中刚好可以相等,便于之后的计算。

PMSM无传感器控制 滑模SMO控制 转子位置估计利用滤波后的扩展反电动势进行反正切计算

PMSM无传感器控制 滑模SMO控制 转子位置估计利用滤波后的扩展反电动势进行反正切计算,再加上滤波器延迟角度进行补偿。 运行无问题,不,只包括仿真文件。 ID:4520658282790059

smv(五)smo算法

11 SMO优化算法(Sequential minimal optimization) SMO算法由Microsoft Research的John C. Platt在1998年提出,并成为最快的二次规划优化算法,特别针对线性SVM和数据稀疏时性能更优。关于SMO最好的资料就是他本人写的《Sequential Minimal Optimization A Fast Algorithm for T

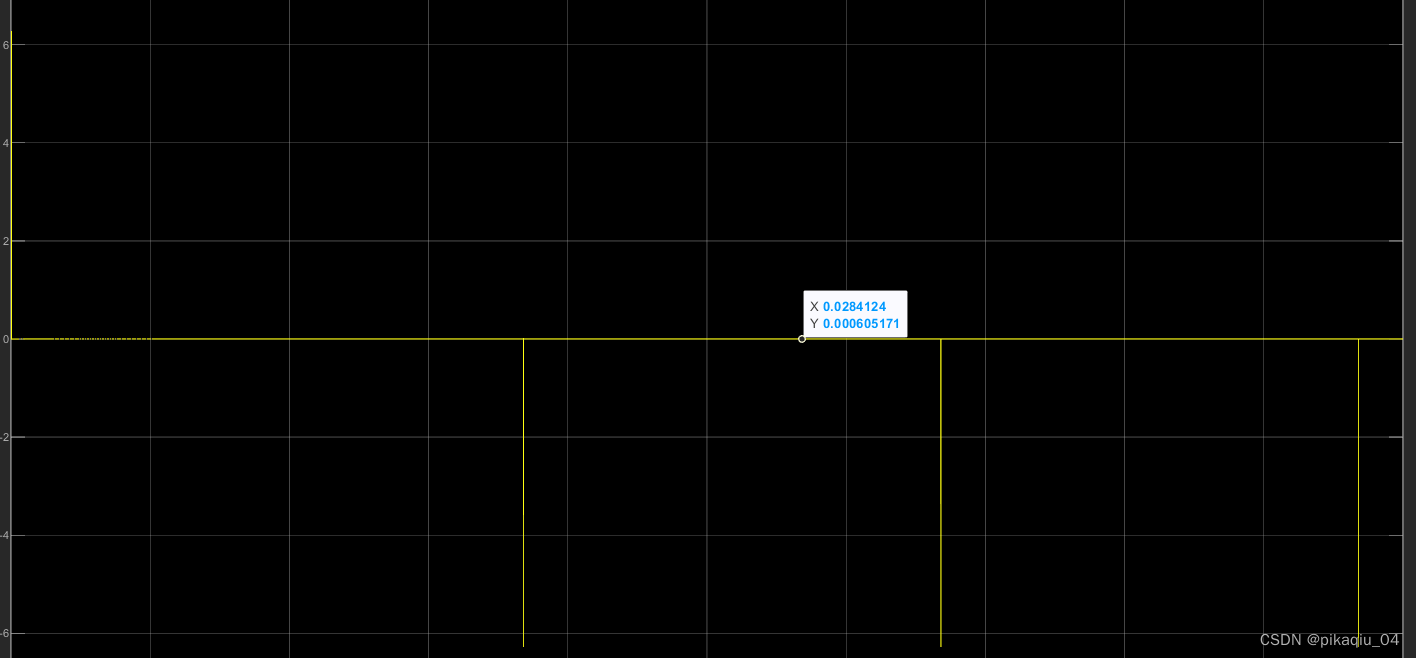

基于滑膜观测器锁相环(SMO-PLL)的无传感电机控制simulink仿真

基于滑膜观测器-锁相环的无传感电机控制仿真 仿真图搭建FOC对比SMO接入反馈后的对比总结补充 波形图都直接取自simulink-scope,均未做美化(doge)。 仿真图搭建 观前提示:原理部分请参考袁雷《现代永磁同步电机控制原理及MATLAB仿真》的公式推导。 整体结构: SMO-PLL: SMO: PLL: FOC对比 搭建完模型后先看看FOC

![[G+smo] gsMultiPatch 类](https://img-blog.csdn.net/20150415145001666?watermark/2/text/aHR0cDovL2Jsb2cuY3Nkbi5uZXQvc29saWRzYW5rZTU0/font/5a6L5L2T/fontsize/400/fill/I0JBQkFCMA==/dissolve/70/gravity/Center)