shufflenet专题

轻量级模型解读——ShuffleNet系列

和MobileNet一样,shuffleNet也是常用的轻量级模型,由旷视科技2017年首次提出 文章目录 1、ShuffleNetv12、ShuffleNetv2 首先上一张ShuffleNetv1和ShuffleNetv2两者参数量及ImageNet数据集上表现情况对比: 1、ShuffleNetv1 2017年,旷视科技提出ShuffleNet,该网络结构专

为什么MobileNet及其变体(比如ShuffleNet)会怎么快呢?

点击上方“AI公园”,关注公众号,选择加“星标“或“置顶” 作者:Yusuke Uchida 编译:ronghuaiyang 导读 MobileNet的特点就是非常的快,而且精度损失很小,这里面的原因是什么呢,这篇文章给大家解密。 介绍 在本文中,我将概述在诸如MobileNet及其变体等高效的CNN模型中使用的构建块,并解释一下为什么它们为何如此高效。特别地,我直观的说明了关于空间和通道

ShuffleNet算法详解

原博文: 论文:ShuffleNet: An Extremely Efficient Convolutional Neural Network for Mobile Devices 论文链接:https://arxiv.org/abs/1707.01083 算法详解: ShuffleNet是Face++的一篇关于降低深度网络计算量的论文,号称是可以在移动设备上运行的深度网络。这篇文章可以和Mo

内涵:高性能网络之shufflenet v2

1.概述 这篇文章是高性能神经网络的经典论文之一shufflenet-v2, 发表于18年7月份,由旷视的马宁宁,孙坚等人提出。21年的RepVgg论文中的一些理论基础很多也是来自于这篇文章。这篇文章层层递进的可以总结为如下这样几个问题: 高性能网络在做什么?之前高性能网络设计是怎么做的?这样设计的依据目标函数是否存在问题?高性能网络的真实的设计目标是什么?依据设计目标,进行对比实验,可以

YOLOv8 如何实现多主干特征融合方式 | GhostNet+ShuffleNet / SwinTransformer+ShuffleNet

文章目录 前言模块添加方法双特征提取例子`GhostNet+ShuffleNet` 双主干结构图代码 `Swin+ShuffleNet` 双主干结构图代码 参数量与计算量1. 什么是YOLO-Magic框架?2. 如何加入这个框架?3. 加入后如何使用框架?4. GitHub组织是什么?

ShuffleNet模型详解

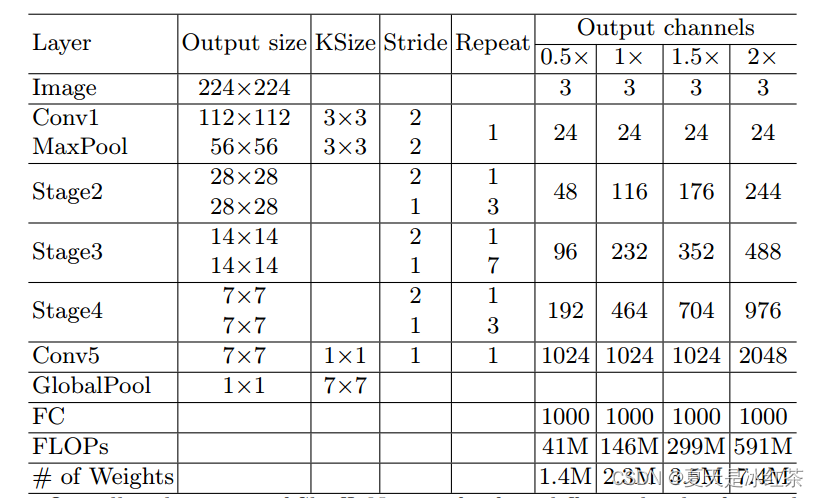

ShuffleNet论文地址:1707.01083.pdf (arxiv.org) ShuffleNetv2论文地址:1807.11164.pdf (arxiv.org) ShuffleNetv1 简介 ShuffleNet 是专门为计算能力非常有限的移动设备设计的。架构采用了逐点分组卷积和通道shuffle两种新的运算,在保持精度的同时大大降低了计算成本。ShuffleNet 比 Mob

ShuffleNet v2算法详解

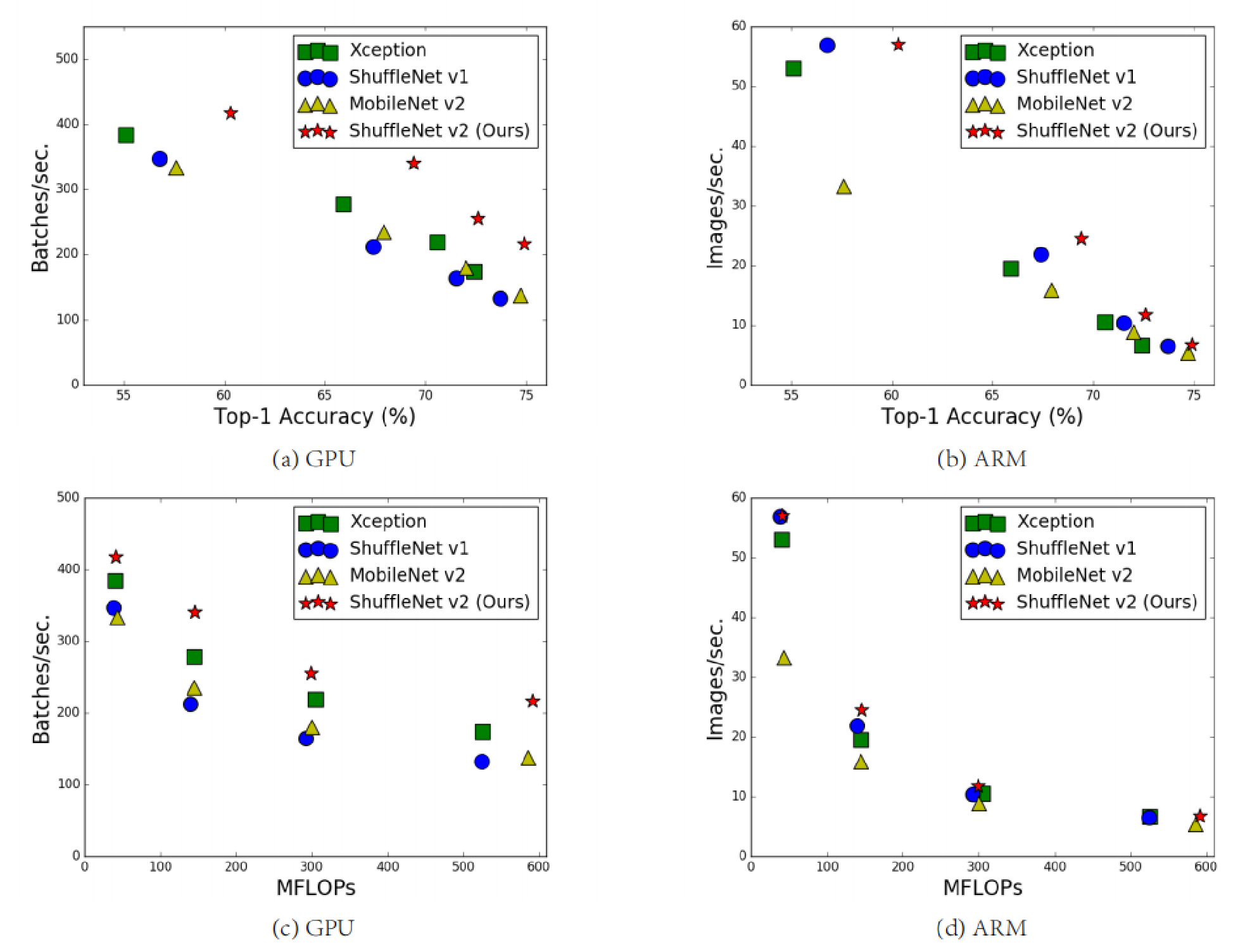

论文地址:https://arxiv.org/pdf/1807.11164.pdf ShuffleNet v1的升级版,文中提供了如何建立weights-light网络的四条准则,并做实验进行了详细的分析,并依照这四点建议,在v1的基础上修改ShuffleNet block 先看图对比shuffleNet v2的效果。对比了GPU和ARM平台下的速度和准确率的分布情况。作者提出:单一的FLOP

ShuffleNet v1算法详解

论文地址:https://arxiv.org/pdf/1707.01083.pdf Face++的一篇关于降低深度网络计算量的论文 什么是group convlution 群卷积 ? 我们假设上一层的输出feature map有N个,即通道数channel=N,也就是说上一层有N个卷积核。再假设群卷积的群数目M。那么该群卷积层的操作就是,先将channel分成M份。每一个group对应N/M个

RT-DETR 更换主干网络之 ShuffleNetv2 | 《ShuffleNet v2:高效卷积神经网络架构设计的实用指南》

目前,神经网络架构设计多以计算复杂度的间接度量——FLOPs为指导。然而,直接的度量,如速度,也取决于其他因素,如内存访问成本和平台特性。因此,这项工作建议评估目标平台上的直接度量,而不仅仅是考虑失败。在一系列控制实验的基础上,本文得出了一些有效设计网络的实用指南。据此,提出了一种新的体系结构,称为ShuffleNet V2。综合消融实验证明,我们的模型在速度和精度方面是最先进的。 论文地址:

ShuffleNet V2:高效CNN架构设计实用指南

摘要 目前,神经网络架构设计主要以计算复杂度的间接指标(即 FLOPs)为指导。然而,直接指标(如速度)还取决于其他因素,如内存访问成本和平台特性。因此,这项工作建议在目标平台上评估直接指标,而不仅仅考虑 FLOPs。在一系列受控实验的基础上,本研究为高效网络设计提供了若干实用指南。因此,本文提出了一种新架构,称为ShuffleNet V2。全面的消融实验验证了我们的模型在速度和准确性的权衡方面

【读点论文】ShuffleNet: An Extremely Efficient Convolutional Neural Network for Mobile Devices,规则分组,有序混洗

ShuffleNet: An Extremely Efficient Convolutional Neural Network for Mobile Devices Abstract 本文介绍了一种称为ShuffleNet的计算效率极高的CNN架构,它是专门为计算能力非常有限(例如10-150 MFLOPs)的移动设备设计的。新架构利用两种新操作,逐点组卷积和信道混洗,在保持精度的同时大大降低

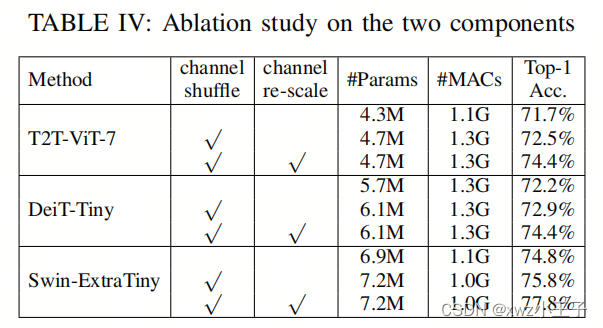

轻量化Backbone | ShuffleNet+ViT结合让ViT也能有ShuffleNet轻量化的优秀能力

视觉Transformer(ViTs)在各种计算机视觉任务中表现出卓越的性能。然而,高计算复杂性阻碍了ViTs在内存和计算资源有限的设备上的适用性。尽管某些研究已经深入探讨了卷积层与自注意力机制的融合,以增强ViTs的效率,但在纯自注意力机制的基础上构建小型但有效的ViTs仍存在知识空白。此外,采用直接策略来减少大型但性能卓越的ViT中的特征通道往往会导致性能显著下降,尽管效率得到改善。 为了解

轻量级网络模型ShuffleNet V2

在学习ShuffleNet V2内容前需要简单了解卷积神经网络和MobileNet,以及Shuffnet V1的相关内容,大家可以出门左转,去看我之前的几篇博客MobileNet发展脉络(V1-V2-V3),轻量级网络模型ShuffleNet V1🆗,接下来步入正题~ 卷积神经网络被广泛应用在图像分类、目标检测等视觉任务中,并取得了巨大的成功。然而,卷积神经网络通常

Pytorch之shuffleNet图像分类

💂 个人主页:风间琉璃🤟 版权: 本文由【风间琉璃】原创、在CSDN首发、需要转载请联系博主💬 如果文章对你有帮助、欢迎关注、点赞、收藏(一键三连)和订阅专栏哦 前言 ShuffleNet是Face++(旷视)在2017年发布的一个高效率可以运行在手机等移动设备的网络结构,论文发表在CVRP2018上。它是一种轻量级卷积神经网络架构,旨在在计算资源有限的情况下实现高效的模型推理。它