radiance专题

NeRF: Representing Scenes as Neural Radiance Fields for View Synthesis 精读

1 传统视图合成和NeRF(Neural Radiance Fields) 1.1 联系 传统视图合成和NeRF的共同目标都是从已有的视角图像中生成新的视角图像。两者都利用已有的多视角图像数据来预测或合成从未见过的视角。 1.2 区别 1.2.1 几何表示方式 传统视图合成:通常使用显式几何模型(如深度图、网格、点云)或其他图像处理方法(如基于图像拼接或光流的方法)来生成新的视图。这些

NeRF: Representing Scenes as Neural Radiance Fields for View Synthesis 翻译

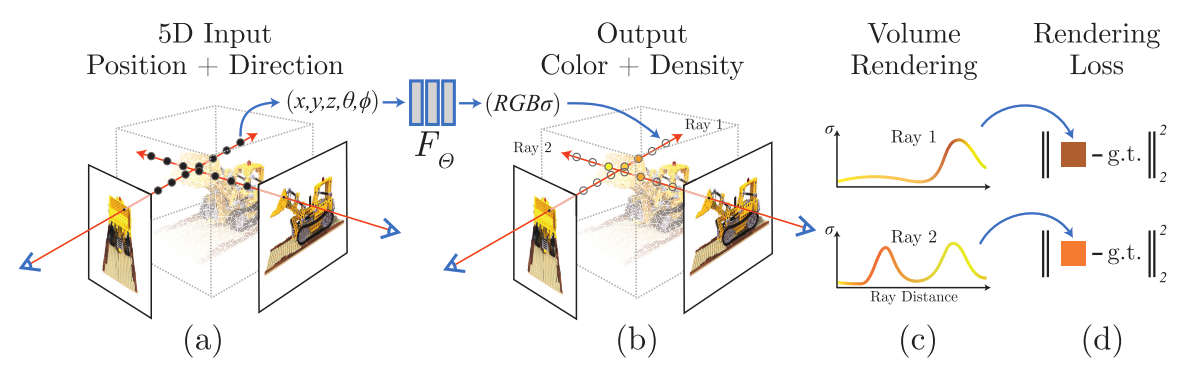

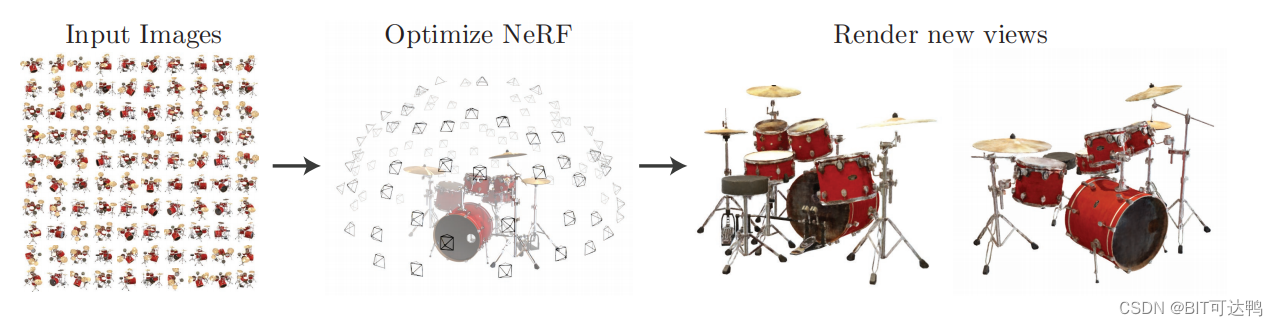

NeRF:将场景表示为用于视图合成的神经辐射场 引言。我们提出了一种方法,该方法通过使用稀疏的输入视图集优化底层连续体场景函数来实现用于合成复杂场景的新视图的最新结果。我们的算法使用全连通(非卷积)深度网络来表示场景,其输入是单个连续的5D坐标(空间位置(x,y,z)和观察方向(θ,φ)),其输出是该空间位置处的体积密度和与观察相关的发射辐射。我们通过查询沿着相机光线的5D坐标来合成视图,并使用

Radiance Field Learners As UAVFirst-Person Viewers 翻译

作为无人机第一人称视角的辐射场学习者 引言。第一人称视角(FPV)在无人机飞行轨迹的革新方面具有巨大的潜力,为复杂建筑结构的导航提供了一条令人振奋的途径。然而,传统的神经辐射场(NeRF)方法面临着诸如每次迭代采样单个点以及需要大量视图进行监控等挑战。UAV视频由于视点有限和空间尺度变化大而加剧了这些问题,导致不同尺度下的细节渲染不足。作为回应,我们引入了FPV-NeRF,通过三个关键方面来解决

【文献】3D Gaussian Splatting for Real-Time Radiance Field Rendering

论文地址:https://arxiv.org/abs/2308.04079 项目: https://repo-sam.inria.fr/fungraph/3d-gaussian-splatting/ 代码: git clone https://github.com/graphdeco-inria/gaussian-splatting —recursive 一、文章概述 1.问题

辐射神经场(NeRF, Neural Radiance Fields)

辐射神经场(NeRF, Neural Radiance Fields) 辐射神经场(NeRF, Neural Radiance Fields)是一种基于神经网络的方法,用于从二维图像合成高质量的三维场景。这一方法由Ben Mildenhall等人在2020年提出,利用多视角二维图像进行三维重建,生成的场景具有逼真的细节和光照效果。 NeRF的基本原理 NeRF的核心思想是通过神经网络表示场景

【论文笔记】DiL-NeRF: Delving into Lidar for Neural Radiance Field on Street Scenes

原文链接:https://arxiv.org/abs/2405.00900 1. 引言 自动驾驶等应用领域需要逼真的仿真。传统的仿真流程需要手工创建3D资产并构成虚拟环境,但其人力和专业需求使其难以具有可放缩性。 NeRF有不错的仿真能力,但需要大范围覆盖的训练数据以学习潜在的几何、材料特性和光照。在自动驾驶场景中,数据覆盖很稀疏,且相机的轨迹共线。此外,路面纹理较少,进一步引入重建的模糊性

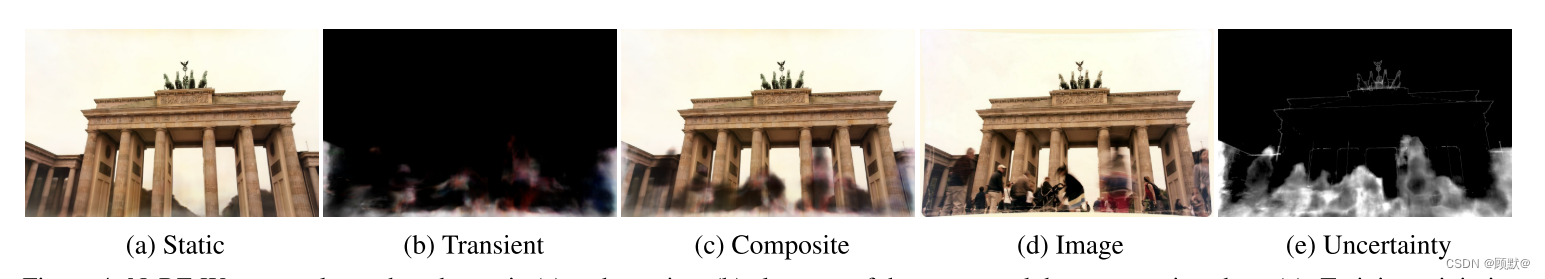

NeRF in the Wild: Neural Radiance Fields for Unconstrained Photo Collections

NeRF in the Wild: Neural Radiance Fields for Unconstrained Photo Collections(野外的 NERF: 用于无约束照片采集的神经辐射场) Abstract 我们提出了一种基于学习的方法来合成新的视图的复杂场景使用只有非结构化的收集野生照片。我们建立在神经辐射场(neRF)的基础上,它使用多层感知机的权重来模拟场景的密度和颜色

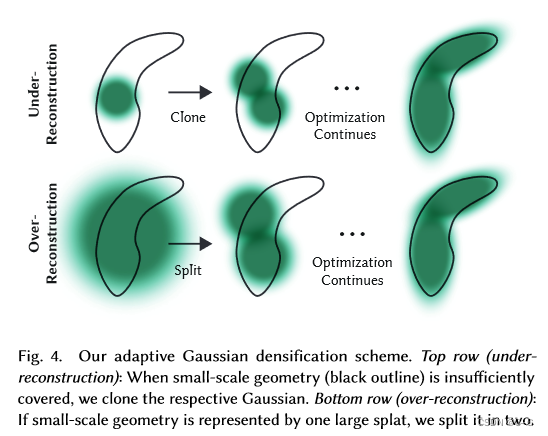

108、3D Gaussian Splatting for Real-Time Radiance Field Rendering

简介 官网 更少训练时间的同时实现最先进的视觉质量,能在1080p分辨率下实现高质量的实时(≥30 fps)新视图合成 NeRF使用隐式场景表示,体素,点云等属于显示建模方法,3DGS就是显示辐射场。它用3D高斯作为灵活高效的表示方法,同时利用神经网络的特性进行参数优化,旨在以更快的训练速度和实时性能实现高质量的渲染,尤其适用于复杂场景和高分辨率输出。 nerf是一个连续的表示,隐含地表示

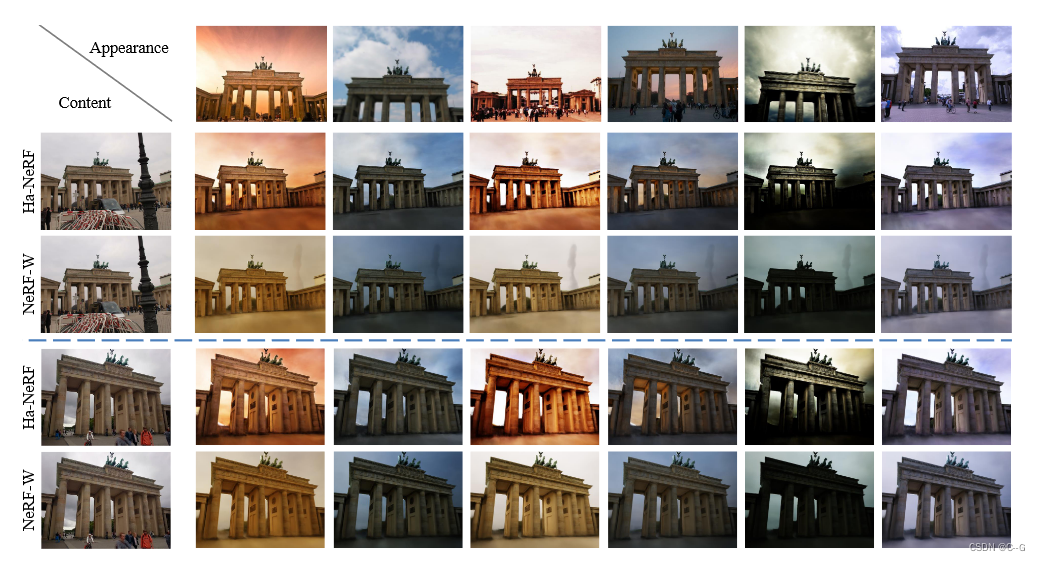

41、Hallucinated Neural Radiance Fields in the Wild

简介 主页:https://rover-xingyu.github.io/Ha-NeRF/ 从(a)一组具有可变外观和复杂遮挡的旅游图像中恢复(b)幻觉神经辐射场(Ha-NeRF)。可以始终如一地呈现©自由遮挡视图,产生不同的外观。 论文提出了一个appearance hallucination(外观幻觉)模块,一个基于cnn的外观编码器和一个视图一致的外观损失,以转移一致的光度外观在不同的

Nerf-Wild神经辐射场论文学习笔记 Neural Radiance Fields for Unconstrained Photo Collections

前言: 本文为记录自己在Nerf学习道路的一些笔记,包括对论文以及其代码的思考内容。 公众号: AI知识物语 B站后续同步更新讲解 本篇文章主要针对其数学公式来学习其内容,欢迎批评指正!!! (代码下篇出) 1:摘要 提出基于学习(learning-based)方法,使用野外照片的非结构化集合(unstructured collections of in-the-wild photogra

【图像拼接】论文精读:PERF: Panoramic Neural Radiance Field from a Single Panorama

第一次来请先看这篇文章:【图像拼接(Image Stitching)】关于【图像拼接论文精读】专栏的相关说明,包含专栏使用说明、创新思路分享等(不定期更新) 图像拼接系列相关论文精读 Seam Carving for Content-Aware Image ResizingAs-Rigid-As-Possible Shape ManipulationAdaptive As-Natural-As

【NeRF】Neural Radiance Fields讲解

文章目录 1.Definition of field(场的定义)1.1 shape representations(各种形状表征方式)1.2 Explicit surfaces and implicit surfaces1.3 Radiance Field(Implicit Surfaces)体素密度 2.Definition of Rendering(渲染的定义)2.1 Sphere T

CVPR 2023: DBARF: Deep Bundle-Adjusting Generalizable Neural Radiance Fields

我们使用以下 6 个分类标准来解释本文的研究主题: 1. 神经表示: 隐式: 这种表示使用神经网络直接将空间中的 3D 点映射到其颜色和密度。网络充当“黑盒”函数,其内部工作原理无法直接解释。示例包括 NeRF、MPR-NeRF 和 Plenoxels。显式: 这种表示将每个体素或顶点的颜色和密度信息存储在 3D 网格或网格中。这使场景几何更加明确易懂,但也需要大量内存,并且渲染起来可能很耗费

3DGS 其一:3D Gaussian Splatting for Real-Time Radiance Field Rendering

3DGS 其一:3D Gaussian Splatting for Real-Time Radiance Field Rendering 1. 预备知识1.1 球谐函数1.2 Splatting1.3 α \alpha α blending1.4 多维高斯的协方差矩阵1.4.1 高斯与椭球体的关系1.4.2 世界坐标系下的三维高斯到二维像素平面投影过程 2. 3D Gaussian Sp

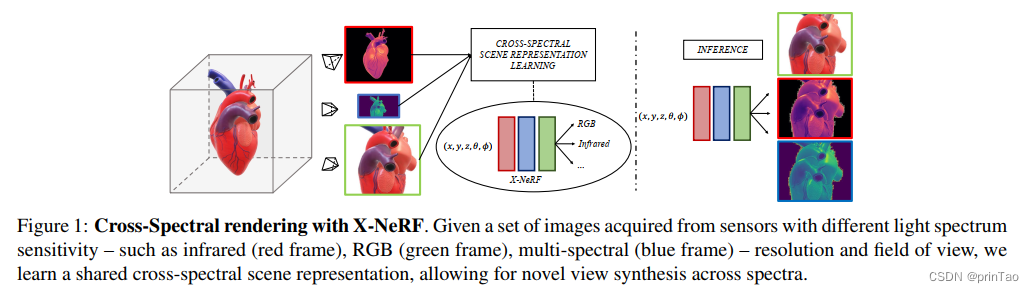

【论文阅读】多模态NeRF:Cross-Spectral Neural Radiance Fields

https://cvlab-unibo.github.io/xnerf-web intro 从不同的light spectrum sensitivity获取信息,同时需要obtain a unified Cross-Spectral scene representation – allowing for querying, for any single point, any of the i

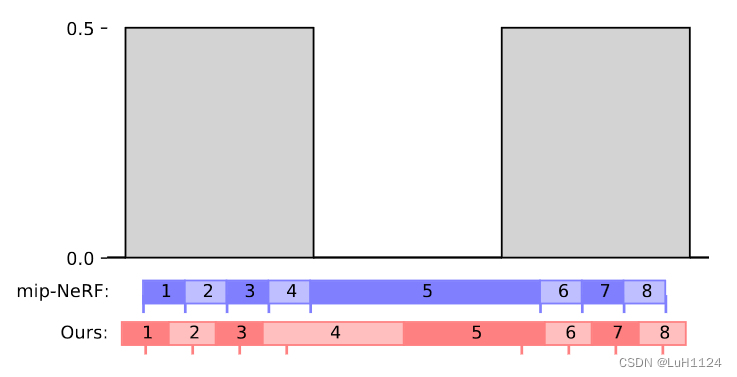

【论文阅读笔记】Mip-NeRF 360: Unbounded Anti-Aliased Neural Radiance Fields

目录 概述摘要引言参数化效率歧义性 mip-NeRF场景和光线参数化从粗到细的在线蒸馏基于区间的模型的正则化实现细节实验限制总结:附录退火膨胀采样背景颜色 paper:https://arxiv.org/abs/2111.12077 code:https://github.com/google-research/multinerf project:https://jonbarr

【论文笔记】3D Gaussian Splatting for Real-Time Radiance Field Rendering

原文链接:https://arxiv.org/abs/2308.04079 1. 引言 网孔和点是最常见的3D场景表达,因其是显式的且适合基于GPU/CUDA的快速栅格化。神经辐射场(NeRF)则建立连续的场景表达便于优化,但渲染时的随机采样耗时且引入噪声。本文的方法结合了上述两种方法的优点:使用3D高斯表达和基于tile的溅射,能实时地渲染高质量高分辨率图像。 首先建立3D高斯表达场景。从

【论文笔记】3D Gaussian Splatting for Real-Time Radiance Field Rendering

原文链接:https://arxiv.org/abs/2308.04079 1. 引言 网孔和点是最常见的3D场景表达,因其是显式的且适合基于GPU/CUDA的快速栅格化。神经辐射场(NeRF)则建立连续的场景表达便于优化,但渲染时的随机采样耗时且引入噪声。本文的方法结合了上述两种方法的优点:使用3D高斯表达和基于tile的溅射,能实时地渲染高质量高分辨率图像。 首先建立3D高斯表达场景。从

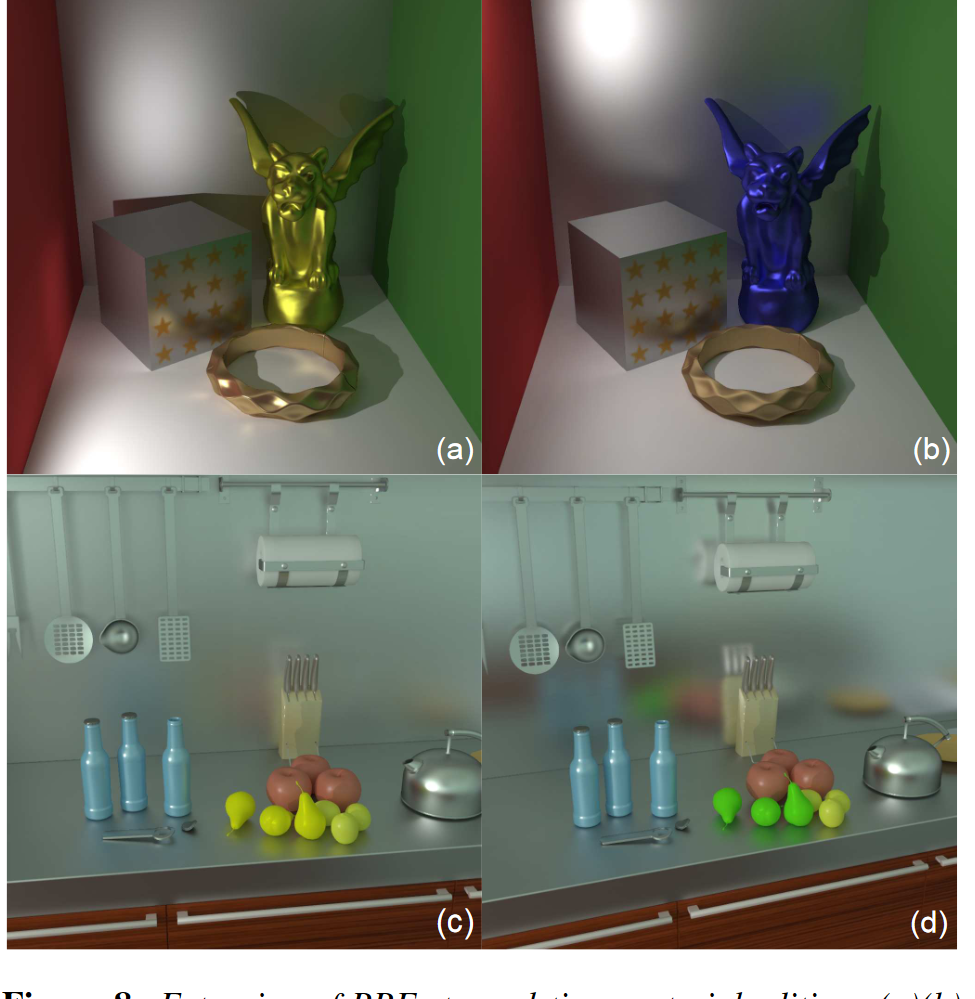

《Global illumination with radiance regression functions》

总结一下最近看的这篇结合神经网络的全局光照论文 这是一篇2013年TOG的论文。 介绍 论文的主要思想是利用了神经网络的非线性特性去拟合全局光照中的间接光照部分,采用了基础的2层MLP去训练,最终能实现一些点光源、glossy材质的光照渲染。为了更好的理解、其输入输出表示如下。 首先是原文的介绍: 4个三维向量:着色点位置 x p x_p xp,间接光照对应视角方向 v v v,点光源位置

[SIGGRAPH-23] 3D Gaussian Splatting for Real-Time Radiance Field Rendering

pdf | proj | code 本文提出一种新的3D数据表达形式3D Gaussians。每个Gaussian由以下参数组成:中心点位置、协方差矩阵、可见性、颜色。通过世界坐标系到相机坐标系,再到图像坐标系的仿射关系,可将3D Gaussian映射到相机坐标系,通过对z轴积分,可得到对应Splatting 2D分布。针对3D Gaussians,提出对应的优化方法。去除可见性太低的高

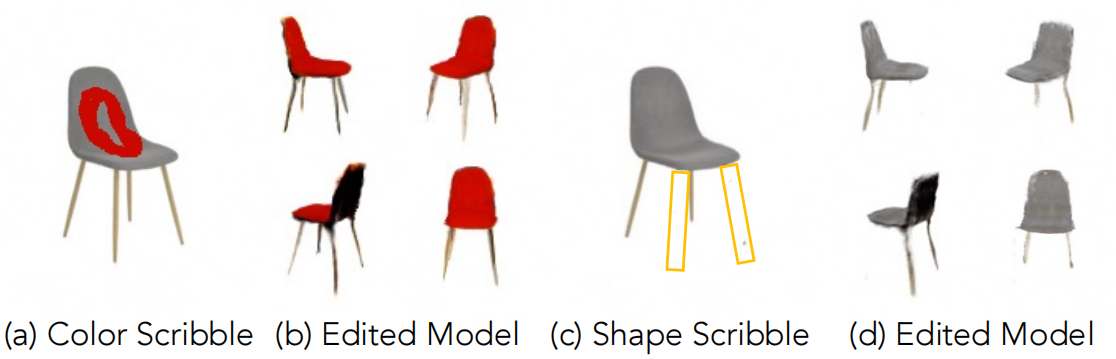

【三维编辑】Editing Conditional Radiance Fields 编辑条件NeRF(ICCV2021)

Editing Conditional Radiance Fields(ICCV 2021) 作者单位:Steven Liu, Xiuming Zhang, Zhoutong Zhang, Richard Zhang MIT, Adobe Research, CMU 代码地址:https://github.com/stevliu/editnerf 文章目录 摘要前言一、相关工作二、

NeRF:Representing Scenes as Neural Radiance Fields for viem Synthesis(用于视图合成的神经辐射场的场景表示)

NeRF:Representing Scenes as Neural Radiance Fields for viem Synthesis(用于视图合成的神经辐射场的场景表示)|2020年 Fig. 1:通过场景的一些图片作为输入,我们提出一种优化连续的 5D 神经辐射场表示的方法 摘要 我们提出一种方法,使用较少的视图(view)作为输入,对一个连续、隐含的体积场景函数(volumet

【ECCV 2020】NeRF: Representing Scenes as Neural Radiance Fields for View Synthesis

Representing Scenes as Neural Radiance Fields for View Synthesis 论文简介:论文介绍:Neural Radiance Field Scene Representation:Volume Rendering with Radiance Fields:Optimizing a Neural Radiance Field:Positi

[ICCV-23] DeformToon3D: Deformable Neural Radiance Fields for 3D Toonification

pdf | code 将3D人脸风格化问题拆分为几何风格化与纹理风格化。提出StyleField,学习以风格/ID为控制信号的几何形变残差,实现几何风格化。通过对超分网络引入AdaIN,实现纹理风格化。由于没有修改3D GAN空间,因此可以便捷实现Editing和Animation。 目录 摘要 方法 Geometry Toonification with StyleField Tex

[ICCV-23] DeformToon3D: Deformable Neural Radiance Fields for 3D Toonification

pdf | code 将3D人脸风格化问题拆分为几何风格化与纹理风格化。提出StyleField,学习以风格/ID为控制信号的几何形变残差,实现几何风格化。通过对超分网络引入AdaIN,实现纹理风格化。由于没有修改3D GAN空间,因此可以便捷实现Editing和Animation。 目录 摘要 方法 Geometry Toonification with StyleField Tex

![[SIGGRAPH-23] 3D Gaussian Splatting for Real-Time Radiance Field Rendering](https://img-blog.csdnimg.cn/8c9dec18a06c4ca8bc41e0fd5ce729b9.png)

![[ICCV-23] DeformToon3D: Deformable Neural Radiance Fields for 3D Toonification](https://img-blog.csdnimg.cn/7e380c05d6b44621b4e0e93b7d7abc06.png)