mlm专题

MLM:多模态大型语言模型的简介、微调方法、发展历史及其代表性模型、案例应用之详细攻略

MLM:多模态大型语言模型的简介、微调方法、发展历史及其代表性模型、案例应用之详细攻略 目录 相关文章 AI之MLM:《MM-LLMs: Recent Advances in MultiModal Large Language Models多模态大语言模型的最新进展》翻译与解读 MLM之CLIP:CLIP(对比语言-图像预训练模型)的简介、安装和使用方法、案例应用之详细攻略 多模

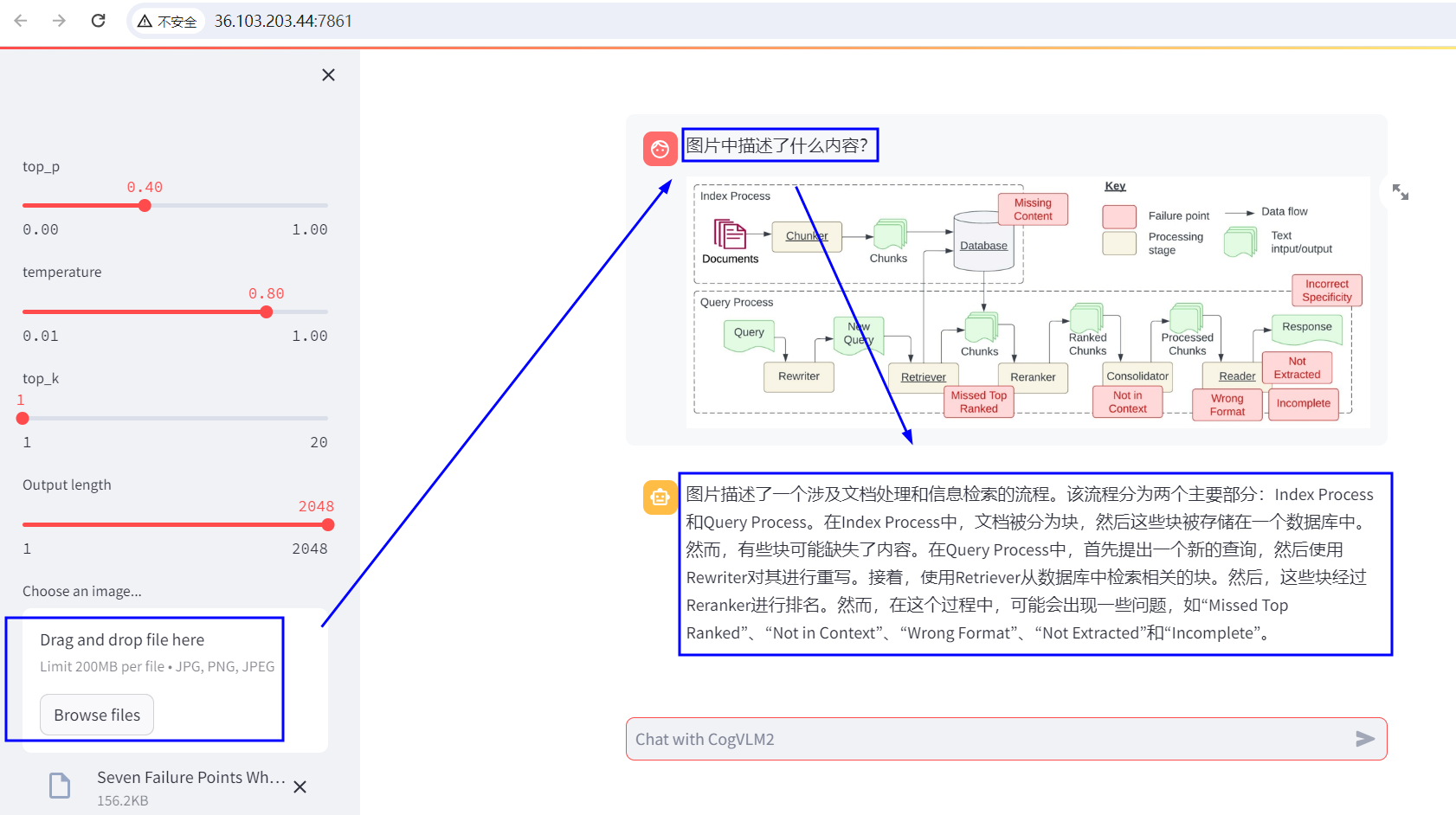

MLM之CogVLM2:CogVLM2(基于Llama-3-8B-Instruct 模型进行微调)的简介、安装和使用方法、案例应用之详细攻略

MLM之CogVLM2:CogVLM2(基于Llama-3-8B-Instruct 模型进行微调)的简介、安装和使用方法、案例应用之详细攻略 目录 CogVLM2的简介 1、更新日志 2、CogVLM2 系列开源模型的详细信息 3、Benchmark 4、项目结构 5、模型协议 CogVLM2的安装和使用方法 1、模型微调 注意 最低配置 开始微调 下载数据集和安

bert 的MLM框架任务-梯度累积

参考:BEHRT/task/MLM.ipynb at ca0163faf5ec09e5b31b064b20085f6608c2b6d1 · deepmedicine/BEHRT · GitHub class BertConfig(Bert.modeling.BertConfig):def __init__(self, config):super(BertConfig, self).__init_

pytorch版本的bert模型代码(MLM)

魔改bert就必须要知道Bert的结构: 主要解答与BertForMaskedLM(MLM)有关的类: 下面是MLM的分类头: class BertLMPredictionHead(nn.Module):def __init__(self, config, bert_model_embedding_weights):super(BertLMPredictionHead, self).__in

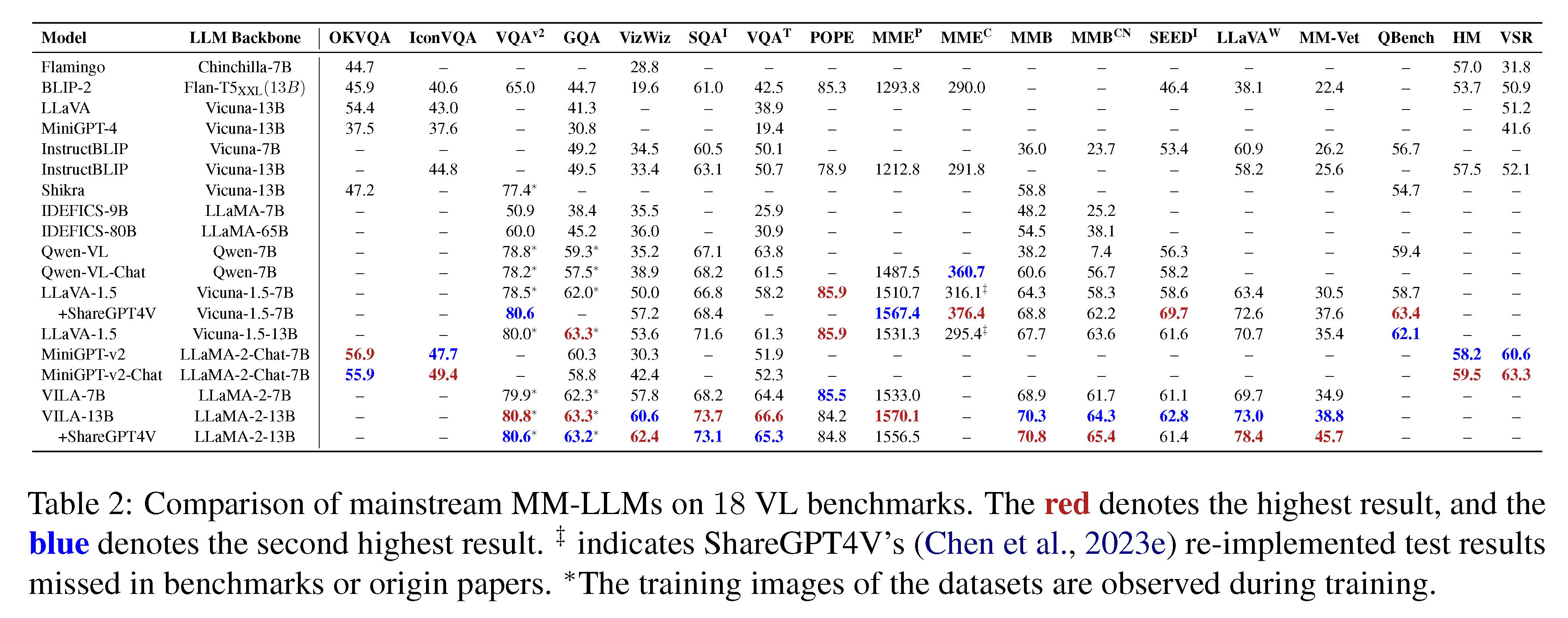

AI之MLM:《MM-LLMs: Recent Advances in MultiModal Large Language Models多模态大语言模型的最新进展》翻译与解读

AI之MLM:《MM-LLMs: Recent Advances in MultiModal Large Language Models多模态大语言模型的最新进展》翻译与解读 目录 《MM-LLMs: Recent Advances in MultiModal Large Language Models》翻译与解读 Abstract摘要 Figure 1: The timeli

微服务治理:什么是微服务生命周期管理 (MLM)?

微服务生命周期管理 (MLM) 指的是管理微服务整个生命周期的各种流程和工具,从其最初的设计和开发到最终的停用。它类似于软件开发生命周期 (SDLC),但专门针对微服务架构的独特需求进行定制。 以下分解了 MLM 中的关键阶段及其含义: 1. 设计和开发: 定义边界和 API: 明确概述每个微服务的作用域和职责,以及它们如何相互交互。开发和测试: 独立构建和测试微服务,同时确保兼容性和遵守标

区别探索:掩码语言模型 (MLM) 和因果语言模型 (CLM)的区别

大多数现代 NLP 系统都遵循相当标准的方法来为各种用例训练新模型,即首先预训练,然后微调。这里, 预训练的目标是利用大量未标记的文本并构建语言理解的通用模型,然后针对各种特定的 NLP 任务(例如机器翻译、文本摘要等)进行微调。 在本博客中,我们将讨论两种流行的预训练方案,即掩码语言建模(MLM)和因果语言建模(CLM)。 没有时间阅读整个博客?然后观看这段 <60 秒的 短片 -