lightgbm专题

【python 机器学习】机器学习算法之LightGBM

算法介绍: LightGBM 由微软2017年提出,主要用于解决 GDBT 在海量数据中遇到的问题,以便其可以更好更快地用于工业实践中。从 LightGBM 名字我们可以看出其是轻量级(Light)的梯度提升机(GBM),其相对 XGBoost 具有训练速度快、内存占用低的特点。 实际上,XGBoost和lightGBM都属于GBDT的一种实现,旨在优化算法的性能,提升算法的训练速度,与XGBoo

机器学习-有监督学习-集成学习方法(六):Bootstrap->Boosting(提升)方法->LightGBM(Light Gradient Boosting Machine)

机器学习-有监督学习-集成学习方法(六):Bootstrap->Boosting(提升)方法->LightGBM(Light Gradient Boosting Machine) LightGBM 中文文档 https://lightgbm.apachecn.org/ https://zhuanlan.zhihu.com/p/366952043

回归预测|基于鹅GOOSE优化LightGBM的数据回归预测Matlab程序 多特征输入单输出 2024年优化算法

回归预测|基于鹅GOOSE优化LightGBM的数据回归预测Matlab程序 多特征输入单输出 2024年优化算法| 文章目录 前言回归预测|基于鹅GOOSE优化LightGBM的数据回归预测Matlab程序 多特征输入单输出 2024年优化算法GOOSE-LightGBM 一、GOOSE-LightGBM模型原理:流程:总结: 二、实验结果三、核心代码四、代码获取五、总结

机器学习——lightGBM(学习整理)

目录 一、认识lightGBM 1. 简单介绍 2. 主要特点 LightGBM 的缺点 3. 模型训练方式 (1)Training API (2)Scikit-learn API 二、相关函数参数 1. Training API 2. Scikit-learn API(重复只做补充) 3. lightgbm.cv 4. lightgbm.Dataset 5. Callb

对比分析:GBDT、XGBoost、CatBoost和LightGBM

对比分析:GBDT、XGBoost、CatBoost和LightGBM 梯度提升决策树(GBDT)是当前机器学习中常用的集成学习方法之一,它通过集成多个弱学习器(通常是决策树)来构建强学习器。GBDT在分类和回归任务中表现优异,并在许多机器学习竞赛中频频获胜。随着算法的发展,GBDT衍生出了多种实现,其中以XGBoost、CatBoost和LightGBM最为知名。本文将详细介绍这四种算法的特点

Random Forest GBDT XGBOOST LightGBM面试问题整理

一.知识点 二.特征重要性评估 基于树的集成算法有一个很好的特性,就是模型训练结束后可以输出模型所使用的特征的相对重要性,便于理解哪些因素是对预测有关键影响,有效筛选特征。 Random Forest 袋外数据错误率评估 由于RF采用bootstrapping有放回采样, 一个样本不被采样到的概率为 limm→∞(1−1m)m=1e≈0.368 lim m → ∞

Mac笔记本安装LightGBM

MAC install LightGBM: brew install cmake brew install gcc --without-multilib git clone --recursive https://github.com/Microsoft/LightGBM cd LightGBM mkdir build cd build cmake .. (这一步要使用root权限)

【lightgbm/xgboost/nn代码整理三】keras做二分类,多分类以及回

【lightgbm/xgboost/nn代码整理三】keras做二分类,多分类以及回归任务 浏览更多内容,可访问:http://www.growai.cn 1.简介 该部分是比较基础的深度网络部分,是基于keras实现的多层感知机网络(mlp),使用nn个人感觉最大的一个好处就是目标函数自定义很方便,下面将从数据处理、网络搭建和模型训练三个部分介绍。如果只是想要阅读代码,可直接移步到尾部链接

【lightgbm, xgboost, nn代码整理一】lightgbm做二分类,多分类以及回归任务(含python源码)

lightgbm做二分类,多分类以及回归任务(含python源码) 浏览更多内容,可访问:http://www.growai.cn 1. 简介 内心一直想把自己前一段时间写的代码整理一下,梳理一下知识点,方便以后查看,同时也方便和大家交流。希望我的分享能帮助到一些小白用户快速前进,也希望大家看到不足之处慷慨的指出,相互学习,快速成长。我将从三个部分介绍数据挖掘类比赛中常用的一些方法,分别是l

利用pyspark评估lightgbm模型

1.打包conda虚拟环境并上传到hdfs (1)打包虚拟环境 cd /home/work/.conda/envs/light_gbm zip -r -q lgb.zip ./ 注意:这里打包的位置会影响到后面指定executor的pyspark环境。 一定要到虚拟环境light_gbm这一层目录下,而不是envs这一层目录 (2)把打包好的虚拟环境上传到hdfs hadoop fs

kaggle竞赛实战7——其他方案之lightgbm

本文换种方案,用wrapper+lightgbm建模+TPE调优 接下来是特征筛选过程,此处先择使用Wrapper方法进行特征筛选,通过带入全部数据训练一个LightGBM模型,然后通过观察特征重要性,选取最重要的300个特征。当然,为了进一步确保挑选过程的有效性,此处我们考虑使用交叉验证的方法来进行多轮验证。实际多轮验证特征重要性的过程也较为清晰,我们只需要记录每一轮特征重要性,并在最后进行简

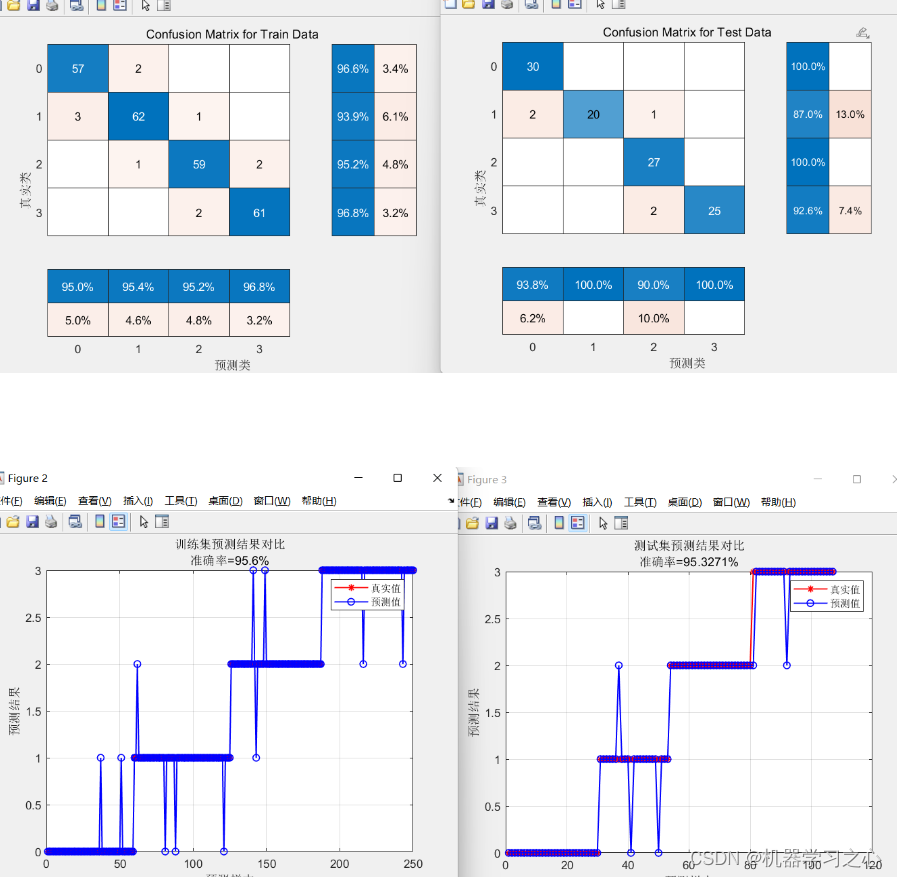

分类预测 | Matlab实现基于LightGBM的多特征输入多类别输出模型

分类预测 | Matlab实现基于LightGBM的多特征输入多类别输出模型 目录 分类预测 | Matlab实现基于LightGBM的多特征输入多类别输出模型分类效果基本介绍程序设计参考资料 分类效果 基本介绍 1.Matlab实现基于LightGBM的数据分类预测模型Matlab程序 多特征输入多类别输出,运行环境为Matlab2018及以上。 2.多特征输入单

【Python】 XGBoost vs LightGBM:两大梯度提升框架的对比

原谅把你带走的雨天 在渐渐模糊的窗前 每个人最后都要说再见 原谅被你带走的永远 微笑着容易过一天 也许是我已经 老了一点 那些日子你会不会舍不得 思念就像关不紧的门 空气里有幸福的灰尘 否则为何闭上眼睛的时候 又全都想起了 谁都别说 让我一个人躲一躲 你的承诺 我竟然没怀疑过 反反覆覆 要不是当初深深深爱过 我试着恨你 却想起你的笑容 🎵 陈楚生/单

LightGBM超参数优化-贝叶斯,网格

import hyperoptfrom hyperopt import hp,fmin,tpe,Trials,partialfrom hyperopt.early_stop import no_progress_loss#参数的搜索空间LGBM_params_space={'max_depth':hp.choice('max_depth',np.arange(10,50).toli

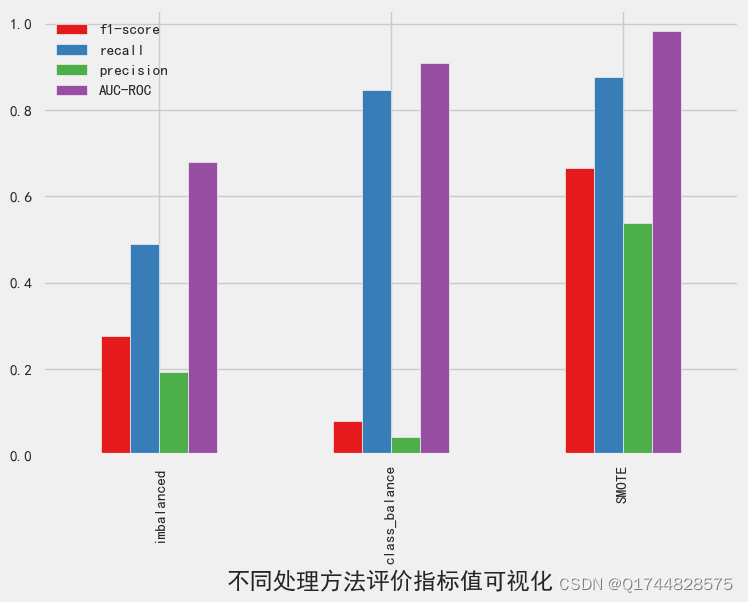

数据挖掘之基于Lightgbm等多模型消融实验的信用欺诈检测实现

欢迎大家点赞、收藏、关注、评论啦 ,由于篇幅有限,只展示了部分核心代码。 文章目录 一项目简介 二、功能三、系统四. 总结 一项目简介 一、项目背景 在当前的金融环境中,信用欺诈行为日益增多,给金融机构和消费者带来了巨大的损失。为了有效地检测和预防信用欺诈,金融机构急需一种高效、准确的方法。本项目旨在利用数据挖掘技术和LightGBM等多模型进行消融实验,以实现信用欺

R语言 lightgbm 算法优化:不平衡二分类问题(附代码)

来源:大数据文摘本文约10000字,建议阅读10分钟本文以kaggle比赛的数据为例,为你讲解不平衡二分类问题的解决方法。 本案例使用的数据为kaggle中“Santander Customer Satisfaction”比赛的数据。此案例为不平衡二分类问题,目标为最大化auc值(ROC曲线下方面积)。目前此比赛已经结束。 竞赛题目链接为: https://www.kaggle.com/c/s

LazyProphet:使用 LightGBM 进行时间序列预测

来源:Deephub Imba本文约2800字,建议阅读5分钟LazyProphet还是一个时间序列建模的很好选择。 当我们考虑时间序列的增强树时,通常会想到 M5 比赛,其中前十名中有很大一部分使用了 LightGBM。但是当在单变量情况下使用增强树时,由于没有大量的外生特征可以利用,它的性能非常的糟糕。 首先需要明确的是M4 比赛的亚军 DID 使用了增强树。但是它作为一个元模型来集成其

20240326-2-LightGBM面试题

LightGBM面试题 1. 简单介绍一下LightGBM? LightGBM是一个梯度 boosting 框架,使用基于学习算法的决策树。 它可以说是分布式的,高效的。 从 LightGBM 名字我们可以看出其是轻量级(Light)的梯度提升机(GBM),其相对 XGBoost 具有训练速度快、内存占用低的特点。 LightGBM 是为解决GBDT训练速度慢,内存占用大的缺点,此外还

【六 (4)机器学习-回归任务-鲍鱼年龄预测xgboost、lightgbm实战】

目录 文章导航一、xgboost简介二、lightgbm简介三、代码实现1、导入类库2、导入数据3、类别参数预处理4、数据集划分、模型初始化、参数优化、保存模型4、对测试集进行预测 文章导航 【一 简明数据分析进阶路径介绍(文章导航)】 一、xgboost简介 XGBoost(Extreme Gradient Boosting)是一种基于梯度提升决策树的优化分布式梯度提升

微软开源分布式高性能GB框架LightGBM MacOS下编译安装过程

LightGBM(Light Gradient Boosting Machine)是一个基于决策树算法的快速的、分布式的、高性能 gradient boosting(GBDT、GBRT、GBM 或 MART)框架,可被用于排行、分类以及其他许多机器学习任务中。开源项目地址: https://github.com/Microsoft/LightGBM 开源|LightGBM:三天内收获GitHub

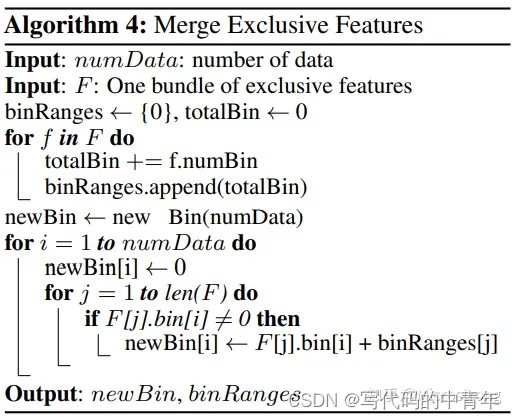

深入理解LightGBM

深入理解LightGBM 【机器学习】深度剖析 LightGBM vs XGBOOST 哪个更胜一筹-CSDN博客 终于有人把XGBoost 和 LightGBM 讲明白了,项目中最主流的集成算法!

LightGBM:更好更快地用于工业实践集成学习算法

AI预测相关目录 AI预测流程,包括ETL、算法策略、算法模型、模型评估、可视化等相关内容 最好有基础的python算法预测经验 EEMD策略及踩坑VMD-CNN-LSTM时序预测对双向LSTM等模型添加自注意力机制K折叠交叉验证optuna超参数优化框架多任务学习-模型融合策略Transformer模型及Paddle实现迁移学习在预测任务上的tensoflow2.0实现holt提取时序序列

XGBoost与LightGBM 数据科学家常用工具大PK——性能与结构

https://www.youtube.com/watch?v=dOwKbwQ97tI&list=RDLVWeHM2xpYQpw&index=4

mmlspark.lightgbm.LightGBMClassifier参数明

mmlspark.lightgbm.LightGBMClassifier 是一个用于二元分类和多类分类的机器学习模型,它是基于 Microsoft ML for Apache Spark (MMLSpark) 库的。这个类是为了在Spark环境中使用LightGBM实现,提供了大量的参数用于调整模型。下面是一些主要参数的详细中文描述: baggingFraction (float): Bagg

LightGBM高级教程:深度集成与迁移学习

导言 深度集成和迁移学习是提高模型性能和泛化能力的重要技术。在Python中,LightGBM作为一种高效的梯度提升决策树算法,可以与其他模型进行深度集成,同时也支持迁移学习。本教程将详细介绍如何在Python中使用LightGBM进行深度集成与迁移学习,并提供相应的代码示例。 深度集成 深度集成是指将多个不同模型的预测结果结合起来,以提高模型性能和鲁棒性。在LightGBM中,可以使用其预

探索LightGBM:异常值处理与鲁棒建模

导言 异常值是数据中的特殊点,可能导致模型的不准确性和不稳定性。在使用LightGBM进行建模时,处理异常值是非常重要的一步,以确保模型的鲁棒性和可靠性。本教程将详细介绍如何在Python中使用LightGBM进行异常值处理和鲁棒建模,并提供相应的代码示例。 加载数据 首先,我们需要加载数据集并准备数据用于模型训练。以下是一个简单的示例: import lightgbm as lgbfr