inception专题

Inception_V2_V3

Inception_V2_V3 CNN卷积网络的发展史 1. LetNet5(1998) 2. AlexNet(2012) 3. ZFNet(2013) 4. VGGNet(2014) 5. GoogLeNet(2014) 6. ResNet(2015) 7. DenseNet(2017) 8. EfficientNet(2019) 9. Vision Transformers(2020) 1

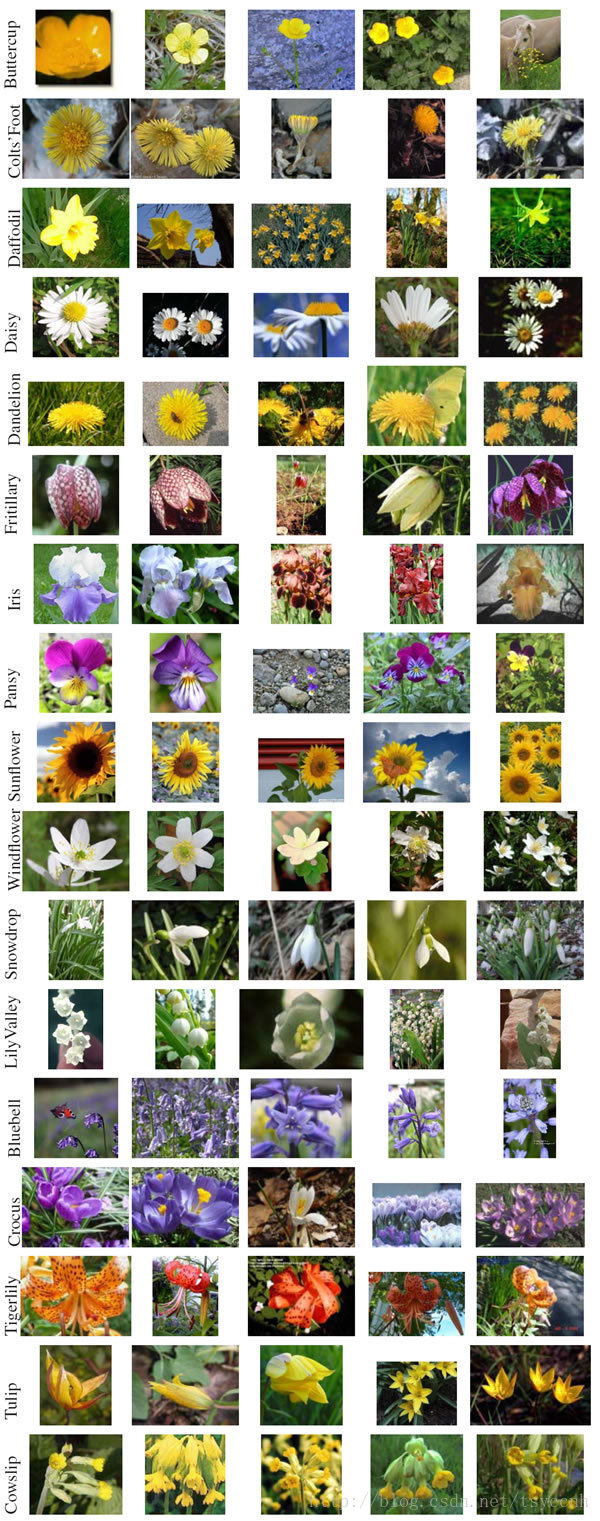

TensorFlow使用inception模型进行flower识别训练+修改原始inception实现predict

这是我对原始Inception做了修改之后传到github上的github链接 主要的修改是实现了输出filename和对应的label 并提供了运行相关py文件的运行命令 有需要的可以去下载 自己尝试运行inception 中的flowers_train.py 在此过程中 遇到了一些坑 在网上也没有找到详细讲述如何运行的博客 在这里写下来与大家分享我作为一个小白遇到的问题和解决的办

深度学习网络结构之---Inception

目录 一、Inception名称的由来 二、Inception结构 三、Inception v2 四、Inception v3 1、深度网络的通用设计原则 2.卷积分解(Factorizing Convolutions) 3.对称卷积分解 3.非对称卷积分解 五、Inception v4 一、Inception名称的由来 Inception网

常见的神经网络模型 AlexNet,VGGNet,GoogleNet,resNet,inceptionV3,Inception-v4,xception等论文下载链接

LeNet 1986 AlexNet 2012 http://pan.baidu.com/s/1NpEG2,作者:Alex Krizhevsky,Ilya Sutskever,Geoffrey E.Hinton VGGNet 2014 https://arxiv.org/pdf/1409.1556.pdf 6.8% test error,作者:Karen Simonyan,Andrew Ziss

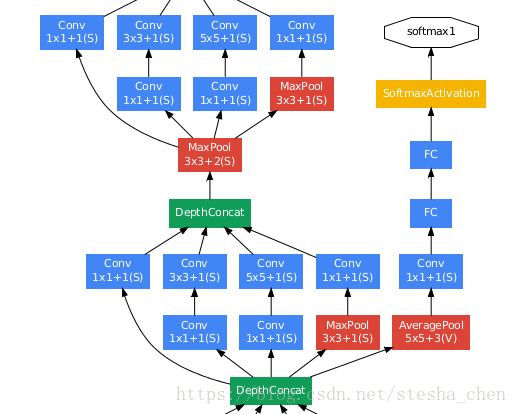

【机器学习300问】106、Inception网络结构如何设计的?这么设计的目的是什么?

谷歌的Inception网络,也被称为GoogLeNet,是Google在2014年推出的一种深度卷积神经网络(CNN)模型,在这之前的AlexNet、VGG等结构都是通过增大网络的深度(层数)来获得更好的训练效果,但层数的增加会带来很多负作用,比如overfit、梯度消失、梯度爆炸等。Inception网络的核心组成部分是所谓的"Inception模块",这是对传统卷积神经网络架

5.23.12 计算机视觉的 Inception 架构

1. 介绍 分类性能的提升往往会转化为各种应用领域中显着的质量提升,深度卷积架构的架构改进可用于提高大多数其他计算机视觉任务的性能,这些任务越来越依赖于高质量的学习视觉特征。在 AlexNet 功能无法与手工设计、制作的解决方案竞争的情况下,网络质量的改进为卷积网络带来了新的应用领域。 GoogleNet 使用了大约 700 万个参数,比其前身 AlexNet(使用 6000 万个参数)减少了

Inception网络

本文来自于网易云课堂 Inception网络简介 当构建卷积层时需要考虑过滤器的大小究竟是1×3,3×3还是5×5,要不要添加池化层而inception网络的作用就是代替你来做决定。虽然网络架构因此变得更加复杂,但网络表现却非常好。 对于一个28*28*192的输入,inception网络或inception层的作用就是代替人工来确定卷积层中的过滤器类型或者确定是否需要卷积层或者池化层。

tensorflow 卷积神经网络 Inception-v3模型 迁移学习

____tz_zs小练习 案例来源于 《TensorFlow实战Google深度学习框架》 谷歌提供的训练好的Inception-v3模型: https://storage.googleapis.com/download.tensorflow.org/models/inception_dec_2015.zip 案例使用的数据集: http://download.tensorf

经典网络GoogLeNet(Inception V3)的搭建与实现(全网最佳版本)

作者总结的很好:https://blog.csdn.net/loveliuzz/article/details/79135583

Keras 入门课6 -- 使用Inception V3模型进行迁移学习

Keras 入门课6:使用Inception V3模型进行迁移学习 本系列课程代码,欢迎star: https://github.com/tsycnh/Keras-Tutorials keras 请使用2.1.2版 深度学习可以说是一门数据驱动的学科,各种有名的CNN模型,无一不是在大型的数据库上进行的训练。像ImageNet这种规模的数据库,动辄上百万张图片。对于普通的机器学习工作者

TensorFlow学习笔记:Retrain Inception_v3(一)

转:http://www.jianshu.com/p/613c3b08faea0. 概要最新的物体识别模型可能含有数百万个参数,将耗费几周的时间去完全训练。因此我们采用迁移学习的方法,在已经训练好的模型(基于ImageNet)上调整部分参数,以实现对新类别的分类。关于迁移学习的理论,可以参考DeCAF: A Deep Convolutional Activation Feature for

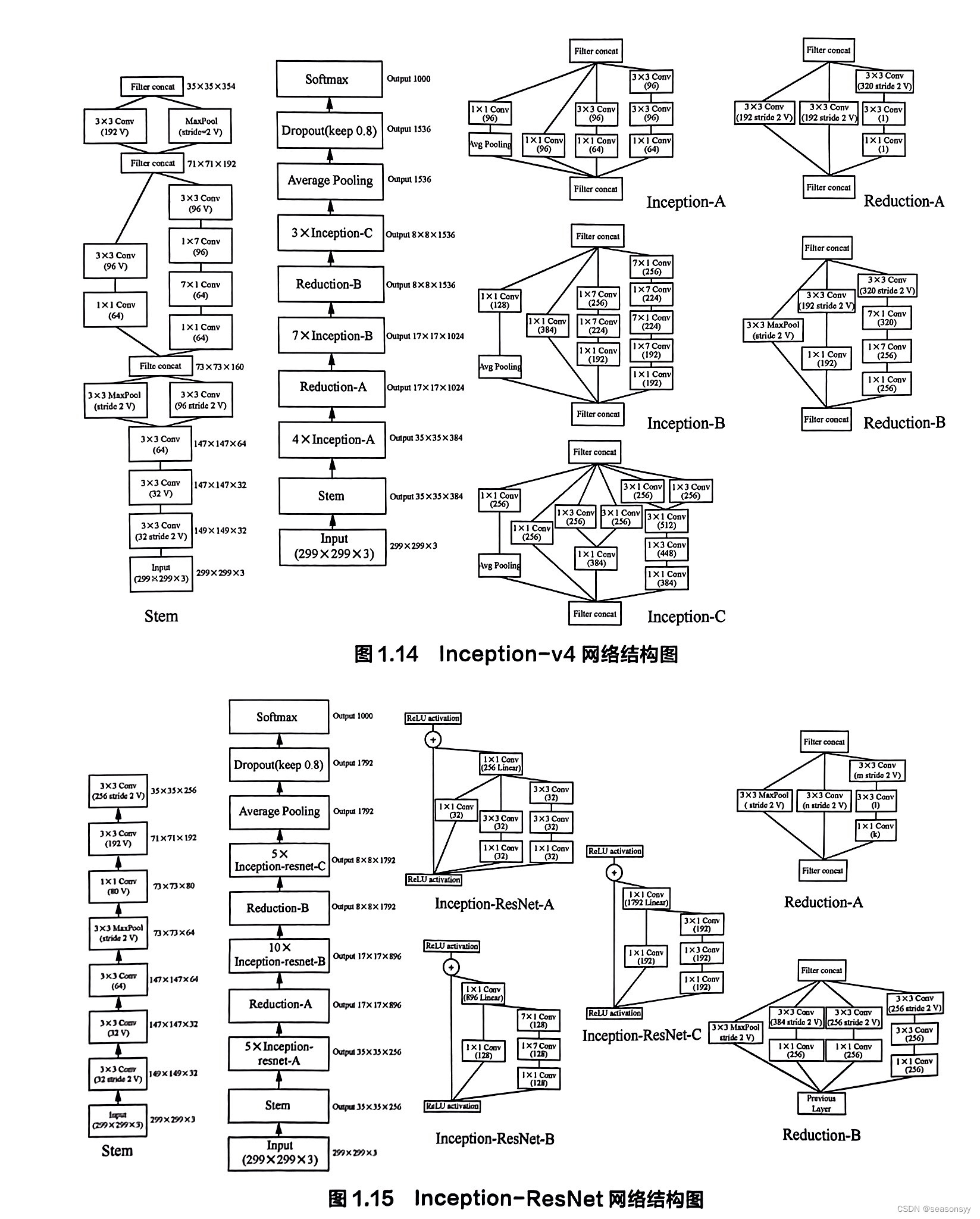

1.8.5 卷积神经网络近年来在结构设计上的主要发展和变迁——Inception-v4 和 Inception-ResNet

1.8.5 卷积神经网络近年来在结构设计上的主要发展和变迁——Inception-v4 和 Inception-ResNet 前情回顾: 1.8.1 卷积神经网络近年来在结构设计上的主要发展和变迁——AlexNet 1.8.2 卷积神经网络近年来在结构设计上的主要发展和变迁——VGGNet 1.8.3 卷积神经网络近年来在结构设计上的主要发展和变迁——GoogleNet/inception-v

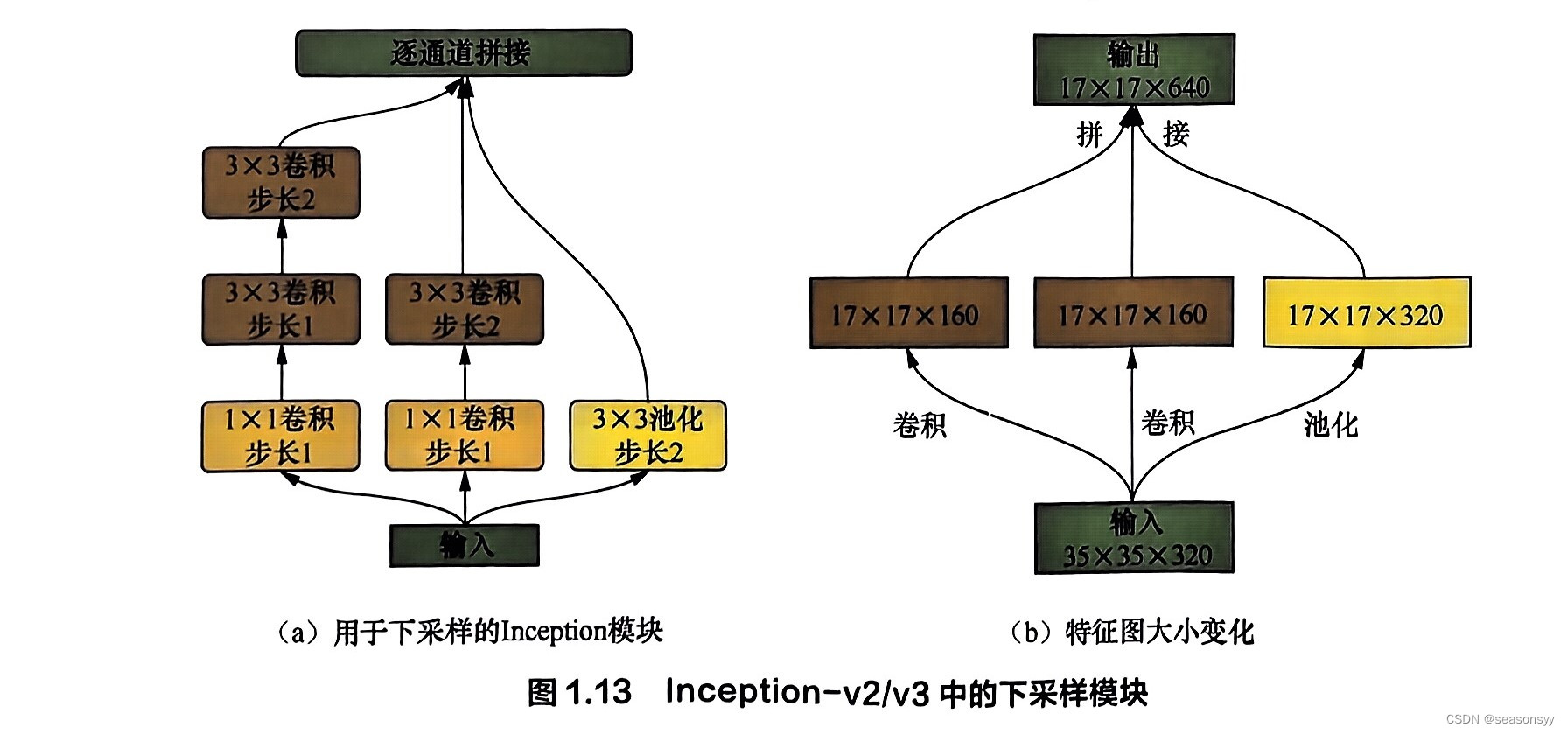

1.8.4 卷积神经网络近年来在结构设计上的主要发展和变迁——Inception-v2 和Inception-v3

1.8.4 卷积神经网络近年来在结构设计上的主要发展和变迁——Inception-v2 和Inception-v3 前情回顾: 1.8.1 卷积神经网络近年来在结构设计上的主要发展和变迁——AlexNet 1.8.2 卷积神经网络近年来在结构设计上的主要发展和变迁——VGGNet 1.8.3 卷积神经网络近年来在结构设计上的主要发展和变迁——GoogleNet/inception-v1

深度学习总结:常见卷积神经网络——Inception

深度学习总结:常见卷积神经网络(2)——Inception Inception v1Inception v2BN层 Inception v3非对称卷积分解 Inception v4总结 上一篇博客主要回顾了VGG和Resnet,这一篇主要回顾一下GoogLeNet系列。 Inception v1 Inception v1提出于2014年,和VGG是同一年,使用了Ince

AlexNet、VGG、ResNet、Inception、MobileNet、EfficientNet。复合缩放方法,深度可分离卷积

目录 AlexNet、VGG、ResNet、Inception、MobileNet、EfficientNe AlexNet VGG Visual Geometry Group 名称的由来 ResNet Inception

Inception安装部署实现SQL自动审核与上线

1 Incption概述 1.1 Inception简介 Inception是集审核、执行、回滚于一体的一个自动化运维系统,它可以对提交的所有语句的语法分析,如果语法有问题,都会将相应的错误信息返回给审核者。 还提供SQL语句的执行功能,可执行的语句类型包括常用的DML及DDL语句及truncate table等操作。 Inception在执行 DML时还提供生成回滚语句的功能,对应

sheng的学习笔记-AI-Inception network

目录:sheng的学习笔记-AI目录-CSDN博客 基础知识 构建卷积层时,你要决定过滤器的大小究竟是1×1(原来是1×3,猜测为口误),3×3还是5×5,或者要不要添加池化层。而Inception网络的作用就是代替你来决定,虽然网络架构因此变得更加复杂,但网络表现却非常好 本文用到基础知识 1*1卷积,需要看文章:sheng的学习笔记-AI-Network in Network(

27 含并行连结的网络 GoogLeNet / Inception V3【李沐动手学深度学习v2】

目录 1. GoogLeNet 2. 代码 2.1 Inception 2.2 GoogLeNet模型 2.3 训练模型 3. 小结 1. GoogLeNet 白色框:用来改变通道数 蓝色框:用来抽取信息 2. 代码 2.1 Inception 如图所示,Inception块由四条并行路径组成。 前三条

Resnet到Inception网络模型结构及代码分析

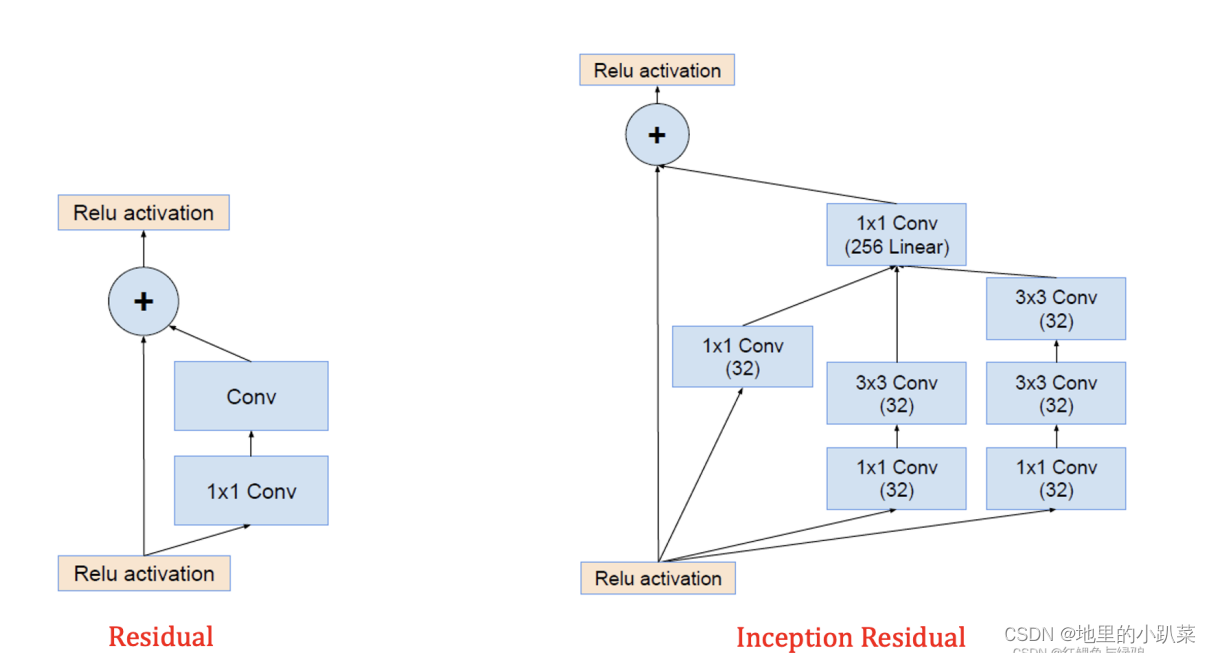

关于inceptionv1-v4的论文以及细节在这篇博客中已经展示的非常的清楚,这里谈谈思考。 inception网络的开创新的优势在于其将神经网络的优化精髓理解的足够透彻,resnet的大神已经证明了网络的深度通过残差网络可以无限的堆叠下去,然后深度到达一定层数后再堆叠下去的作用就很有限了,inception的大神清楚的理解到网络的深度达到一定以后,如果还要想在数据流的角度继续提高模型的

【学习笔记】Tensorflow+Inception-v3训练自己的数据

导读 喵喵的,一个大坑。本文分为吐槽和干货两部分。 一、吐槽 大周末的,被导师扣下加班,嗨气,谁叫本狗子太弱鸡呢,看起来很简单的任务倒腾了两天还没完,不扣你扣谁? 自己刚接到微调Inception-v3的任务时,也是觉得小意思不是,不就下载预训练模型然后finetune? 当然,本狗子是不可能自己写代码的,毕竟弱鸡自己造轮胎从来都漏气。打开网页,眼花缭乱,选定了个看起来算比较简单

[caffe]深度学习之图像分类模型Batch Normalization[BN-inception]解读

一、简介 如果将googlenet称之为google家的inception v1的话,其Batch Normalization(http://arxiv.org/pdf/1502.03167v3.pdf)文章讲的就是BN-inception v1。 它不是网络本身本质上的内容修改,而是为了将conv层的输出做normalization以使得下一层的更新能够更快,更准确。 二、网络

深度学习方法(十一):卷积神经网络结构变化——Google Inception V1-V4,Xception(depthwise convolution)

欢迎转载,转载请注明:本文出自Bin的专栏blog.csdn.net/xbinworld。 技术交流QQ群:433250724,欢迎对算法、机器学习技术感兴趣的同学加入。 上一篇讲了深度学习方法(十):卷积神经网络结构变化——Maxout Networks,Network In Network,Global Average Pooling,本篇讲一讲Google的Inception系列

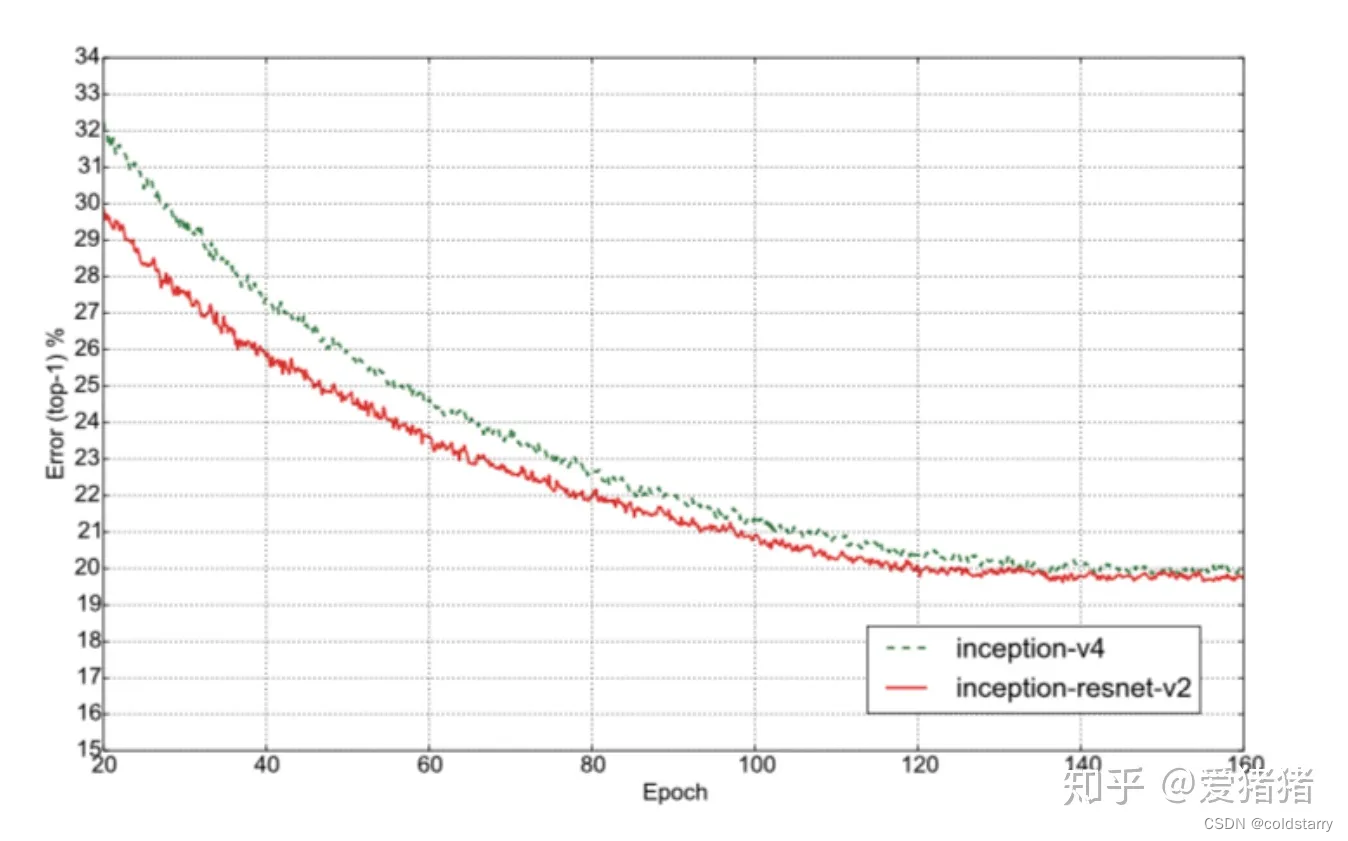

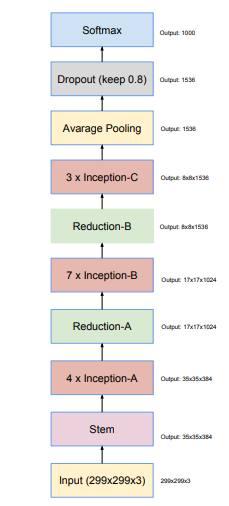

Inception-V4和Inception-Resnet论文阅读和代码解析

目录: 论文阅读 代码解析 小结 论文阅读 论文地址:Inception-v4, Inception-ResNet and the Impact of Residual Connections on Learning 此论文主要是作者尝试将inception与residual结合,而提出了inception-resnet-v1和inception-resnet-v2网络,并且为了

Batch Normalization论文解读与Inception V2代码简析

目录 论文阅读 代码简析 小结 论文阅读 Inception V2是Inception家族的一个中间件产物,在论文Rethinking the Inception Architecture for Computer Vision中提到了Inception V2的概念,但是google的代码实现却是命名为Inception V3。从google实现的Inception V2源码可以看

GoogleLeNet(Inception-V1)论文及代码解析

目录 GoogleLeNet论文 tensorflow代码分析 小结 GoogleLeNet论文 GoogleLeNet是2014年ImageNet中ILSVRC14竞赛的冠军,和VGG网络是同一届,VGG网络是当年竞赛的亚军。但是实际上两个网络的TOP-5错误率相差并不多,GoogleLeNet的网络结构相对VGG复杂一些,是一个22层的网络,并且提出了一种Ince

换汤不换药--我看《Inception》(《盗梦空间》)

最近最火爆的电影应该是《Inception》(《盗梦空间》)了。上映没多久,IMDB的分数就达到了9.3,排名已经是第三了! 我也去电影院看了这部影片。可以说,这部片子对得起我掏的电影票钱,情节很吸引人,场面也够火爆,是一部很不错的电影,值得去电影院看。可是,我个人觉得,这部电影远远配不上它在IMDB的分数和排名! 首先,这部片子的剧本没有任何新意。就是人在梦里做梦的故事,只不