crossentropyloss专题

PyTorch nn.CrossEntropyLoss() 交叉熵损失函数详解和要点提醒

文章目录 前置知识nn.CrossEntropyLoss() 交叉熵损失参数数学公式带权重的公式(weight)标签平滑(label_smoothing) 要点 附录参考链接 前置知识 深度学习:关于损失函数的一些前置知识(PyTorch Loss) nn.CrossEntropyLoss() 交叉熵损失 torch.nn.CrossEntropyLoss(weight=N

深入理解交叉熵损失 CrossEntropyLoss - 最大似然估计

深入理解交叉熵损失 CrossEntropyLoss - 最大似然估计 flyfish 下面有详细的例子和公式的说明。 最大似然估计的概念 最大似然估计是一种统计方法,用来估计模型参数,使得在这些参数下观测到的数据出现的概率(即似然)最大。 具体步骤 定义似然函数: 给定一个参数化的概率模型 P ( X ∣ θ ) P(X|\theta) P(X∣θ),其中 θ \theta θ

深入理解交叉熵损失CrossEntropyLoss - 乘积符号在似然函数中的应用

深入理解交叉熵损失CrossEntropyLoss - 乘积符号在似然函数中的应用 flyfish 乘积符号prod,通常写作 ∏ \prod ∏,它类似于求和符号 ∑ \sum ∑,但它表示的是连续乘积。我们来看一下这个符号的具体用法和例子。 乘积符号 ∏ \prod ∏ 乘积符号 ∏ \prod ∏ 用于表示一系列数的乘积。其具体形式如下: ∏ i = 1 n a i \p

深入理解交叉熵损失CrossEntropyLoss - 概率基础

深入理解交叉熵损失CrossEntropyLoss - 概率基础 flyfish 独立同分布 独立同分布(Independent and Identically Distributed, i.i.d.)是指一组随机变量是相互独立的,并且它们服从相同的概率分布。具体来说: 独立:一个随机变量的取值不受其他随机变量的取值影响。 同分布:所有随机变量都服从相同的概率分布。 例如,在抛硬币实验

深入理解交叉熵损失CrossEntropyLoss - 信息论(交叉熵)

深入理解交叉熵损失CrossEntropyLoss - 信息论(交叉熵) 信息论 深入理解交叉熵损失CrossEntropyLoss - 信息论(交叉熵)一、自信息(Self-Information)1. 符号取负2. 对数的性质3. 信息的度量数学推导与例子 二、熵(Entropy)的定义例子直观理解熵的性质例子 三、KL 散度由来和意义名字的由来KL 散度的定义直观理解实际应用 四、交

nn.BCELoss与nn.CrossEntropyLoss的区别

nn.BCELoss与nn.CrossEntropyLoss的区别 最近的工程涉及到超分辨率增强的相关研究,阅读SRGAN的源代码的时候发现,在损失函数的设置上,生成器和判别器分别用了不同的损失函数: self.criterionG = nn.MSELoss()self.criterionD = nn.BCELoss() 并且,判别器使用的是BCELoss,经过查询,把nn

25_PyTorch的十九个损失函数(L1Loss、MSELoss、CrossEntropyLoss 、CTCLoss、NLLLoss、PoissonNLLLoss 、KLDivLoss等)

1.20.PyTorch的十九个损失函数 1.20.1.L1Loss(L1范数损失) 1.20.2.MSELoss(均方误差损失) 1.20.3.CrossEntropyLoss (交叉熵损失) 1.20.4.CTCLoss(连接时序分类损失) 1.20.5.NLLLoss(负对数似然损失) 1.20.6.PoissonNLLLoss (目标泊松分布的负对数似然损失) 1.20.7.KLDivLo

pytorch中BCELoss、CrossEntropyLoss和NLLLoss

在PyTorch中进行二分类,有三种主要的全连接层,激活函数和loss function组合的方法,分别是:torch.nn.Linear+torch.sigmoid+torch.nn.BCELoss,torch.nn.Linear+BCEWithLogitsLoss,和torch.nn.Linear(输出维度为2)+torch.nn.CrossEntropyLoss,BCEWithLogitsL

[转载]用数据说话 Pytorch详解NLLLoss和CrossEntropyLoss

[转载]用数据说话 Pytorch详解NLLLoss和CrossEntropyLoss https://www.cnblogs.com/jiading/p/11979391.html NLL_Loss & CrossEntropyLoss(交叉熵) https://blog.csdn.net/Tabbyddd/article/details/106101759 PyTo

理解pytorch损失函数Softmax、crossentropyloss交叉熵

import torchimport torch.nn as nnx_input=torch.randn(3,3)#随机生成输入print('x_input:\n',x_input)y_target=torch.tensor([1,2,0])#设置输出具体值 print('y_target\n',y_target)#计算输入softmax,此时可以看到每一行加到一起结果都是1softma

二元交叉熵损失函数(Binary Cross Entropy Loss,BCELoss)是交叉熵损失函数(CrossEntropyLoss)的特殊情况

一直以来看到二元交叉熵损失函数(Binary Cross Entropy Loss,BCELoss) 还以为是很复杂的东西,原来其实是交叉熵损失函数(CrossEntropyLoss)的特殊情况,也就是二元交叉熵损失函数其实就是交叉熵损失函数。 推导如下: 对于多分类问题,交叉熵损失函数的一般形式如下: CrossEntropyLoss ( input , target ) = − ∑ i

torch.nn.CrossEntropyLoss

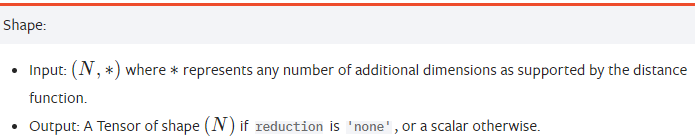

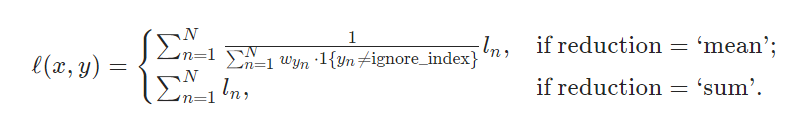

1.说明 交叉熵损失函数是神经网路中比较有用的函数,作用是为了计算出初始化的 y 和实际标签 label 的差别。 torch.nn.CrossEntropyLoss(weight=None, size_average=None, ignore_index=- 100, reduce=None, reduction='mean', label_smoothing=0.0) 公式: l (