本文主要是介绍前馈神经网络基础教程,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

@(深度学习)[神经网络]

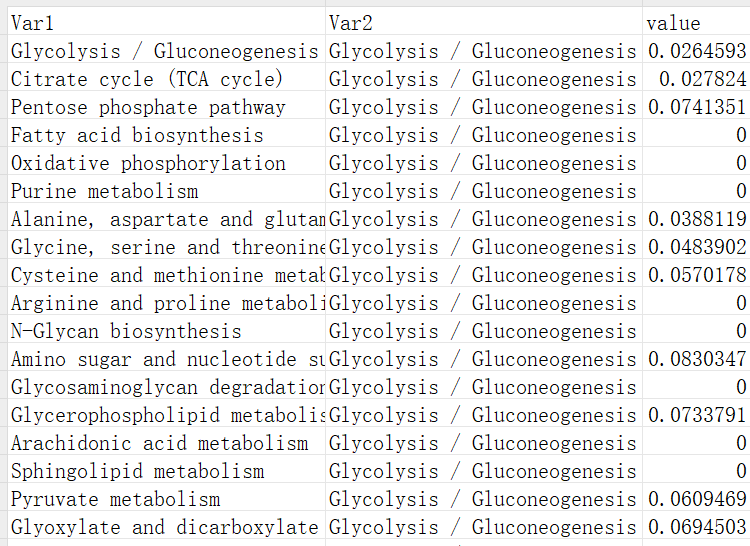

本文主要参考链接

#1. 前馈神经网络基础教程

##1.1. 概述

以监督学习为例,假设我们有训练样本集 ( x ( i ) , y ( i ) ) (x(^i),y(^i)) (x(i),y(i)),那么神经网络算法能够提供一种负责且非线性的假设模型 h W , b ( x ) h_{W,b}(x) hW,b(x),它具有参数 W , b W,b W,b,可以通过调整此参数来拟合我们的数据。

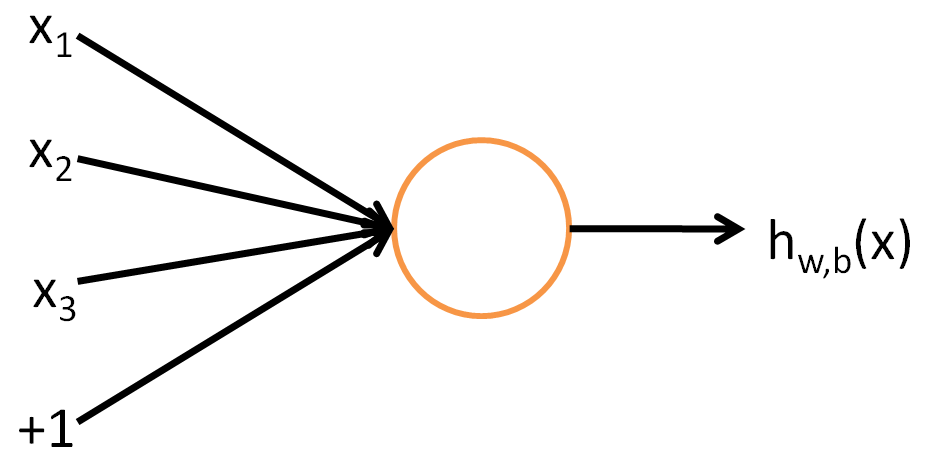

为了描述神经网络,我们先从最简单的神经网络讲起,这个神经网络仅由一个“神经元”构成,以下即是这个“神经元”的图示:

这个“神经元”是一个以 x 1 , x 2 , x 3 x_1, x_2, x_3 x1,x2,x3及截距+1为输入值的运算单元,其输出为 h W , b ( x ) = f ( W T X ) = f ( ∑ i = 1 3 W i x i + b ) h_{W,b}(x)=f(W^TX)=f(\sum_{i=1}^{3}W_ix_i+b) hW,b(x)=f(WTX)=f(∑i=13Wixi+b),其中函数 f : R ⟼ R f:\mathscr{R}\longmapsto \mathscr{R} f:R⟼R被称为激活函数。注意,有的教程中用 x 0 = 1 x_0=1 x0=1来表示截距+1。在本教程中,我们选用sigmoid函数作为激活函数 f ( ⋅ ) f(\cdot) f(⋅):

f ( z ) = 1 1 + e x p ( − z ) f(z)=\frac{1}{1+exp(-z)} f(z)=1+exp(−z)1

可以看出,这个单一“神经元”的输入输出映射关系其实就是一个逻辑回归(logistic regression)。

##1.2. 神经网络模型

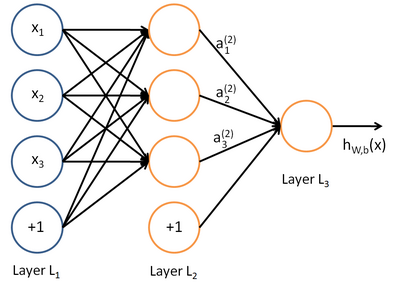

所谓神经网络就是将许多个单一“神经元”联结在一起,这样,一个“神经元”的输出就可以是另一个“神经元”的输入。下图是一个简单的神经网络例子:

我们使用圆圈来表示神经网络的输入,标上“+1”的圆圈被称为偏置节点,也就是截距项。神经网络最左边的一层叫做输入层,最右边的一层叫做输出层(在本例中,输出层只有一个节点)。中间所有节点组成的一层叫做隐藏层,因为我们不能在训练样本集中观测到它们的值。同时可以看到,以上神经网络的例子中有3个输入单元(偏置单元不计在内),3个隐藏单元以及1个输出单元。

我们用 n l n_l nl来表示网络的层数,本例中 n l = 3 n_l=3 nl=3,记第 l l l层记为 L l L_l Ll,于是 L 1 L_1 L1是输入层, L n l L_{n_l} Lnl是输出层。本例神经网络有参数 ( W , b ) = ( W ( 1 ) , b ( 1 ) , W ( 2 ) , b ( 2 ) ) (W,b)=(W^{(1)},b^{(1)},W^{(2)},b^{(2)}) (W,b)=(W(1),b(1),W(2),b(2)),其中 W i j ( l ) W_{ij}^{(l)} Wij(l)(下面的式子中用到)是第 l l l层第 j j j单元与第 l + 1 l+1 l+1层第 i i i单元之间的联接参数(连接线上的权重,从 j j j到 i i i), b i ( l ) b_i^{(l)} bi(l)是第 l + 1 l+1 l+1层第 i i i单元的偏置项。因此在本例中, W ( 1 ) ∈ R 3 × 3 W^{(1)}\in\mathscr{R}^{3\times3} W(1)∈R3×3, W ( 2 ) ∈ R 1 × 3 W^{(2)}\in\mathscr{R}^{1\times3} W(2)∈R1×3。注意,偏置单元没有输入,是因为他们总是输出+1。同时,我们用 s l s_l sl表示第 l l l层的结点数(不包括偏置单元)。

我们用 a i ( l ) a_i^{(l)} ai(l)表示第 l l l层第 i i i单元的激活值的(输出值)。当 l = 1 l=1 l=1时, a i ( l ) = x i a_i^{(l)}=x_i ai(l)=xi,也就是输入层的第 i i i个输入值(输入值的第 i i i个特征)。对于给定参数集合 W , b W,b W,b,我们的神经网络就可以按照 h W , b ( x ) h_{W,b}(x) hW,b(x)来计算输出结果。本例中神经网络的计算步骤如下:

\begin{align}

a_1{(2)}&=f(W_{11}{(1)}x_1+W_{12}{(1)}x_2+W_{13}{(1)}x_3+b_1^{(1)})\

a_2{(2)}&=f(W_{21}{(1)}x_1+W_{22}{(1)}x_2+W_{23}{(1)}x_3+b_2^{(1)})\

a_3{(2)}&=f(W_{31}{(1)}x_1+W_{32}{(1)}x_2+W_{33}{(1)}x_3+b_3^{(1)})\

h_{W,b}(x)&=a_1{(3)}=f(W_{11}{(2)}a_1{(2)}+W_{12}{(2)}a_2{(2)}+W_{13}{(2)}a_3{(2)}+b_1{(2)})

\end{align}

我们用 z i ( l ) z_i^{(l)} zi(l)表示第 l l l层第 i i i单元输入加权和(包括偏置单元),比如, z i ( 2 ) = ∑ j = 1 n W i j ( 1 ) x j + b i ( 1 ) z_i^{(2)}=\sum_{j=1}^nW_{ij}^{(1)}x_j+b_i^{(1)} zi(2)=∑j=1nWij(1)xj+bi(1), a i ( 2 ) = f ( z i ( 2 ) ) a_i^{(2)}=f(z_i^{(2)}) ai(2)=f(zi(2))。

我们将激活函数 f ( ⋅ ) f(\cdot) f(⋅)扩展为向量形式: f ( [ z 1 , z 2 , z 3 ] ) = [ f ( z 1 ) , f ( z 2 ) , f ( z 3 ) ] f([z_1,z_2,z_3])=[f(z_1),f(z_2),f(z_3)] f([z1,z2,z3])=[f(z1),f(z2),f(z3)],那么,上面的等式可以更简洁地表示为:

\begin{align}

z{(2)}&=W{(1)}x+b^{(1)}\

a{(2)}&=f(z{(2)})\

z{(3)}&=W{(2)}a{(2)}+b{(2)}\

h_{W,b}(x)&=a{(3)}=f(z{(3)})\

\end{align}

我们将上面的计算步骤叫做前向传播。给定第 l l l层的激活值 a ( l ) a^{(l)} a(l)后,第 l + 1 l+1 l+1层的激活值 a ( l + 1 ) a^{(l+1)} a(l+1)就可以按照下面步骤计算得到:

\begin{align}

z{(l+1)}&=W{(l)}a{(l)}+b{(l)}\

a{(l+1)}&=f(z{(l+1)})\

\end{align}

将参数矩阵化,使用矩阵-向量运算方式,我们就可以利用线性代数的优势对神经网络进行快速求解。

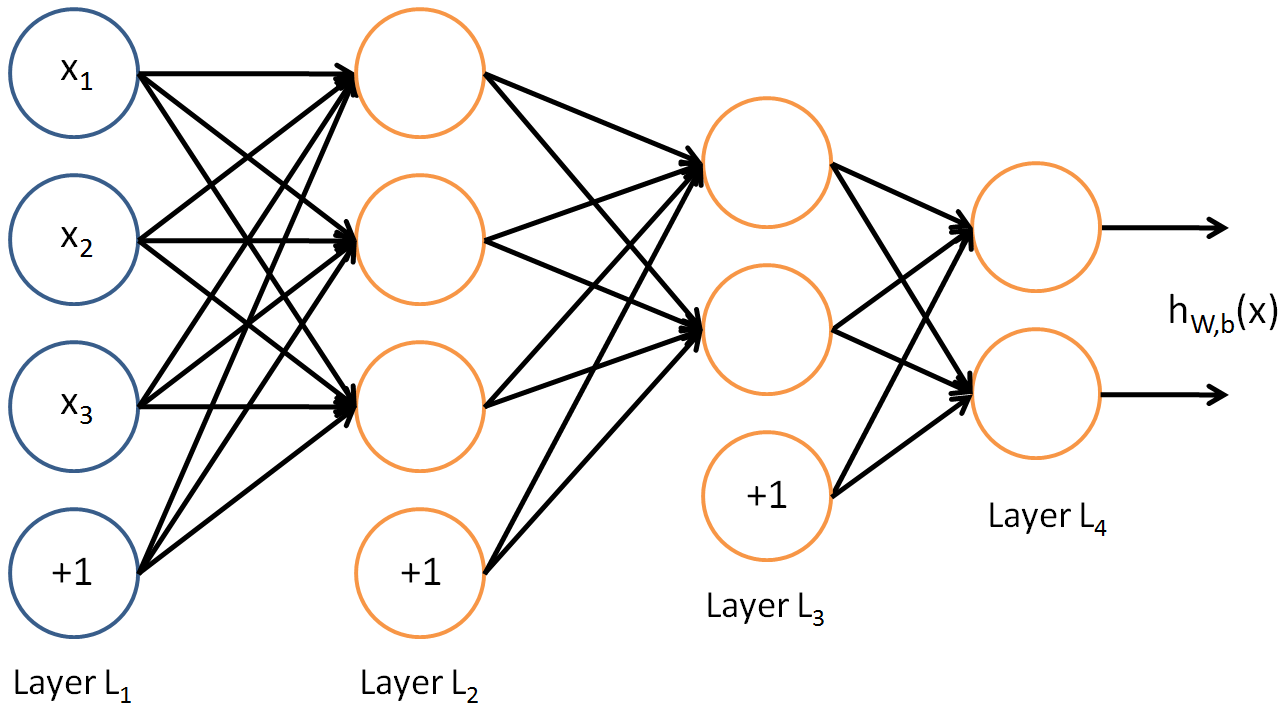

神经网络也可以由多个隐藏层和多个输出单元,例如下图所示:

像上图这样的网络,叫做前馈神经网络,这种联接图没有闭环或回路。

这篇关于前馈神经网络基础教程的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!