本文主要是介绍优思学院|如何领导六西格玛变革?学习哈佛商学院的八步变革模型,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

哈佛商学院的领导力和变革管理教授 John.P. Kotter 在1995年出版的《领导变革 - Leading Change》一书中介绍了他的开创性的8步变革模型。该模型建立在库尔特-卢因的工作基础上,列出了变革过程中的8个关键步骤,认为忽视其中任何一个步骤都足以导致整个计划的失败。

这是作为六西格玛黑带的一堂重要的课,因为黑带的职责不只是在提供统计技术,更重要的,是领导变革,创造改变!

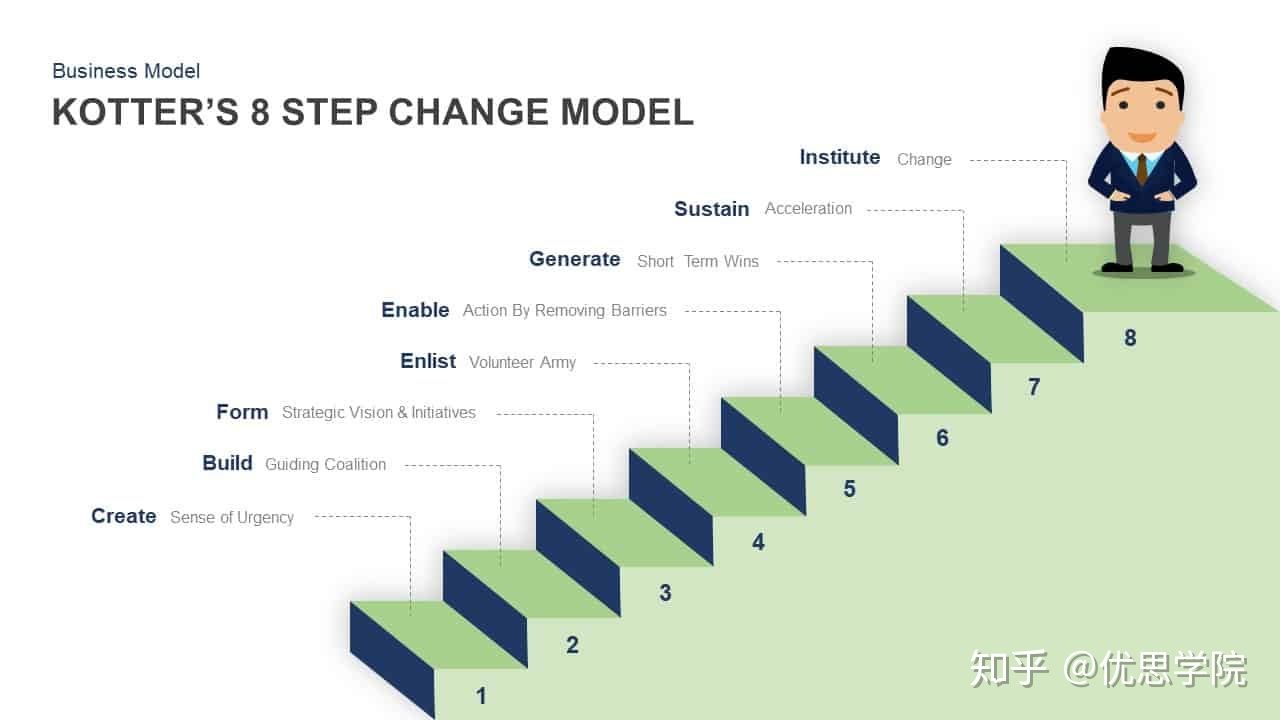

第一步:创造紧迫感 - Create Urgency

变革对组织的成功是必要的,这种想法是非常有力的。如果你能创造一个环境,让个人意识到现有的问题,并能看到可能的解决方案,那么对变革的支持就有可能增加。引起关于正在发生的事情和组织可以朝着什么方向发展的对话将有助于实现这一目标。启动这一进程的方法之一是创建一个论坛,在论坛上提出并讨论问题和潜在的解决方案。这一步就是准备工作,Kotter估计,一个公司大约75%的管理层需要支持变革才能成功。这强调了他的观点,即在跳入变革过程之前做好准备是很重要的。这一步创造了变革的 "需要",而不仅仅是变革的 "想要"。当涉及到变革可能得到的支持和最终的成功时,这种区别是非常重要的。

第二步:形成一个强大的联盟 - Form a Powerful Coalition

单枪匹马地领导整个变革过程是非常困难的,因此,建立一个联盟来帮助你指导他人是非常重要的。你建立的联盟应该由各种技能、各种经验和来自企业不同领域的人组成,以最大限度地提高其效率。 联盟可以帮助你在整个组织中传播信息,下放任务,确保整个组织范围内对变革的支持。团队成员之间相互协作、相互补充,并能推动对方更加努力地工作,将使你的生活更加轻松,变革更有可能取得成功。

第三步:创造一个变革的愿景 - Create a Vision for Change

一项变革举措很可能非常复杂,往往难以理解,尤其是对处于下层的员工而言。因此,创造一个易于理解并能概括总体目标的愿景,是获得整个组织支持的有效方法。虽然这个愿景应该是简单易懂的,但它也需要鼓舞人心,以产生最大的效果。

第四步:传播愿景 - Communicate the Vision

仅仅创造愿景还不足以获得支持,还需要在整个组织内进行沟通。这是一个很好的机会,可以利用你所建立的联盟,因为他们之间很可能在企业的每个领域都有网络。重要的是要不断地传达这个信息,因为很有可能竞争的信息也会被传播。

第五步:排除障碍 - Remove Obstacles

前四个步骤对于增强你的变革计划的力量是至关重要的,但同样重要的是,要寻找有可能降低其成功机会的因素。无论是个人、传统、法律还是物理障碍,很可能会有一些障碍阻挡你的变革之路。尽早发现这些障碍,并依靠现有资源来打破它们,而不影响任何其他领域的业务。

第六步:创造短期的胜利 - Create Short-Term Wins

变革进程往往需要一段时间才能获得任何回报,如果个人认为他们的努力白费了,就会导致支持率下降。因此,重要的是要通过创造一些短期的胜利来证明新进程的优势。短期目标也是激励和指导的有用工具。利用这些胜利来证明投资和努力的合理性,可以帮助重新激励员工继续支持变革。

第七步:在变革的基础上再接再厉 - Build on the Change

许多变革过程在临近结束时由于自满情绪的滋生而失败,项目没有正常完成。因此,Kotter认为,在变革完成后的很长一段时间内,保持和巩固变革是很重要的。不断设定目标,分析哪些地方可以做得更好,以便持续改进。

第八步:锚定企业文化的变革 - Anchor the Changes in Corporate Culture

仅仅改变员工的习惯和流程并不总是足以在整个组织中灌输文化变革。这些改变应该成为组织核心的一部分,才能产生持久的效果。让高级利益相关者参与进来,鼓励新员工采用变革,并对采用变革的个人进行庆祝,这些都将有助于推动变革成为组织的核心。

Kotter概述这些步骤的主要原因是强调变革不是一个简单快速的过程。需要许多步骤的规划,即使变革已经实施,仍有许多工作要做,以确保变革的成功。

这篇关于优思学院|如何领导六西格玛变革?学习哈佛商学院的八步变革模型的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!