本文主要是介绍悬赏1000万美元,打假AI换脸!Facebook发起Deepfakes检测挑战赛,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

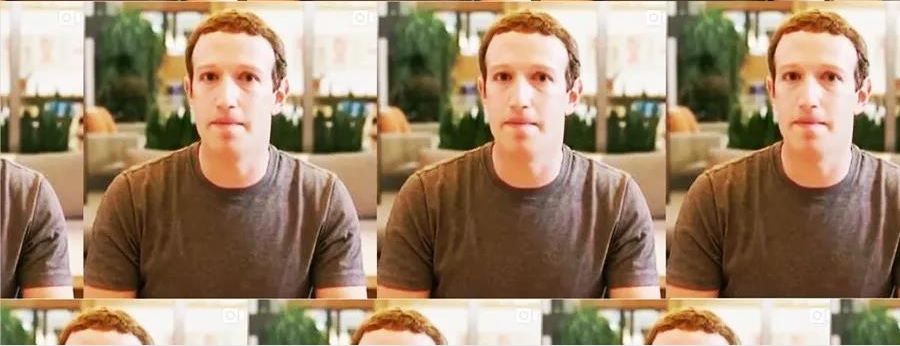

【导读】近日,Facebook宣布启动一项“Deepfake视频检测挑战赛”,壕掷1000万美元,悬赏能够最好地检测出利用Deepfake技术制造的假视频,包括微软、MIT、牛津大学,加州大学伯克利分校等业界学界联合支持。

Facebook宣布了一项名为Deepfake Detection Challenge(DFDC)的挑战赛,壕掷1000万美元,悬赏能够最好地检测出利用Deepfake技术制造的假视频。

Facebook的首席技术官Mike Schroepfer表示,挑战的目标是“创造出每个人都可以使用的技术,以便更好地检测AI何时被用来改变视频以误导观众。”

Deepfake检测挑战赛将包括一个数据集和排行榜,以及拨款和奖励,以刺激行业创造新的方式来检测和防止通过AI操纵的媒体被用来误导他人。

悬赏1000万美元,挑战赛获学界支持

Yann LeCun 曾在 Twitter 上提问:

讲真,要是当初知道卷积神经网络 (CNN) 会催生 DeepFake,我们还要不要发表 CNN?

他说:“假设在上世纪 80 年代那时我们能够预见 CNN 的这些负面影响,我们该不该把 CNN 模型保密不公开呢?”

LeCun最后的结论是,就算自己不开源,CNN (或者类似的东西) 还是会被其他人发明出来 (实际上,有些人可以说差不多已经做到了)。

既然已经开源,并且已经导致了负面影响,思考如何阻止和对抗这些负面影响更有价值。

这次,Facebook投入了超过1000万美元来资助这项全行业的努力。

为了确保数据集和挑战参数的质量,这些参数最初将在今年10月的国际计算机视觉会议(ICCV)上通过有针对性的技术工作会议进行测试。

完整的数据集发布和DFDC发布将于今年12月召开的神经信息处理系统会议(NeurIPS)上发布。Facebook也将参与挑战,但不接受任何经济奖励。

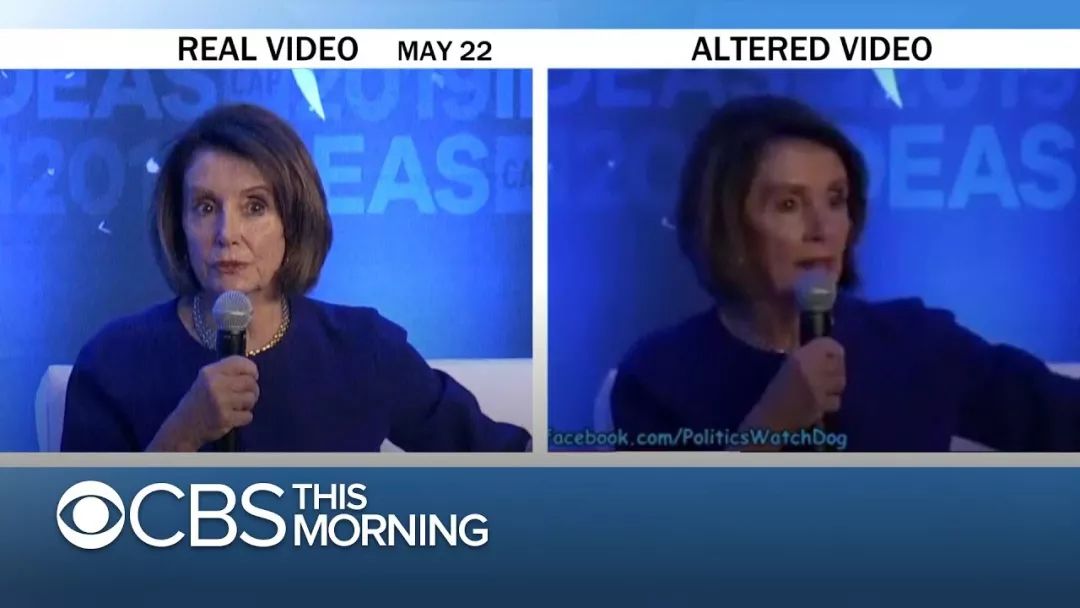

有“换脸”就有“反换脸”,越来越多的研究人员在努力寻找准确识别 Deepfake 的假视频的方法。

最迫切希望攻破Deepfake的是美国国防部DAPRA,他们发起Media Forensics项目(简称MediFor),资助研发一系列自动化工具来辨识被ps的图片、Deepfake伪造的视频、等等。

他们的第一个成果是一款“反换脸”AI刑侦工具,主要由纽约州立大学奥尔巴尼分校的研究人员开发技术,通过有效地预测眼睛的状态,准确率达到 99%。

研究人员发现,Deepfake假视频里的人物极少眨眼,甚至不会眨眼,因为它们都是使用睁眼的照片进行训练的。利用这些细微的线索,可以检测出图像或视频中的脸是真实的还是 AI 生成的。

早期的 Deepfake 生成的假视频缺陷明显,比如人物说话时从不眨眼,现在这个缺陷已被修复

然而,这一工具来不及实用化就被宣告无效了——早期的Deepfake视频远远算不上完美,存在各种容易发现的缺陷,比如不眨眼。但 Deepfake 技术的发展速度非常惊人,假视频中人物从不眨眼的缺陷很快得到了改善,生成的假视频变得越来越逼真可信。

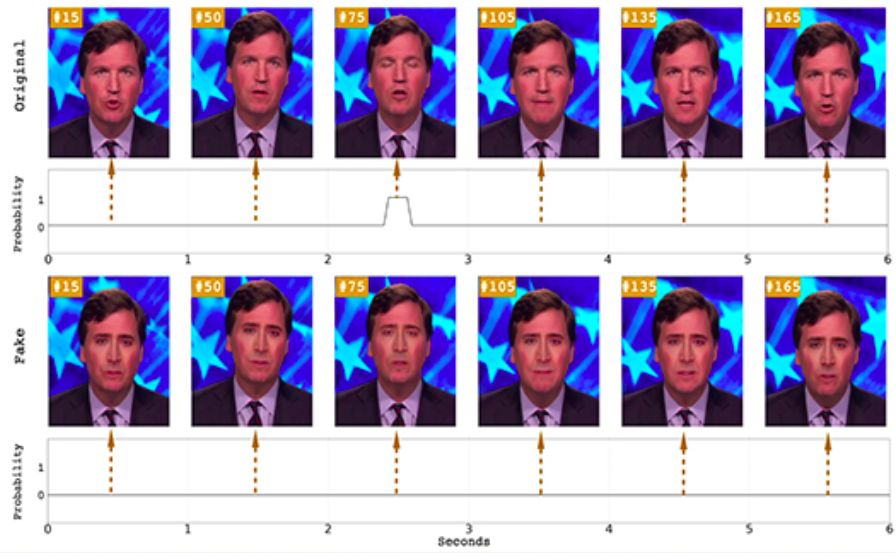

最近,来自加州大学伯克利分校和南加州大学的研究人员在“以AI攻AI”的这场战斗中开发了出了新的武器,可以更加准确地识别伪造的视频。研究人员利用前总统奥巴马的现有视频,使用类似的过程来创建假视频,训练 AI 来寻找每个人的 “软性生物识别” 标签。

图 2. 从上到下依次是原始视频,嘴唇同步 Deepfake 假视频、喜剧模仿视频、换脸 Deepfake 和木偶大师 deepfake 的 10 秒视频剪辑的五个示例帧。

这听起来很复杂,其实并不陌生。每当我们开口说话时,都会以微妙但独特的方式来移动身体,我们的头、手、眼睛甚至嘴唇都会产生这样的运动。这一切都是在潜意识里完成的,你没有意识到你的身体正在做这件事,大脑也没有立刻意识到身体其他部位的运动发生在何时,但从结果上看,这是目前 Deepfake 在创造假视频时的时候没有考虑到的因素。

在实验中,这款新的 AI 准确发现伪造视频的几率达到了 92%,实验对象包括使用多种技术创建的假视频,以及由于视频文件被过度压缩导致图像质量下降的视频。

不过,研究人员也发现,该方法的适用性容易受到人们说话的不同背景的影响(直面镜头正式讲话,与不看镜头的现场采访),解决这些局限仍需要更多的研究。

现在,Facebook、微软、MIT、UC伯克利等业界和学校联合发起的这项Deepfake 检测挑战赛,无疑将进一步推进“反换脸”的进步,有兴趣的同学快去参与。

这篇关于悬赏1000万美元,打假AI换脸!Facebook发起Deepfakes检测挑战赛的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!